当前时间: 2026-04-04 22:00:58

更新时间: 2026-04-04

分类:软件教程

评论(0)

Claude源码泄露,跟你有什么关系

3月31号,Anthropic发布Claude Code新版本的时候,工程师忘了删一个调试文件,把源代码推到了公开平台上

我也上网找到了泄露的源代码,投喂给了我的Claude,让它帮我分析了一下,里面有一些比较有价值的信息

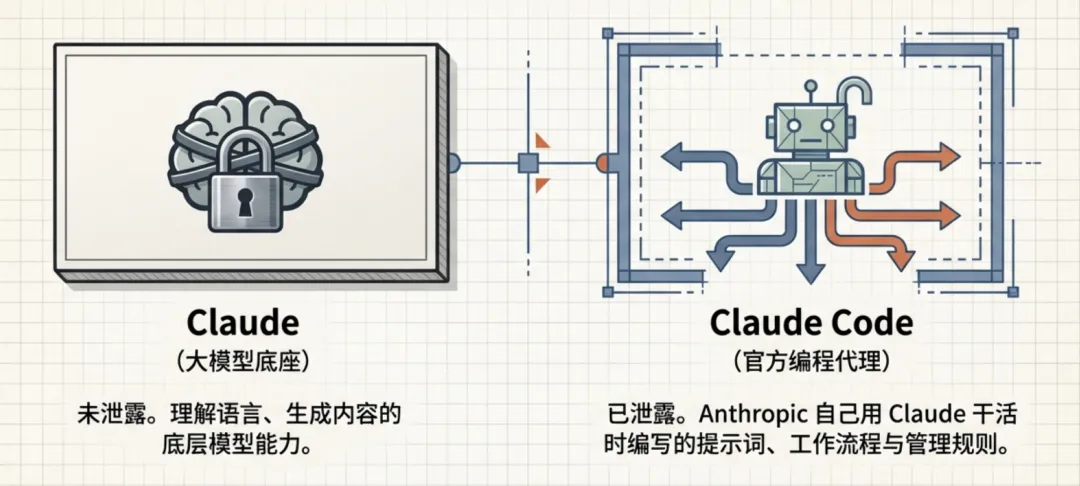

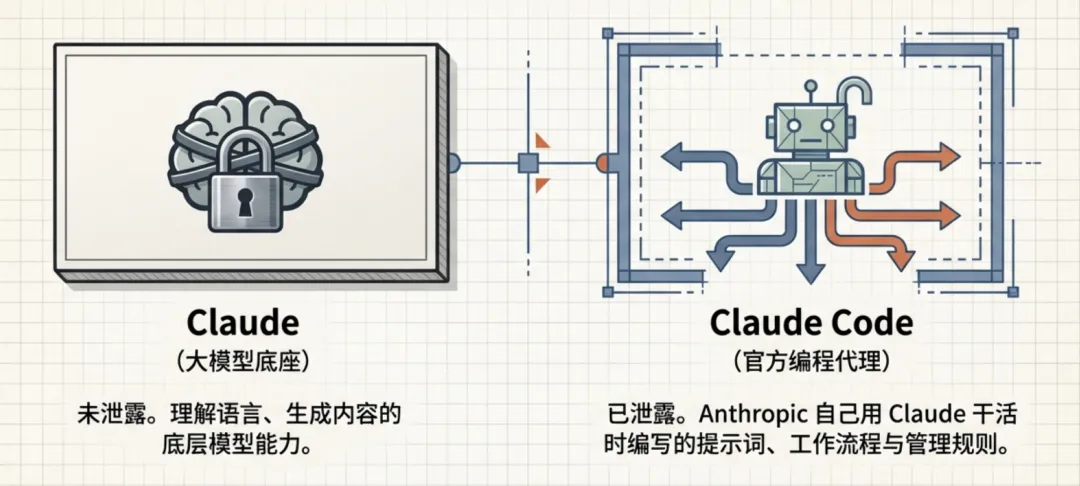

这次泄露的是Claude Code的源代码,不是Claude的源代码

Claude是大模型本身,就是你跟它对话时,它理解你在说什么、帮你写东西、帮你分析问题的那个能力,这个没有泄露

Claude Code是Anthropic基于这个大模型做的一个编程工具,你可以理解为:Anthropic自己也在用Claude,Claude Code就是他们用Claude干活时写的提示词、工作流程、和管理规则

所以我们能分析的方向,主要就是:做AI的公司自己是怎么给AI写提示词的,他们在实际使用中踩过什么坑、总结出了什么经验

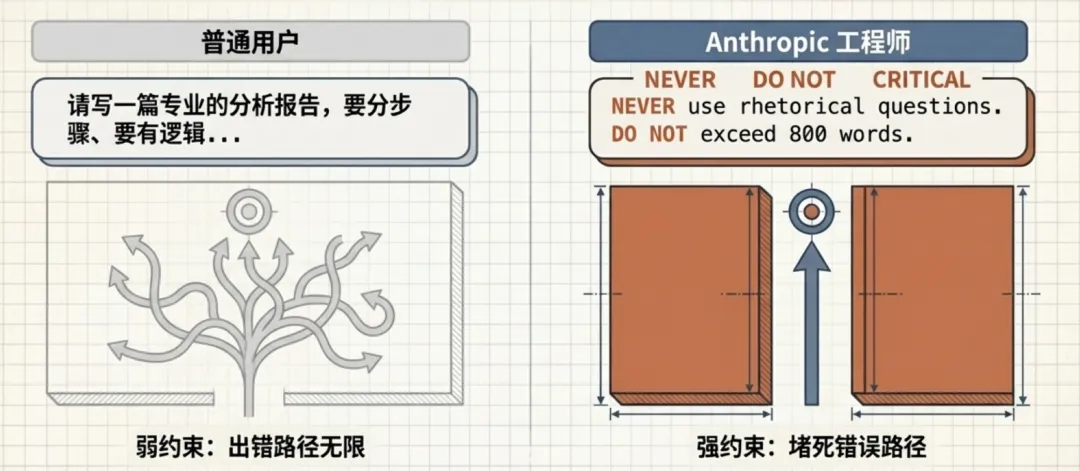

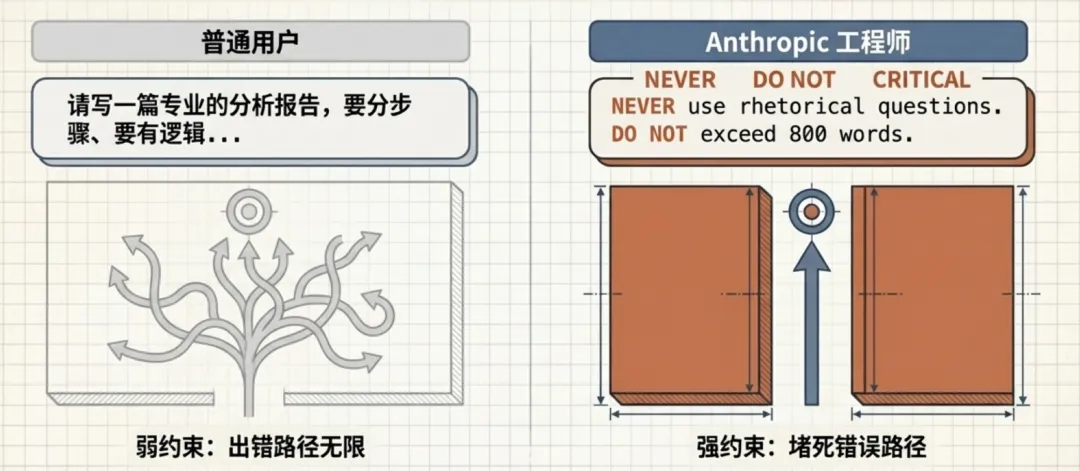

1️⃣Anthropic自己写提示词,用得最多的词是”不要”

我们平时给AI写提示词,本能想的是要怎样怎样,要分步骤、要有逻辑、要专业。但Claude Code内部的提示词,大量在用NEVER、DO NOT、CRITICAL。

与其跟AI说请写一篇专业的分析报告,不如说”不要用排比句,不要写空话套话,不要超过800字”。禁令比指令精准得多,AI做对的方式有一万种,但做错的方式就那么几种,把错的堵死,对的自然就出来了。

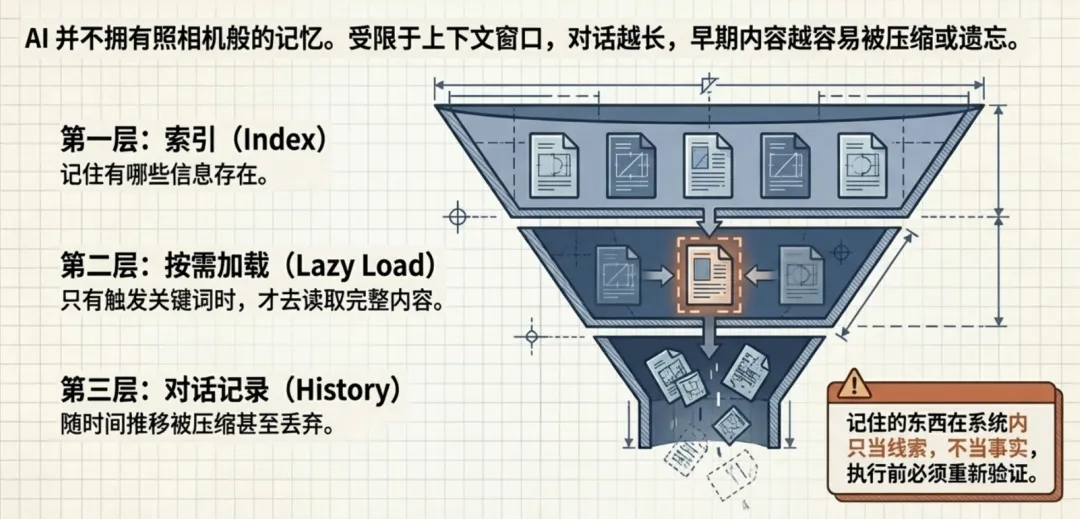

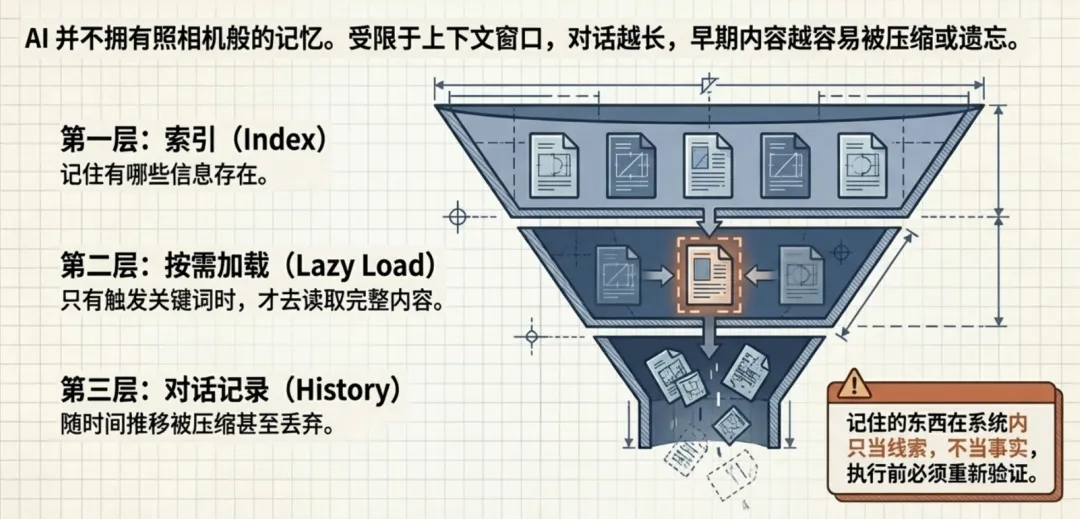

很多人觉得AI记忆力强,聊过的东西它都记得,其实不是。

Anthropic给Claude Code设计的记忆系统,核心原则是:记住的东西只当线索,不当事实,执行任务之前必须回去重新验证。

而且AI的记忆有一个上下文窗口的限制,对话越长,早期的内容就会被压缩甚至丢掉,这也是为什么聊着聊着AI会忘记之前说过的事。

Anthropic的处理方式是分了三层:第一层是索引,记住有哪些信息;第二层是按需加载,用到的时候才去读完整内容;第三层是对话记录本身。

还有一个比较有意思的设计,用户不用AI的时候,AI会在后台自己整理记忆,把散的信息归拢,发现矛盾的删掉,过时的清理掉,Anthropic内部给这个功能取名叫autoDream

②一个对话窗口只聊一个主题,避免上下文被无关内容稀释

③如果是长期项目,把关键信息整理成一个文档,每次对话开头投喂进去

④发现AI的回答开始跑偏或者遗漏之前的要求,大概率是上下文被压缩了,可以开新对话重新开始

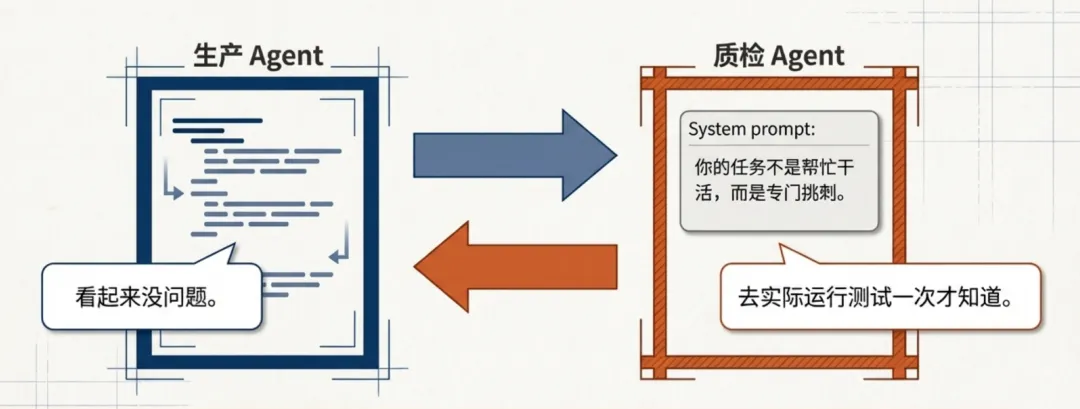

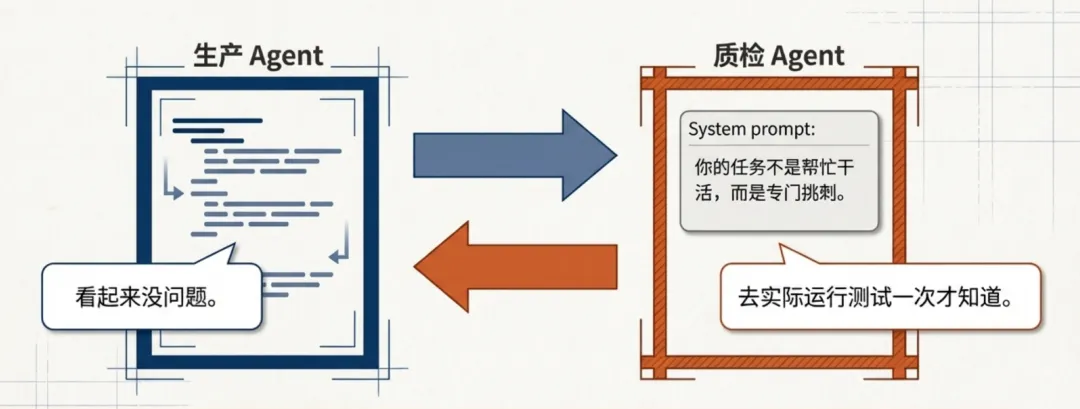

3️⃣Anthropic给AI安了一个专门唱反调的角色

源码里专门设了一个验证者,任务不是帮忙干活,是专门挑刺的。

AI说看起来没问题,验证者会说:看起来没问题不等于验证过了,去实际试一下。

这个思路我们完全可以自己用,让AI帮忙写了一个方案,别直接用,开一个新对话,把方案扔进去,说:找出所有漏洞和可能翻车的地方。

一个AI负责生产,一个AI负责质检,比我们自己检查好得多。因为自己检查的时候,会倾向于觉得”我写的应该没问题”,AI没有这个心理包袱。

内部测试数据显示,新版模型的虚假声明率从16.7%涨到了29%,翻了将近一倍。

AI的迭代不是一条直线往上走的,有时候某个方面改进了,另一个方面反而退步。

涉及事实和数据的内容,建议不要直接用AI给的结论,几个可以降低风险的方式:

①让AI在回答的时候标注信息来源,没有来源的判断要打个问号

③可以直接在提示词里加一句”如果不确定的内容,请标注你的确信程度”,AI会对自己的回答做一个可信度评估

④同一个问题问两次,如果两次回答的关键信息不一致,大概率有编造的成分

源码里能看到,Claude Code的任务循环有一个明确的停止机制,它需要知道什么状态算做完了。

如果任务描述得比较模糊,AI容易陷入循环,反复调整但不知道该停在哪。

比如不要说帮我优化这段文案,而是说”帮我改到200字以内,重点突出XX,改完就停”。

再比如不要说帮我检查一下有没有问题,而是说”检查有没有逻辑矛盾和事实错误,如果没有就告诉我没问题”。

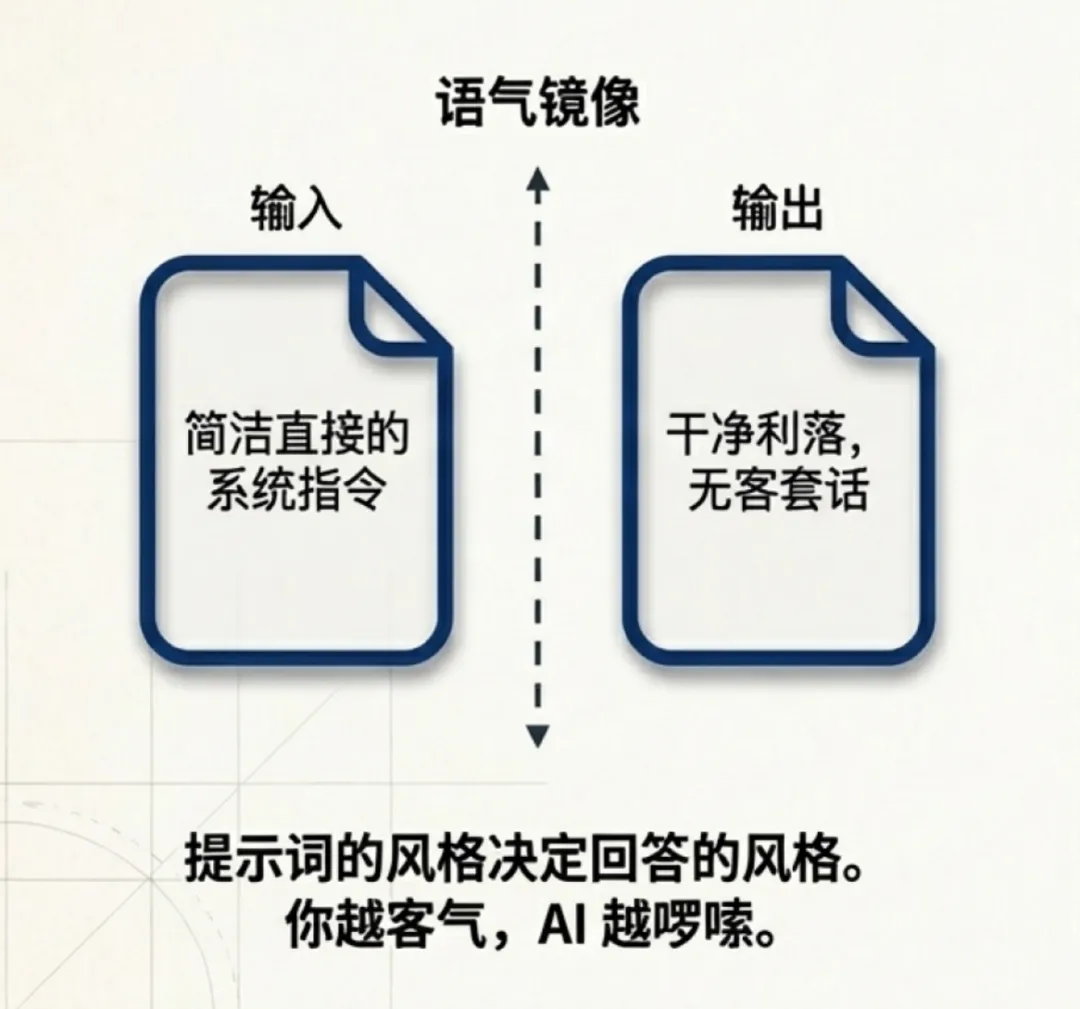

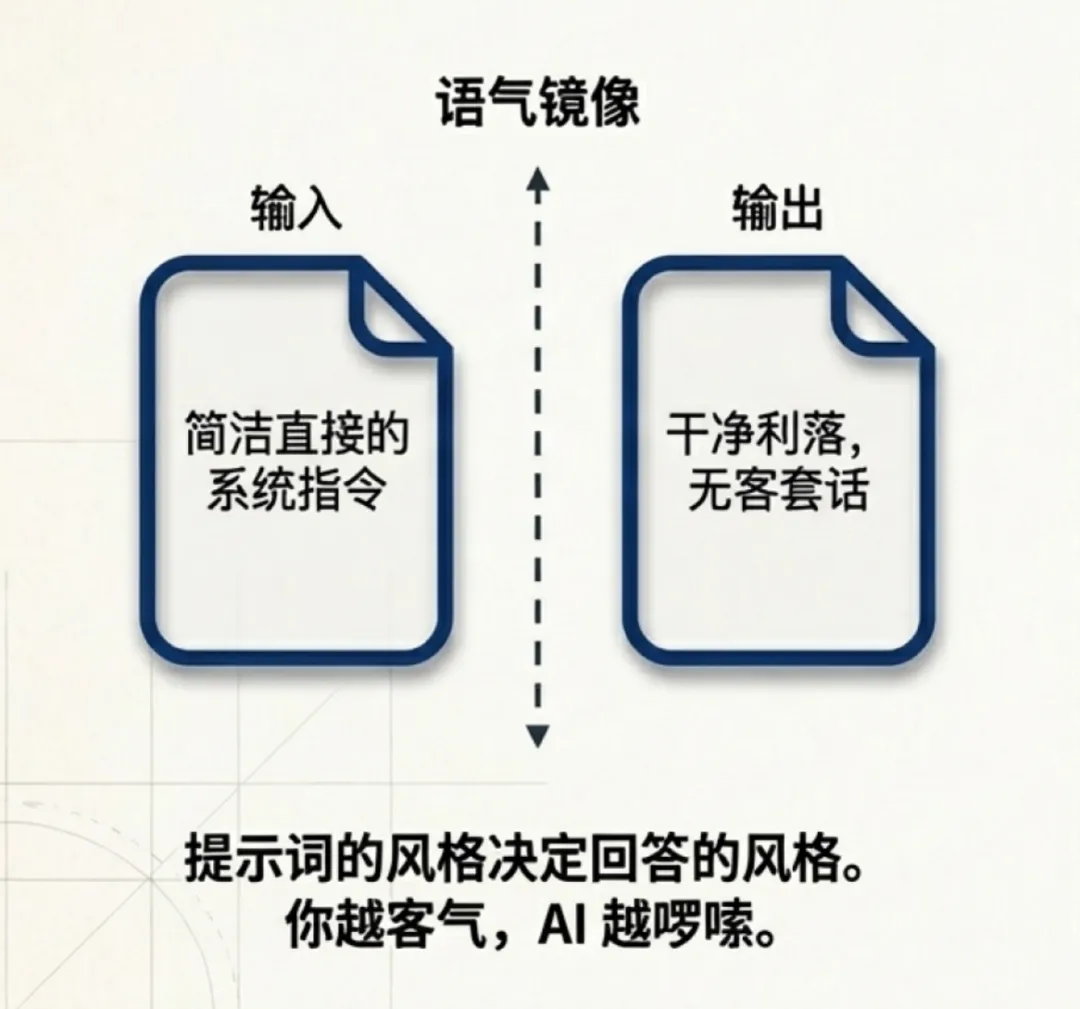

源码里可以看到,Anthropic给Claude Code写的系统提示词本身就是简洁直接的,明确要求AI不要说好的!、当然可以!这种客套话。

这说明一个事情:我们写提示词的语气,会影响AI回答的语气。

如果我们用很正式、很客气的方式提问,AI也倾向于给很正式、很客气的回答,通常也更啰嗦。如果提示词本身就简洁直接,AI的回答也会更干脆。

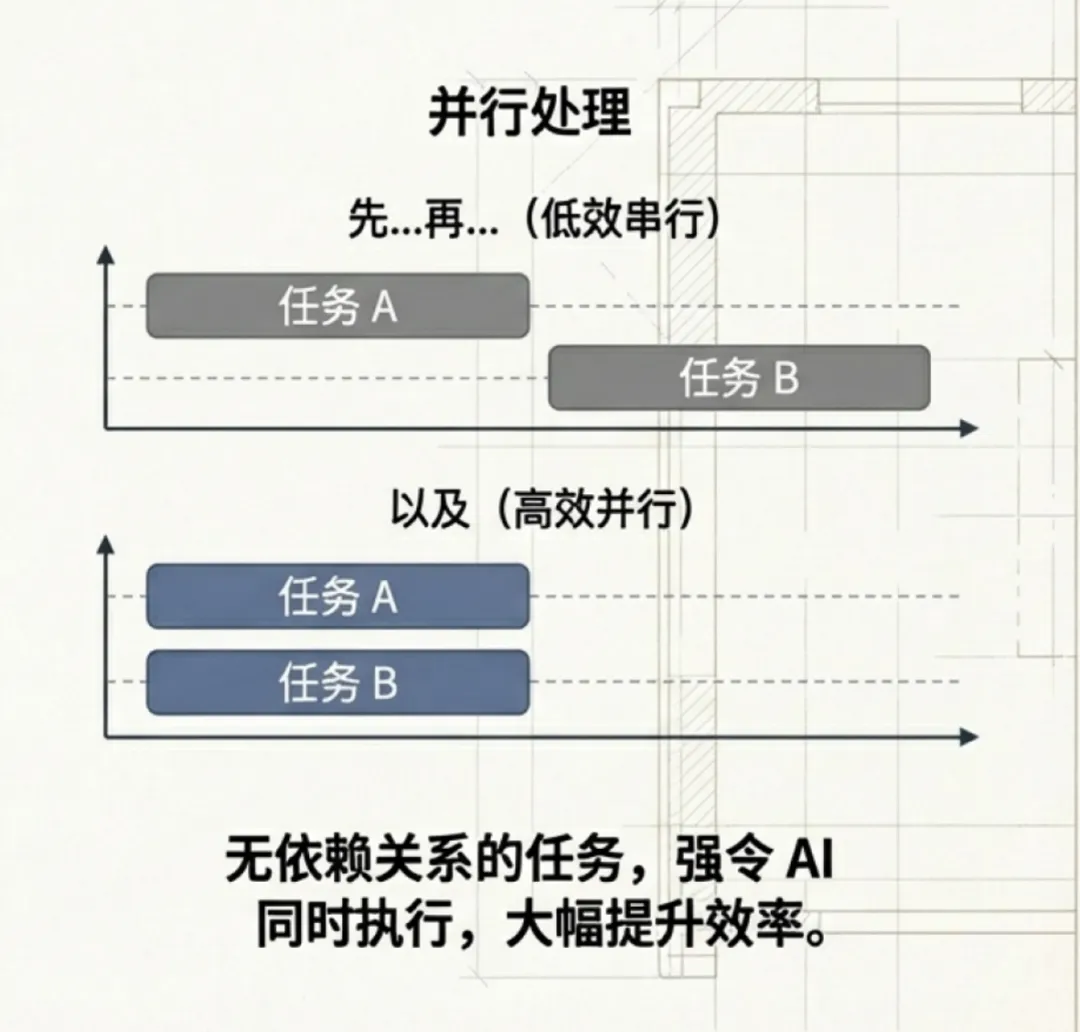

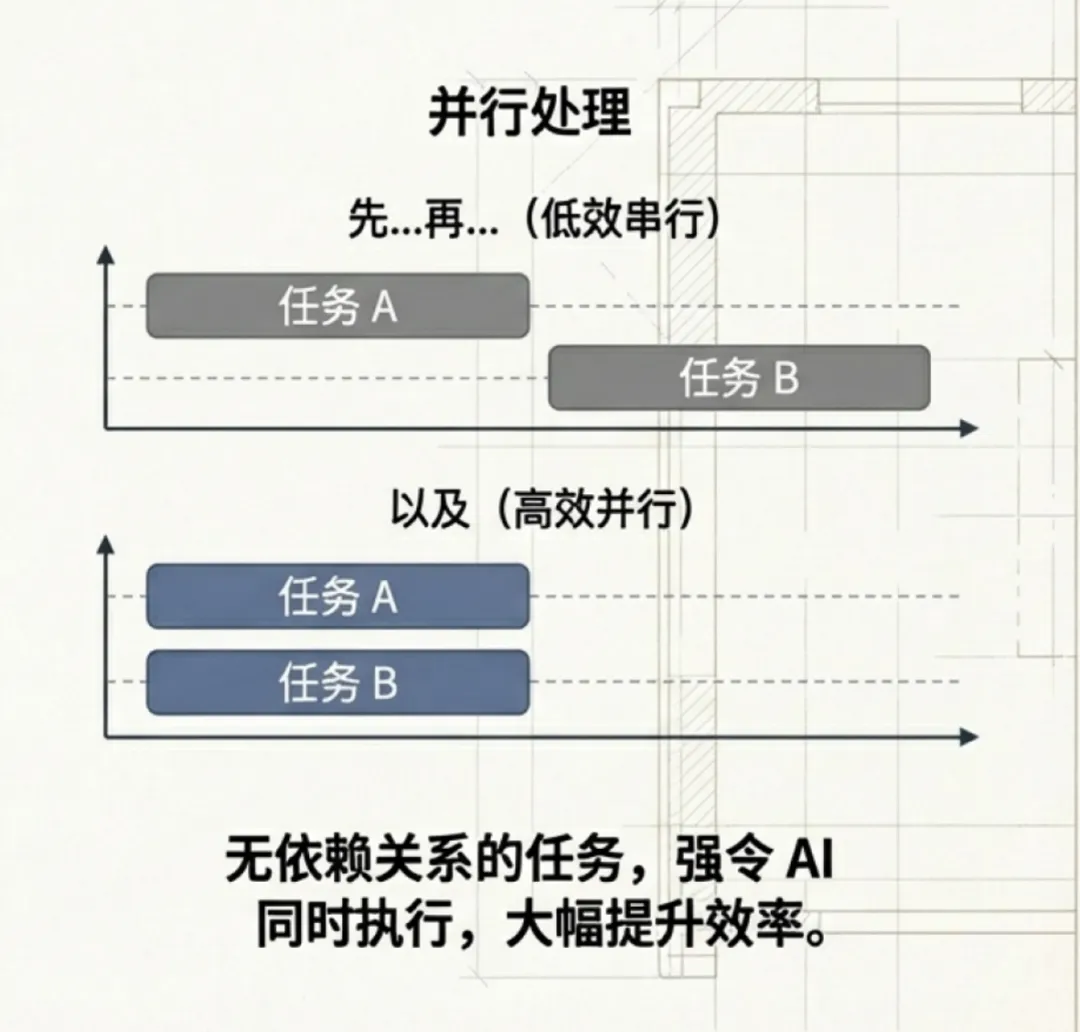

源码里明确写了,Claude Code被要求在任务之间没有依赖关系的时候并行执行。

但如果我们给任务的方式是一步一步的,AI就会老老实实按顺序来。

比如”先帮我总结这篇文章,再帮我翻译成英文”,这两件事其实可以同时做。

改成”帮我总结这篇文章,以及翻译成英文”,AI就会并行处理,效率高不少。

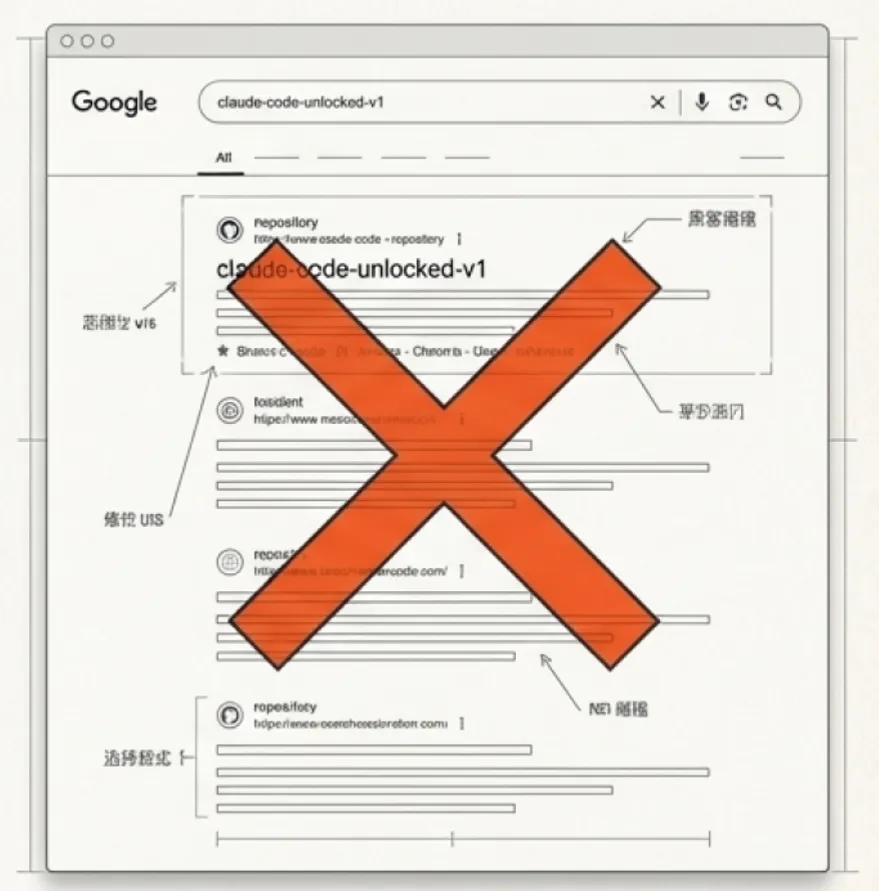

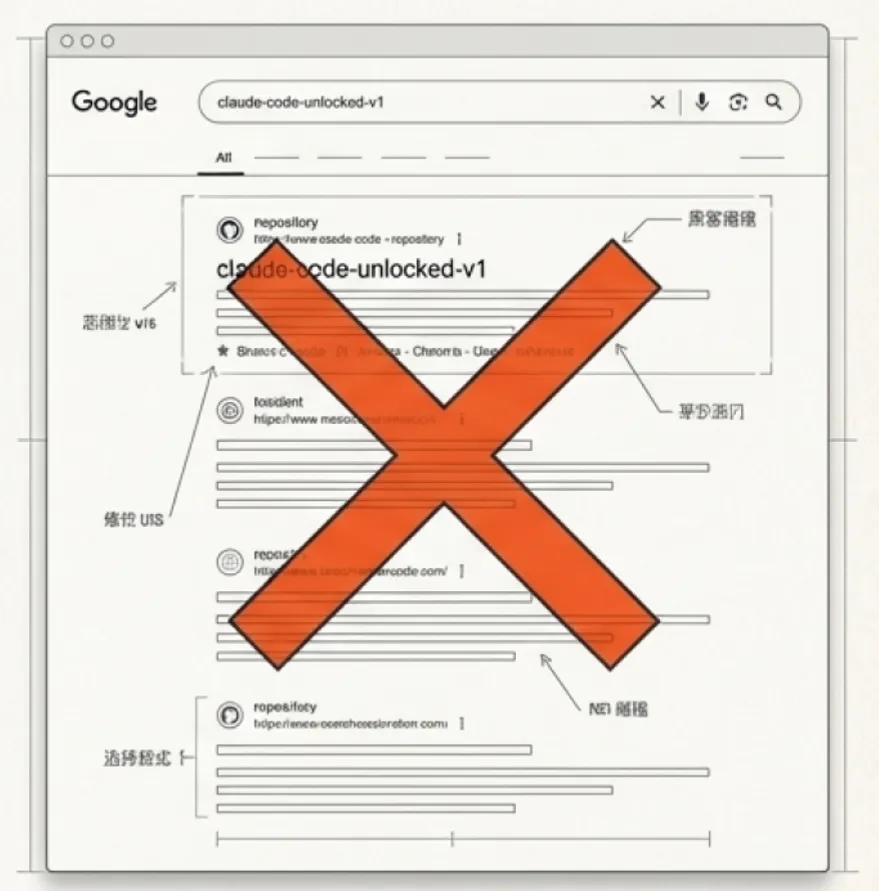

我看到源代码泄露以后,今天已经出现了黑客利用这个事情钓鱼的新闻了。

有人在GitHub上传了假的解锁版Claude Code,搜Claude Code泄露的时候,Google前几个结果就有钓鱼链接,下载了就会中木马。

建议大家千万别碰什么破解版、解锁版的Claude Code。

另外安全公司从泄露的代码里找到了一个权限漏洞,Anthropic内部其实已经写好了修复代码,但还没有更新到用户用的版本里。

在用Claude Code的话,建议换成官方安装器重新装一下,比较稳妥