AI工具深度对比:Trae vs WorkBuddy,谁更适合你的工作场景?

同一任务实测 | 课程教学材料生成 | 50 分钟 vs 30 分钟的效率差距

引言:AI 工具这么多,到底该选哪一个?

最近 AI 工具特别火,打开手机应用商店,各类 AI 助手琳琅满目。但很多人都有同一个困惑:听起来都很厉害,到底哪个更适合我?

今天,我就用一个真实的测试案例,给大家展示两款主流 AI 工具的实际表现。无论你是老师、培训师,还是普通职场人,这份对比都能帮你找到最适合的选择。

一、测试背景:同一个任务,谁做得更好?

这次测试的场景是:生成一套完整的 5G 网络课程教学材料。

我给两个 AI 工具输入了完全相同的素材——课本截图、实训平台资源、课程主题,让它们各自生成教案、讲稿和 HTML 讲义。

|

|

|

|

|---|---|---|

| 底层模型 |

|

|

| 产品定位 |

|

|

| 交互方式 |

|

|

重要说明:这两个 AI 工具的背后,都运行着同一套工作流系统——teaching-workflow-5G(5G 课程教学设计完整工作流)。这个工作流包含三个生成技能:教案生成(lesson-plan)、讲稿生成(lecture-script)和 HTML 讲义生成(lecture-html),串联从教案到讲稿再到 HTML 讲义的全流程。

这意味着:两边的底层技能是一样的,测试的是工具对工作流的执行效率,而非技能本身的差异。

||模型一样,提示词任务一样,skills技能也一样,那实际输出会有什么不同呢?

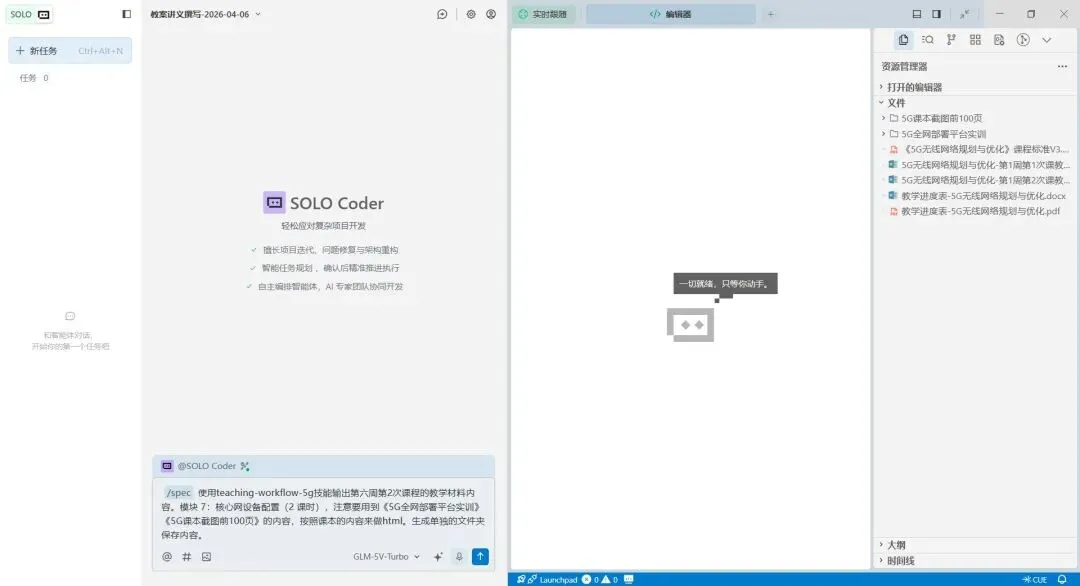

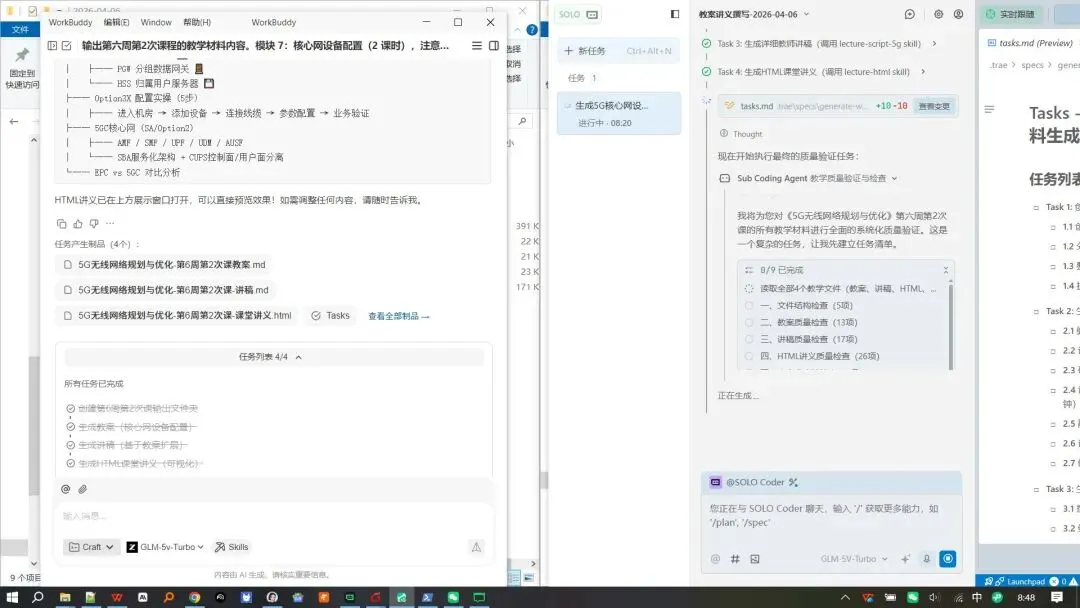

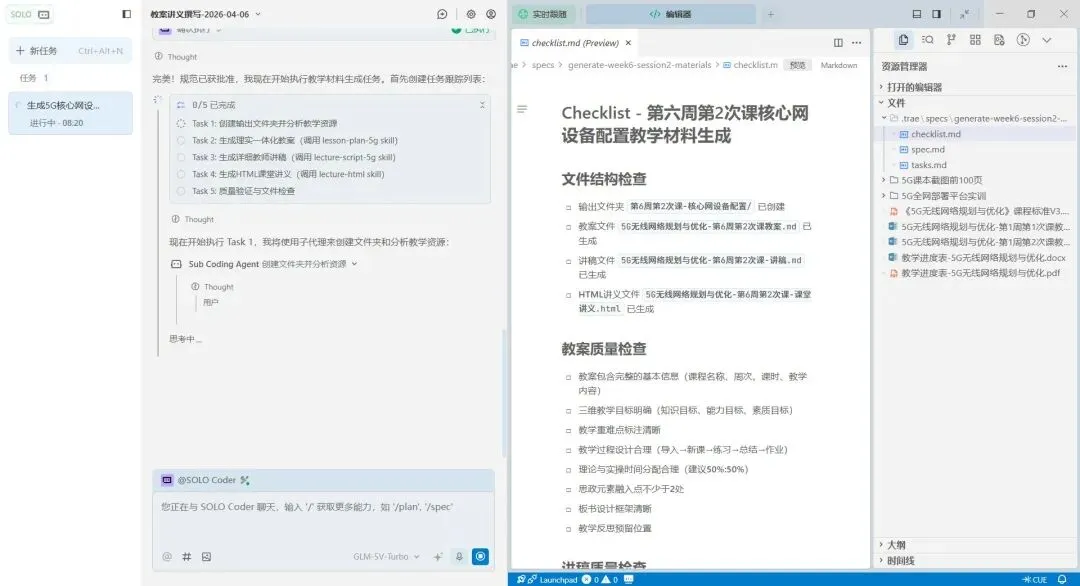

下图展示了两款工具的真实操作界面,上图为 Trae(SOLO Coder)的任务列表界面,下图为 WorkBuddy 的对话式界面:

二、输出结果大比拼:数量与质量的差距

2.1 文件数量:Trae 多产出 2 个文件

|

|

|

|

|---|---|---|

|

|

|

|

|

|

|

|

|

|

|

|

| 质量验证报告 |

|

|

| 资源分析报告 |

|

|

| 总计 | 5 个 | 3 个 |

关键发现:Trae 额外输出了“质量验证报告”和“资源分析报告”,这意味着它自带质检功能,会自己检查输出是否符合规范。

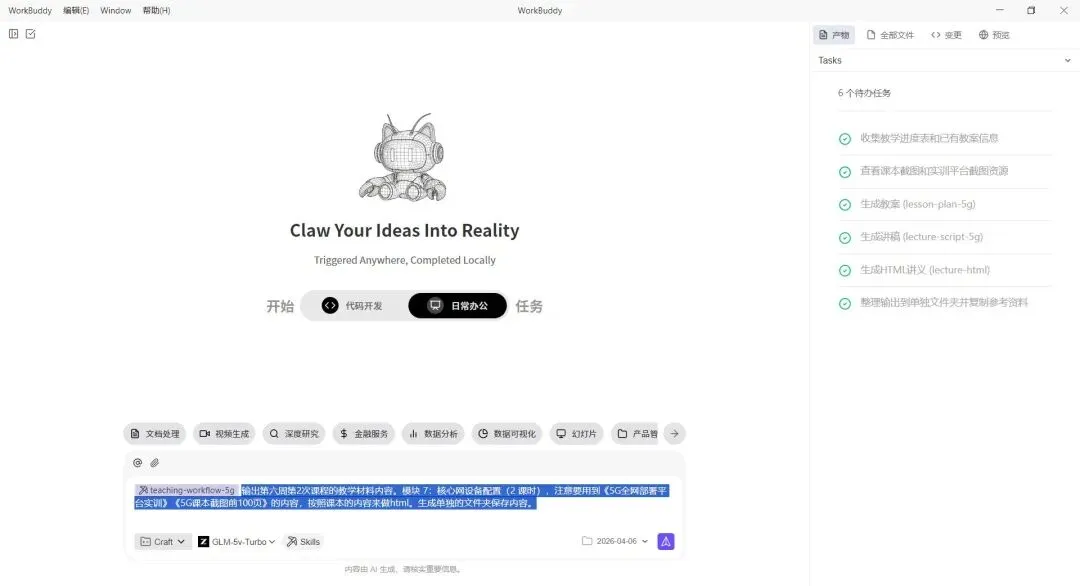

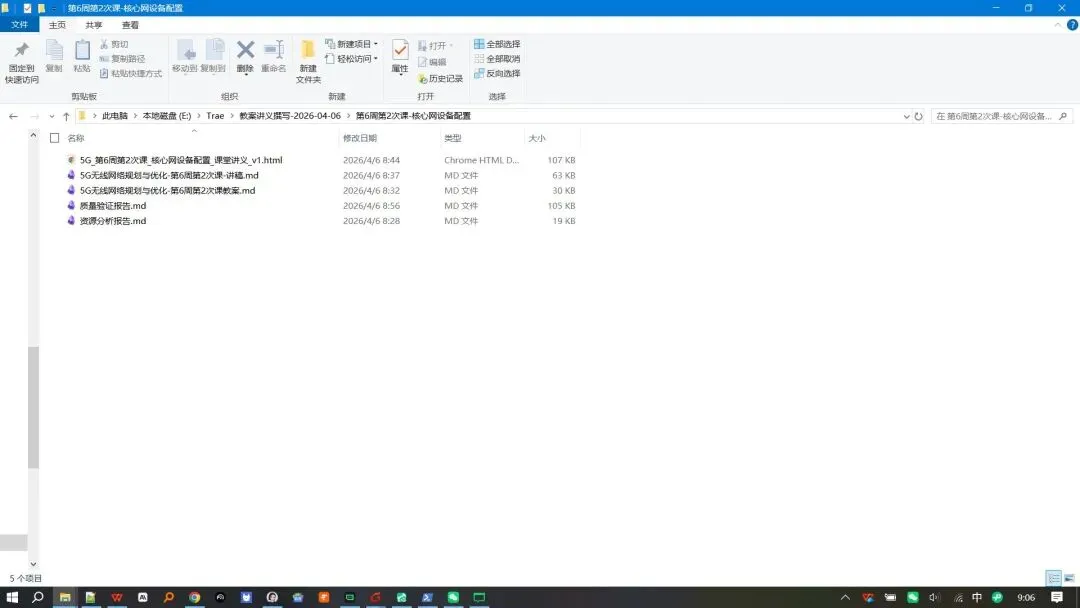

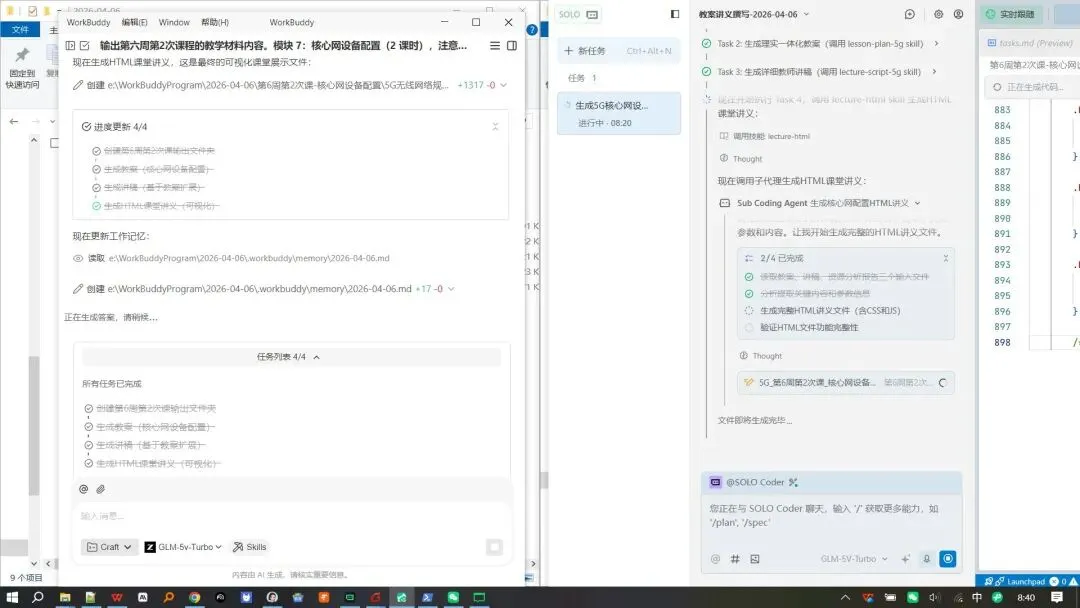

下图展示了 Trae 生成的质量检查清单和最终输出的文件(下图可以看到我在运行中使用的四个 skill 技能,后续我将讲一下如何做合适自己的 skills):

2.2 内容深度:讲稿差距最惊人

最让我震惊的是讲稿的差异:

|

|

|

|

|---|---|---|

|

|

1332 行 |

|

|

|

|

|

|

|

10 种突发场景预案 |

|

|

|

|

|

换算一下:Trae 的讲稿是 WorkBuddy 的 3.6 倍 详细内容。

这意味着什么?Trae 的讲稿可以直接拿来上课,而 WorkBuddy 的还需要人工大幅补充。

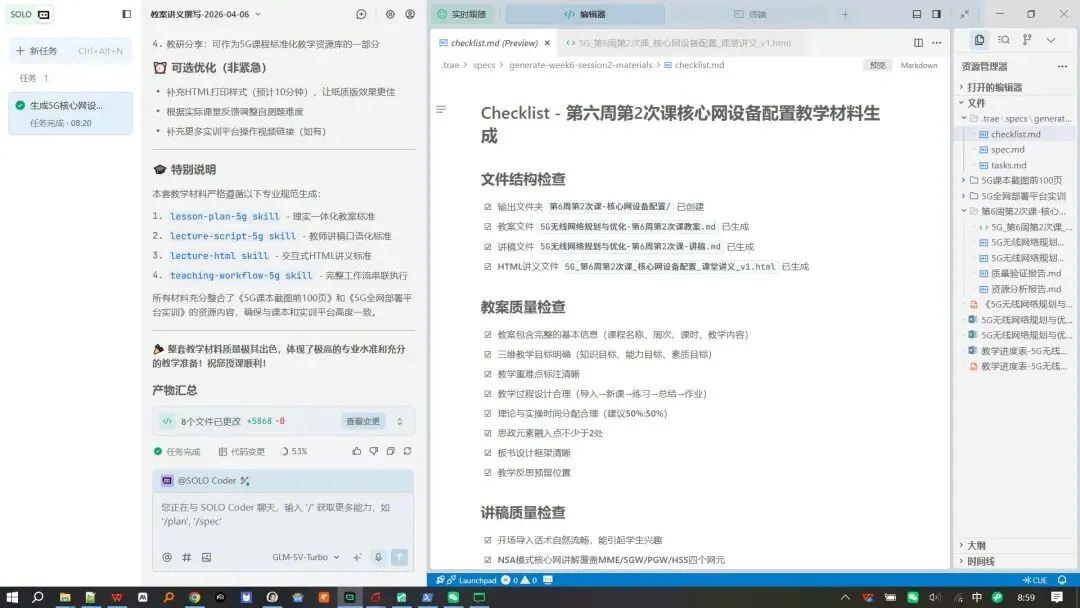

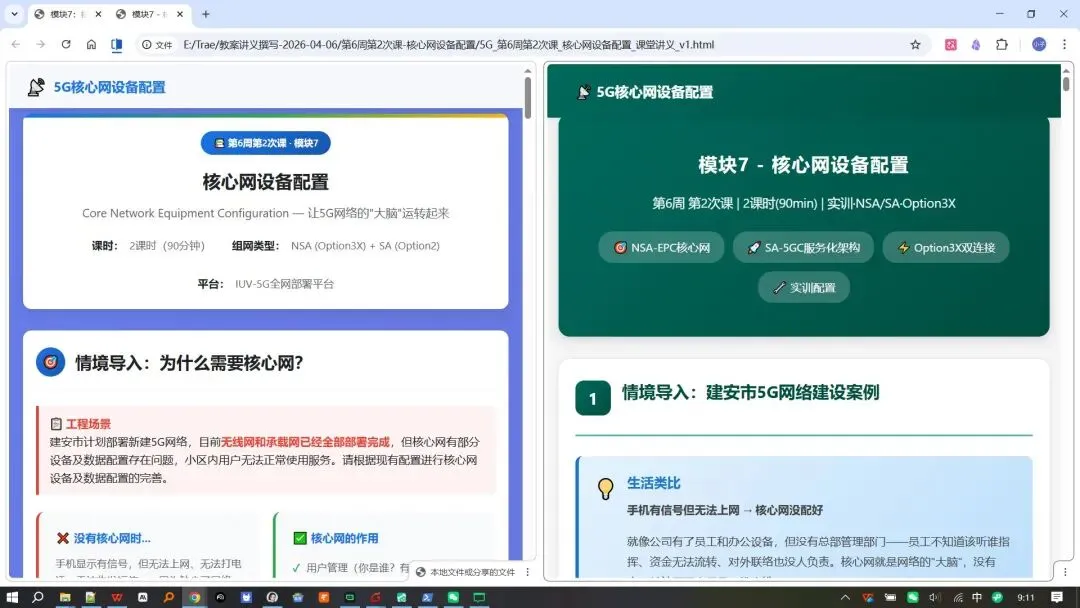

下图展示了 Trae 生成的 HTML 课堂讲义输出界面,可以看到任务全部完成,包括创建资源存储器、生成教案 Markdown、生成讲稿 Markdown、生成 HTML 课堂讲义:

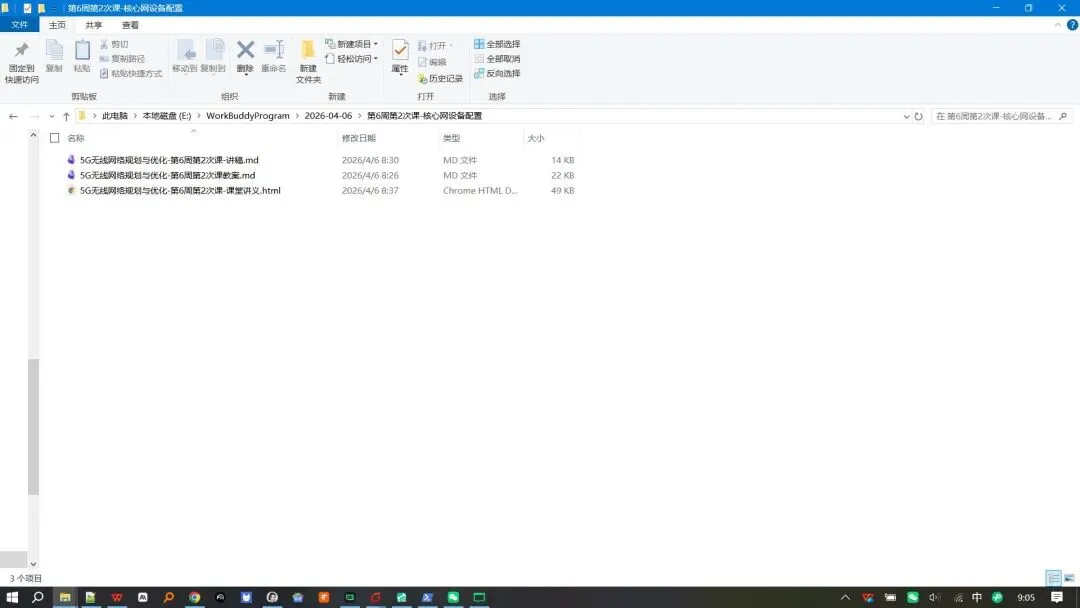

下图展示了 WorkBuddy 生成的文件结果,可以清晰看到只有 3 个基础文件(教案、讲稿、HTML 讲义),没有质量验证报告:

下图展示了最终生成的 HTML 课堂讲义成果——5G 核心网设备配置课程页面,让读者直观感受 Trae 生成的终稿级教学材料效果。页面包含了课程目标、教学内容、实践指导等完整模块:

三、速度与效率:50 分钟 vs 30 分钟

|

|

|

|

|---|---|---|

|

|

|

约 30 分钟 |

|

|

|

|

|

|

|

|

下图展示了 WorkBuddy 的任务执行过程,所有任务已完成,右上角显示任务进度:

结论:WorkBuddy 比 Trae 快 40%,且全程不需要人工干预;但 Trae 的输出质量更高——自带质检功能,产出的是终稿级别,而 WorkBuddy 还需要人工润色。

四、核心差异:它们适合谁?

4.1 选 Trae 的场景 ✅

-

想要一次性生成完整材料,开箱即用

-

追求输出质量,需要终稿级别内容

-

需要质量保证,不想自己检查细节

-

是新教师或兼职教师,需要详细的讲稿参考

Trae 的定位:教学材料的“智能工厂”,输出的是终稿级别,可以直接使用。

4.2 选 WorkBuddy 的场景 ✅

-

需要反复沟通迭代的内容创作

-

喜欢对话式交互,随时调整方向

-

已有初稿,需要针对性修改和优化

-

企业场景,需要与飞书/微信等工具协同

WorkBuddy 的定位:知识工作的“AI 伙伴”,输出的是初稿级别,需要人工润色。

五、一句话总结

想要省心省力直接用,选 Trae;想要灵活迭代慢慢磨,选 WorkBuddy。

下图展示了实际使用中 Trae 的任务规划界面,任务清晰列表化,便于跟踪和管理:

如果一定要我推荐一个组合策略:

第一步:用Trae生成完整初稿(节省80%时间)

第二步:用WorkBuddy进行针对性优化

第三步:根据实际反馈迭代

结尾

这次测试让我最大的感悟是:工具的设计理念,比底层模型更能决定最终效果。

同一个模型,放在不同的工作流程里,产出的质量可以差好几倍。

所以,别纠结模型参数了,找到适合自己工作场景的工具,才是真正的效率提升。

文章字数:约 2200 字 | 阅读时间:约 5 分钟

如果觉得有用,点个赞 👍 收藏 ⭐ 转发给需要的朋友

本文基于真实测试数据撰写,测试任务为课程教学材料生成。

夜雨聆风

夜雨聆风