1小时从零到成品:我用AI写了个桌面工具,踩了3个坑(Trae SOLO WEB 实战记录)

1小时从零到成品:我用AI写了个桌面工具,踩了3个坑

Trae SOLO WEB 实战记录──────────────────────────────

|

“从需求到成品,花了大约1小时。这是我的真实开发记录。” |

开发一个功能完整的桌面应用,正常情况下我会预估要几个小时到几天。

需求分析、架构设计、写代码、调试、修Bug……每个环节都要花时间。但这次试了一下AI编程,整个过程跟以前不太一样了。

下面我把整个开发过程完整记录下来,包括踩过的坑和实际花的时间,希望对想试AI编程的朋友有参考价值。

声明:本次体验缘起于无意中抽到了 Trae(https://www.trae.cn/)SOLO WEB 模式的邀请码,登录后进行的真实体验。下文所有内容均为实际操作记录,绝非广告或美化。

──────────────────────────────

什么是SOLO WEB模式?

本次体验用的是 Trae 平台的 SOLO Web 模式,官网登录界面如下:

▲ 图:Trae平台官网(trae.cn)—— “The Real AI Engineer”

SOLO WEB模式是国产AI编程平台 Trae 提供的一种编程方式。用户用自然语言描述需求,AI来分析并生成代码。说白了,你告诉它你想要什么,它来写代码。

几个特点:

•门槛不高:不需要深厚的编程知识,用自然语言描述需求就行

•速度快:从需求到能用的东西,大约1小时左右,传统方式可能要4-8小时

•可以反复调整:发现不对的地方就说,每次修改几分钟就能搞定

•前后端、桌面应用都能做:

不过说在前头:

本次开发的文件搜索工具,属于“个人小工具”类型——逻辑简单、边界清晰、功能独立。这恰恰是AI编程目前最吃得开的场景。大型项目、复杂架构、高安全要求的场景,AI目前还有很大局限(详见文术附录)。所以本文展示的是AI在它最擅长场景下的表现,不是什么“无所不能”的宣传。

──────────────────────────────

实战案例:约1小时开发文件搜索工具

先看时间分布:

|

阶段 |

合理时间 |

主要活动 |

|

需求分析与文档生成 |

10-15分钟 |

分析需求、生成产品文档、技术架构文档、方案确认 |

|

初始代码实现 |

20-25分钟 |

创建项目结构、实现主应用GUI、开发搜索引擎核心逻辑 |

|

测试与反馈迭代 |

25-30分钟 |

处理用户反馈、修复子目录搜索、调整输出格式、打包下载 |

|

最终优化与打包 |

5分钟 |

优化提示词、创建使用说明、打包最终文件 |

|

合计 |

60-75分钟 |

从需求到成品的完整开发过程 |

|

这个时间分布真实吗?合理。需求分析包含了一次方案拒绝与重新设计;初始代码需完成GUI和搜索引擎两大模块;测试反馈包含3次迭代修复和打包下载。 |

补充说明:

上述时间是在非高峰期、网络稳定的条件下记录的。实际使用中,你可能会遇到以下情况:

•排队等待:高峰期使AI平台可能需要排队,我体验中有时要等几分钟,网上也有用户反映排队10-30分钟的情况

•响应变慢:复杂任务的生成时间会比简单任务长很多,有时一个请求要等几分钟才有结果

•网络中断:长时间任务执行过程中网络断开,可能导致代码写到一半报错,需要重新来过

所以如果运气不好,总时间可能会拉长到1.5-2小时甚至更久。建议尽量选择非高峰期使用,体验会好很多。

第1-10分钟:需求分析与文档生成

我向AI提交了以下需求:

|

用户原始提示词: 文件搜索字符串工具 功能需求: • 文件搜索功能:支持文件和子目录通配符模式匹配(如 *.txt, **/*.log) • 内容搜索功能:在文件内容中搜索指定文本 • 正则表达式支持:可选使用正则表达式进行高级搜索 • 原始文件支持编码选择:UTF-8, GBK • 支持编码转换:输出文件编码选择,原始编码不同时自动转换 • GUI界面:提供直观的图形用户界面 • 进度显示:实时显示搜索进度和当前处理的文件 程序要求:提供可执行程序下载给我 |

AI助手:分析完需求后,自动生成了产品需求文档和技术架构文档。

不过这里有个小插曲:

第一版方案,AI选的技术栈我不认可。

我:拒绝了第一版方案,要求“用Python实现”。

AI助手:重新分析,给了基于Python + PyQt6的新方案。确认后才开始写代码。

这个细节我觉得挺重要的——方案不对就拒绝,不要将就。用户拥有最终决策权,AI负责执行。

第11-30分钟:初始代码实现

AI助手并行完成了以下工作:

•创建项目结构,实现主应用GUI界面,包括搜索配置区、进度显示区和结果展示区

•实现搜索引擎核心逻辑,支持文件通配符匹配、内容搜索、正则表达式和编码转换

•写了打包脚本,准备生成可直接运行的文件

20分钟左右,一个完整的GUI应用就跑起来了。

第31-55分钟:测试与反馈迭代

这个阶段是最耗时的,也是最能说明问题的。以下是测试中实际发现的问题:

|

序号 |

发现的问题 |

处理结果 |

|

① |

第一版程序没有输出文件名输入框 |

提示后立即添加,默认值为search_results.txt |

|

② |

输出文件包含文件名等额外信息,不是纯文本行 |

要求只保存找到的文本行,不包含额外信息,快速修改了输出格式 |

|

③ |

没有支持子目录递归搜索 |

提示后修改了搜索逻辑,支持多层级子目录递归 |

说实话:每个Bug反馈后,AI都在几分钟内修好了。放在传统开发里,“理解问题→定位原因→修改代码→验证”这个循环,每个问题少说30分钟。这次用AI,25分钟内搞定了3个问题。

第56-60分钟:最终优化与打包

最后5分钟,AI助手写了使用说明文档,优化了提示词。

我:“单独文件下载不方便,把全部文件打包给我,我下载本地运行”。

AI助手:把所有项目文件打包成 FileSearchTool.zip,并给了本地运行指南。

|

压缩包内容 |

说明 |

|

main.py |

主应用入口 |

|

search_engine.py |

搜索引擎核心逻辑 |

|

requirements.txt |

依赖列表(PyQt6、chardet) |

本地运行三步:

•解压压缩包→ pip install -r requirements.txt→ python main.py

下载后测试通过,功能符合需求。

──────────────────────────────

技术实现亮点

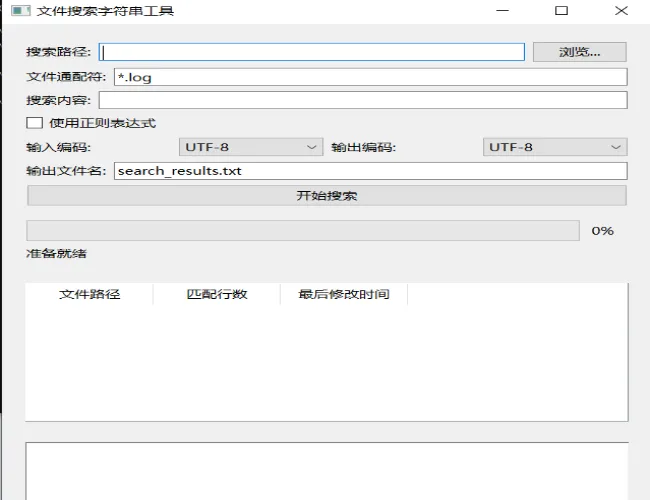

1. 直观的GUI界面

用PyQt6做的图形界面,功能还比较完整:

•搜索路径选择、文件通配符输入(默认:*.log)、搜索内容输入

•正则表达式开关、编码选择、输出文件名输入

•实时进度显示、搜索结果展示

Windows上运行“python main.py”的实际效果:

▲ 图:“文件搜索字符串工具”运行界面(Windows系统,python main.py)

2. 搜索引擎

•文件和子目录通配符匹配:支持多层级目录递归搜索

•内容搜索和正则表达式:简单文本和复杂正则都支持

•多编码支持和支持转换:支持多种编码和编码转换

•实时进度反馈和结果保存:搜索过程中实时更新进度条,一键导出结果

3. 错误处理

••单个文件读取异常不会导致程序崩溃

•界面反馈比较清晰,哪里出了问题能看到

──────────────────────────────

实战经验总结

走完整个流程下来,有几点体会比较深:

1. AI能快速“从0到1”,但不一定一步到位

AI在短时间内生成了完整的项目结构、GUI界面和搜索引擎,这种“并行生成”能力确实令人印象深刻。但第一版代码还是有三个明显的Bug——能快速给出一个可用的版本,但细节还是要人来把关。

2. 反馈质量直接决定迭代效率

每个Bug从发现到修复只需几分钟,但前提是你能把问题说清楚。比如“输出文件包含文件名等额外信息,要求只保存找到的文本行”——这样的反馈,AI能立刻理解并修复。反过来,如果只说“输出不对”,可能还得多沟通几轮。

3. 方案确认很重要,别急着写代码

我拒绝了第一版技术方案,要求重新用Python实现。看似浪费了时间,实际上避免了后面更大的迭代成本。早点确认方案,比什么都重要。

4. 分阶段开发比一次性提需求稳当

如果一开始就把所有功能都告诉AI,第一版的问题可能会更多。先实现核心功能、测试通过后再加辅助功能,更稳妥。

再强调一下:上述经验都是基于“个人小工具”这个场景。复杂项目中AI编程的表现可能完全不一样,详见文术附录。

──────────────────────────────

与传统开发的对比

对比基于本次实际场景(个人小工具):

|

开发方式 |

时间投入 |

所需技能 |

迭代速度 |

开发成本 |

|

传统开发 |

4-8小时 |

专业编程知识 |

慢 |

高 |

|

AI辅助开发 |

1-1.25小时 |

自然语言+基础技术理解 |

快 |

低 |

|

在“个人小工具”这个AI最吃得开的场景下,效率提升约80%。但这个对比不能简单平移到所有场景——场景越复杂,AI的优势越小。 |

──────────────────────────────

小结

|

目前可以快速生成代码,但需要人工多次指导或一次写好要求。不排除仍有漏点,但这个大方向挡不住。 |

说实话,这次开发并不是一帆风顺。AI生成的第一版代码就有3个Bug。但有几个点让我印象深刻:

•修复很快:每个问题从发现到修好,只需几分钟

•不需要深入编程:只要能说清楚问题在哪,AI就能理解并修复

•整体效率还是很高的:即使加上迭代修复时间,总体还是远超传统开发

AI辅助开发不是什么“一键生成”,它需要人来参与、把关、反复调整。

补充一点:本次的60-75分钟,是基于有一定编程基础的用户。有编程经验的人可能更快,完全没有编程背景的人第一次用可能会花更多时间——毕竟“告诉AI问题在哪”本身也需要一定的技术理解力。随着AI工具进化,这个门槛会越来越低,但目前还不是零。

如果你能把需求说清楚,也愿意花时间测试和反馈,AI编程确实能帮你省不少时间。

──────────────────────────────

写在最后

电脑普及后,不是人人都能做好Excel,但确实让更多人能用上电子表格。AI编程也类似——它降低了门槛,但不是零门槛,当前AI编程让每个人能以较低成本定制小工具、工作流脚本。

AI目前擅长的是把明确的、边界清晰的需求快速变成代码。至于系统怎么设计、架构怎么搭、长期怎么维护,这些还是得靠人。

所以用AI编程,最关键的能力其实是两件事:一是能把自己的需求说清楚,二是有足够的判断力来审核AI给出的东西——方案对不对、代码有没有坑、适不适合你的实际情况。

我觉得比较适合用AI编程的场景:

•写个人小工具:像这次的文件搜索、数据处理脚本之类的

•验证一个想法:快速做个原型看看行不行得通

•学编程:看看AI生成的代码,学习一些编程思路

我觉得还需要谨慎的场景:

•大型项目:AI很难理解全局,模块集成后问题会很多

•高安全要求的系统:代码缺乏形式化验证,边界情况不一定能覆盖到

•需求自己都说不清的时候:你都不知道要什么,AI更不知道

更详细的场景分析可以看文术附录。

──────────────────────────────

感兴趣的话,可以从一个小工具开始试试

亲自体验一下,比看什么文章都有用。

AI编程已经可用,但别拿它当万能药。

──────────────────────────────

附录:AI编程实际应用场景分析

我找多个AI交叉验证梳理的AI编程目前的适用场景请参考。

目前做得不错的场景

•个人工具/脚本:文件处理、数据转换之类,逻辑简单、边界清晰。本次的文件搜索工具就是一个典型案例。这个场景几乎没有争议。

•代码补全/模板生成:日常写代码时的补全、标准CRUD接口、API接口生成等,这块目前最成熟。有测试显示API接口生成完整度可达88%-95%。

•单元测试生成:AI生成单元测试的质量还行,覆盖率可达70%-82%。但集成测试和关键业务场景测试还是需要人工补充。

•原型验证:快速验证一个想法是否可行,不要求代码完美。多个工具都能一次性生成多文件项目并编译运行。

•代码解释/学习:看不懂的代码承AI解释,看报错信息找AI帮忙分析。对初学者很有用。

•文档生成:函数注释、API文档、README之类的,生成质量还行。

目前还不行的场景

•大型项目/复杂架构:AI很难理解全局,模块间的依赖关系、数据流设计这些还是需要人来想。有行业分析认为,完全靠AI独立完成中等以上复杂度的真实项目,成功率接近0。

•需求模糊的场景:用户自己都说不清要什么,AI更没办法。本次的三个Bug就能说明一些问题。有研究指出,“AI编程的最后一公里”往往是需求的模糊性,而不是代码生成本身。

•高安全/高可靠系统:金融、医疗这些场景,AI生成的代码缺乏形式化验证,安全漏洞不一定能全面覆盖。OpenAI自己的报告也指出,AI生成代码中约12%存在安全漏洞。

•复杂UI/交互设计:设计感、用户体验这些“隐性需求”,AI很难准确把握。

•性能敏感型应用:高并发、实时系统,AI倾向于生成“能跑”的代码,不一定是“跑得好”的代码。

•长期维护的项目:AI生成的代码往往“一次性”特征明显,扩展性差。有数据显示,AI生成代码两周内被丢弃的比例翻倍,重复代码块频率增长了8倍,技术债务累积问题值得注意。

汇总一下:

|

场景类型 |

AI适用度 |

关键瓶颈 |

|

个人小工具 |

★★★★★ |

几乎无 |

|

代码补全/模板 |

★★★★★ |

几乎无 |

|

单元测试生成 |

★★★★☆ |

覆盖率达70-82%,但集成测试需人工补充 |

|

原型验证 |

★★★★ |

需求理解偏差 |

|

代码学习/解释 |

★★★★ |

复杂逻辑解释不够深入 |

|

中型项目开发 |

★★★ |

架构设计、模块集成 |

|

复杂UI设计 |

★★ |

审美、交互细节 |

|

大型系统架构 |

★★ |

全局视野、长期演进,独立完成成功率接近0 |

|

高安全/高可靠 |

★ |

边界验证、形式化证明,约12%代码存在安全漏洞 |

|

长期维护项目 |

★★ |

扩展性差、技术债务累积、代码丢弃率高 |

|

AI编程现在最吃得开的是“从0到1”,最不擅长的是“从1到100”。用好它的优势,也别对它抱不切实际的期望。 |

──────────────────────────────

教学相长

公众号:笃行AI实验室 | 用实践检验每一款AI工具

分享 · 交流 · 进步

夜雨聆风

夜雨聆风