程序员救命神器!这个开源AI工具每天自动帮你筛出值得读的科技新闻

每天早上打开浏览器,你是不是也这样:Hacker News、Reddit、Telegram、各种RSS订阅…

标签页开得满满当当,结果刷了半小时还没找到一篇真正值得细读的文章?信息时代最讽刺的事情就是——信息太多了,反而让人更焦虑。

前段时间我发现了一个叫 Horizon 的开源项目,用了一段时间后,真的有种”终于有人懂我”的感觉。

这玩意儿就像给你的信息源雇了一个24小时不休息的AI编辑,自动帮你抓新闻、打分、写摘要,最后生成一份干干净净的双语日报。

它到底能干嘛?

简单来说,Horizon 是一个全自动的AI科技新闻聚合器。它干的事情很纯粹:

📡 多源聚合 —— 同时监控 Hacker News、RSS、Reddit、Telegram 频道还有 GitHub 的 Release 动态。你不用到处翻了,它一次性帮你抓全。

🤖 AI智能打分 —— 这是我最爱的功能。它支持 Claude、GPT-4、Gemini、DeepSeek、豆包这些主流模型,给每条新闻打 0-10 分。低于6分的直接过滤掉,再也不用被水贴打扰。而且打分逻辑还挺靠谱,会考虑技术深度、新颖性和影响力。

🌐 中英双语 —— 生成的报告同时有英文和中文版本,想看原文或者快速浏览中文摘要都行。对于英文不太好的朋友,这简直是救命稻草。

🔍 自动补背景 —— 遇到不懂的概念?它会自动去搜背景知识,比如看到 “KV Cache优化” 这种专业术语,直接给你解释清楚,不用再去维基百科跳来跳去。

💬 汇总社区声音 —— 不只给你新闻,还把 HackerNews、Reddit 上的高赞评论也抓过来,让你一眼看到”大伙儿怎么看”。

手把手教你跑起来

安装其实挺简单的,有两种方式,我推荐用 uv 安装,速度快很多。

第一步:克隆仓库

git clone https://github.com/Thysrael/Horizon.git

cd horizon

第二步:安装依赖

如果你装了 uv(没装的话 pip install uv 先整一个):

uv sync

或者用传统 pip:

pip install -e .

Docker党看这里:其实更省事的办法是直接跑 Docker,后面会说。

第三步:配置环境

这一步是关键。Horizon 用一个 JSON 文件管所有配置,灵活得一批。

先复制示例文件:

cp .env.example .env

cp data/config.example.json data/config.json

然后编辑 .env 文件,填入你的 API Key。比如你用 DeepSeek:

DEEPSEEK_API_KEY=sk-xxxxxxxxxxxx

或者用豆包、OpenAI 的都行,Horizon 基本都支持。

第四步:改配置文件

打开 data/config.json,这里可以自定义信息源。举个例子:

{

"ai": {

"provider": "deepseek",

"model": "deepseek-chat",

"api_key_env": "DEEPSEEK_API_KEY",

"languages": ["zh", "en"]

},

"sources": {

"hackernews": {

"enabled": true,

"fetch_top_stories": 20,

"min_score": 100

},

"reddit": {

"subreddits": [

{ "subreddit": "MachineLearning", "sort": "hot" },

{ "subreddit": "LocalLLaMA", "sort": "new" }

],

"fetch_comments": 5

},

"rss": [

{ "name": "Simon Willison", "url": "https://simonwillison.net/atom/everything/" }

],

"telegram": {

"channels": [

{ "channel": "zaihuapd", "fetch_limit": 20 }

]

}

},

"filtering": {

"ai_score_threshold": 6.0,

"time_window_hours": 24

}

}

看到没,你想关注哪个 Subreddit、哪个 RSS 源、哪个 Telegram 频道,往里面加就行。阈值 ai_score_threshold 默认是6分,要是你觉得筛选太严或者太松,随时调。

懒得写配置? Horizon 有个交互式向导,运行 uv run horizon --wizard(具体命令看文档),它会问你感兴趣啥领域,比如 “LLM推理”、”嵌入式”、”Web安全”,然后自动推荐信息源,对新手很友好。

第五步:开跑!

万事俱备,执行:

uv run horizon

默认是抓取最近24小时的内容。如果你想抓过去两天的:

uv run horizon --hours 48

然后看着终端里一行行输出,从各平台抓数据、AI分析打分、 enrichment 补充背景…还挺有科技感的。跑完后,生成的日报会保存在 data/summaries/ 目录里,是 Markdown 格式的,可以直接用浏览器打开看。

进阶玩法:全自动托管

手动跑虽然爽,但咱们程序员讲究自动化对吧?Horizon 早就替你想好了。

GitHub Actions 自动部署:项目里自带了 .github/workflows/daily-summary.yml,你配置好 Secrets(就是那些 API Key),它会每天定时跑,自动生成日报并部署到 GitHub Pages 上。这意味着你可以拥有一个属于自己的”每日科技简报”网站,手机电脑随时看。

邮件订阅:它还内置了邮件列表功能,用 SMTP/IMAP 就能跑。配置好后,别人可以邮件订阅你的日报,全自动处理订阅退订。要是你想做个小范围的科技 newsletter,这功能直接开箱即用。

MCP 集成:最近 MCP(Model Context Protocol)挺火的,Horizon 也内置了 MCP Server。这意味着你可以让 Claude 或者其他支持 MCP 的 AI 直接操作 Horizon,比如让它”抓取下过去48小时关于RAG的新闻并生成摘要”,玩法很多。

小吐槽与建议

用了一段时间,也发现几个小坑。

首先是 API 费用,如果你信息源配置得太多,每天抓几十上百条让 AI 打分,Token 消耗还是有点可观的。

建议把 fetch_top_stories 这些参数调低一点,或者选便宜的模型比如 DeepSeek 或者豆包来跑打分环节。

另外,Telegram 源有时候网络不好会抓失败,这个要看你本地的网络环境。

不过总的来说,Horizon 真的是解决了我的一大痛点。

以前每天刷新闻像在大海捞针,现在每天早上花5分钟看一眼 Horizon 生成的日报,重要的信息一条没落,水贴一个没见着,效率提升太明显了。

项目是完全开源的,MIT 协议,你可以随便改。

作者 Thysrael 还在持续迭代,最近刚加了 Docker 支持和 MCP 集成,活跃度挺高。

源码地址:https://github.com/Thysrael/Horizon

试试看吧,说不定它也能把你从信息过载的泥潭里救出来。

专注分享 GitHub知识,分享AI 资讯和AI搞米经验,分享AI Agent使用经验。

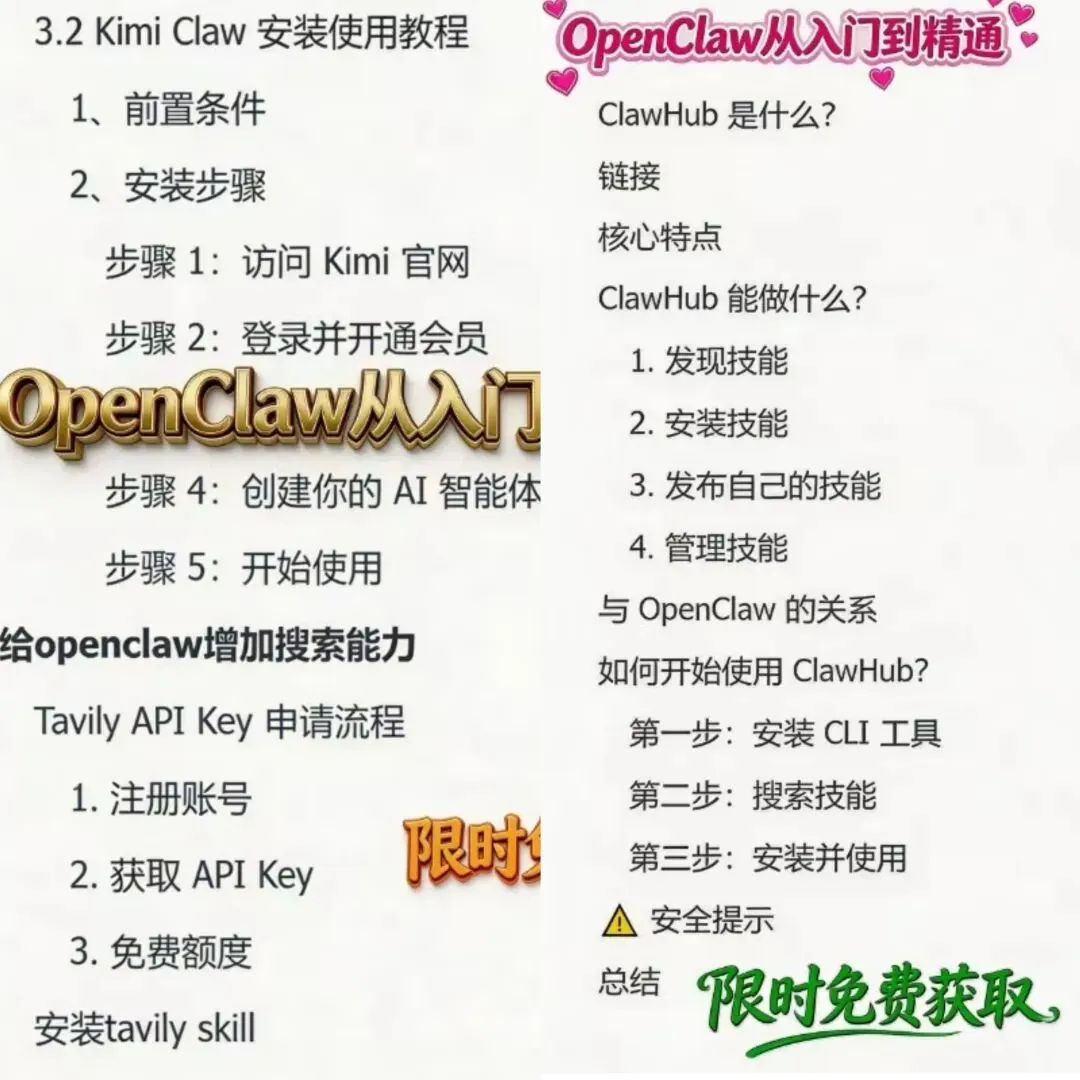

想领取完整版OpenClaw资料,围观朋友圈,一起交流AI的,可加我VX,备注“github“。

夜雨聆风

夜雨聆风