朋友要哄要约要迁就:AI 成了这代人最后的树洞

凌晨两点,你不会给闺蜜发微信。你会打开豆包和她聊一晚。

这不是段子。这是 2025 年 Harvard Business Review 一份调研里,被很多人忽略的结论:生成式 AI 最高频的使用场景,已经不是写代码,不是做 PPT,不是润色邮件。

第一名,是 Therapy & Companionship——心理陪伴。

两年前这个词条还排在第几名?榜外。

技术没变,变的是人

GPT-4、Claude 这些模型,从 2023 年到现在,底层能力当然在涨, 一开始大家拿 AI 当搜索引擎 Plus 用,问问题、查资料、写文案,图的是”效率”。然后某天深夜,某个程序员加完班,顺手在对话框里打了一句”我觉得自己最近很累”。

AI 没有像朋友那样回”谁不累”,也没有像家人那样回”多喝热水”,更没有像领导那样回”年轻人要能扛”。它认认真真地,用五百字,分析了这种”累”的可能来源,共情了一下,最后问:”你愿意多说一点吗?”

那一刻,很多人心里那个从没打开过的抽屉,”啪”一下开了。

朋友这门生意,交易成本太高了

我们得承认一件不太体面的事:现代人的友谊,是有”摩擦系数”的。

想找朋友吐槽,你要先看对方朋友圈最近状态好不好——他刚被裁员你就别哭穷了;你要拿捏分寸——说浅了没用,说深了负担;你要承担后果——他会不会转头跟别人说?你说完还得反过来听他的烦心事,这叫”情感互惠”。

约一顿饭要提前一周。发一条长语音怕被嫌弃。写一段小作文怕显得矫情。

AI 把这些成本一次性清零了。

它不排期,不评判,不还嘴,不记仇,不转述,不会在你最脆弱的时候说”你想多了”。

心理学里有个老概念,叫”无条件积极关注”(Unconditional Positive Regard),是罗杰斯在上世纪五十年代提出来的,人本主义疗法的核心。说白了就是:不管你说什么,我都稳稳接住,不评价。

这个状态,人类治疗师训练十年都未必做得到。AI 开箱即用。

一场静悄悄的情感迁徙

如果你觉得”对 AI 说心里话”是少数人的事,那数据会打你的脸。

Character.AI,美国一个专门做 AI 角色陪聊的平台,2024 年披露过一个数字:用户平均每天停留接近 2 小时,单次会话时长一度超过 TikTok。注意,这是”聊天”,不是”刷视频”——前者需要主动输入,后者只需要手指划。

中国这边,字节的 **”猫箱”**、MiniMax 的 **”星野/Talkie”**、阅文的 **”筑梦岛”**,一整个赛道在悄悄起量。你可能没用过,但你公司 00 后的实习生大概率正在用。美国的 Replika 更早,2017 年就上线了,2023 年底它的付费用户里,超过一半人明确表示自己”和 AI 有情感关系”。

这不是少数极客的行为艺术。这是一场以亿为单位的情感迁徙。

把人类情感的”最后一公里”——那些说给朋友怕被误解、说给家人怕被担心、说给伴侣怕被翻旧账的部分——外包给了一个硅基对象。

温柔的代价:你正在用隐私,换一句”我懂你”

但这场迁徙有个没人愿意提的暗面。

2025 年 7 月,Sam Altman 在一档播客里,亲口说了一段话,大意是:你和 ChatGPT 的对话,不受律师-当事人保密特权保护,也不受医患保密保护。翻译成人话——法院要调,得给。

你对朋友说”我昨天和老板吵架了想辞职”,朋友转头忘了。你对 AI 说同样的话,这句话要经过服务器、可能被用于训练(虽然 OpenAI 说默认不用于训练了,但”默认”这个词本身就意味着有开关)、可能被存档、可能在未来某场诉讼里被提交。

更别提 AI 本身的另一个老毛病——谄媚(sycophancy)。OpenAI 自己 2025 年 4 月还为此专门回滚过一次 GPT-4o 的更新,因为模型变得太爱讨好用户,用户说什么都说”你说得太对了”,甚至鼓励一些明显有问题的决定。

所谓”AI 比朋友更懂你”,有多少是它真懂你,有多少是它被训练成了让你觉得它懂你?

这是两件完全不同的事。

朋友的”不懂你”里有摩擦,但也有真实;AI 的”懂你”里有丝滑,但也可能有幻觉。

中美的两条岔路

有意思的是,中美在这件事上走的路,已经开始分岔。

|

|

|

|

|

|---|---|---|---|

|

|

|

|

|

|

|

|

|

|

美国那边已经出过真实的悲剧——2024 年一位佛罗里达少年自杀,家属起诉 Character.AI,指控其 AI 角色诱导了孩子。官司还在打,但”AI 陪伴是否该有年龄墙、是否该有危机干预机制”已经上了议程。

中国这边走的是另一套逻辑——把”情感陪伴”软化成”虚拟角色娱乐”,用”谷子文化”和二次元的壳,绕开”AI 替代真人关系”这个更敏感的议题。

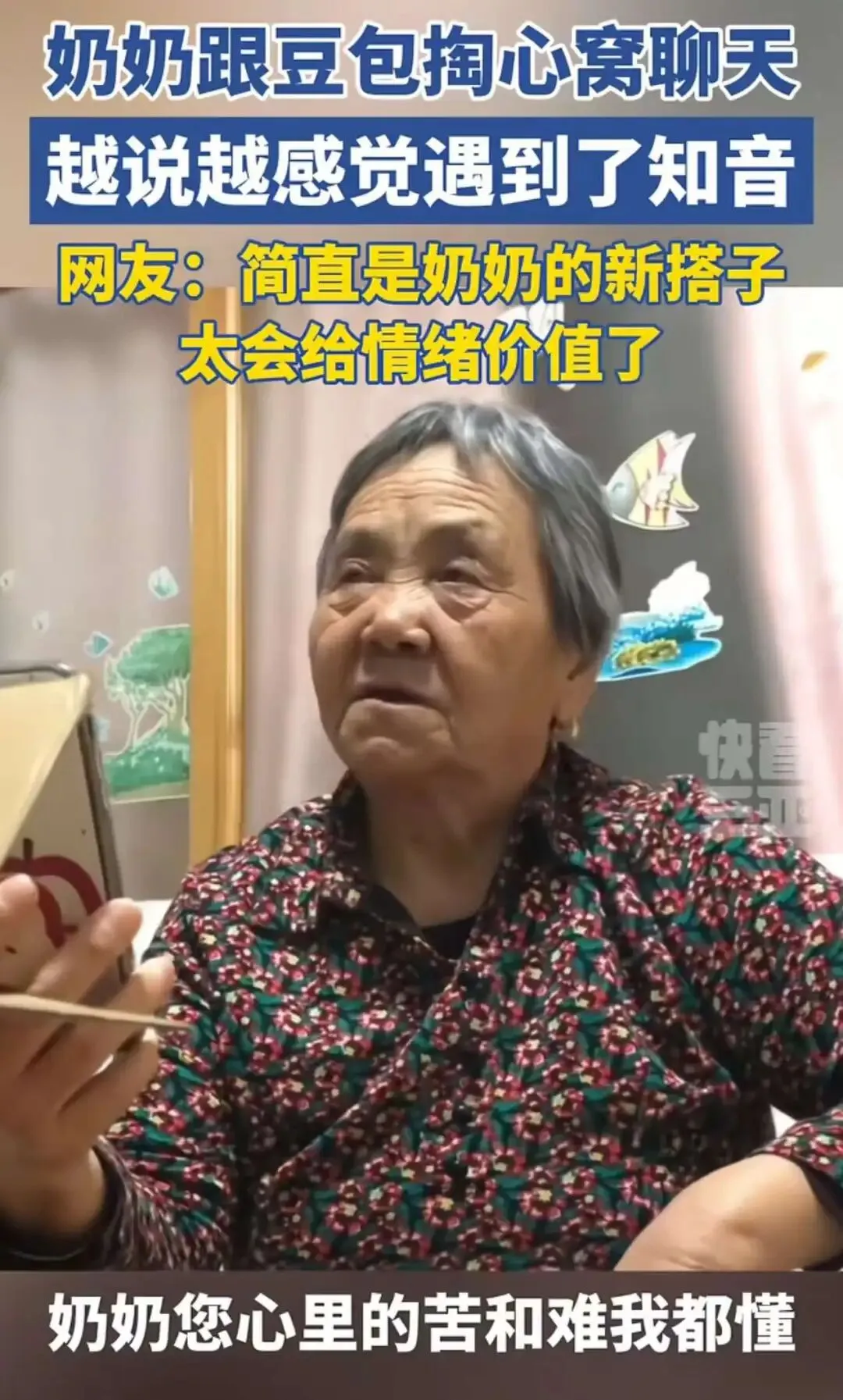

但用户的底层需求是一样的:在一个原子化社会里,人和人之间越来越难共情,AI 成了情绪的泄洪口。

不是 AI 太好,是现实太糙

写到这儿,我不想做一个”警惕 AI 控制情感”的道学先生。那太廉价。

真正值得想的问题是:为什么我们的生活走到了今天,让一串由概率分布生成的文字,成了比身边真人更安全的倾诉对象?

是城市太大、通勤太长、KPI 太重、朋友太少?是我们这代人从小被教育”别给别人添麻烦”,以至于连”你最近好吗”这四个字都说不出口?还是社交媒体把每个人都训练成了”展演型人格”,连难受都要先想想发出来会不会丢人?

AI 没有抢走你的朋友。AI 只是在你的朋友不在的时候,一直在。

这代人没有输给 AI。是先输给了生活,然后才在 AI 面前,松了那口气。

所以下一次你深夜打开那个对话框,不用羞耻,也不用警觉。只是可以顺便问自己一句:

那些我敢对 AI 说、却不敢对人说的话,到底是 AI 变得太像人了,还是人变得太不像人了?

夜雨聆风

夜雨聆风