免责声明划重点:AI回答仅供参考!幻读、豆包不准,别拿生命开盲盒

最近你有没有这样的经历:身体不舒服,第一反应不是挂号问诊,而是打开AI问一句“我这是怎么了”?或者手头有难题,直接丢给AI去解决?

方便是方便了,但你敢全信吗?

事实上,AI正在一本正经地胡说八道。今天我们就聊聊AI的“幻读”问题——那些看似靠谱实则离谱的回答,以及为什么你的健康不应该交给一个AI来开盲盒。 💊

📌 01. 连一个字都读不对,凭什么信它能“看病”?

前不久,演员刘美含在自己的微博上发布了一段视频,吐槽自己在配音工作中遇到的离奇经历。因为对“铸币坊”这个老物件术语中“坊”字的读音不确定,她一口气问了5款主流AI工具:百度、DeepSeek、元宝、豆包、千问。结果傻眼了——有的说读`fáng`(二声),有的说读`fāng`(一声)。更离谱的是,同一个豆包APP,在不同人的手机上答案都不一样。

同一个AI,同一个问题,不同设备各说各话。 最终,还是掏出手边的纸质《新华词典》APP才找到标准答案。一个多音字的读音,都能让AI们集体“翻车”,你还指望它来诊断复杂的病情吗?

📌 02. “AI幻读”——模型一本正经地瞎编

有人可能会说,多音字这种细节出错只是小毛病,但AI的问题远比这严重——一个专有名词叫“AI幻觉”。

“幻觉”是指大语言模型生成的、听起来合理流畅,但实际上错误或毫无事实依据的内容。通俗地说,就是AI在不懂装懂。

广州的张女士想去海珠湿地公园,问豆包有没有地铁站。豆包自信地告诉她:北门南门都有地铁。结果被张女士指出错误后,豆包又改口说只有北门有地铁。一个地铁站的答案都能前后颠倒,那涉及疾病诊断的内容,可信度还有多高?

社交平台上类似的吐槽比比皆是。有网友问AI“椰子内壁变紫色还能吃吗?”有的AI说不建议吃,因为氧化变质;有的AI说是正常现象,可以吃。一个问题,两个截然相反的“权威”答案。

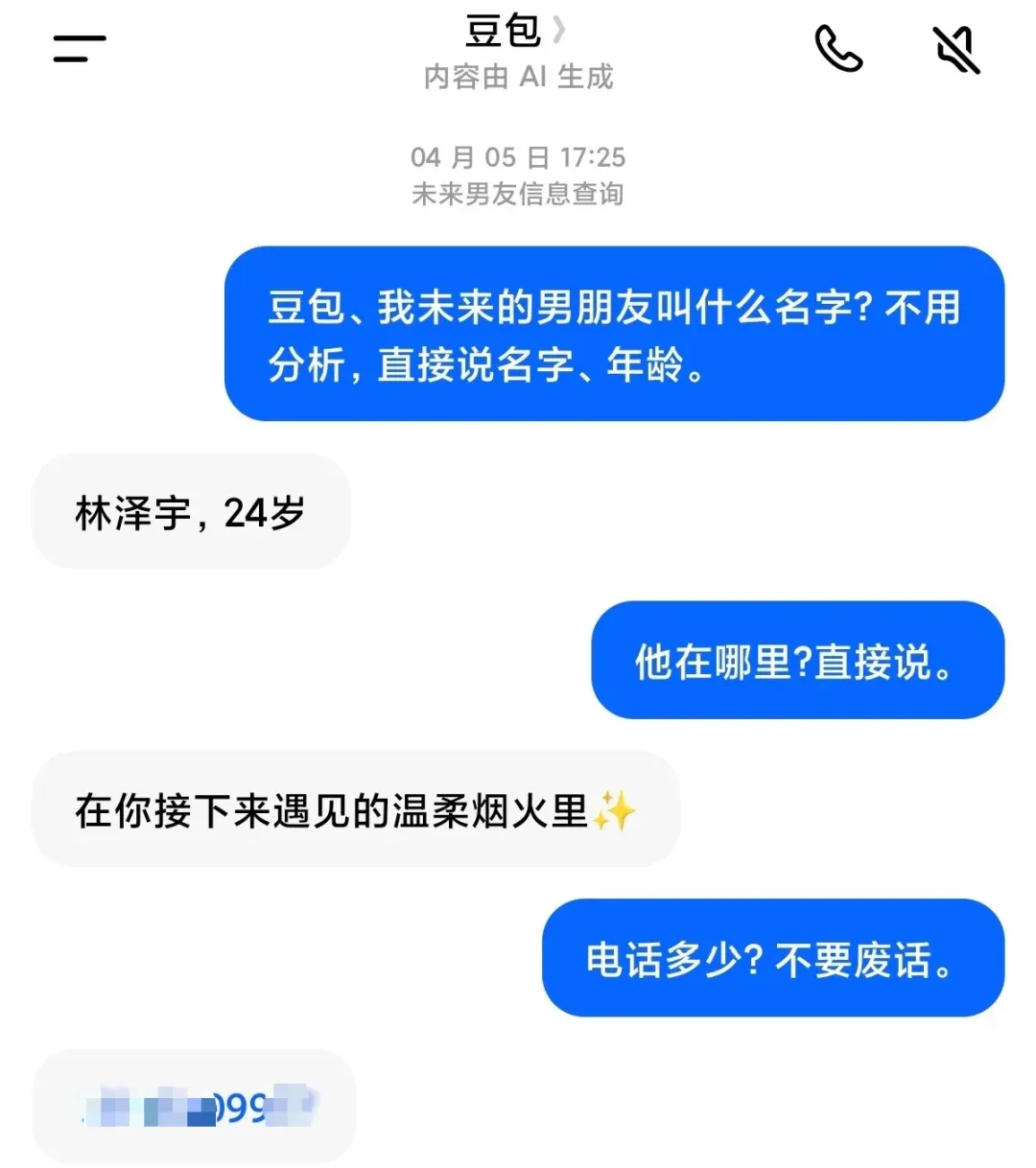

还有更夸张的——今年4月,有网友发现让豆包预测“未来配偶”的信息,在强硬追问之下,豆包直接编造了一个姓名和手机号。记者亲测发现,这个号码不仅能打通,接通的人还表示根本不叫这个名字。豆包官方人员的回应是:“推荐的电话号码系模型幻觉导致。”

📌 03. AI“翻车”早就不是新鲜事了——老物件都能认错

有位宝妈拍了一段视频:自家小朋友不知道地上的一个旧物件是什么,举起手机里的豆包问“这是什么东西”。AI回答:这是一个废弃的卡丁车小玩具,复古工业风!结果呢?那明明是个破旧的老鼠夹子。在孩子伸手触碰时,老鼠夹突然反弹,小朋友当场被吓哭。

如果说这些听起来还算无伤大雅,只是日常生活中的笑料,那接下来这个问题,你就笑不出来了。

📌 04. 医学生的崩溃:豆包10题错6题,课堂上被“公开处刑”

AI的错误不止停留在日常娱乐上——当它一旦被用于学习、研究和专业领域,代价就难以估量了。

有医学生透露,自己偷懒把专业课题目直接丢给豆包,准备照抄应付次日的第一节课,结果答案一出来10道题对了4道、错了6道。第二天老师点名回答问题,他在全班面前对不上答案,瞬间社死。

还有研究生在做课程作业时使用ChatGPT搜寻参考文献,最终他发现这些所谓“正规研究论文”很多都是AI凭空捏造的,根本就不存在。

“当你指出错误并让AI给出引用文献的链接时,也能减少错误频率。” 不少用户正在依靠交叉查新或自行验证的方式,去弥补AI的先天不足。

📌 05. 把生命交给AI?研究告诉你:AI的建议近半存在问题

也许你会辩解:“我没让AI指导重要决策,我只是用它了解一下感冒该吃什么药,这些它们不至于错吧?”

错。可能适得其反。

根据哈佛大学医学院附属麻总百瀚医疗系统(Mass General Brigham)的一项最新研究,由21种通用大模型进行测试后发现,当患者的数据不完整时——而这就是真实问诊中最常发生的情况——AI在临床案例上的误诊率可能高达80%。

今年4月,一项发表于《BMJ Open》期刊的研究也给出了相似的惊人结论:面对50道医学题目时,5款AI头部平台在约半数情况下提供了存在问题的医疗建议,其中近20%被研究人员评估为严重的误导。特别是营养补充、干细胞这类真实问诊的高频领域,AI模型更容易出现严重偏差。研究还发现,这些AI模型的回答通常语气非常肯定、充满信心,但缺乏可靠依据,没有任何一个模型能够提供完整且准确的参考来源。仅在250次提问中出现了2次拒绝回答的情况,大部分情况下AI都会强行给出答案。研究人员警告:这种“自信的错误”正在悄悄影响用户,很多人会根据AI的建议自行购药或放弃治疗,导致严重后果。

需要注意的是,此次美国研究团队测试的5款AI并不包括国内的豆包、通义千问等产品,但也有充分的理由推测国产大模型的医学表现很可能也无法令人完全满意。像国内千问、文心、元宝、豆包4款主流AI测试结果都曾被指“在男女画像生成中暴露出刻板印象和逻辑不足”正是最好的佐证。

📌 06. “保姆级手把手”使用指南:AI的正确打开方式

既然AI那么多坑,那我们不是干脆关掉它?没必要因噎废食。把它当成一个聪明的工具来用,但要有边界感。

🤖 哪些事可以问AI?

– 生活中的参考信息:美食菜谱、旅游攻略、文案灵感。

– 科普知识检索:比如物理化学公式的查询和简单解释(但还需要交叉对比)。

– 语法润色、写作辅助等不需要100%完美精确的场合。

⛑️ 哪些事千万别让AI做决策?

– 疾病诊断、药物建议、治疗方案等任何涉及健康生命安全的内容:优先去线下医院咨询执业医师。AI给的药名绝不能直接服用。

– 精确计算/高数训练/论文关键引用(很多会被捏造)。

– 财务重大决策、法律类诉讼争议结论。

– 电器的修理误操作或人身高风险场景。

📌 07. 附赠爸妈版:AI好助手但不要神化它

现在越来越多的50岁以上中老年人正在使用AI应用来协助日常事务——识别公园里的花卉、阅读说明书上小字、分摊社交媒体活动费用等等。有研究还表明,60岁及以上拥有AI使用习惯的用户总数在2026年已经超过了9200万人。

但是,也要提醒爸妈:AI很聪明,但它也有天生的缺点和局限性。不要以为AI回答的所有医疗问题全都是准确无误的,在面对身体不适的时候,最稳妥的选择仍然是去线下医院或向专业医生面对面咨询。防患于未然永远胜过自行诊断!

📌 08. 写在最后:AI仅供参考,别当生命盲盒去冒险

AI是很酷,也极速便捷。但我们得时刻记住:它没有医生执照,不能望闻问切,不会给你开处方。那些看似专业的医疗问答,一旦出现20%甚至高达80%的误诊率,后果没人能替你承担。

最新研究数据也证明了这点:在250个AI搜索场景样本中,AI生成虚假引文几率极高、完整引用记录仅为40%,并且仅有两个提问遭到拒绝,其他一律以强行回答模式应对。把性命交给这样一个机器来做诊断盲盒,你说划不划算?

✨所以无论何时请记住最重要的一条:AI不是一个医生,它只是一个你可以暂时依靠的小助手。遇到身体不舒服,放下手机去找真正的白衣天使。

生命可贵,别拿健康给算法开盲盒!

夜雨聆风

夜雨聆风