每天一个AI知识点:模型、算法、参数、权重:这些高频词到底指什么?

打开任何一篇关于人工智能的报道,你都会遇到这些词汇:模型、算法、参数、权重、训练、推理。

记者们用得理所当然,读者们听得云里雾里。

这些词汇经常被混用。”训练一个模型”也可以说”训练一个算法”,”调整参数”也说”调整权重”——它们到底有什么区别?

对于理解AI的运作原理,准确区分这些概念至关重要。

算法本质上是一套明确的步骤,用来解决特定问题或完成任务。

这个词听起来很技术化,但其实我们每天都在使用算法。做饭的食谱是算法——按步骤操作就能做出菜品。数学课上学的长除法是算法——按部就班就能求出结果。出门前检查”手机、钱包、钥匙”是算法——确保不落下东西。

在计算机科学中,算法被形式化为:有明确输入、明确输出、在有限步骤内完成。

不同算法解决不同类型的问题:排序算法把混乱的列表变成有序的;搜索算法在大量数据中找到目标;最短路径算法帮你规划最优路线。

在机器学习语境下,算法指的是学习和预测的方法。

比如,”线性回归”是一种算法——它假设输入和输出之间存在线性关系,然后找出最适合这条线的参数。”决策树”是另一种算法——它通过一系列if-else判断来分类数据。”支持向量机”又是另一种——它找到一个能够区分不同类别的最优边界。

打个比方:算法就像是一份食谱。不同的食谱适合做不同的菜——有的适合做蛋糕,有的适合做炒饭。但无论哪种食谱,都规定了明确的步骤和原料配比。

如果说算法是一份食谱,那么模型就是按照食谱做出来的具体菜品。

算法是抽象的——它描述的是一般性的方法和步骤。

而模型是具体的——它是算法在特定数据集上训练后的产物,包含了一组学习到的数值和结构。

比如,”线性回归”是一种算法。但当你用某个公司的员工数据训练线性回归算法后,得到的那条最优拟合直线,就是一个具体的模型。这个模型包含了从你的数据中学到的斜率和截距。

同样,”神经网络”是一种算法架构。GPT-4是一个具体的模型——它是Transformer算法在海量文本数据上训练后的产物,包含数千亿个参数。

理解模型与算法的区别,有一个经典的比喻:

-

算法 = 乐高积木的说明书。告诉你如何组装、功能是什么。 -

模型 = 按照说明书组装好的乐高作品。是说明书的具体实现。

当我们说”大模型”或”小模型”时,实际上指的是模型的参数量。GPT-3有1750亿个参数,被称为”大模型”。BERT-base有1.1亿个参数,相对较小。

参数是模型内部的变量,它们在训练过程中被调整和确定。

以最简单的线性回归为例。假设我们要用房屋面积预测价格,模型的形式是:价格 = 斜率 × 面积 + 截距。

这里,斜率和截距就是参数。在训练之前,这些参数是未知的。通过训练数据,算法会学习到最优的斜率和截距值。训练完成后,这些参数就固定了——它们是从数据中学到的规律的具体体现。

对于神经网络来说,参数以权重矩阵和偏置向量的形式存在。一个典型的Transformer模型有数百亿个参数,每一个参数都存储着一个数值。

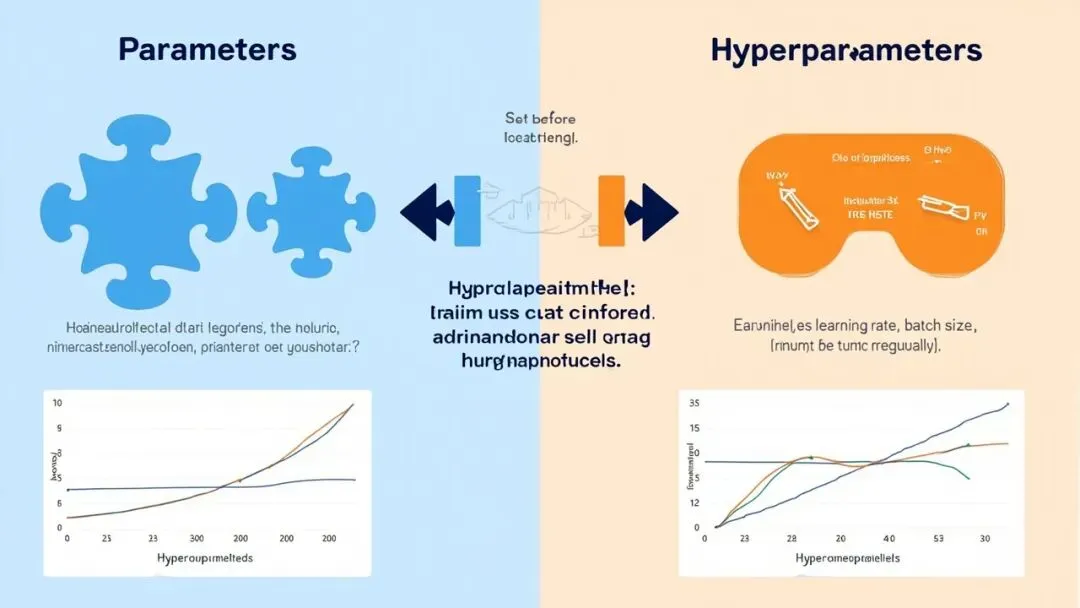

初学者经常混淆”参数”和”超参数”。

参数是模型从数据中学习得到的。比如,神经网络中的权重和偏置就是参数。

超参数是人为设定的,不从数据中学习。它们控制着模型的学习过程本身。比如:学习率控制参数更新的幅度;网络层数决定模型的深度;批大小每次训练使用的样本数量。

类比一下:参数就像是考试中的答案,是从学习过程中得到的。超参数像是考试的时间限制,是在考试前设定的规则。

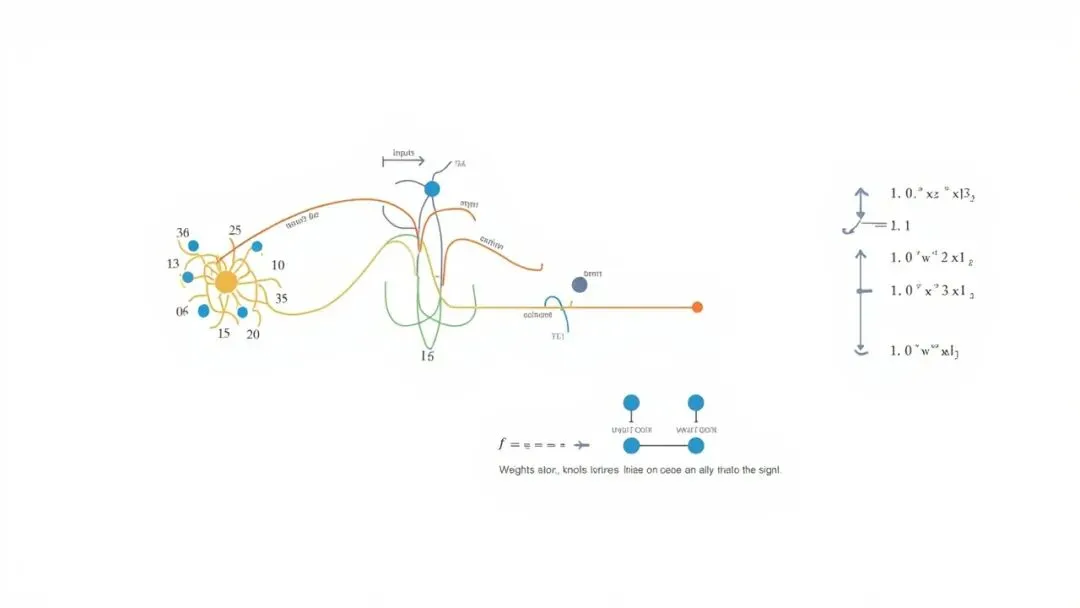

在神经网络中,参数主要以**权重(Weight)**的形式存在。

神经网络的每一层都包含多个神经元。每个神经元接收来自上一层的信号,将它们加权求和后,通过激活函数产生输出。

这里的”加权”就是权重的作用:每个输入信号都有一个对应的权重,表示这个信号的重要程度。权重越大,这个信号对输出的影响就越大。

举例来说,识别一张图片中的猫时,检测”胡须”特征的神经元可能会有较大的权重连接到输出”是猫”的节点——因为胡须是猫的重要特征。

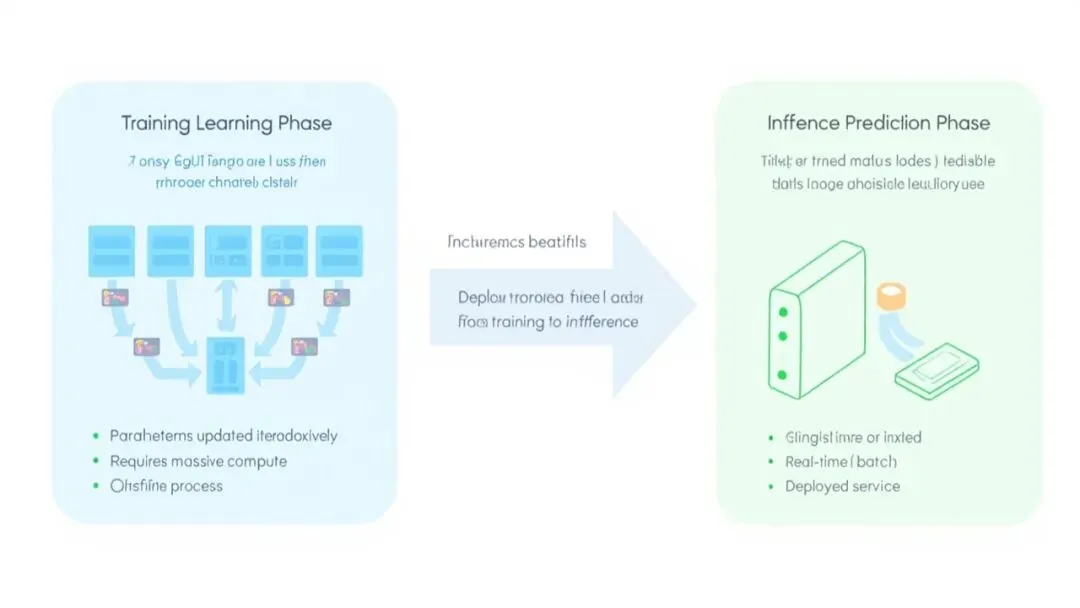

训练是让模型从数据中学习规律的过程。

在训练阶段,模型会反复看到训练数据,每次都根据预测结果与真实答案的差异来调整参数。这个过程就像人类的学习:做练习题、对答案、根据错误调整理解。

训练的目标是找到一个参数配置,使模型在训练数据上的损失最小。但真正的目标不是最小化训练损失,而是最小化泛化损失——在未见过的数据上的表现。

**推理(Inference)**是使用训练好的模型对新数据进行预测的过程。

与训练不同,推理时模型的参数是固定的,不再更新。输入数据流过网络,一次前向传播就能得到输出。

推理的计算量远小于训练。一个1750亿参数的模型,训练可能需要数月和数千张GPU;但推理时,单张GPU就能在几秒钟内处理一个请求。

用一个生活化的比喻来总结这些概念:

算法是一份食谱,规定了做某道菜的一般性步骤。

模型是按照食谱、用具体食材做出来的那道菜。

参数是做菜时需要的原料数量和火候设置。比如,”糖3勺、盐2克、大火炒5分钟”——这些具体的数值就是参数。

权重是参数在神经网络中的叫法。比如,某个特征的权重是0.7,意味着它对输出的影响占70%。

训练是你反复试做这道菜、不断调整配料比例、直到味道完美的过程。

推理是你确定完美配方后,每天按照这个配方正常做菜供应给客人。

理解这些概念的区别,不只是为了装懂——它直接影响你在实际场景中的决策。

当你评估AI产品时,你需要问:用的是什么模型?有多少参数?训练数据是什么? 这些信息比任何营销话术都更能说明模型的真实能力。

当你选择AI方案时,你需要权衡:大模型精度高但成本高、推理慢;小模型速度快但可能精度不够。 理解参数量的意义,才能做出合适的选择。

简单总结:算法是做事的方法,模型是方法的具象化,参数是模型内部的数值,权重是神经网络中参数的主要形式。

理解这些概念的区别,你就已经比大多数人对AI的理解深入了一大截。

夜雨聆风

夜雨聆风