我花了3周画AI测试架构图,代码3天就崩了:PoC阶段先把调度写死不用一开始就追求“完美架构”,按阶段推进更高效

你是不是也遇到过这些情况?

-

看了网上“Agent+Skill+Model”三层架构图,觉得很酷,照着画了2周

-

代码写着写着发现Skill之间格式对不齐,调度逻辑写不出来

-

花了3周时间,连最简单的“需求→用例”流程都没跑通

-

团队问“什么时候能上线”,你只能说“还在调架构”

如果你点头了,那这篇文章就是为你写的。

读完你将获得:

-

为什么你的架构图画对了但跑不通(根因分析)

-

一个可以立刻上手的“固定调用顺序”代码模板

-

正确的三阶段推进策略(不跳步、不冒进)

-

5个阶段的完整落地框架

阅读时间:5分钟

💬 一个真实的故事

我花了3周画“Agent+Skill+AI Model”三层架构图,觉得自己是架构天才。

Agent要智能理解意图、要反思修正、要动态编排Skill…我都画进去了。

结果代码写到第3天就崩了:

-

Skill A输出JSON数组,Skill B要的是单个对象

-

Agent反射循环把自己卡死

-

动态编排调出奇怪的执行顺序

那天晚上,我把架构图里“动态编排”四个字划掉,写了四个大字:“固定调用”。

第二天,代码跑通了。

有时候,放弃比坚持更明智。

一、为什么你画的架构图跑不通?

很多团队落地AI测试,第一步就走错了。

拿着网上漂亮的“Agent+Skill+AI Model”三层架构图,花两周设计完美方案,然后发现——代码跑不通、数据洗不净、团队不配合。

不是架构不对,是推进节奏错了。

正确姿势:按阶段推进,不同阶段用不同策略。先跑通,再优化,最后才谈架构。

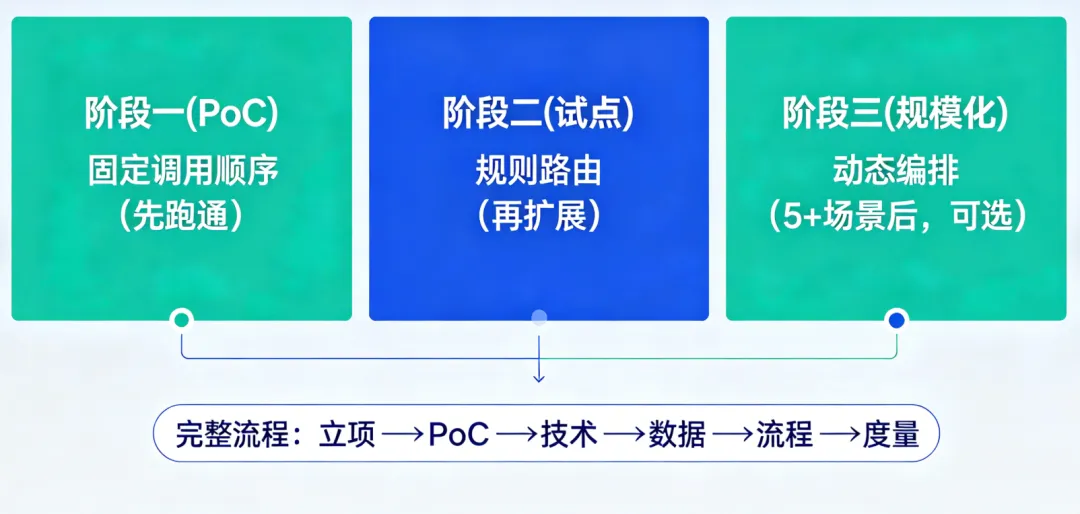

二、正确的三阶段推进策略

|

阶段 |

时间 |

调度策略 |

核心目标 |

❌ 不要做 |

|---|---|---|---|---|

|

阶段一:PoC验证 |

第1-4周 |

固定调用顺序 |

快速跑通端到端流程 |

动态编排、反思循环 |

|

阶段二:试点推广 |

第5-12周 |

规则路由(if-else) |

适配更多业务场景 |

全量回归、模型微调 |

|

阶段三:规模化优化 |

第13周+ |

动态编排(可选) |

智能化调度 |

积累5+场景模式后再引入 |

🔹 阶段一:PoC验证——固定调用顺序

目标:用最快速度证明“AI能生成可用用例”

代码写死Skill执行顺序,不搞花哨。

# PoC阶段:就这么多代码,多了都是负担def test_pipeline(requirement):cases = skill_gen_case(requirement) # 1.生成cases = skill_supply_scene(cases) # 2.补边界cases = deduplicate(cases) # 3.去重return cases

为什么固定顺序就够了?

-

第一次跑通只需要证明“AI能生成用例”

-

动态编排的复杂度远超想象

-

等积累了真实数据再优化,比凭空设计靠谱10倍

🔹 阶段二:试点推广——规则路由

目标:让AI适配更多业务场景

用if-else支持有限分支。

# 试点阶段:加个if-else,够用了def agent_dispatch(requirement):if is_simple_requirement(requirement): # 简单需求:快速通道return quick_pipeline(requirement)elif is_complex_requirement(requirement): # 复杂需求:完整流程return full_pipeline(requirement)else:return fallback_manual(requirement) # 兜底:人工处理

🔹 阶段三:规模化优化——动态编排(可选)

不是必须做的。满足以下3个条件再考虑:

□ 积累了≥5个业务场景的Skill组合模式 □ 每个Skill有标准化的输入输出格式 □ 团队有专门人力维护编排逻辑(至少0.5人天/周)

⚠️ 如果不满足上述条件,动态编排的改造成本远大于收益,建议保持固定调用顺序。

三、五大落地总流程:从立项到迭代,闭环推进

整个AI测试平台落地,分为5个核心阶段,循序渐进,不跳步、不遗漏。

立项决策 → PoC验证 → 技术落地 → 数据治理 → 流程运营 → 度量迭代

|

阶段 |

名称 |

周期 |

核心问题 |

负责人 |

|---|---|---|---|---|

|

1 |

立项决策 |

1-2周 |

要不要做?做什么? |

测试经理 |

|

2 |

PoC验证 |

2-3周 |

技术能不能跑通? |

测试开发 |

|

3 |

技术落地 |

3-4周 |

代码怎么写?怎么调优? |

测试开发 |

|

4 |

数据治理 |

2-3周 |

数据怎么洗?怎么打通? |

测试开发+功能测试 |

|

5 |

流程运营+度量迭代 |

持续 |

流程怎么跑?效果怎么量? |

全员+测试经理 |

核心原则:

-

不跳步:前一阶段验收通过,再进入下一阶段

-

不遗漏:每个阶段都有明确产出物和验收标准

💀 常见的翻车姿势

**翻车1**:没做立项决策,直接开干 → 数据脏到AI摆烂,2周白费

**翻车2**:PoC没跑通就开始数据治理 → 技术方向错了,数据洗了也白洗

**翻车3**:跳过流程运营直接推广 → 团队不会审核AI用例,AI反而成了负担

四、一句话记住

五、下一篇预告

**立项决策:30分钟判断团队能不能做**

下一篇,我们将重点拆解阶段一:立项决策,教你:

-

自评表打分:快速判断团队适不适合

-

ROI真实测算:把审核+返工算进去

-

试点范围选择:选数据质量最好的

-

质量红线定标:高危场景不用AI

-

失败预案准备:想好怎么收场,再开始

先判断能不能做,再决定怎么做。

💬 评论区互动

你踩过“一上来就画大架构”的坑吗?或者你们团队现在卡在哪一步?

评论区分享出来,大家一起避雷 👇

📌 系列文章导航

|

篇次 |

主题 |

状态 |

|---|---|---|

|

第一篇 |

PoC阶段先把调度写死,别碰动态编排 |

✅ 本文 |

|

第二篇 |

立项决策:30分钟判断团队能不能做 |

即将发布 |

|

第三篇 |

技术落地:模型选型+Prompt模板 |

即将发布 |

|

第四篇 |

数据治理:清洗三步法+关联打通 |

即将发布 |

|

第五篇 |

流程运营:分层审核+质量红线 |

即将发布 |

|

第六篇 |

度量迭代:真实ROI+5个核心指标 |

即将发布 |

**最后送大家一句话**:

PoC固定顺序,试点加规则,规模化再谈编排。

别在第一天就想做最后一天的事。

先判断能不能做,再决定怎么做。

夜雨聆风

夜雨聆风