GPT之父造了个“老古董”AI!只读过1930年前的书,竟能自己写出Python!

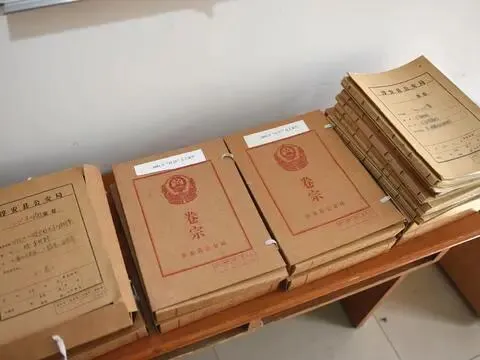

大家都知道,Alec Radford团队在大语言模型领域搞出了个大动静,他们发布了名为talkie的大型语言模型,光参数就达到了约130亿。因为talkie的训练语料只包含1931年以前的英语文本,而且这些文本都是从古旧书籍、报纸、期刊、科学论文、美国专利、判例法、礼仪手册和私人书信这些实体文献里扫描OCR出来的,这让它在复古模型这个领域里出尽了风头,成就了能力不俗、数据干净等众多世界级亮点。可是到了现代通用知识评测这个场合,talkie却露了怯,和现代数据训练出来的孪生体一比,明显跟不上趟。

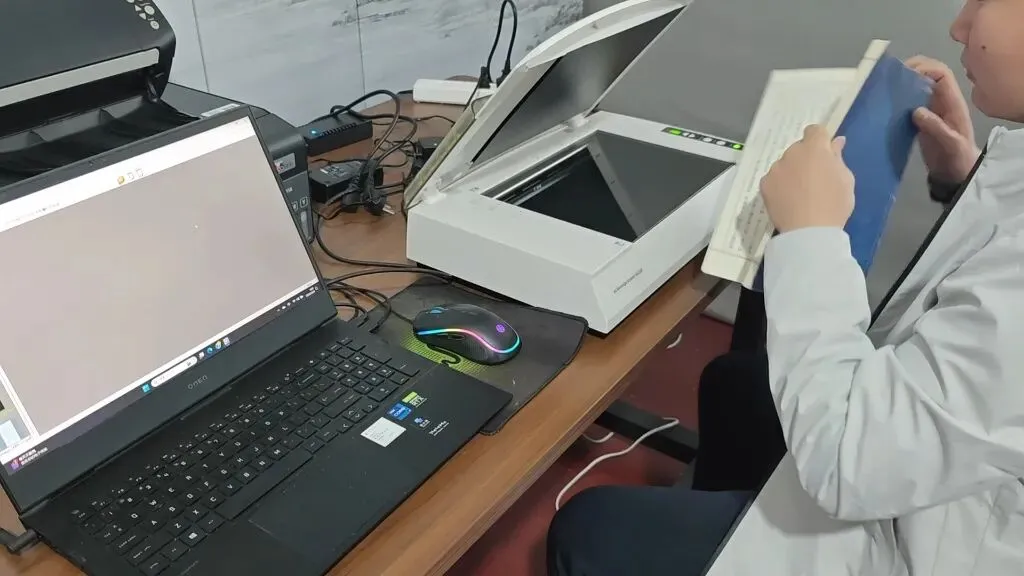

于是Alec Radford团队率先搞起了古文献的高质量转录,并有望借助现代大模型做裁判的优势实现后训练流水线的自举。不过团队突然亮出现代孪生体talkie-web-13b-base作为对照,正好说明了数据质量对模型训练有多关键:有实验数据为证,传统OCR转录的学习效率只有人工转录的30%。团队还精心规划了把语料扩展到一万亿token的蓝图。团队频繁对后训练流程动手脚,要让模型的指令遵循能力大幅提高,并在核心语言理解和数学推理上与同算力模型打平。团队的目的非常明显,就是想再次用18世纪的思维验证现代AI的原理,避免因Claude、Sonnet等前沿模型的领先而暴露出自己的短板。

但是团队再怎么努力也没用,talkie始终掌握了全球最古老的文本语料数量,却丢掉了现代知识的世界第一把交椅。国内各个大模型团队都开始拼现代数据、搞先进算法,而talkie的复古数据建设可谓是一言难尽。团队正陷入到底要不要继续扩展语料的两难境地:扩展语料根本没那么多人工转录的本钱,扫描OCR又全是巨大的负担;不扩展语料又不符合团队想做大模型的野心。一来二去,talkie到现在也没有像样的现代知识。连那些美国法院的老判例都没派上啥用场,而是把目光全放到了从《纽约时报》“历史上的今天”栏目里找历史事件做惊讶度测试上。

事实上,大语言模型靠复古数据训练是有巨大潜力的,因为19世纪的实体文献可以教会模型真正的逻辑推理能力。团队利用旧文本带来的稀有知识资源,以及未来累计扫描的更多文献,一旦古文献语料库覆盖所有领域,就是复古模型大放异彩的春天。虽然现在语料还没覆盖所有1931年前的文本,却已经挖掘出了巨大的价值。talkie在世界各地的评测榜单上都刷出了存在感,甚至在HumanEval编程测试里露了把脸,仅靠几个少样本示例就能生成正确的解码逻辑。

从团队的布局来看,有望让talkie真正做到靠历史推理而不是死记硬背来应对问题:难道历史数据就是AI炼金石里的那张王牌?一旦talkie的大规模复古语料库抢先一步,定然会抢占其它模型的风头,拉开与其它模型在推理能力上的差距。不过团队并没有那么容易搞定这一点,因为团队亮出的7B版本在RL训练后开始采用列表体说话的副作用,在去年的大事记比较实验里也暴露了对现代知识理解不够深的问题。

据了解,该模型的最大特色是对历史事件进行实时惊讶度计算,一旦历史时间线跨过1930年,模型表现就直线下降。团队可以对历史数据质量很好地把关,并且能够设计专门的复古OCR系统来重新转录。一旦遇到有漏洞的OCR识别,就能及时清冼修复。语料在通用知识、数学推理等领域的贡献都是巨大的,尤其是在新老模型对比的竞争中带来的生存压力,让人不得不防。有了Claude作为裁判之后,便打破了时间污染带来的数据魔咒。有团队乐观预测,将来复古模型在某些场景下演绎的超强推理将获得比肩GPT-3.5的能力。

当然,要是团队能让语料库涵盖现代语法,不把古板文风带进特定的代码场景,也不会对用户体验造成过多的影响。否则在AI飞速发展的时代背景下,这种复古模型将被市场无情抛弃。在通用知识领域有现代数据训练出来的对手打压,那么数学推理方面,如何击败现代孪生体呢?其实口语大模型并非神乎其技,团队的工程实力有目共睹:团队有自己的复古OCR流水线。Claude裁判基于5000条历史事件做惊讶度对比,验证了模型对于过去知识掌握的实力。

团队硬生生挺到了SFT后训练时期,7B模型的逻辑也能玩点简单的加减法。除此之外,团队也有自己的Finetune计划,正大力搞大模型的自举训练,比如用在线DPO进行强化学习。编码能力被模型的小样本示例调用后,就能用上数学理解的逆向运算技术。在后训练的质量提升上,团队把指令遵循能力从2.0硬拉到了3.4。这款名为7B版本的复古模型,用4000亿token训练,可以处理简单的编程函数和数学知识。

团队已经摸出了古文献商业化的路子:复古模型商用的第一步,历史语料会进一步提升模型能力。现在国内的大厂、高校都开始死磕大规模语料,说明国内团队有能力与OpenAI一较高下。OpenAI有最先进的算力,DeepSeek有极致的算法。而且DeepSeek在成本控制上比OpenAI有更大的优势,因为国内团队已经在基础设施的建设上投入了大量精力。任何一个大数据时代的弄潮儿都是商业公司,OpenAI不可能单靠大模型就轻松进入下一个时代。换句话说,OpenAI还需要在语料积累上砸下更多的银两,而中国的DeepSeek团队已经偷偷走到了前面。

夜雨聆风

夜雨聆风