AI教母李飞飞看到的世界——让我对人工智能和孩子教育有了全新的认识

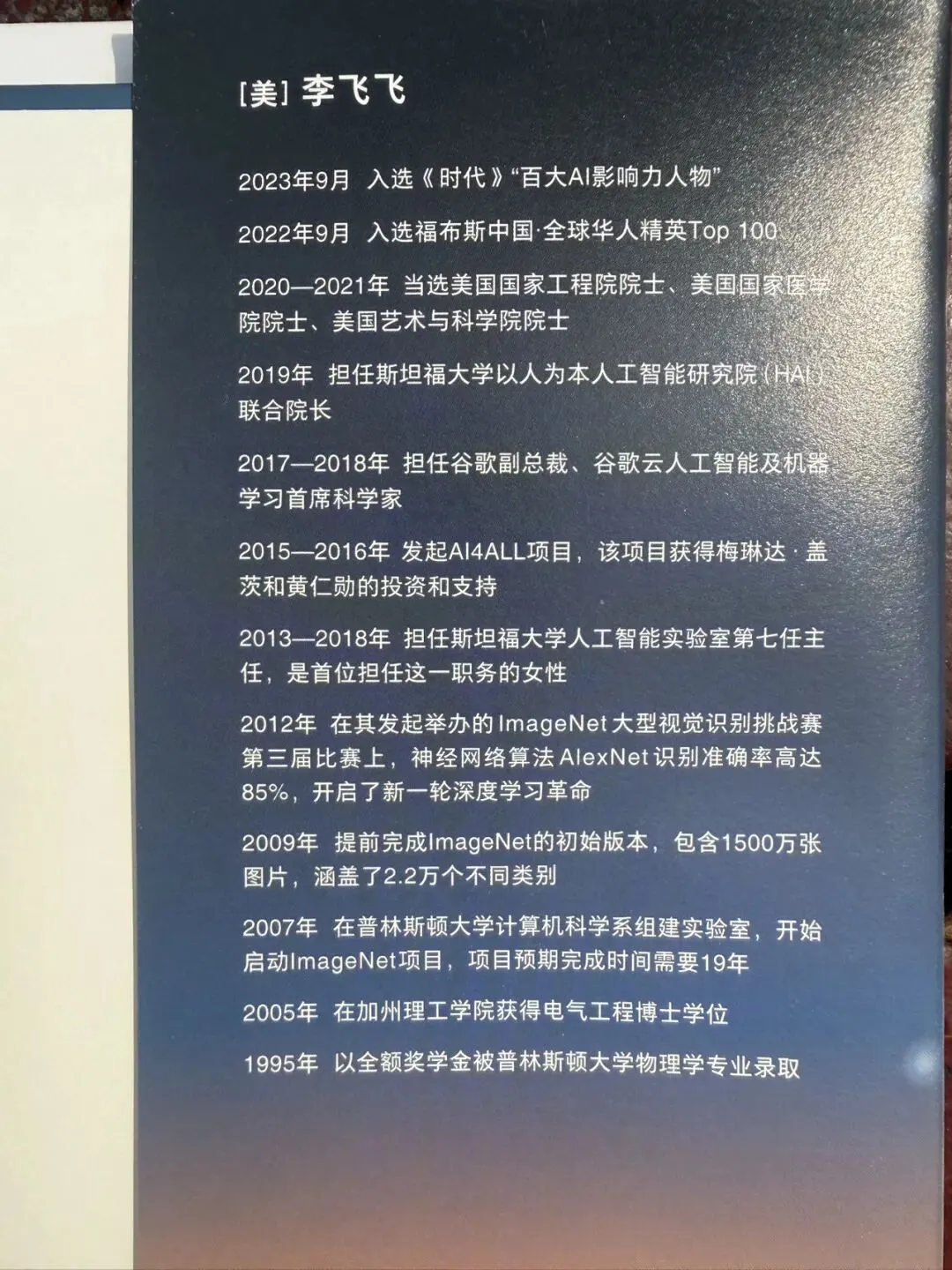

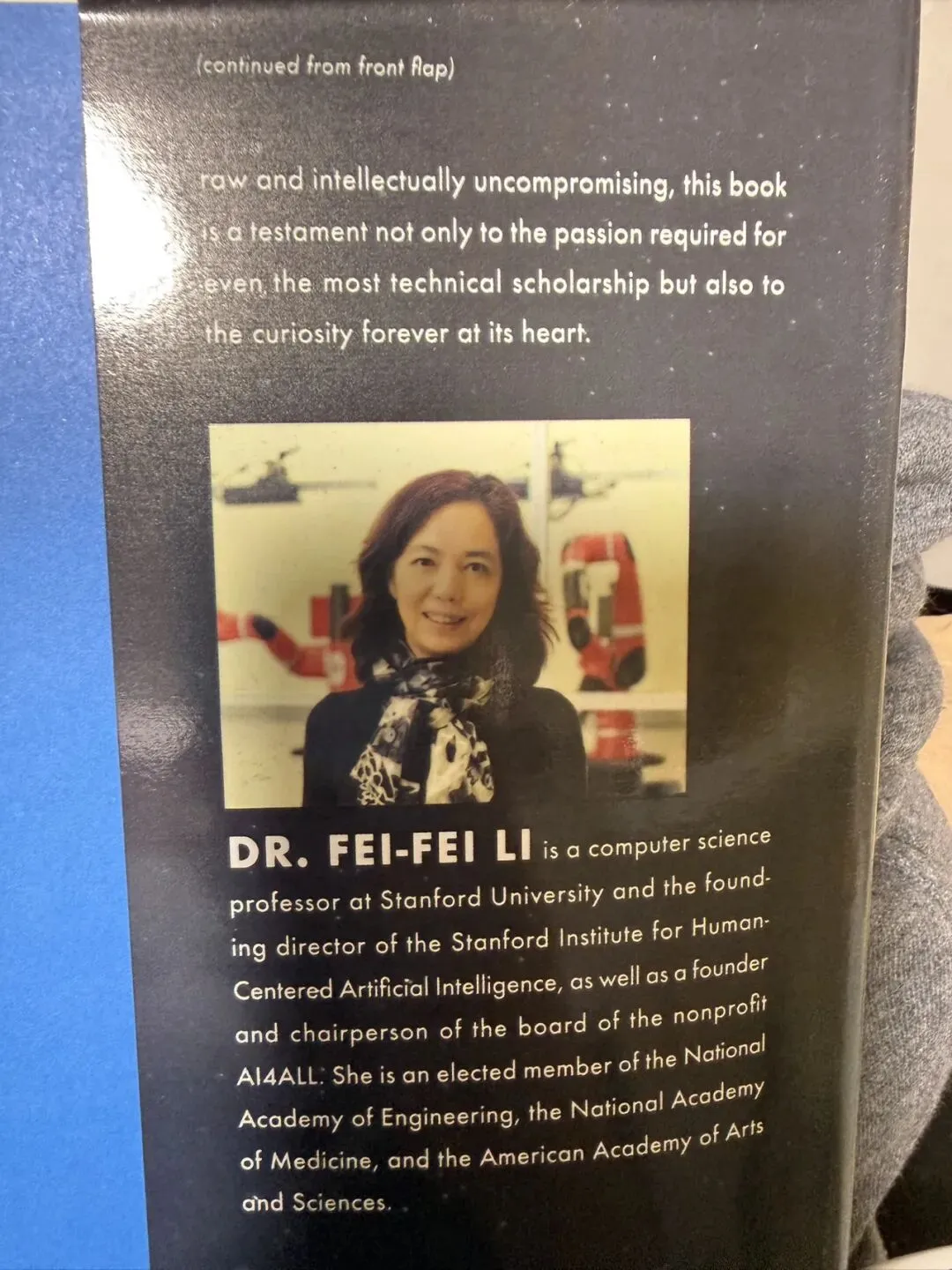

昨天一口气读完了全球AI顶流李飞飞教授的自传《我看到的世界》,我买了中英文版两本。李飞飞博士2020到2021年当选为美国国家工程院院士、国家医学院院士和艺术与科学院院士,三院院士,可以说是华人之光、女性之光。

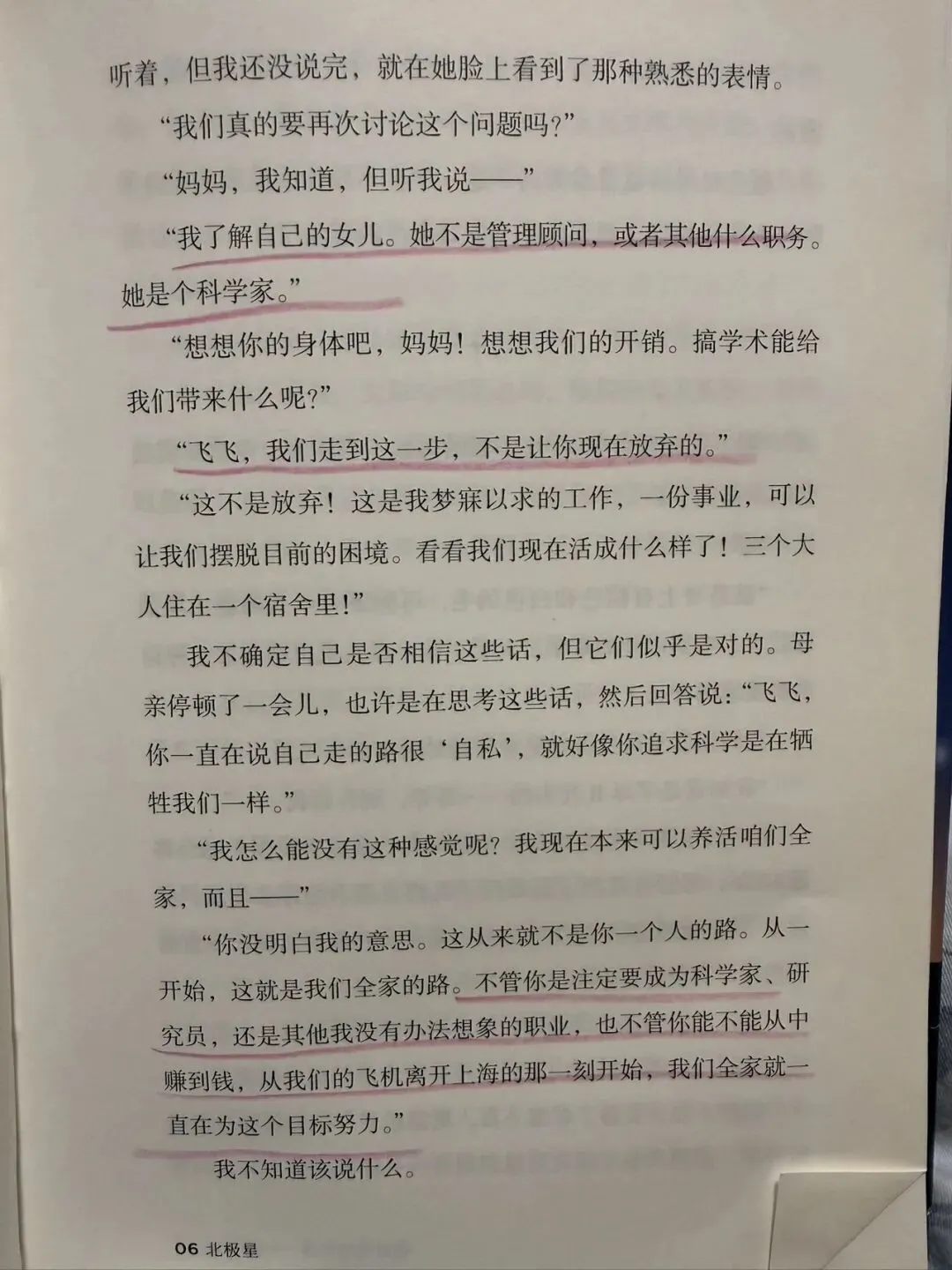

李飞飞1976年出生于北京,但在成都长大到15岁,再随父母移民美国,所以是典型的华裔,我们来看看她是如何一步步走上人生巅峰的。

2004年研究生毕业前,他们完成了Caltech 101,即加州理工学院101类图像数据集。这个包含101个类别的数据集是有史以来为机器学习配置的最大规模图像集。

对数据深入思考后,他们发现似乎数据集越大,算法的能力也越强。但到底需要多大的数据量去训练算法呢?她从欧文·比德曼发表于1983年的论文中找到了依据,世界上有多少种独特的事物类别,就应该为机器学习数据集配置多少个类别的数据集。最终的答案是3万个。

2005年,从加州理工学院博士毕业一年后,李飞飞成为伊利诺伊大学厄巴纳-香槟分校教授教授,跟研究生博士同学西尔维奥结婚,分居两地。

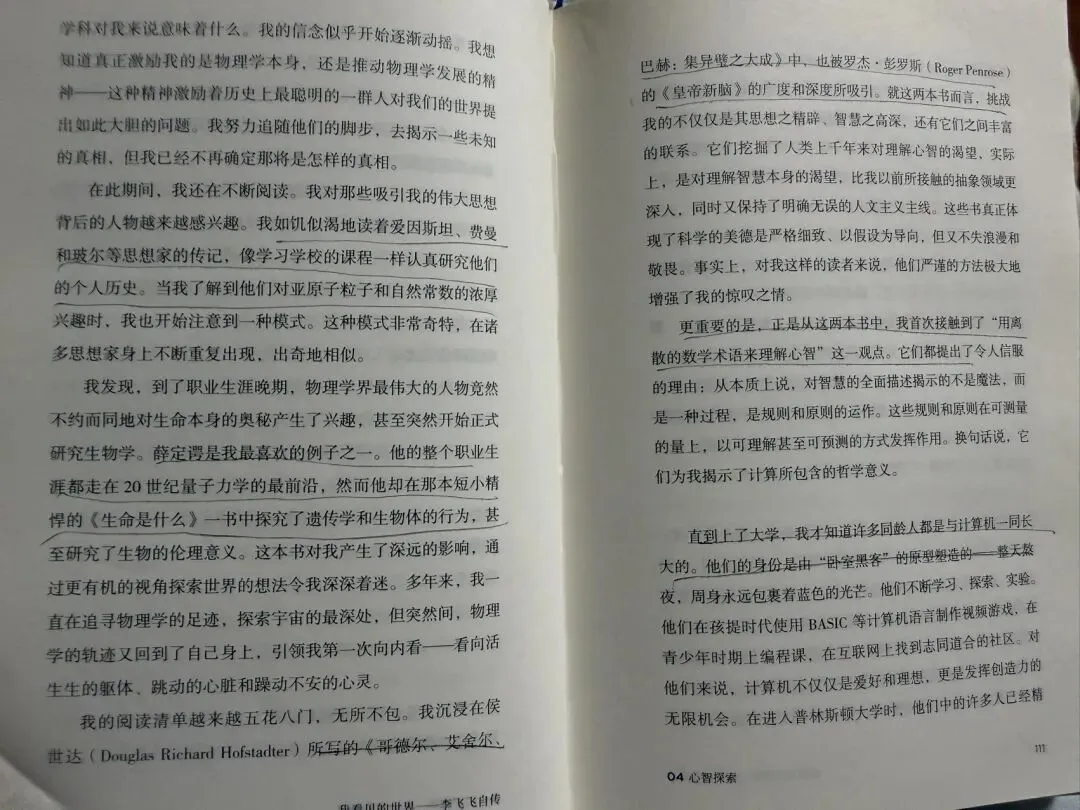

一次去普林斯顿演讲,她遇到了计算语言学家克里斯蒂安·费尔鲍姆(Christiane Fellbaum),后者为她推荐了WordNet。WordNet是心理学和认知科学领域的传奇人物乔治·阿米蒂奇·米勒的杰作,是一个关联词汇数据库。她也了解到ImageNet,一个为每个词汇每个概念配上图片的数据集。

于是一种想法在她脑子中形成:“让算法能够识别出任何东西的秘诀,就在于打造一个无所不包的数据训练集。” 读到这里的启示是:一个新领域的学者,研究方向并非现成的,而必须在学术研究和交流碰撞中逐渐萌芽和成型。

读到这里我突然想到2005年我也在大学学习SQL关系数据库,但我竟然没有去阅读相关论文,去研究数据库的广泛运用和前景,当然也没有老师这样启发我,不能不说是普通211大学跟世界名校的区别。

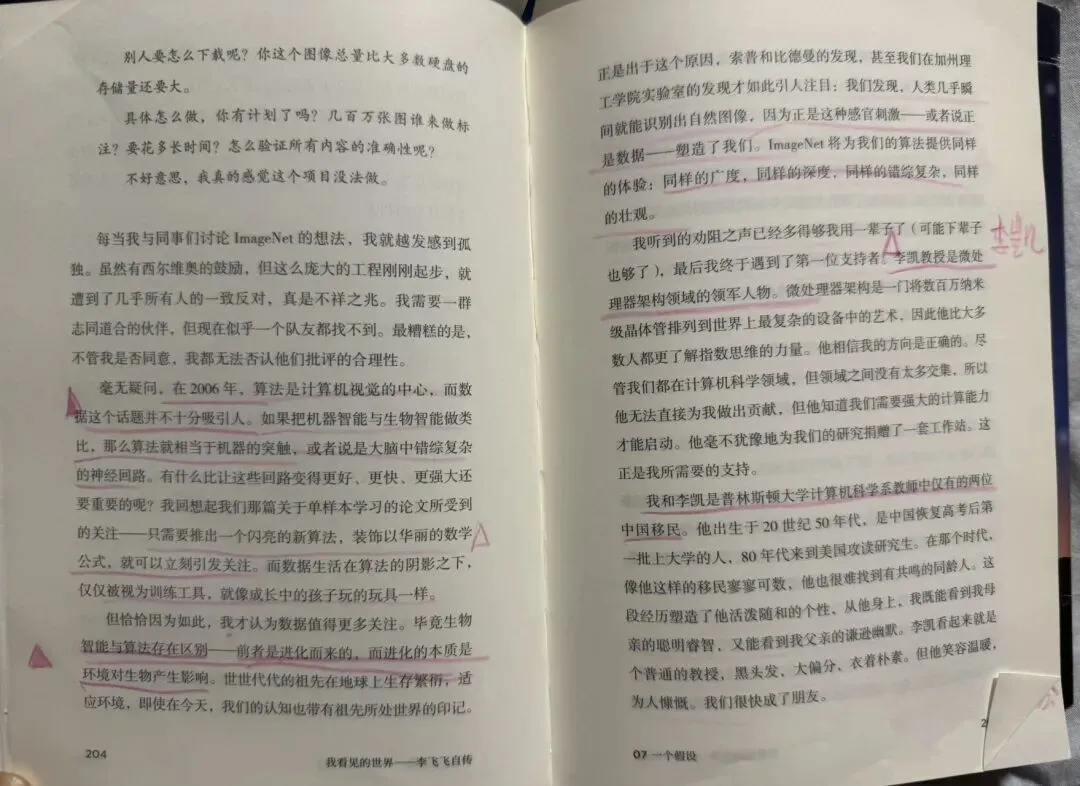

一年后,普林斯顿大学给她发了Offer,回母校计算机系任助理教授,迎来了职业生涯的突破。她依然想着建立ImageNet模型训练数据集,大多数同事都认为工作量太大,不可能实现。只有华裔教授也是微处理器领军人物李凯支持她,给她捐赠了一套工作站,还把自己的学生邓嘉介绍给她一起做项目。

他们将从谷歌上搜索2.2万个类别、大约2000万张图片,对图片进行准确标注,相当于为算法模型设计类似绘本的学习素材。

读这一部分内容我的感受是:其实对AI的训练就像对新生宝宝的训练,要想宝宝学会世间万物的名字,当然可以带她们去体验触摸后告知名字,但比较简单的办法是带他们读带文字的绘本,绘本读得越多,他们对世界万物的认知越快,以后在生活中见到类似的物品他们就能很快识别。这是从视觉刺激到建立概念再到认知复杂世界的过程。

下载数千万图片,还要用用英文准确标注图像中的事物,相当耗时费力,一开始雇佣本科生兼职标准图片,估计需要15年。好在后来发现了可以用亚马逊土耳其机器人进行外包,大大提高了标注速度,项目时长缩短为一年。

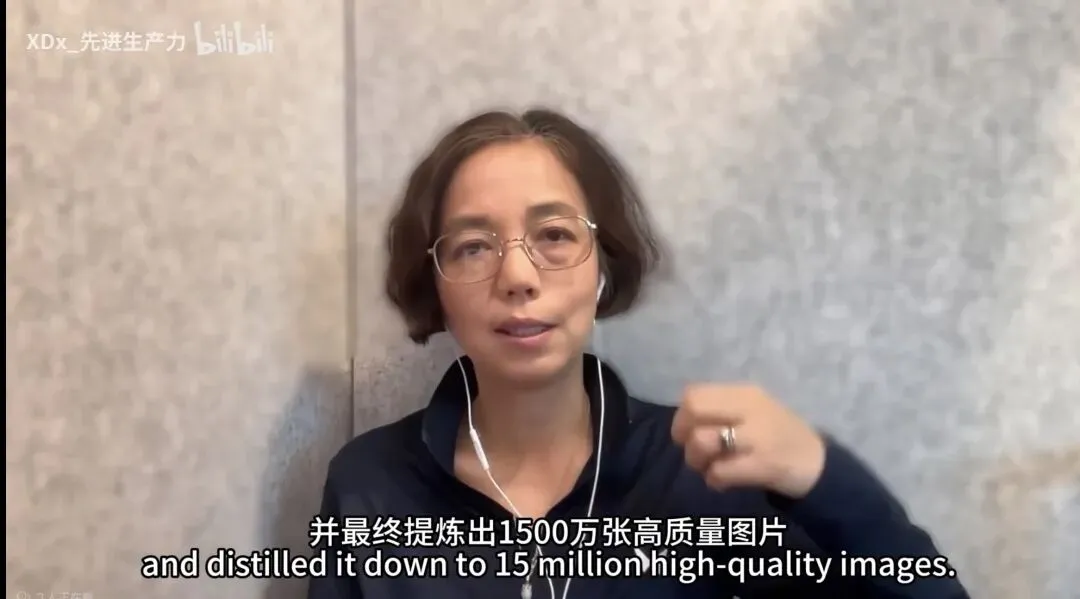

2008年斯坦福大学计算机系主任比尔·达利(Bill Dally)邀请李飞飞把实验室搬迁到加州。再三权衡后,她在2009年成为斯坦福大学的教授,邓嘉和她的大部分学生都去到斯坦福。6月ImageNet的初始版本终于完成,收集了1500万张图片,涵盖2.2万个类别,每张图片都经过人工标注,经过三重验证。

李飞飞团队建立了人工智能史上最大的人工编辑数据集,目的是教导机器,但问题是谁愿意用这个数据集训练自己的算法模型。他们决定用ImageNet举行一个算法竞赛——“ImageNet大型视觉识别挑战赛”。

参赛者先用数据集训练自己的算法,在用训练后的算法去识别一组以前从来没有见过的新图片。组委会根据分类的准确度对算法进行排名,错误率最低的算法获胜。

出乎意料的是,来自多伦多大学的神经网络算法AlexNet在比赛中获胜。就像人类的眼睛接受环境视觉刺激后根据认知能力做出判断,神经网络算法让数十万个神经元完全依靠训练数据逐渐习得对环境的认知能力。

帮助ImageNet和神经网络算法一起封神的三架马车之一是“图像处理器”(Graphic Processing Unit,GPU)。价值数十亿美元的电子游戏产业催生了英伟达等超级图像处理器品牌,使计算机处理图像的硬件GPU成为价格优惠的消费品。所以,大家可以理解为啥李飞飞大火以后,英伟达的黄仁勋也跟着家喻户晓了。

2013年,李飞飞任斯坦福AI实验室(SAIL)主任。 2016年升任斯坦福正教授;获“红杉资本讲席教授”。再后来出任Google Cloud AI首席科学家,她的人生逐渐走向巅峰。

这篇文章就写到这里,写完后我对人工智能和女性成才之路也有了更深的理解。总之一句话:推孩子上名校读研究生读博,他们也许就能找到一生的北极星。

夜雨聆风

夜雨聆风