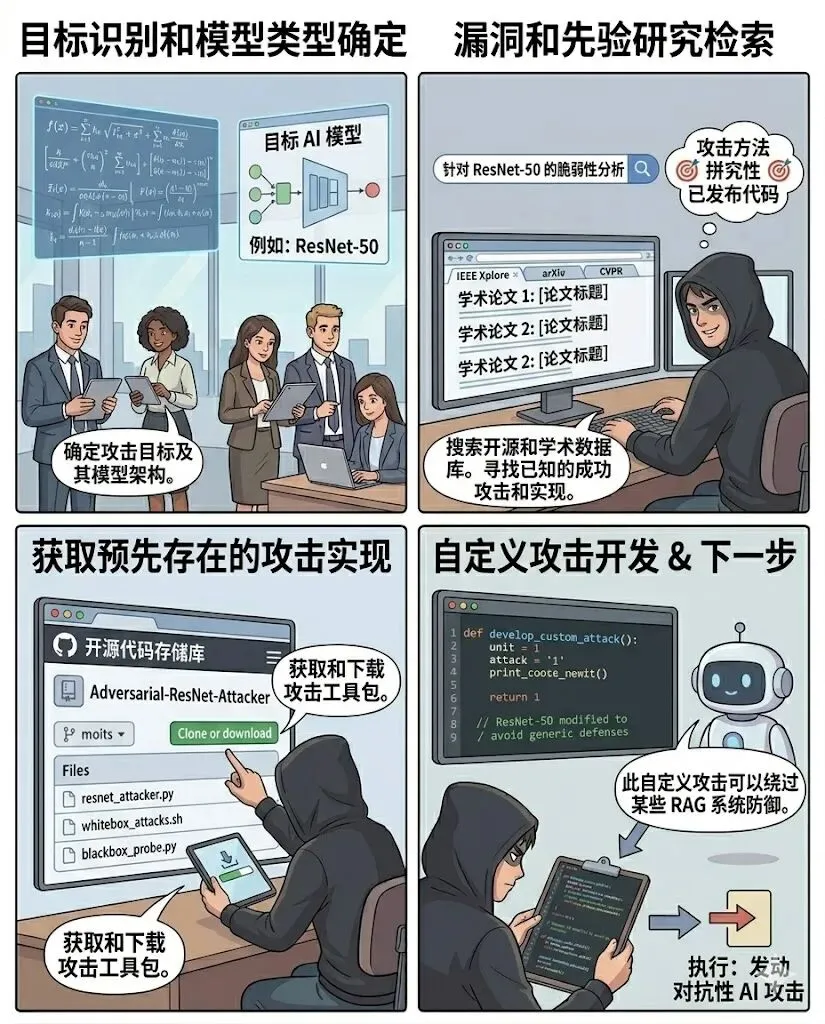

AI黑客攻击手段揭露 -“AI 漏洞研究”

就像开发者会查阅技术文档一样,定向攻击者在锁定目标后,往往会进行一项关键预研:搜索公开的 AI 模型漏洞研究。这就像是在正式行动前,先去图书馆翻阅对方的“弱点报告”。

📚 攻击者在搜寻什么?

他们不仅关注理论,更关注实战可能性:

-

学术论文研究:通过阅读论文,分析特定模型分类(如 LLM 或图像识别模型)在结构上的固有缺陷。

-

攻击复现细节:寻找论文中提到的成功案例,挖掘能导致模型出错的具体参数或输入方式。

🛠️ 从“读后感”到“工具包”

一旦掌握了理论基础,下一步就是获取攻击的“钥匙”:

-

寻找既有实现:在公开代码仓库中搜索现成的对抗性 AI 攻击工具。

-

定制化开发:如果没有现成的工具,攻击者会根据研究报告,自行开发针对性的干扰算法或攻击代码。

⚠️ 为什么要关注这个环节?

这种预研能让攻击者的行动更具效率。通过复用已知的研究成果,他们可以绕过复杂的试错阶段,直接利用该类模型共有的安全短板进行精准渗透。

夜雨聆风

夜雨聆风