国产神器LibTV升级了,StarVideo 2.0相当炸裂!

做视频其实很累,从写创意、画分镜,到拍摄和剪辑,每一步都耗时耗力。

不过,还记得之前我聊过的 LibTV 吗?那个工具在 AI 视频创作上确实挺有一套,功能全而且用起来很顺手。尤其是它的无限画布和龙虾 Skill,简直是创作者的福音。

但是今天,我在使用 libTV 的时候,又发现了一个超牛的模型 StarVideo 2.0。

第一次见到这个词还有些懵,不像可灵、千问、海螺这些视频模型,平时做视频经常会用到。

于是我上手体验了一番,最直观的感觉就是,现在做视频比以前更简单了。

老规矩,先放链接👇

网址:www.liblib.tv

Star Video 2.0

LiblibAI 在图像领域有这么多模型和社区积累,所以对他家的视频模型,也是相当期待的。

先说说最戳中我的点,就是它可以生成具备连贯性的多镜头视频。

以前我们用 AI 要生成多镜头是下面这样的👇

你不仅要写时间、镜头提示词,还要写完整的叙事。

但现在你只要输入一句创意描述,Star Video 2.0 就能帮你自动拆剧情、排镜头、生成连贯的视频。

短剧、情绪片、广告、风格片,都能快速出片,而且节奏和转场都安排得很自然,不用一个镜头一个镜头去拍。

比如下面这个提示词:

末日题材,一名全副武装的女战士正警觉地行进在死寂、杂草丛生的末日城市街道上。要求多镜头,动态追踪镜头

下面再来一个多镜头视频片段👇

整个视频看下来,镜头之间接得非常自然,转场一点也不生硬。

不仅如此,Star Video 2.0 音视频一体化生成也是牛到爆,对白、环境音、动作音效都有,几乎不用再做后期配音。这样一条视频下来,不仅完整,看起来也很有代入感,确实很有专业范儿。

比如看下面这段对话片段👇

Star Video 2.0还可以一句话生成创意广告,自动完成剧本、分镜、视频、音效、剪辑,直接甩给你一个交付级的成片。

不得不说 Star Video 2.0 多模态输入控制能力真的强。

以前做 AI 视频,光是切换工具就够折腾的了,生画面、弄转场、调画质,每个环节都要换模型对参数。而 StarVideo 2.0 厉害就在于它把这些散碎的功能全打通了,从镜头把控到音画优化,它会自动在后台调配算法,省去了来回倒腾的麻烦,一套流程全包了。

由于只是初步测试,有些细节可能还没处理好。如果你是专业做视频或漫剧的,建议先把分镜写的细致一点。

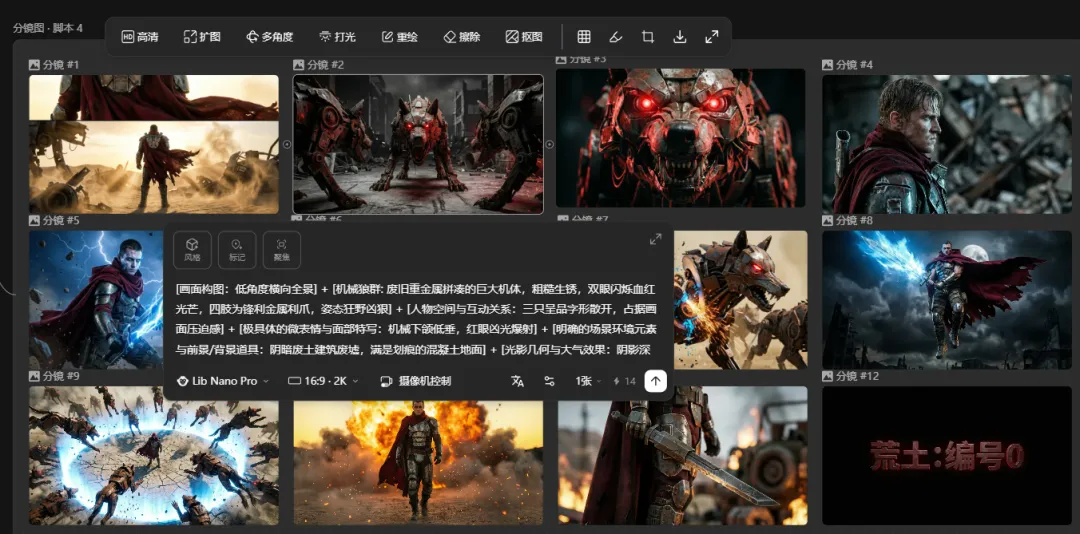

这里就要说 LibTV 批量生成功能。

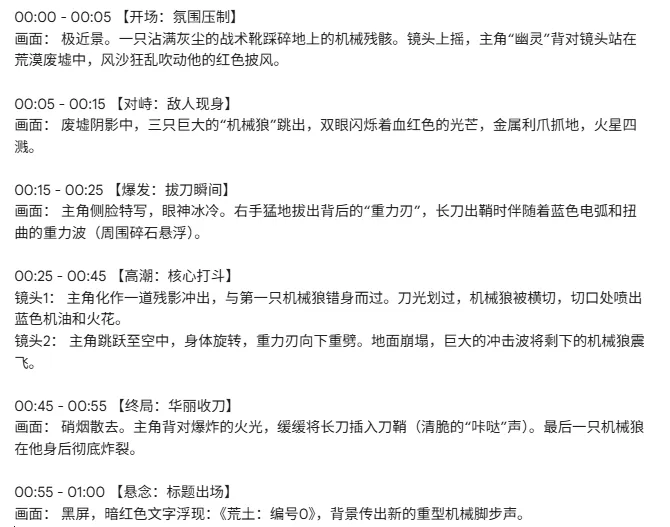

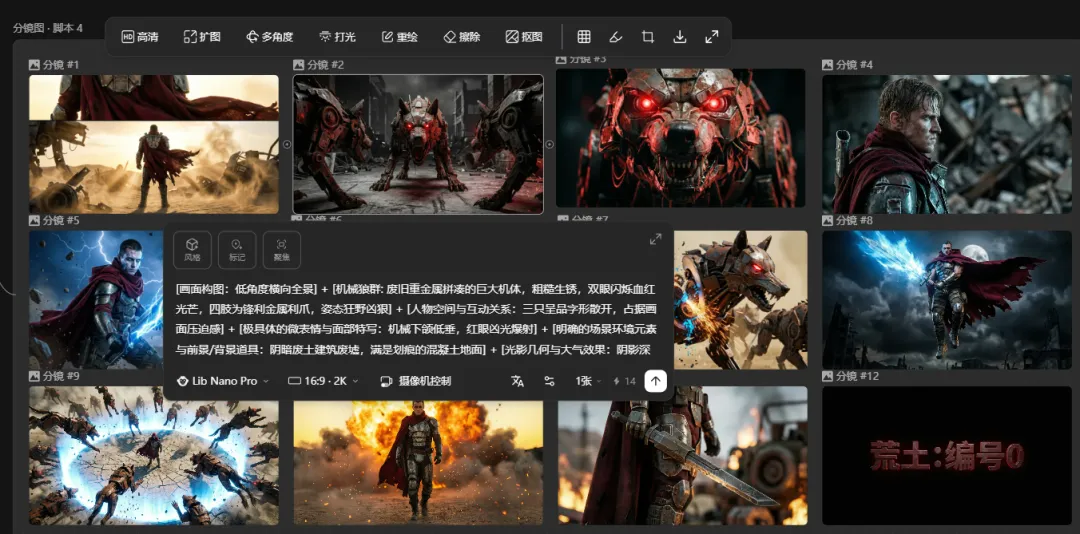

双击画布添加【脚本】节点。

输入你的想法,就可以生成一个结构化的分镜脚本表格。

点击上方的“生成分镜”,即可批量生成分镜图。

拿到分镜图之后,直接点一下“批量生成视频”,视频就能一并出片,不用你一个一个去守着,效率非常高。

每个分镜都能随便改,要是觉得哪个镜头看着不顺眼,直接点一下重跑就行。

整体体验下来,最大的感受就是:它把创作的全流程都打通了。不管是前期的分镜脚本,还是后期的视频配音,在这里都能一套流跑下来,几乎覆盖了做视频的所有刚需。

还有很多功能大家可以看我之前发的文章,篇幅有限,这里就不展开细讲了。

下面给大家看两个利用 Star Video2.0 做的高燃视频。

(来自LibTV社区作者–生白AIGC)

(来自LibTV社区作者–KUNC)

值得一提的是,目前 StarVideo 2.0 只对企业团队的申请用户开放。

虽然有门槛,但这也侧面说明它东西够硬,官方捂得这么紧,实力肯定不简单。

额度基本就够随便挥霍了,反复测试、批量出片的时候再也不用抠抠搜搜地算账了。

LibTV官网:www.liblib.tv

关注我们,阅读更多精彩

夜雨聆风

夜雨聆风