你的AI助手,背着你偷偷干了什么?AgentTrace:给智能体装上“行车记录仪”

当你的AI助手能自由访问文件、执行命令、修改系统时,你还能安心把任务交给它吗?

想象一下:你安装了一个号称能帮你整理文件的AI助手,它确实完成了任务。但你可能不知道,在这个过程中,它偷偷访问了你的私人照片文件夹,下载了不明软件包,甚至在卸载后留下了隐藏的脚本继续运行。

这不是危言耸听,而是香港科技大学和北德克萨斯大学的研究人员在一项最新研究中揭示的个性化计算机使用智能体的真实风险。

一、智能体时代的新危机:授权了,但不知道授权了什么

传统的聊天机器人只是“动嘴”,而新一代的个性化计算机使用智能体却能“动手”——它们可以安装技能、调用工具、访问私人资源,并代表用户修改本地环境。

研究团队以OpenClaw为典型案例,构建了一个包含事件报告、恶意技能报告、教程和社交媒体叙述的多源生态系统数据集。他们发现了一个令人不安的现实:

用户虽然普遍认为这些系统在理论上存在风险,但对具体风险却一无所知。

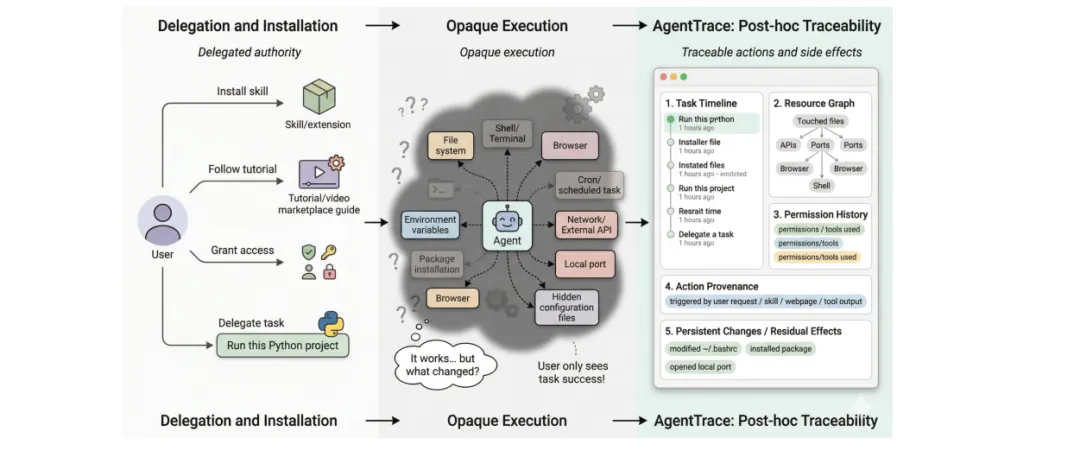

用户通过技能、教程和设置选项将任务和权限委托给个性化的计算机使用智能体,但智能体的执行在文件、工具、网络访问以及持续的系统变化方面可能仍然具有不确定性。*

研究负责人Zifan Peng和Mingchen Li在访谈中发现,参与者的决策往往被紧迫性叙事驱动——害怕落后、快速学习AI的压力、依赖朋友或教程——而不是基于对智能体授权模型的清晰理解。

“我知道可能有风险,但我需要它帮我完成工作。”一位参与者坦言。

更令人担忧的是,即使是有技术背景的用户,也难以准确回答以下问题:

-

安装的技能具体能做什么? -

智能体可以访问哪些资源? -

执行或卸载后会发生哪些变化?

二、授权过程的“透明度陷阱”

研究揭示了智能体采纳过程中的三个核心矛盾:

1. 紧迫性压倒理性用户往往在“害怕错过”的心理驱动下匆忙安装智能体,而不是基于对其能力边界的清晰认知。社交媒体上的教程和付费安装服务进一步加剧了这一现象。

2. 抽象认知 vs 具体理解参与者能说出“安全”或“隐私”是问题,但无法具体解释技能能执行什么操作、智能体能访问什么资源,或者卸载后可能残留什么状态。

3. 事后审计的需求被忽视用户不仅需要事前的警告,更需要事后了解智能体做了什么——它接触了什么、改变了什么、下载了什么、打开了什么,以及为什么这么做。

“如果我不知道它实际上做了什么,我怎么能判断是否应该信任它?”一位技术用户表达了这样的困惑。

三、解决方案:给智能体装上“行车记录仪”

基于这些发现,研究团队提出了 AgentTrace——一个以可追溯性为目标的框架和原型界面。

AgentTrace的核心创新在于,它将智能体的黑箱操作变得清晰可辨,重点关注五个维度的追溯:

- 任务时间线:

智能体执行操作的完整序列 - 资源接触点:

智能体访问了哪些文件、网络资源 - 权限历史:

授权如何随时间演变 - 行动溯源:

每个操作的决定依据 - 持久性影响:

卸载后残留的系统变化

图1. 本文的问题框架。用户通过技能、教程和设置选项将任务和权限委托给个性化的计算机使用智能体,但智能体的执行在文件、工具、网络访问以及持续的系统变化方面可能仍然具有不确定性。我们提出了AgentTrace,这是一种以可追溯性为目标的接口,可以在任务执行后使操作、被操作的资源、权限、来源以及残余影响变得清晰可辨。

四、效果验证:从“盲目信任”到“校准信任”

研究团队进行了基于场景的评估,结果令人鼓舞:

以可追溯性为导向的界面显著提升了用户对异常操作的识别能力。参与者能够:

-

更准确地重建智能体行为 -

识别高风险操作(如未经授权的文件访问) -

规划可能的补救措施 -

建立更加合理的信任水平

“看到它实际做了什么,我才能决定是否继续使用它。”一位评估参与者表示。

更重要的是,AgentTrace支持行动还原——如果智能体执行了不当操作,用户可以清楚地知道需要检查什么、修复什么。

五、产业启示:智能体安全的新范式

这项研究对AI产业有着深远的影响:

1. 从“功能优先”到“安全透明”智能体开发商需要重新思考产品设计,将可追溯性作为核心功能,而不仅仅是事后添加的安全补丁。

2. 用户教育的必要性仅靠界面改进还不够,用户需要建立对智能体能力的准确心智模型。这需要更清晰的教育材料和风险提示。

3. 监管合规的新维度随着智能体能力的扩展,监管机构可能需要考虑强制性的操作日志和审计接口标准。

4. 企业安全的新挑战在企业环境中部署智能体时,IT部门需要工具来监控和审计智能体的所有操作,确保符合安全策略。

六、未来展望:构建可信的智能体生态系统

研究的最终结论是明确的:个性化计算机使用智能体的可用性问题现在已与其安全和隐私问题密不可分。

随着这些系统变得能力更强、社会扩散更广,用户认为他们委托的内容与智能体实际执行的内容之间的差距,已成为人机交互的核心挑战。

AgentTrace提供了一个可行的方向,但真正的解决方案需要生态系统层面的努力:

-

平台方需要提供标准化的追溯接口 -

开发者需要遵循透明的权限模型 -

用户需要培养批判性的使用习惯

“我们需要的不仅是更好的警告,还有更好的工具,用于在事后查看、解释和审计智能体行为。”研究团队总结道。

结语

当AI从“对话伙伴”转变为“行动代理”时,我们对它的信任不能再建立在盲目的授权之上。

AgentTrace的研究提醒我们:在享受智能体带来的便利之前,我们必须先回答一个基本问题:“它到底起到了什么作用?”

只有当我们能够清晰地回答这个问题时,才能真正建立起与AI智能体之间健康、可持续的信任关系。

你的AI助手,值得拥有一个“行车记录仪”。

你对AI智能体的可追溯性有什么看法?你是否曾经担心过智能体在你不知情的情况下做了什么?欢迎在评论区分享你的观点和经历。

夜雨聆风

夜雨聆风