AI芯片“分工”时代开启:谷歌双芯出击,全面挑战英伟达霸权

2026年4月,在拉斯维加斯举行的Google Cloud Next大会上,谷歌正式发布了其第八代张量处理单元(TPU)的两款专用芯片:TPU 8t(专为训练优化)与TPU 8i(专为推理优化)。这不仅是谷歌自研AI芯片的一次常规迭代,更是其战略路线的重大转向——首次将训练与推理两大核心任务拆分至独立的硬件架构。此举标志着AI计算正式进入“分工”时代,也吹响了谷歌向英伟达AI算力霸主地位发起全面挑战的号角。

一、 战略转向:从通用到专精,应对智能体时代新需求

谷歌此次发布双芯片,其核心逻辑源于AI应用范式的根本性变化。过去,生成式AI以“一问一答”的推理为主,计算负载相对统一。然而,随着AI智能体(Agent)的崛起,任务变得复杂、多步且需持续学习。这导致基础设施面临双重挑战:一方面,前沿模型的训练需要前所未有的算力规模和集群可靠性;另一方面,智能体交互要求极低的响应延迟和高并发处理能力。通用芯片难以同时满足这两种截然不同的需求。

谷歌高级副总裁阿明·瓦赫达特指出:“随着人工智能代理的兴起,我们认为,如果芯片能够根据训练和服务的需求进行个性化定制,那么整个社区将会受益。”因此,TPU 8t与TPU 8i应运而生,分别瞄准了计算密集型的模型训练和内存密集型的低延迟推理。

二、 技术深析:两款芯片如何各显神通

TPU 8t被设计为面向超大规模训练的“算力巨兽”。其目标是“将前沿模型开发周期从数月压缩至数周”。为实现此目标,它追求极致的规模和吞吐量。单个TPU 8t超级计算集群可扩展至9600颗芯片,通过全新的Virgo网络实现近百万芯片的近乎线性扩展,提供高达121 ExaFlops的算力。其芯片间带宽翻倍至19.2 Tb/s,并集成了复杂的可靠性设计,如光路交换(OCS)和实时故障绕行,旨在将有效训练时间维持在97%以上,这对动辄数月的万亿参数模型训练至关重要。

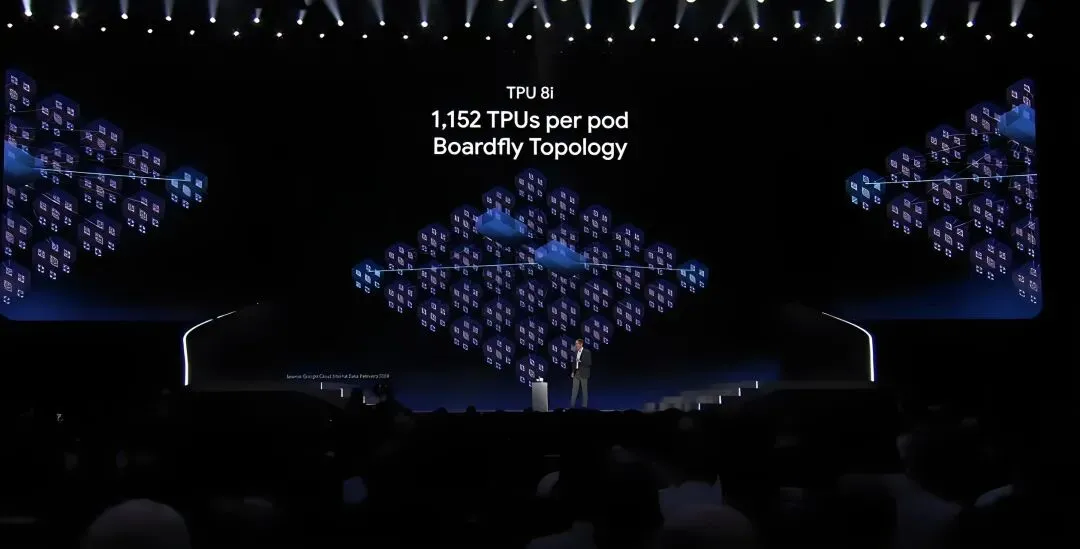

TPU 8i则是为智能体时代量身定制的“低延迟专家”。智能体复杂的多步工作流会放大任何微小的延迟。TPU 8i的核心创新在于突破“内存墙”:它集成了高达384MB的片上SRAM,是上一代的三倍,使得模型推理时的关键数据(如KV缓存)能完全驻留片上,极大减少了访问高延迟外部内存的次数。同时,其Boardfly网络拓扑将通信直径缩减50%以上,并配备专用的片上集体加速引擎(CAE)来卸载通信负载。谷歌称,这些创新使TPU 8i的每美元性能提升80%,意味着客户能以相同成本服务近两倍的请求。

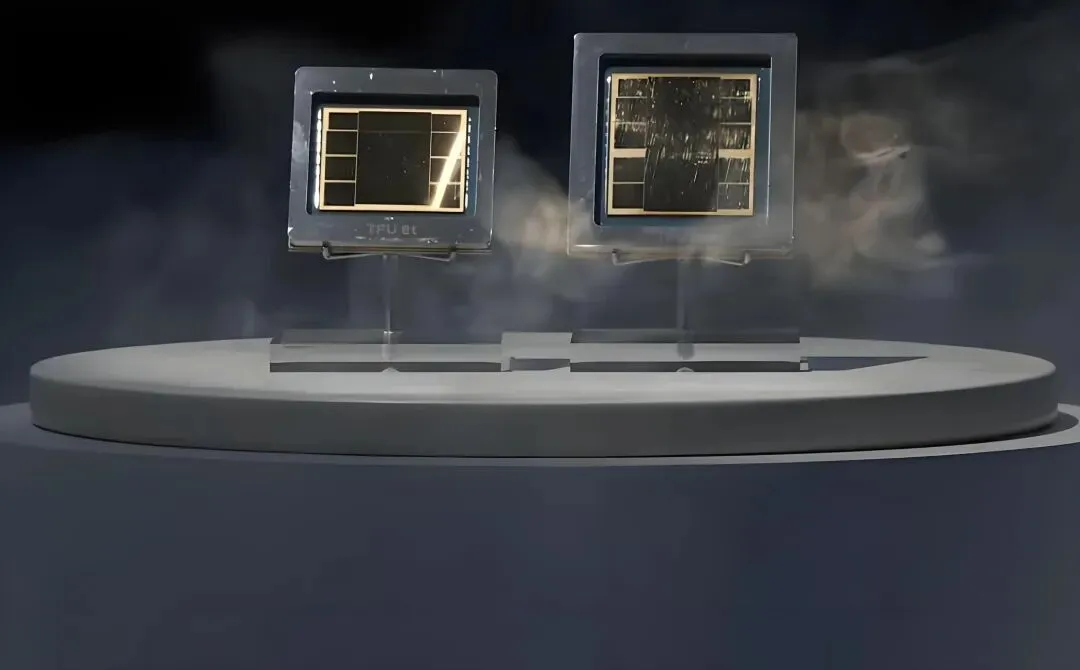

两者均采用谷歌第四代液冷技术,以应对近千瓦级的芯片功耗。更重要的是,它们首次运行在谷歌自研的基于Arm的Axion CPU上,实现了从主机到加速器的全栈协同优化,提升了整体系统能效。

三、 竞争全景:谷歌在“一超多强”市场中身处何位

谷歌并非唯一挑战者。全球科技巨头均已深入AI芯片战场,市场竞争格局呈现“一超多强”态势。

直面霸主英伟达:英伟达的护城河远不止单芯片性能,而在于其CUDA全栈生态。从训练到推理,从硬件到软件,英伟达提供了一站式解决方案。其最新产品如专攻推理的H200和全能旗舰B200/GB200,性能依然强悍。谷歌TPU的优势在于与自家云服务及软件栈(如JAX)的深度垂直整合,能在特定场景(如运行Gemini模型)下实现更优的能效和性价比。然而,其生态相对封闭,难以在谷歌云之外使用,这是其与英伟达竞争的最大短板。

应对开放生态挑战者AMD:AMD凭借MI300系列在绝对硬件性能上已逼近英伟达,并通过开源ROCm平台和性价比策略积极争取客户。其即将推出的MI455X搭载192GB HBM4,推理性能宣称超越H200。AMD路线与英伟达更相似,提供通用的加速器。谷歌则走的是云服务绑定、软硬一体的路径,两者竞争维度不同。AMD威胁的是英伟达的通用市场,而谷歌旨在巩固自身云生态。

与其他云巨头的“内战”:亚马逊AWS的Trainium(训练)和Inferentia(推理)芯片组合与谷歌路线最为相似,核心目标都是为自身云服务降本增效。微软也发布了自研的Maia AI芯片。这场“内战”的胜负,将取决于各云厂商的整体服务性价比、软件易用性和全球基础设施能力。

此外,报道显示谷歌正与芯片设计公司Marvell合作,开发内存处理单元(MPU)和新型推理TPU。这意在丰富其芯片矩阵,并降低对博通等单一供应商的依赖,同时针对英伟达GPU在推理场景的高成本发起更精准的打击。

四、 产业链共振与未来挑战

谷歌TPU的演进正深刻影响上游产业链。其芯片功耗(前代已近千瓦)使得液冷散热从可选项变为AI数据中心的硬性门槛,催生了巨大的温控系统需求。同时,为了喂养这些“算力巨兽”,800G/1.6T光模块、高端PCB以及HBM(高带宽内存) 的需求暴增。SK海力士宣布投资128亿美元建先进封装厂,正是为了应对HBM的爆炸性需求。

摩根士丹利的报告进一步指出,在智能体时代,CPU和内存的重要性急剧提升,因为任务调度和控制流处理占据了大部分执行时间。这印证了谷歌集成自研Axion CPU的战略眼光,也意味着AI算力竞争正从单一的GPU加速,演变为CPU、GPU/TPU、内存和互联技术的全系统较量。

展望未来,谷歌双芯发布标志着AI算力市场进入了专业化、多元化的新阶段。然而,挑战依然巨大:CUDA生态的粘性、自研芯片的持续巨额投入、以及如何在保持性能领先的同时扩大生态开放性,都是谷歌必须面对的课题。可以预见,未来市场将长期呈现“一超多强”的格局:英伟达凭借全栈生态保持领先;谷歌、亚马逊等云厂商通过自研芯片深化垂直整合;AMD则以开放硬件的角色争夺市场份额。谷歌的这次“分工”尝试,不仅是一次产品发布,更是对AI算力未来形态的一次重要宣言——没有单一架构能通吃一切,专精与融合将是通往AGI时代的必由之路。

夜雨聆风

夜雨聆风