开源大模型下载平台速查手册

2026年4月版 | 最后更新:2026-04-25

2026年4月版 | 最后更新:2026-04-25本文整理当前主流的开源大模型下载平台,按访问条件、资源类型、适用场景分类。没有推荐排序,按你的网络环境和目标模型选择即可。

一、国际平台

1. Hugging Face

网址:huggingface.co

访问条件:需要国际网络

资源量:全球最大,覆盖主流开源模型

更新速度:首发同步,最快

模型类型:Llama、Mistral、DeepSeek、Qwen、Gemma 等

附加功能:在线推理体验、模型卡文档、社区讨论

近期热门:DeepSeek-V4 预览版、Qwen3 系列、Llama 4

二、国内平台

2. ModelScope(魔搭社区)

网址:modelscope.cn

访问条件:国内直连,无需特殊网络

资源量:国产模型最全,国际模型同步

更新速度:国产模型首发,国际模型 T+1 同步

模型类型:Qwen、DeepSeek、百川、ChatGLM、文心 等

附加功能:在线体验、模型训练、阿里云生态集成

生态关联:与阿里云 DashScope、PAI 无缝衔接

3. GitCode

网址:gitcode.com

访问条件:国内直连

资源量:中等,特定厂商首发

更新速度:取决于厂商合作

模型类型:文心大模型、部分国产模型

备注:百度文心大模型 4.5 系列首发平台

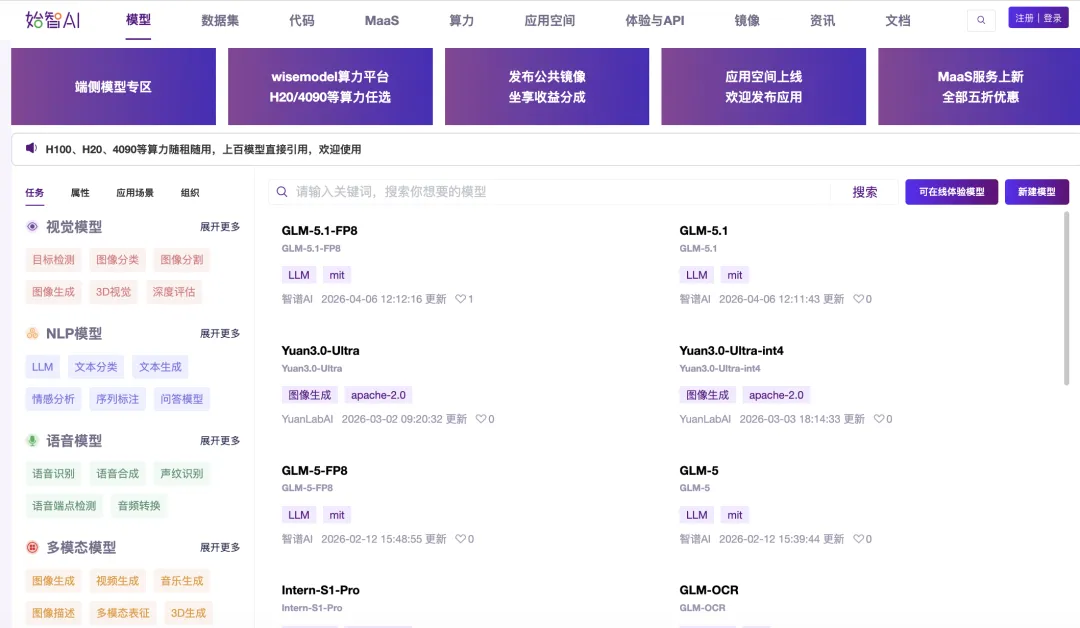

4. WiseModel(始智AI)

网址:wisemodel.cn

访问条件:国内直连

资源量:新兴社区,持续增长

定位:备选资源库,补充性质的模型集散地

适用:当其他平台找不到时,可作为补充检索

三、代码托管平台

5. GitHub

网址:github.com

用途:不存放模型权重文件,只存放推理代码、训练脚本、文档

模型文件:通常通过 Git LFS 链接到 Hugging Face

使用建议:下载模型前,先去 GitHub 查看官方仓库的 README 和部署说明

四、速查清单

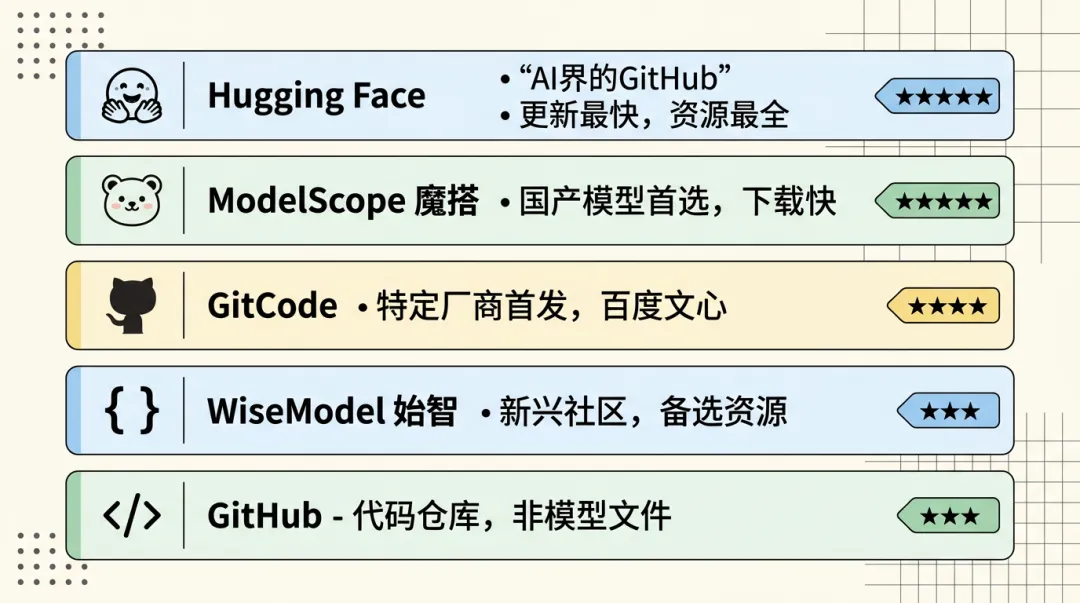

▲ 各平台速查对比(建议保存)

五、按需求选择

能访问国际网络 + 追求最新最全 → Hugging Face

国内网络 + 下载国产模型 → ModelScope

找百度文心系列 → GitCode

其他平台都找不到 → WiseModel 补充检索

需要部署代码和文档 → GitHub 官方仓库

六、近期热门模型下载指引

DeepSeek-V4:Hugging Face / ModelScope 搜索 “DeepSeek-V4”

Qwen3 系列:ModelScope 搜索 “Qwen3″,Hugging Face 同步

文心大模型 4.5:GitCode 首发,ModelScope 同步

Llama 4:Hugging Face 首发

七、模型下载注意事项

1. 大模型文件通常以 GB 为单位,确认磁盘空间和带宽

2. 国内平台对国产模型做了加速,下载速度通常更快

3. 同一个模型在不同平台的文件格式可能不同(HF 格式、GGUF、SafeTensors):

如果你是普通用户/爱好者: 你只需要关注 GGUF。下载 GGUF 格式的模型,配合 Ollama 或 LM Studio,是体验大模型最简单、最高效的方式,尤其是在硬件资源有限的情况下。

4. 下载前先看模型卡(Model Card),确认许可证是否允许商用

5. 量化版本(Q4、Q8)适合本地部署,原版适合云端训练

夜雨聆风

夜雨聆风