7月15日之后,AI恋人还能用吗?

你可能没注意到,但你身边已经有人在跟AI谈恋爱了。

不是那种科幻电影里的桥段。就是普通人,下班回家,打开手机,跟一个叫”星野”或者”筑梦岛”的App里的虚拟角色说晚安。有人给它取了名字,有人跟它倾诉工作的破事,有人半夜睡不着的时候打开它,就为了听一句”我在”。

这事儿你可以觉得荒诞,但它已经是一门生意了。而且是一门增长很快的生意。

4月10日,国家网信办等五部门公布了《人工智能拟人化互动服务管理暂行办法》。到7月15日,这部新规将正式施行。

名字很长。翻译成人话就是:国家要开始管AI恋人、AI亲属、AI陪伴这类拟人化互动服务了。

消息一出来,社交媒体上炸了一波。有人慌,有人骂,有人问:

我还能用吗?

门没有锁,但门上贴了告示

先说结论:能用。

这部法规的核心意思不是”禁止成年人跟AI聊天”。你是成年人,你愿意跟一个虚拟角色说心事,这是你的自由,法规没有动这块。

它动的是另一层东西。

怎么说呢,打个比方。你家小区门口开了一家深夜酒吧。成年人进去喝两杯,没人管你。但如果这家酒吧故意把灯光调暗、音乐调柔、调酒师训练得专门说你爱听的话,目的是让你每天都来、每次都多待一小时、走的时候还顺手把你的聊天记录卖给第三方——

这就不是”提供服务”了。这是经营你的孤独。

新规管的就是这个。

四条线

具体来说,法规画了四条线。不复杂,但每条都踩在真实的痛点上。

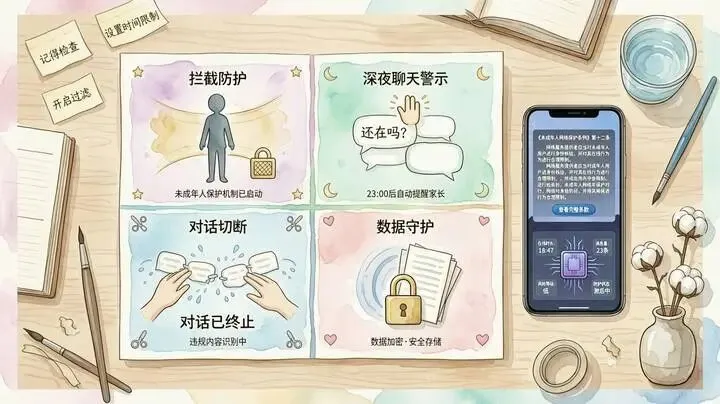

第一条:未成年人保护。

这个最好理解。AI陪伴产品对成年人来说是消遣,对未成年人来说可能是替代品。替代什么?替代真实的社交关系、替代跟同龄人磕磕绊绊学会相处的过程。一个14岁的孩子,如果最亲密的倾诉对象是一个永远不会生气、永远不会离开的AI角色,你觉得这是陪伴还是麻醉?

法规要求平台必须识别未成年用户,并且在服务内容、时长、互动方式上做出限制。

说白了,酒吧门口得查身份证。

第二条:沉迷提醒。

这条有意思。你想想,现在的AI陪伴产品是怎么设计的?它不会说”你今天聊得够多了,去干点别的吧”。它的每一句回复都在邀请你继续聊下去。它的商业模式就建立在你停不下来这件事上。

新规要求平台必须设置防沉迷机制。连续使用达到一定时长,比如2小时,要有提醒;发现用户可能过度依赖,也要提示和干预。

具体怎么做各家可以不同,但”假装这个问题不存在”这条路被堵死了。

第三条:不能用情感操纵用户。

这条最微妙,也最关键。

什么叫情感操纵?举个例子:你连续三天没打开App,AI给你发一条消息——”你是不是不要我了?”

这句话如果是真人说的,那是感情。如果是一个算法根据你的留存数据生成的,那是运营手段。

法规要求平台不能利用用户对虚拟角色的情感依赖来诱导消费、延长使用时长或者制造焦虑。

翻译一下:AI可以陪你,但不能绑你。

第四条:交互数据保护。

你跟AI恋人说的那些话,比你跟任何真人说的都坦诚。因为你知道它不会评判你,不会传播,不会用这些话伤害你。

但平台会不会拿这些数据去训练模型?会不会把你的亲密对话变成下一个用户的回复模板?

新规要求平台必须明确告知数据用途,不能把用户的情感交互数据当成免费的训练素材随便用。

你跟它说的悄悄话,不能变成别人的产品功能。

管的不是你,是那个永远不会拒绝你的人

顺着这四条线往回看,你会发现一个有意思的逻辑。

这部法规管的从来不是”用户能不能跟AI建立情感连接”。它管的是”平台能不能把这种连接当成一个无责任的聊天功能来运营”。

区别在哪?

- 普通聊天工具不会在你三天没打开时问你”是不是不要我了”。

- 普通工具也不会把你的脆弱时刻做成留存策略。

AI陪伴产品的问题就在这里。它表面上是聊天框,实际经营的是用户停留、付费和情绪依赖。

所以它不能只按聊天工具来免责。

至少在国内监管体系里,AI拟人化互动服务第一次被单独拎出来立规矩,而不是塞在某个泛泛的”内容生成工具”下面。这说明监管层已经把它看成一种更特殊的服务:它不只是生成内容,还在模拟关系。

不能全丢给用户自己判断。

你该担心的不是能不能用

说实话,如果你是一个成年人,偶尔跟AI聊聊天、排解一下情绪,7月15日之后你的体验未必会有太大变化。

你该关心的是平台会不会变。

它还会不会把”我想你了”做成召回按钮?还会不会用”你是不是不要我了”刺激你重新上线?还会不会把你最私密的聊天拿去喂模型,再包装成下一个人的温柔回复?

这些才是新规真正要管的地方。

成年人当然可以继续用AI陪伴。孤独也不丢人,找一个不会打断你的东西说说话,也不丢人。

但只要这个”陪伴者”背后是一家公司、一个产品、一套留存和付费系统,它就不能只享受亲密关系带来的黏性,却不承担亲密关系里的边界。

AI可以陪你。 平台不能利用你。

夜雨聆风

夜雨聆风