深度分析AI智能体(Agentic),能进入汽车座舱么?

目前AI领域最火的莫过于Agentic,自ChatGPT震撼登场,AI领域经历了几代重大演变,最终变成今天Agentic,AI也得以进入千家万户,实实在在为普通人服务。

第一代(2022年底):被动响应。以 ChatGPT 为代表,依赖提示词工程(Prompt Engineering),本质是“静态百科全书”,无法感知实时世界且缺乏行动能力。

第二代(2023年中):工具觉醒。引入 Function Calling (允许模型调用外部API)和 RAG 技术(增强外部知识检索,虽 2020 年提出,但 2023 年广泛应用),赋予 AI “执行四肢”与外部实时信息增强。AutoGPT 是早期代理尝试,但确实因无限循环和缺乏可靠规划而效率低(常被称为“hallucination-prone”)。

第三代(2023年底):工程化编排Orchestration。确立 ReAct 推理框架,推广多智能体协作模式。Coze、Dify 等低代码平台降低了开发门槛,强调流程的可控性。这代强调从混乱自治到工程化,如通过DAG(有向无环图)避免AutoGPT的低效。

第四代(2024年底):标准化与多模态。MCP 协议(Model Context Protocol)终结了集成碎片化,Computer Use 允许 Agent 通过屏幕、鼠标、键盘交互图形界面(多模态扩展)。Cursor 等 AI 编程工具推动了“Vibe Coding”(氛围编程,使用 AI 根据自然语言提示生成功能代码)。

第五代(2025年底):常驻自治。核心是 Agent Skills 技能封装和 Heartbeat 心跳机制(OpenClaw、Moltbook等普及),使 Agent 成为 24 小时后台运行、具备本地数据主权的“数字实体”。

Agentic AI很可能成为具身智能的大脑,汽车座舱的核心功能。

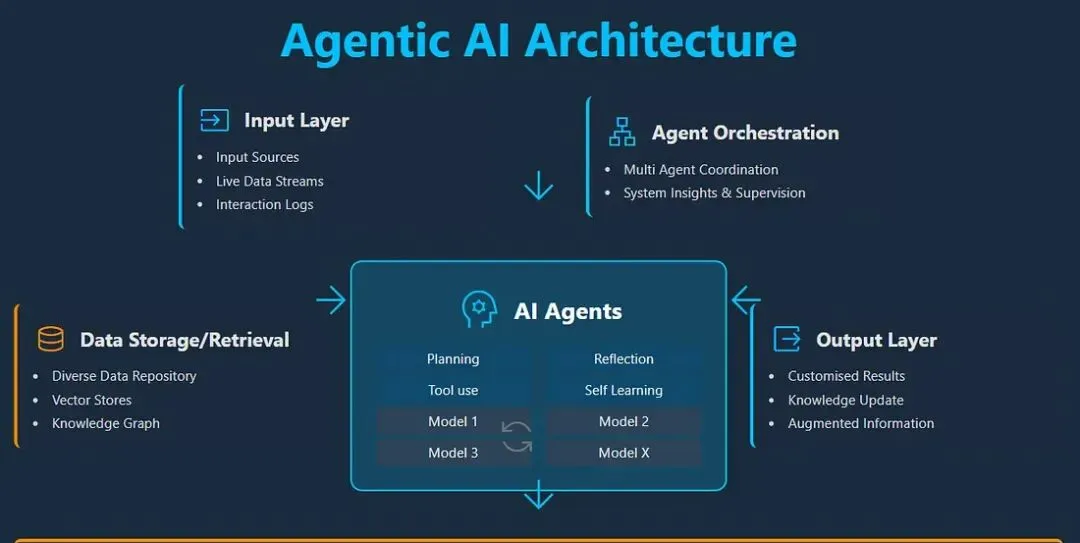

Agentic AI简单架构

图片来源:网络

Agentic AI是一种能够感知环境、进行决策并执行动作的自主软件系统。它以大语言模型(LLM)为大脑,代表用户自动化完成复杂任务,例如自动化处理电子邮件、生成报告、执行多步查询或控制智能设备。

-

(1)推理引擎,推理引擎是Agent的“大脑”,通常基于多模态大模型实现。它负责理解用户意图、制定执行计划、任务执行。在开发层面需要精心设计提示词模板、优化推理链路、控制推理成本。推理引擎的质量直接决定了Agent的智能水平。

-

(2)记忆系统,记忆系统赋予Agent“学习”和“成长”的能力。可以简单分为短期记忆和长期记忆两个大类:短期记忆维护当前会话的上下文状态,类似于人类的工作记忆;长期记忆存储用户偏好、历史交互、知识积累等信息,需要智能的信息抽取和压缩机制。在开发实践中需要设计合理的存储架构、实现高效的检索算法、建立智能的信息更新策略。

-

(3)编排模块,规划与执行模块负责协调其他三个组件的工作,管理Agent的整体执行流程。它承担任务分解、执行计划制定、工具调用编排等职责。在开发层面,这涉及到工作流设计、异常处理策略、并发控制、状态管理等技术挑战。不同的Agent框架对这一模块有不同的实现方式,如Strands Agents的任务编排器、LangGraph的图执行器等。

-

(4)工具接口,工具接口是Agent与外部世界交互的“手脚”。一个Agent可能需要调用数十种不同的API、数据库、外部服务。开发挑战在于:如何标准化不同工具的接入方式、如何实现工具的智能选择和组合、如何处理工具调用的异常和重试、如何确保工具调用的安全性和权限控制。

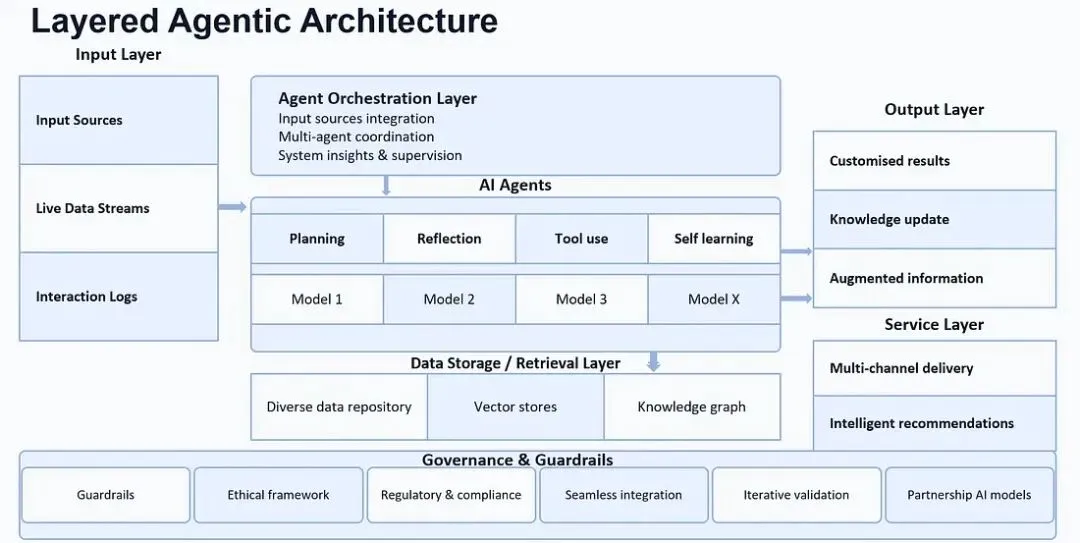

Agentic分层架构

图片来源:网络

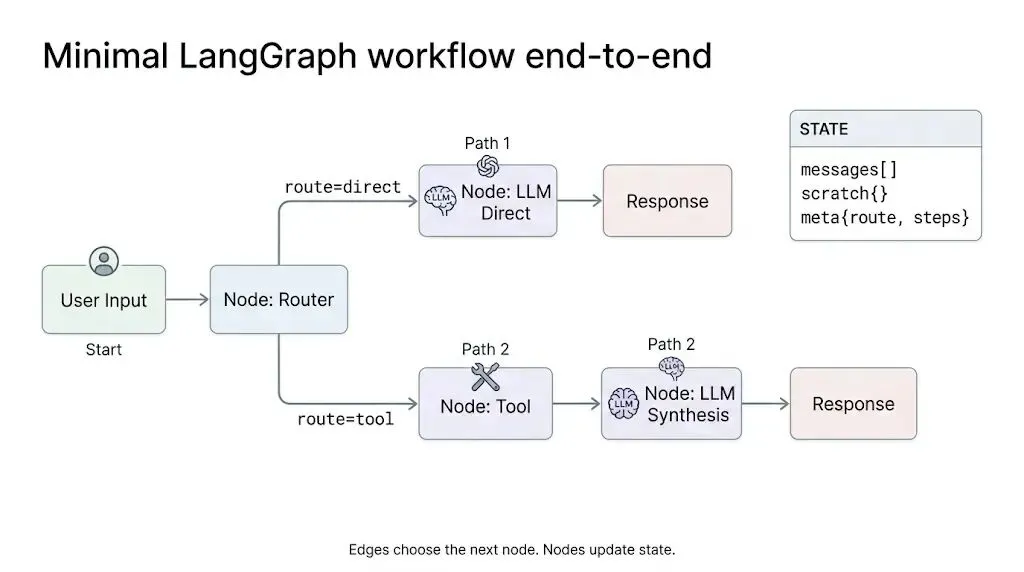

这当中要着重讲一下编排层中的LangGraph,LangGraph 是由 LangChain 团队推出的一个用于构建有状态、多智能体应用程序的强大库。它扩展了 LangChain Expression Language (LCEL) 的能力,通过引入图(Graph)计算模型,完美解决了传统 LLM 应用在复杂逻辑处理中的瓶颈。

LangGraph 的核心优势在于其能够轻松定义具有循环(Cycles)和持久性状态(State Persistence)的工作流,这使得它非常适合开发需要多轮推理、自我反思(Reflection)以及多智能体协同工作的复杂 Agent 系统。相比于线性的工作流编排,LangGraph 允许开发者以节点(Nodes)和边(Edges)的形式直观地定义智能体的行为路径和决策条件,从而实现更高自由度与可控性的应用架构。全球目前90%的AI智能体开发都是基于LangGraph,它是Agent最核心的技术。

图片来源:网络

LangGraph将AI Workload换成直观导航地图,并化身导航员,用户是“制图师”。导航员在“超级地图”上绘制出各点之间的最佳路线,而所有这些路线都是由“制图师”绘制的。

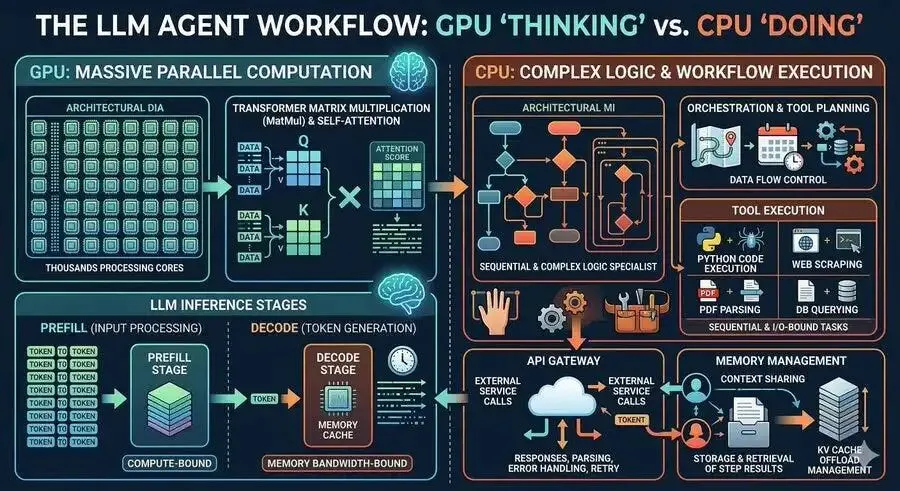

编排层是AI智能体的调度中心,是中枢神经,完全由CPU负责,而LLM的推理像一个人的四肢,由GPU/NPU负责执行,GPU是一个完全被动的device,接受来自CPU的命令和存储传送过来的数据,执行推理,再返回存储系统,然后最终输出。

Agent 的本质是运行在一个具备操作系统能力的云端沙盒计算环境中。Agent的能力跃迁,并非来自在 GPU 上堆叠更多 token 进行推理,而是来自调用外部系统(浏览器、文件系统、终端、网络)完成真实世界任务。在成熟 Agent 架构中,GPU只是被操作系统调度的加速器,Agent 的“身体”是一台完整的云端计算机。主流 Agent 架构为每个 Agent 配备一台云端电脑,Agent 并非直接运行在 GPU Kernel 上,而是运行在具备完整操作系统能力的云端计算环境中。多 Agent 系统需要完成网页浏览、文件搜索、终端命令等复杂任务,因此需要一台完整的云端电脑。包括 Mistral、Perplexity、HuggingFace、LMArena、Gumloop 、爱马仕等在内的 Agent 系统,也均采用“每个 Agent 配一台云端电脑”的架构范式。

Agent 运行在沙盒化的通用计算机环境中,这一执行形态决定了其工作负载天然呈现高度分支化与强控制流特征。龙虾或Manus为每个 Agent 任务分配一个隔离的云端虚拟机,不同任务在逻辑上高度异构(如网页浏览、代码修改、环境部署等),任务之间可并行但控制流完全不同。

图片来源:网络

分支类任务不适合由 GPU/NPU 执行,控制流发散导致算力利用率急剧下降。英伟达在其 CUDA 官方文档中明确指出,GPU 采用 SIMT 执行模型:线程以 32 个为一组(warp),在同一周期内执行同一条指令。一旦同一 warp 内线程进入不同分支路径(Warp Divergence),GPU 会将不同分支串行执行,不属于当前分支的线程被 mask 掉,直接导致吞吐下降。实验结果显示,即便是有限程度的分支发散,也会显著拉长执行时间。在32路完全发散的极端情况下,性能下降可达27-125倍,等效算力利用率仅剩个位数百分比。因此,分支类任务不适合由 GPU 执行,是 GPU 编程中需要避免的情形。

CPU 为复杂控制流而生,天然适配 Agent 的执行特征。CPU属于典型 MIMD 架构:每个核心拥有独立的程序计数器、指令缓存与解码逻辑;不同核心可完全独立执行不同控制流。微架构层面,CPU 专门为复杂逻辑分支进行了长期演进:真实通用程序中,平均每 5–7 条指令就包含一次条件分支;若要维持性能,分支预测准确率需达到 95%+;现代 CPU 通过复杂分支预测器(如 TAGE、感知器)、乱序执行、重排序缓冲区(ROB)等机制,在通用代码中可实现 1–2.5 IPC 的稳定吞吐。因此,Agent 的“行动”阶段本质是大量 if/else 判断、系统调用与串行决策,正是 CPU 微架构长期优化的主战场。

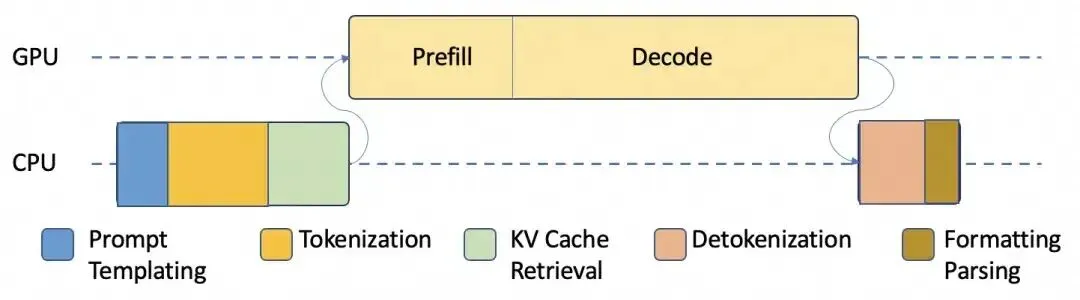

最初级的AI聊天机器人的运行负载分布

上图是最初级的AI聊天机器人的运行负载分布。

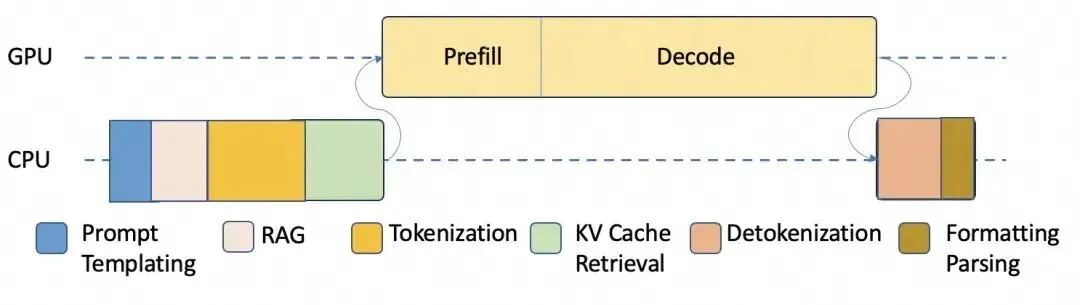

AI智能体的简化运行负载分布

AI智能体的简化运行负载分布(上图),RAG是标配,RAG完全依赖CPU,和GPU/NPU完全无关,也是AI智能体的主要延迟来源之一。

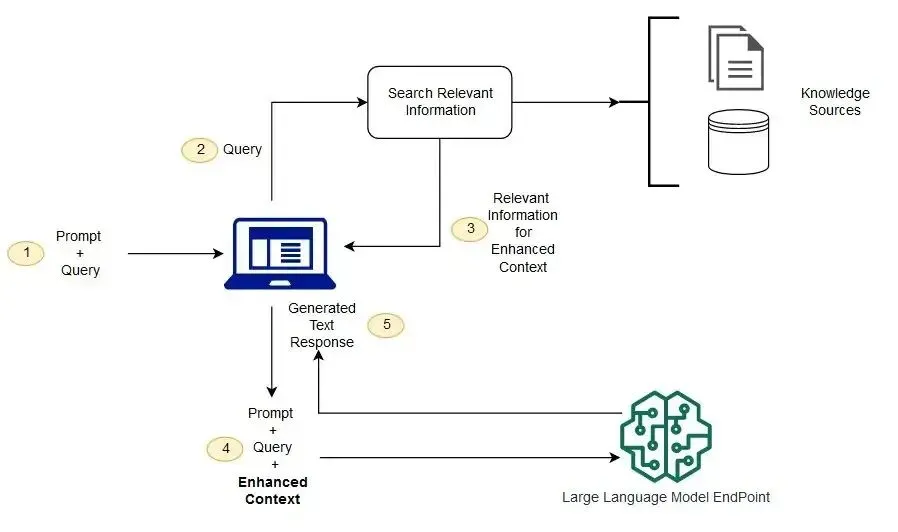

RAG流程

图片来源:网络

大语言模型(LLMs)虽强大,但本质上只是“静态知识+语言模式”的结合,一旦问题超出训练语料,常出现如下问题:无法及时更新信息:回答不了最新新闻、政策;专业领域知识薄弱:如医学、法律问答易出错;事实幻觉严重:引用不存在的论文、伪造数据;推理链条缺失:无法支撑合规审核或逻辑验证。RAG(Retrieval-Augmented Generation) 正是为解决这些问题而生,通过引入外部实时检索机制,极大提升了生成内容的准确性与时效性。

RAG 的核心机制包括:Retrieval (R) 检索: 从外部源、数据库或知识库中搜索相关数据。目标是收集特定、准确和相关的信息,以支持或增强AI对特定主题或查询的理解。Augmentation (A) 增强: 在此阶段,检索到的数据被添加到提示(prompt)上下文中。这意味着信息被集成或结合到提供给AI的输入中,有效地丰富其知识库,以实现更好的推理和上下文感知响应。Generation (G) 生成:最后,LLM 使用增强的上下文生成输出。

RAG 通过以下三个步骤来实现:文本向量化(Embedding):模型使用一个特定的神经网络(Encoder)将一段文本 T 映射为一个高维实数向量(比如,768 或 1536 维)。在这个高维空间,语义相似的文本在几何距离上也更接近。

相似度度量(Similarity Metrics):RAG 对应的数据库为向量数据库,它通过计算查询向量 Q(Query)与库中向量 D(Document)之间的几何关系来判定相关性。最常用的两种数学度量是:a. 余弦相似度(Cosine Similarity):它衡量的是两个向量在方向上的夹角。在语义搜索中,向量的方向比长度(文本长短)更能代表含义。b. 欧几里得距离(L2 Distance):, 衡量两点之间的绝对空间距离。

最邻近搜索 (NNS, Nearest Neighbor Search) :是在多维空间中寻找与查询点距离最近的点的优化问题。它是数据检索、机器学习和模式识别的核心技术,常用于查找相似数据。针对大规模高维数据,通常使用牺牲少许精度以大幅提升查询速度的近似最邻近搜索 (ANN),常用算法包括树结构(如kd-tree)、图结构(如HNSW)和量化技术。

这三个步骤通常都是由CPU负责计算,NPU和负责矩阵计算的GPU毫无作用。

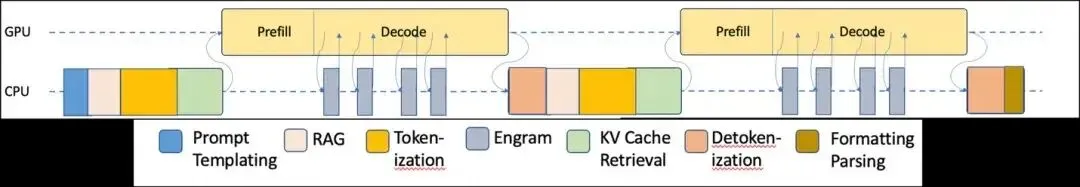

DeepSeek升级RAG为Engram,复杂原理在此不赘述,只需要知道CPU的工作量又增加了,分支更多,中断更多。

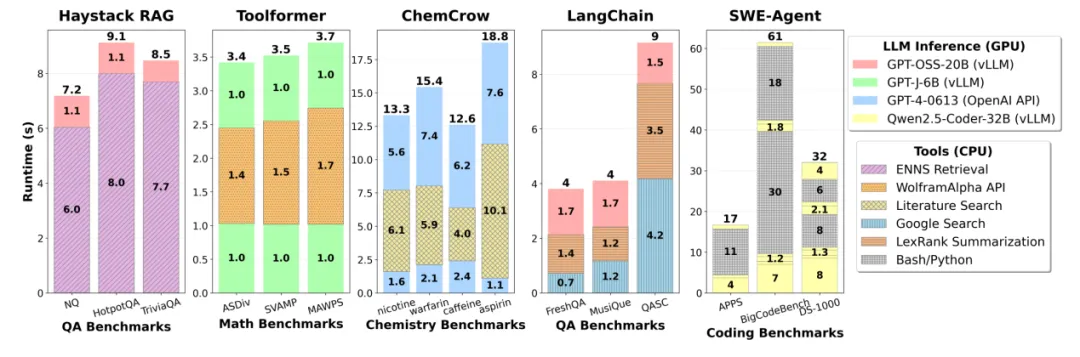

AI智能体运行时间分析

图片来源:论文《A CPU-centric Perspective on Agentic AI》

如果我们把智能体的工具调用,代码执行等任务执行时间也算上,CPU 侧的延时甚至会成为影响系统性能的关键,比如,在 SWE-Agent 中,CPU 执行的 Bash/Python 调用占延迟可达 78.7%,再有如Haystack中,邻近搜索都是由CPU负责,占了总延迟的90%左右,GPU/NPU已经无足轻重。

除了CPU很重要,存储也很重要,Agent 不只是跑模型,它还要挂知识库、历史记忆、工具环境和上下文。无论是 RAG 还是类似 Engram 这样的条件记忆模块,本质上都在拉高对内存容量、内存带宽和分层存储架构的要求。系统的RAM容量至少要是适配本地大模型容量的4-6倍,如谷歌的Gemma E4B,8比特精度下要9-12GB容量,系统的整体容量至少要36GB-72GB,这将导致成本暴增。

另一个是存储带宽,这点苹果优势明显,2023年的M2 Ultra的存储带宽高达800GB/s,而特斯拉即将上市的AI5其存储带宽也不过是819GB/s,还要到2027年初才能量产,不过绝大部分厂家还在为136GB/s的存储带宽沾沾自喜,这中间主要是成本因素。

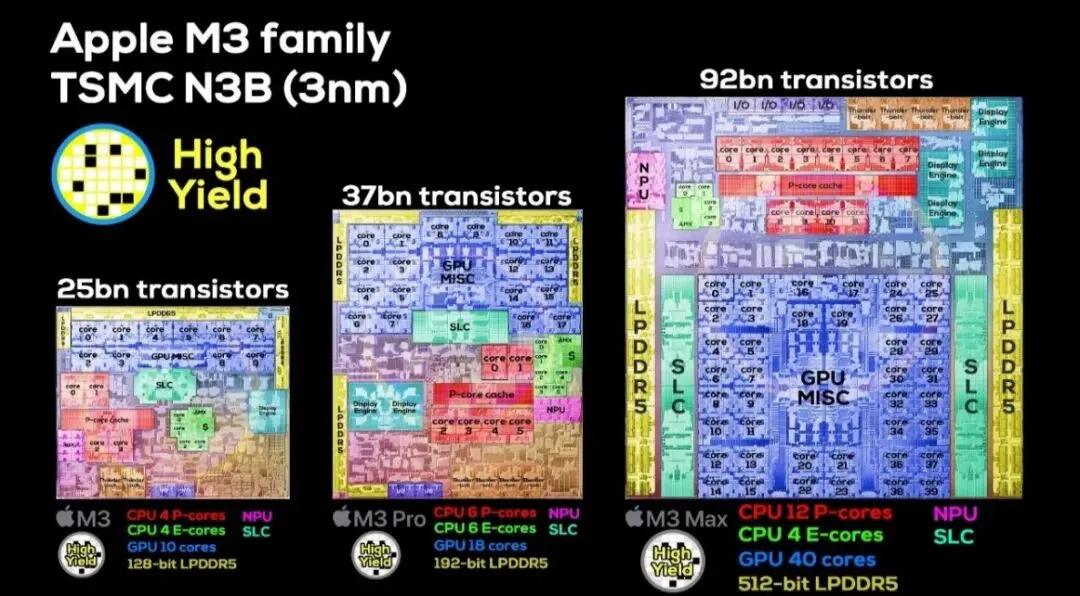

苹果M3系列芯片对比

图片来源:网络

M3 Max的存储带宽是400GB/s,M3 Pro是150GB/s,实际就是LPDDR5内存控制的die size(存储位宽)决定存储带宽,而die size与芯片硬件成本是1:1的正比例。M3 Max虽然存储带宽比高了2倍多,但die size面积增加了不止两倍多。存储控制器通常采用数字模拟混合信号设计 (Mixed-Signal Design),将高速的物理层(PHY,模拟部分)与逻辑控制层(Controller,数字部分)集成在同一芯片或封装中。混合信号的晶体管密度远低于纯逻辑电路,厂家如果用同样的die size做AI算力增强,数字会好看的多,更迎合普通人心理,更方便宣传,普通人根本不知道存储带宽的价值,只是简单认为TOPS数值越高越好,厂家自然也迎合消费者心态,这样还能降低成本,何乐而不为。

此外不仅是存储带宽,存储速率或者说频率也很重要,GDDR和HBM的带宽都远高于LPDDR,但其频率远低于LPDDR,所以在强调速度而非吞吐量的CPU一侧还是用LPDDR更高速率,在讲究吞吐量的GPU/NPU一侧用GDDR或HBM更好。

要想在汽车座舱里流畅养龙虾,需要大幅提高CPU算力,至少500K DMIPS以上,NPU算力只需要8位精度30-40TOPS就足够,LPDDR存储至少要有48GB,带宽至少有273GB/s。这将增加3000-4000元人民币的成本,恐怕大部分厂家都不愿意负担这个成本。具身智能倒是成本敏感度低,有可能首先引入AI智能体。

免责说明:本文观点和数据仅供参考,和实际情况可能存在偏差。本文不构成投资建议,文中所有观点、数据仅代表笔者立场,不具有任何指导、投资和决策意见。

更多报告

| AI机器人 | ||

|

AI机器人 |

||

| 云端和AI | ||

| 车云 | ||

| 动力层 | ||

| 动力 | 混合动力报告 | |

| 800-1000V高压平台 | 电驱动与动力域研究 | |

|

热管理 |

||

|

其他 |

| 电子电气架构层 | ||

| E/E架构框架 | E/E架构 | 汽车电子代工 |

| 48V低压供电网络 | ||

| 智驾域 | 自动驾驶SoC | |

| 座舱域 | 座舱域控 | |

| 车控域 | 车身(区)域控研究 | |

| 通信/网络域 | ||

|

|

||

| 跨域融合 | ||

| 其他芯片 |

|

|

| 车载存储芯片 |

| 智舱系统集成和应用层 | ||

|

智能座舱应用框架 |

|

座舱设计趋势 |

|

自动驾驶算法和系统 |

| OS和支撑层 | ||

| SDV框架 | SDV:软件定义汽车 | |

|

信息安全/功能安全 |

| 其他宏观 | ||

| 车型平台 | 车企模块化平台 | |

| 政策、标准、准入 | 智能辅助驾驶法规和汽车出海 |

「AI与机器人月报」

「联系方式」

手机号同微信号

产业研究部丨赵先生 18702148304

推广传播部|杜先生 13910162318

夜雨聆风

夜雨聆风