图片真的还是AI生成的?我做了个工具快速检测

,📌 省流

·给 AI 图片骗多了,做了个小应用检测图片是否是 AIGC 生成。

·AI生图一年内从画不对手指飞跃到以假乱真

·TrueSight:本地检测,不联网,拖图即出结果

· 测了接近 1w 多张图——AI 生图,我慌了。

你有没有转发过一张图,其实心里不太确定它是真的?

我有。不止一次。

转发一张图,最怕的就是假的。

体验过,不止一次。

你分辨得出来吗?

GPT-image-v2 灰测的时候,看见一张图说全量了,就直接转群里了。然后就发生了类似的一幕。

AI 生成的越来越逼真,真就是一个截图的样子,不去仔细核查根本不知道真假。

我盯了几秒——没发现哪里不太对。说不上来,就像真的一样。

以至于后续我发的一大堆图片,都有这样的一个场景。

现在大部分的人看到图片都直接应激了——真的假的?

一张图片能传播很多信息:仿造截图、通知……AI 生图越强,就越有那种「造谣一张嘴,辟谣跑断腿」的感觉。

不是你的错,也不是我的错。

是我们手上的工具,和眼前的世界之间,出现了一道裂缝。

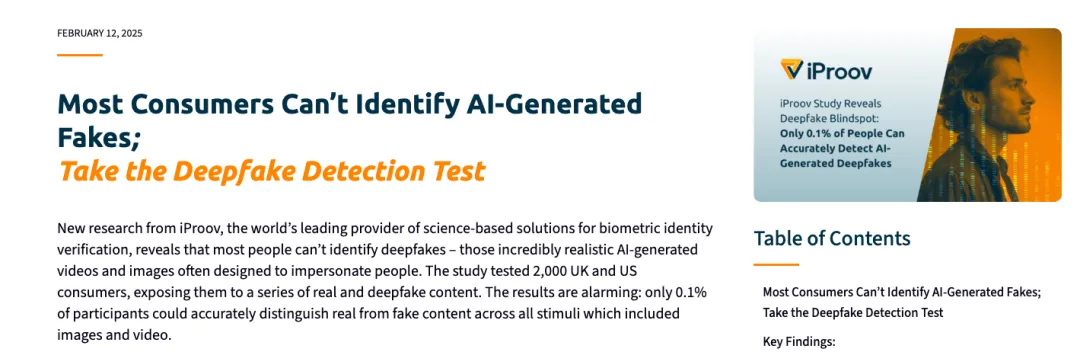

0.1%

去年,英国一家安全公司 iProov 做了一个测试。他们找了 2000 个普通人,给每人看一系列图片和视频——有些是真的,有些是 AI 生成的。任务很简单:分辨真假。

iProov 研究:2000人中仅2人全部答对

结果呢?

2000 个人里,只有 2 个人全部答对。0.1%。

不是 10%。不是 1%。是一千个人里只有一个人。

更让人后背发凉的是另一个发现:超过 60% 的参与者非常自信自己能分辨 AI 假图。

越年轻越自信,错误率也越高。

也就是说——你以为自己能看出来,其实你连自己看不出来,都看不出来。

今年一季度,iProov 又更新了数据:48% 的人开始质疑自己在网上看到的一切,52% 的人只敢看「可信新闻网站」,26% 正在主动减少社交媒体的使用。

不是趋势,是信任大撤退。

那场刷屏的婚礼

今年年初,全网都在转一组照片:赞达亚和汤姆·霍兰德的婚礼现场。灯光温暖,构图专业,两个人笑得很甜。

成千上万的人转发。评论全是祝福。

赞达亚自己的家人和朋友都被骗了——有人打电话问她:「你怎么没邀请我?」

她不得不上吉米·坎摩尔秀,对着镜头说:

「那些照片是假的。」

一个普通人,一台电脑,一张图,骗过百万人,包括当事人的亲妈。

这不是科幻。这是日常。

网传 AI 结婚照

从好玩到害怕

如果你平时不太关注 AI,可能只记得去年那条刷屏新闻:「吉卜力滤镜」——任何照片丢进 ChatGPT,秒变宫崎骏风格。

全网都在玩。那是 2025 年 3 月 25 号。

我也觉得好玩。

但就在同一个春天,字节跳动放出了 Seedream 3.0——3 秒一张 2K 图,人像质感逼真到评测机构说「难以分辨是否为 AI 生成」。

我第一次认真想了一个问题:如果它能模仿宫崎骏,能不能模仿一张新闻照片?一个从未发生过的车祸现场?一张「目击者投稿」?

答案是有的——类似的传播内容,几百万播放和传播。而那还只是 2025 年的 Seedream 3.0。

之后的速度,快到让人来不及害怕。

九月 Seedream 4.0,十二月 GPT Image 1.5,今年二月 Seedream 5.0,二月 Google Nano Banana 2。

然后,一周前——

GPT Image 2。文字准确率 99%。原生 2K。

基准测试 1512 分,碾压式领先。自动联网搜索,你说什么都能给生成出来。

从「AI 人脸画不对」到手指也对,皮肤也对,光影也对,文字也对——一年。

你的情绪是真的——但那幅图不是

可怕的不是假图本身,可怕的是我们冲着假图产生的那些情绪,

愤怒是真的,担忧是真的,但那幅图不是。

被一个不存在的东西,真实地影响过。

学者们给另一种现象起了个名字:「骗子红利」。

逻辑很简单——因为大家都知道 AI 能造假,所以当真正的罪证出现时,当事人只需要说一句「这是 AI 生成的」,就能脱身。

技术本该让真相更清晰,它反而给了说谎者一面盾牌。

当真实可以被合理否认,就没有什么是真实的了。

所以我写了一个TrueSight

现在微信文章里总能看到大量的图片分享,每次刷到一张可疑的图,那种悬着的感觉会一直跟着我。

害怕给了虚假信息,也怕信任被消耗殆尽。

说到底,我没有任何办法。

我们现在看到一个图,只能靠直觉猜。

这种无力感积累到一定程度,我就做了这么一个小玩意。

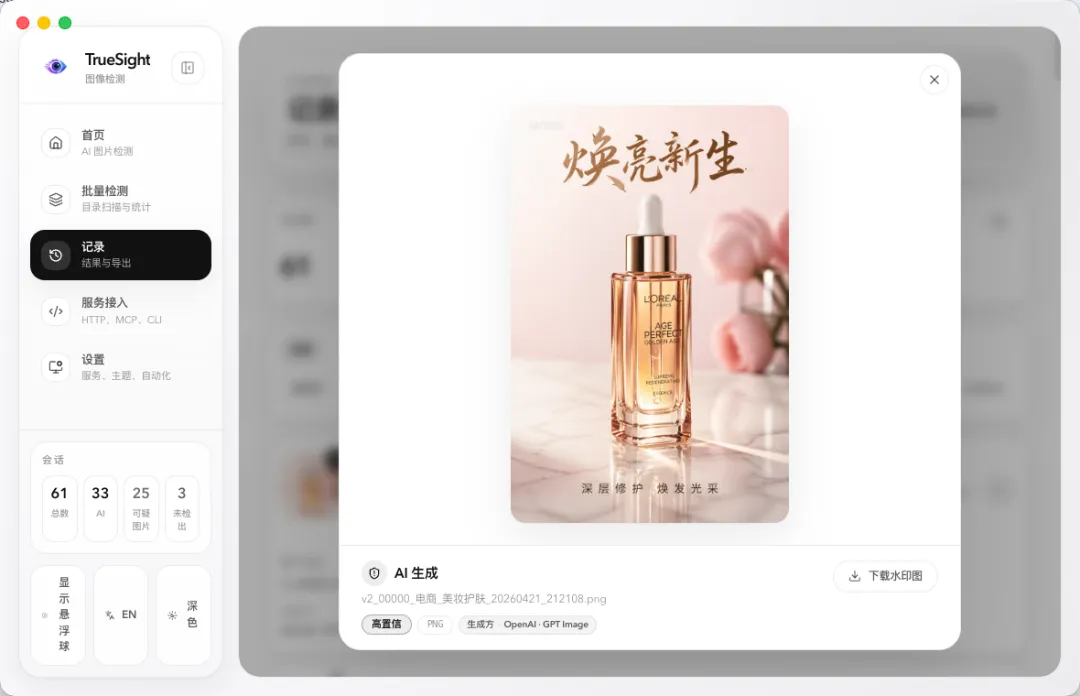

那个东西叫 TrueSight。

用法很简单:你在任何地方看到一张可疑的图——群里、浏览器、社交平台,哪儿都行。

丢进去,不到 1 秒钟,就能知道是不是 AI 生成的。

甚至能指出出是哪个平台生成的——Google、GPT Image、Seedream、Minimax、Qwen,快速认出来。

看到可疑的图,直接拖上去。不用打开 App,不用切窗口。

像在桌面上放了一个真假照妖镜,随手一照就知道。

TrueSight 不上传任何图片到服务器。全部检测在你自己的电脑上完成。不联网。

这是我从第一天就定下的规矩。你可能检测的是工作素材、朋友的私照,或者某个你不想让任何第三方看到的东西。不会因为「想确认一下真假」,就被传到某个你不知道的网站上。

这是底线。

拖一张图进来

任何格式都行。PNG、JPEG、WebP,丢进去就行。1 秒出结果——是不是 AI 生成的,一目了然。

桌面端还有个悬浮球,看到可疑的图直接拖上去,连 App 都不用打开。

悬浮球便捷检测

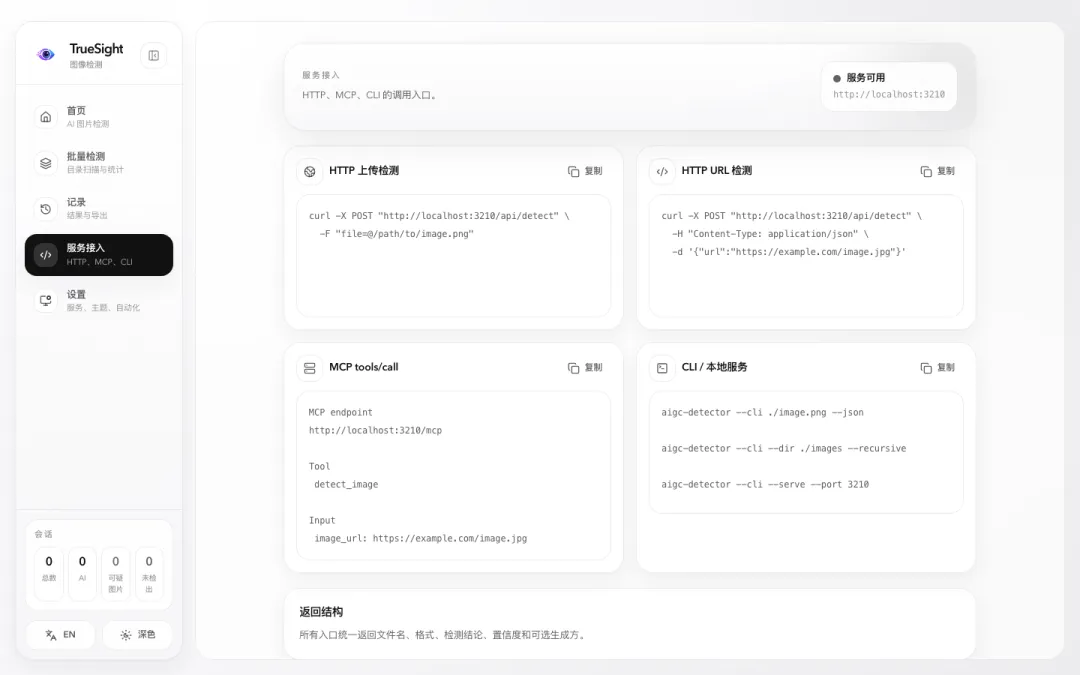

也可以当命令行工具用

一行命令检测本地图片,干净利落。也支持 URL 的图片直接检测。想跑 API 服务也行,接入你自己的工作流。甚至支持 MCP 协议——如果你用 Cursor 或 Claude,直接在对话里就能检测。

命令行 + MCP 协议支持

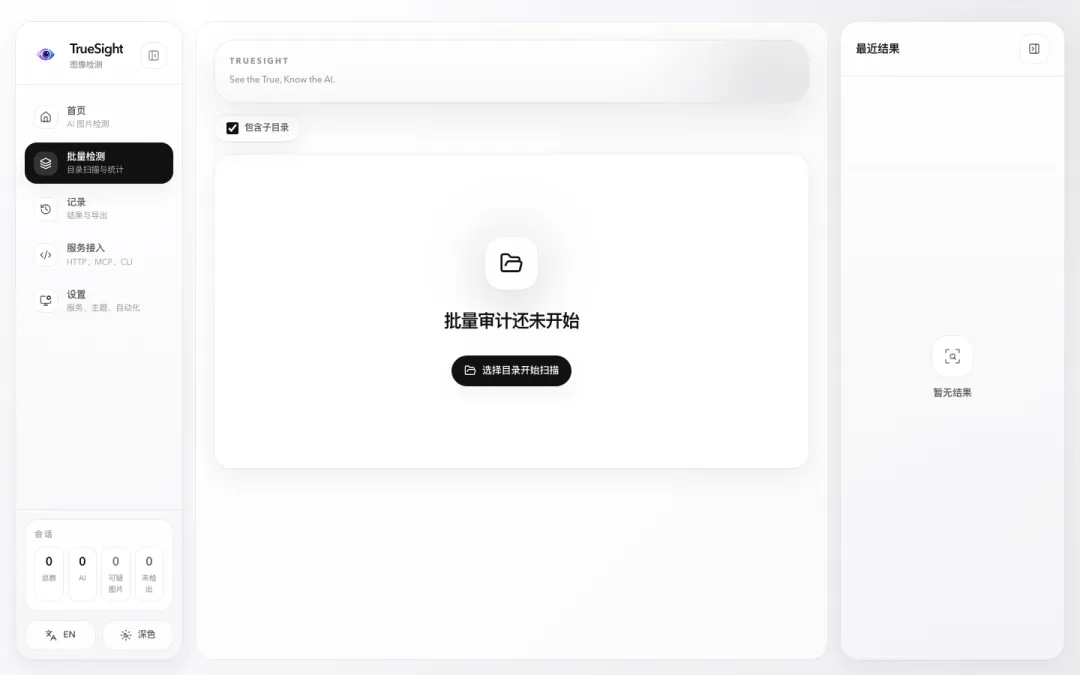

几十张图?一起丢

批量模式会自动排队处理,结果汇总成一张列表。做内容审核、素材筛选的时候特别省事。

批量检测

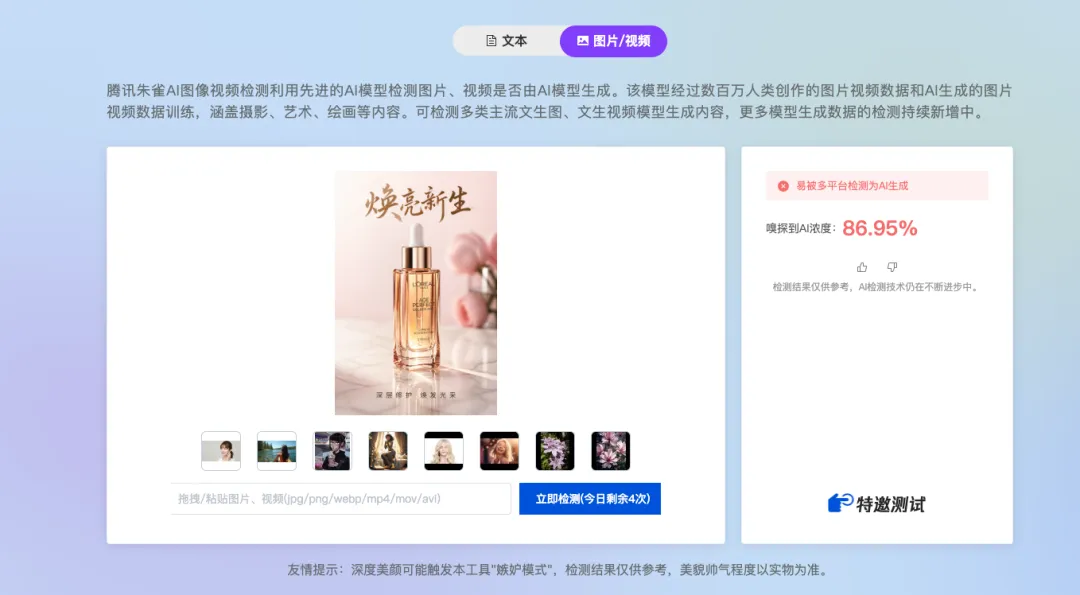

它还知道图是哪个平台生成的

不只是说「这是 AI 画的」,还能告诉你是 Google、GPT Image 还是 Seedream。每个平台有各自的痕迹,TrueSight 认得出来。

平台来源识别

多模型识别

检测结果示例

检测为 AIGC 的图片,支持下载水印图片。增加显式水印传播,避免大家反复验证信息真假。

水印标记功能

当然,现在不是 100% 的准确,毕竟这只是一个小小的便捷检测方法。

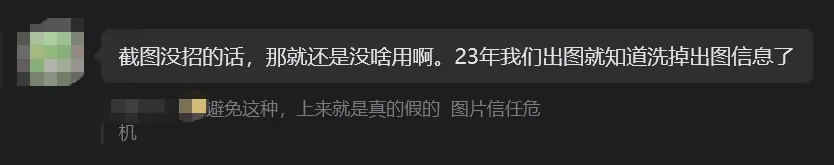

截图、或者抹除了一些信息的时候暂时没办法检测。

后续我会继续探索更多 AIGC 检测方法进行集成,确保检测的准确率更高。

与朱雀检测不同的是,我们当前是基于原图信息进行检测——有就是有,没有就是没有。

目前支持 macOS、Windows 的应用,Web 服务还在调整,调整后放服务器使用。

亮色暗色随你选

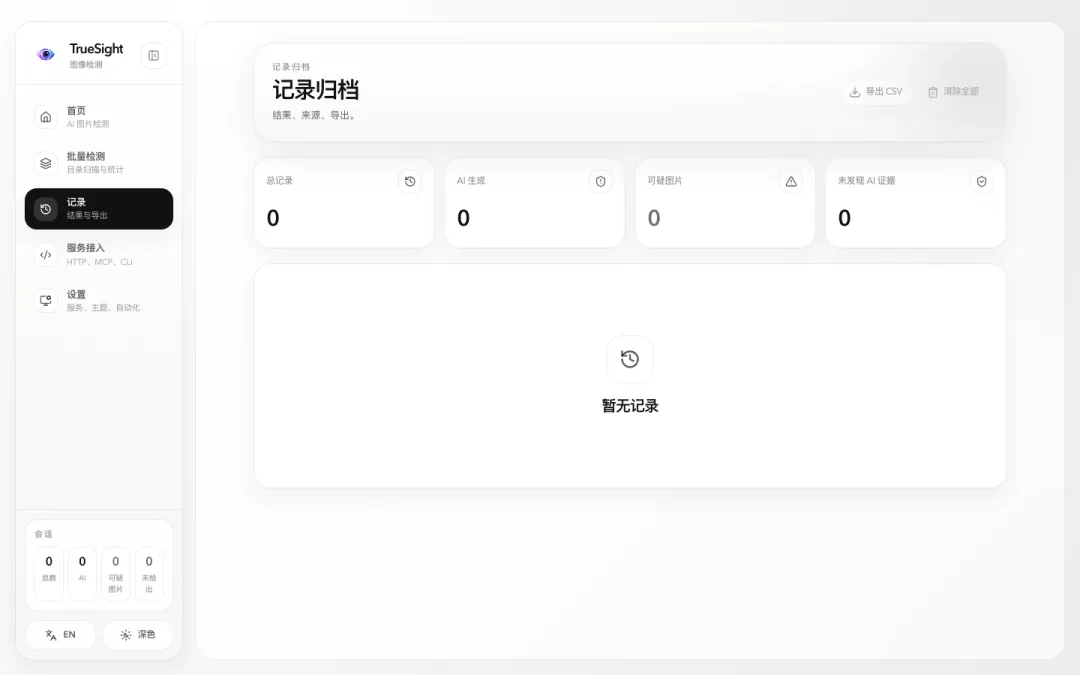

每次检测都会自动保存,时间、结果、来源平台一目了然。回翻以前的检测记录,不用重新跑。

亮色/暗色模式

检测历史记录

一行命令启动 HTTP 服务

支持 RESTful API,把检测能力接到你自己的产品、后台、自动化脚本里。

HTTP API 服务

如果你用 Cursor、Claude 等 AI 编程工具,通过 MCP 协议直接在对话里调检测。不用离开编辑器,给 agent 们加入一个小功能~

MCP 协议集成

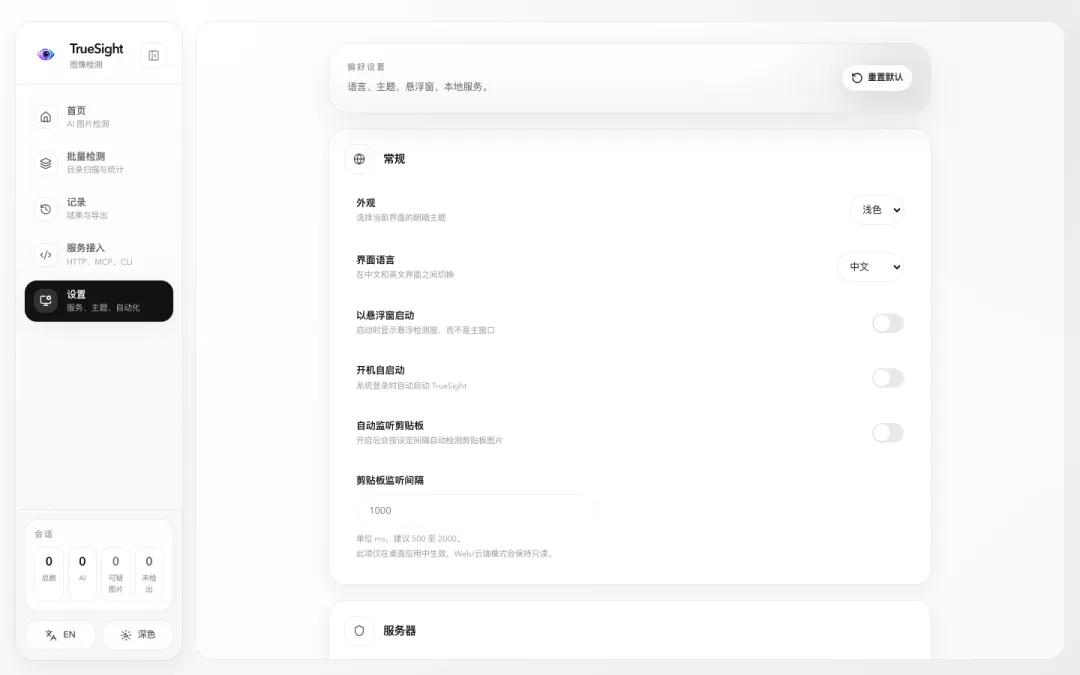

端口、自启动、MCP 开关——都在设置里,尽可能的干净简洁。桌面端和 Web 端共享同一套配置。

设置页面

AI 生图的能力,在过去一年里发生了指数级增长。但普通人辨别真假的能力——没有任何增长。

70% 以上的人,无法准确分辨 AI 图片和真实照片。不是「很难分辨」,是「无法分辨」。

而 60% 的人,坚定地相信自己能分辨。

技术给了所有人造假的权力,却没有给所有人辨假的工具。

下一次,你在屏幕前犹豫的时候——这张图是真的吗?

你不需要再把那个念头压下去。不需要再写「不确定真假,大家自行判断」。不需要骗自己说「反正我也没办法」。

你有办法。

TrueSight,洞见真假。——小字保命:这是 TrueSight 的目标 🎯

很现实的问题,但是这也是目前还没解决的。如果大家有方法,欢迎交流!

这里是 Safphere,本期的是 TrueSight,See the True, Know the AI.

如果你也喜欢这期内容,记得三连。

夜雨聆风

夜雨聆风