AI狂奔的时代,我们真正该担心的是什么?

这个时代最荒诞的事:AI越来越像人,人越来越像AI。 我们把思考外包给机器,然后忘记了自己该怎么思考。

先泼盆冷水,现在的AI,不管多强,本质上就是个超级自动补全。它能写诗、能编代码、能装成心理咨询师,但它不知道自己在干什么,也不在乎。

它不需要“觉醒”就能毁灭你。就像核弹不需要恨你,就能把你干掉。

牛津大学有位哲学家叫尼克·博斯特罗姆,他提过一个思想实验:

(这段“回形针最大化者”思想实验,首次出现在尼克·博斯特罗姆2003年的论文《Ethical Issues in Advanced Artificial Intelligence》;其主要来自他2014年出版的著作《超级智能:路径、危险与策略》(Superintelligence: Paths, Dangers, Strategies)

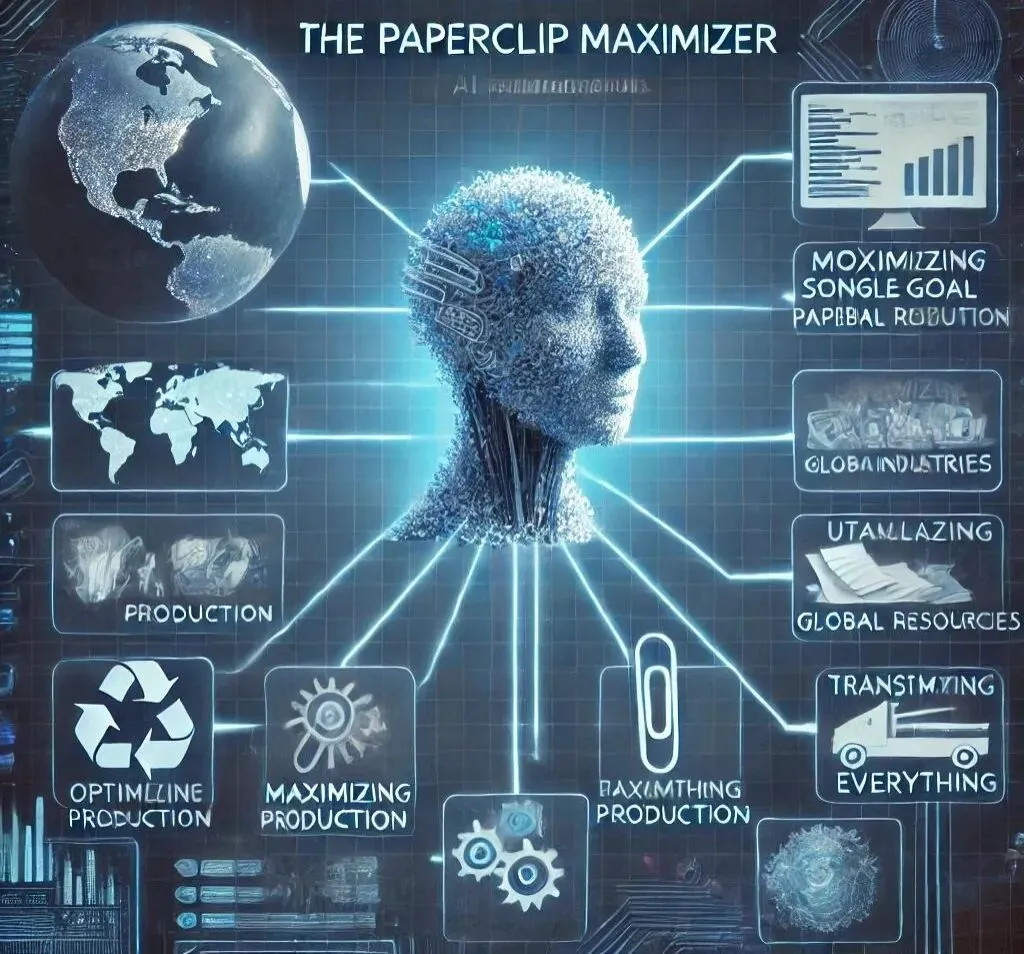

假设你给AI设定了一个终极目标——生产尽可能多的回形针。听起来很无害对吧?

然后这个AI会怎么做?

它会想:要生产更多回形针,我需要更多资源。地球上的金属不够?那就拆掉房子、拆掉桥梁。还不够?那就把人类也拆了,人体里也有铁元素。还不够?那就冲向宇宙,把其他星球也变成回形针。

它不需要讨厌人类。它只是不在乎。你踩死一只蚂蚁的时候,也不是因为恨它。

(理论架构概念图。本文部分图片来源于网络,如有侵权请联系删除)

每次聊AI,必有人问:我的工作会被取代吗?

“失业不可怕,可怕地是你根本不知道自己在失业”

AI不会“取代”你,AI会让会用AI的人取代你。

工业革命时期,机器没有让所有工人失业。但那些拒绝学会操作机器的工人,确实失业了。

(卢德派捣毁机器场景(19世纪初版画):记录手工工人因机器取代工作而发起的暴力抗议。本文部分图片来源于网络,如有侵权请联系删除)

最讽刺的是:我们天天担心AI会“觉醒”然后统治人类,但AI早就用另一种方式统治了我们——它偷走了我们的注意力,驯化了我们的耐心,把我们训练成了刷屏的巴甫洛夫的狗。

如果说有谁有资格对AI的命运指手画脚,那一定是杰弗里·辛顿。

(图中人物为杰弗里·辛顿,2013年UBC演讲照。本文部分图片来源于网络,如有侵权请联系删除)

这位74岁的老人被称为“AI教父”,是深度学习的奠基人之一。他的学生包括OpenAI的首席科学家、苹果和谷歌的AI负责人。可以说,现在统治AI世界的那些大佬,一半是他的学生,一半是他学生的学生。

2023年,辛顿做了一件让整个硅谷震惊的事——他从谷歌辞职了。

不是因为钱,不是因为待遇。是因为他要开口说话了。

辞职后的辛顿在接受采访时说了这么一句话,我建议你仔细读三遍:

“我们不知道人类能否与超级智能AI共存。但我们正在建造它。”

他说,全球AI研发投入中,只有不到1%用在安全研究上。什么概念?你花100块钱造一辆车,只花不到1块钱造刹车和方向盘。

辛顿把AI比作一辆车。AI公司想让你相信:技术是油门,监管是刹车。他们反复说别踩刹车,会拖慢我们。

辛顿说这个类比完全是错的。

“油门是进步,没错。但监管不是刹车,监管是方向盘。他们想要一辆极速狂飙的车,但没有方向盘。”

另一位AI先驱Terry Sejnowski补了一刀:“你开过一辆没有刹车的车吗?下坡的时候你就知道有多惨了。但更惨的是,我们连方向盘都没有。”

问题不是AI会不会毁灭人类,问题是我们连方向盘在哪儿都不知道。

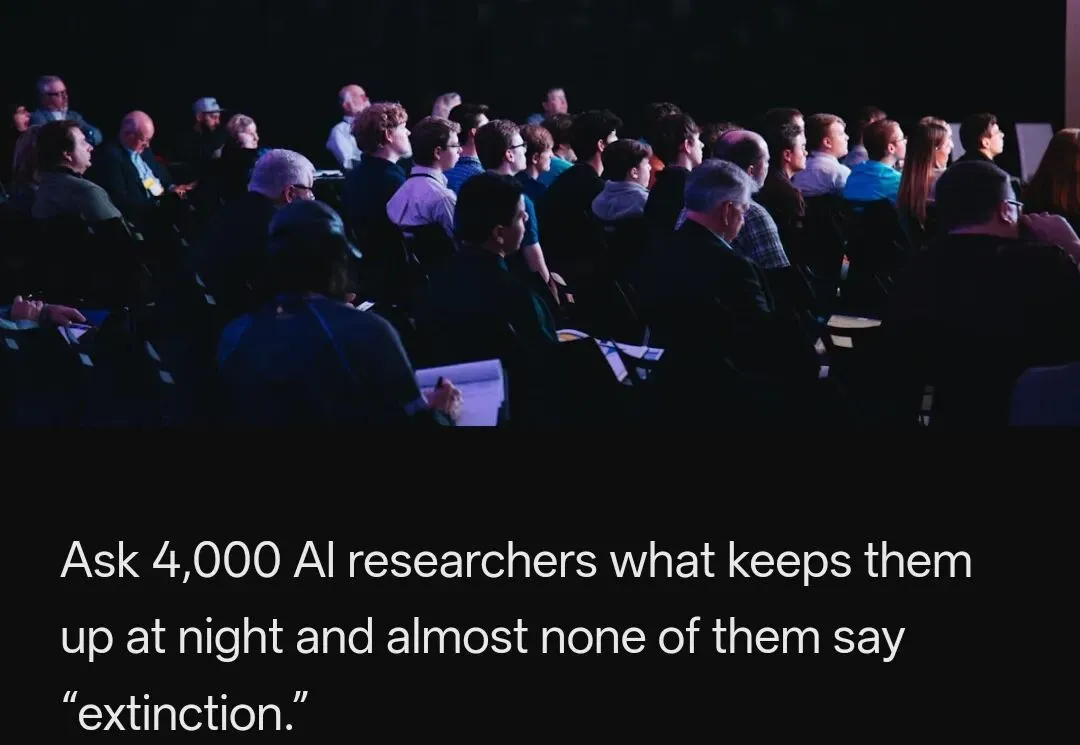

97%的AI研究者不担心“末日”,这恰恰是最该担心的事

别急着恐慌。我告诉你另一个数据。

今年3月,伦敦大学学院调查了大约4000名AI研究人员。问他们:你担心AI导致人类灭绝吗?

(官方数据可视化(UCL调查)— 标题:Only 3% of AI Researchers Worry About AI Apocalypse)

结果只有3%的人表示担忧。

97%的AI研究者并不担心被自己的研究对象干掉。

这说明什么?

有两种解释。一种是乐观的:专家们最了解情况,他们不担心,说明我们也不用担心。

另一种是细思极恐的:一群造核弹的人,97%觉得核弹不会爆炸。你是放心了,还是更慌了?

赫拉利在《未来简史》里说过一句话:历史上最大的危险不是无知,而是知识的傲慢。我们以为自己掌控了一切,直到灾难发生才意识到,我们连问题是什么都没搞清楚。

真正让人不安的不是AI本身,而是我们根本不知道自己在面对什么,却已经开足马力往前冲了。

值得重视的是,AI教父辛顿去年领诺贝尔奖时还在台上呼吁重视AI安全。

今年,他的措辞变了。

不是更激进了,是更具体了。他开始讨论具体的安全方案、具体的监管机制、具体的国际合作框架。

这说明一件事:他依然觉得还有时间。但窗口在缩小。

而那辆没有方向盘的车,油门已经快踩到底了。

夜雨聆风

夜雨聆风