本地LLM AI 推理服务工具有哪些,新手教程来了

也就是大家常说的本地大语言模型(LLM)管理与运行工具,他不是大模型,只是大模型的本地调度管理工具,算作是大模型和用户间的中间层工具和运行框架。可以在个人设备(PC、Mac、树莓派等等)上快速私有化部署和管理大语言模型。

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

如果纯想体验,又没有电脑基础,先推荐2款新手适合的。

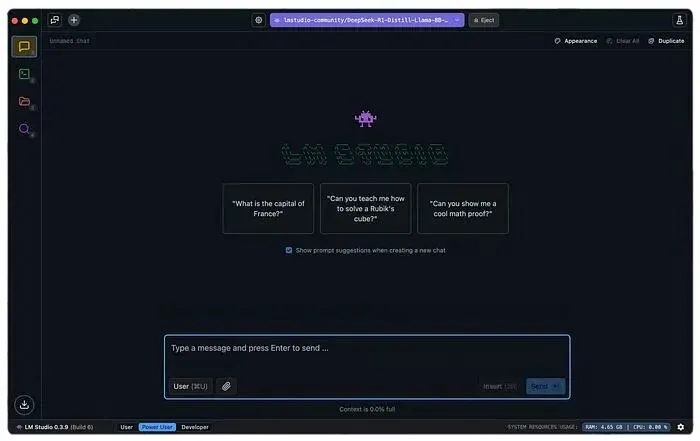

LM Studio

优点

-

全图形化:下载、运行、对话、API 开关全界面操作,完全无命令行 -

对GGUF模型友好:支持所有主流量化模型,自动推荐适配版本 -

内置 OpenAI 兼容 API:一键开启本地服务 -

可以实现多模型并行:可同时跑多个模型并切换

缺点:功能较浅,无微调、高级参数配置性能略低于原生 llama.cpp

Ollama

Ollama

优点

-

极简:一行命令安装 / 运行(ollama run llama3),自动适配 GPU/CPU -

跨平台:Windows/macOS/Linux,Apple Silicon 金属加速 -

模型库全:内置 100+ 优化模型(Llama3、Qwen、DeepSeek 等) -

OpenAI 兼容 API:http://localhost:11434,集成方便

缺点

-

显存利用率低(40%–60%),大模型(≥13B)显存占用高 -

并发弱,不适合高吞吐生产环境

llama.cpp(低配设备、边缘部署主选)

优点

-

极致轻量:纯 CPU 也能跑 7B–13B 模型,适配老旧设备、树莓派 -

显存效率高:支持 4-bit/8-bit 量化,比 Ollama 省 30%–50% 显存 -

多平台加速:CUDA/Metal/OpenCL/AVX2,Apple Silicon 优化极佳,Mac用户福音 -

社区最强:Ollama/LM Studio 底层均依赖它

缺点

-

无 GUI,纯命令行,需编译 / 参数调优,上手成本高 -

模型需手动转 GGUF 格式,管理麻烦

vLLM

优点

-

吞吐量爆炸:比传统框架高 14–24 倍,支持数百并发请求 -

显存利用率 85%–95%,比 Ollama 省 30%–50% 显存 -

连续批处理:动态处理不同长度请求,延迟低 -

支持分布式多 GPU,适合 70B+ 大模型

缺点

-

上手复杂,需 Python 环境,配置参数多 -

仅面向服务器 / 生产,无桌面端优化 -

不适合个人日常使用(太重)

LocalAI

优点

-

无缝替换 OpenAI:API 路径 / 参数完全一致,不改代码即可迁移 -

支持 GGUF/GPTQ/EXL2 等多格式,可同时管理多个模型 -

轻量容器化:Docker 一键部署,适合服务器 / 集群 -

内置模型缓存,响应更快

缺点

-

性能中等,并发弱于 vLLM,适合中小规模服务 -

社区活跃度低于 Ollama/vLLM

夜雨聆风

夜雨聆风