我们怎么"学会用好 AI"?

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

OpenAI 的实践教训:超过 100 行反而让 Agent 迷失,不知道哪条和当前任务有关。正确做法是 100 行以内的导航地图,指向详细文档的存放位置,Agent 按需跳转查阅。

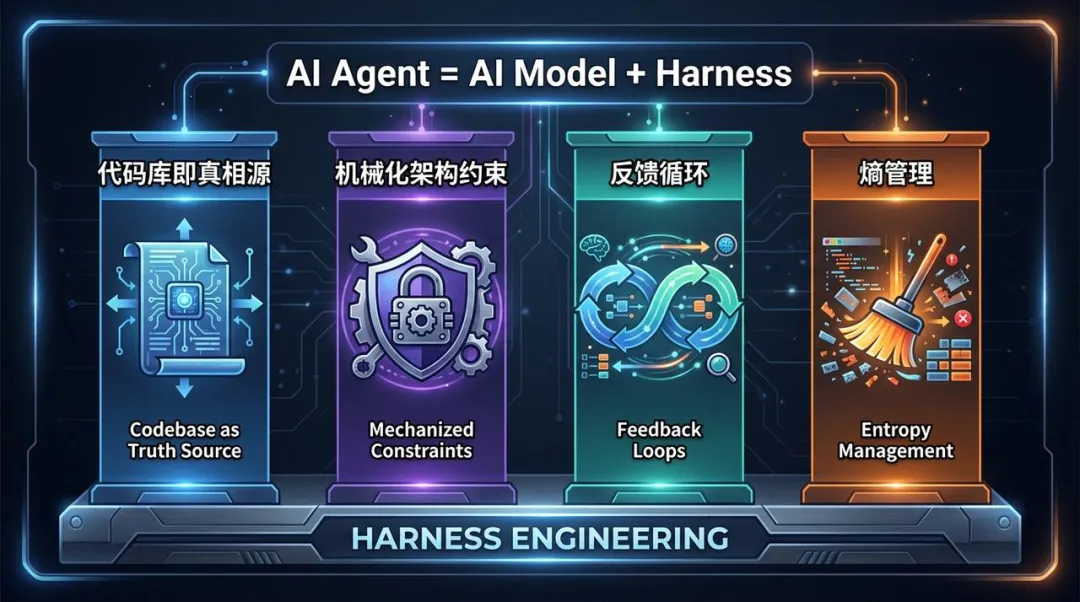

CLAUDE.md 是建议,Hooks 是法律。 这句话是 Harness Engineering 里流传最广的一句话。

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

品味捕获一次,强制执行无限次。

如果这篇文章对你有帮助,不妨点个赞、转发、收藏三连支持! ❤️想第一时间收到推送,记得加个星标 ⭐

往期推荐

温馨提醒:「狂师・AI 进化社」,旨在帮助每一个人系统全面的学习 AI,哪怕你是纯 AI 小白,这里面的教程你从 0 开始看保证你一样能看懂,目标是让每一个人可以系统掌握 AI 赋能到工作中,

目前已更新到AI智能体、AI测试版块,建议立马去跟着学习,还是那句话,会用 AI 只是表面,能理解 AI 背后的逻辑,以及用 AI 解决一些你的问题,才会比人更进一步。

五一假期要是有空,可以顺手补补这块进度~

现在上车非常值得,早点跟上,后面在公司拿成果、面试都会轻松很多

👇 点击下方关注公众号《测试开发技术》,获取免费测开学习路线、简历模板、面试真题、AI测试、AI 编程、自动化测试、测试开发资料教程等。

END

后台回复【领资料包】试试

夜雨聆风

夜雨聆风