我扒了 Claude Code 的源码,终于看懂它为什么会“突然被限”

我把源码、社区分析和一份更细的“封号机制”技术报告对在一起看,结论很清楚:

Claude Code 本质不是聊天产品,而是一套“工程执行编排系统 + 账号风控系统”。

一、先把定位讲透:它不是聊天助手,是工程执行编排器

如果你把 Claude Code 当成 ChatGPT 的 CLI 版本,你会低估它。

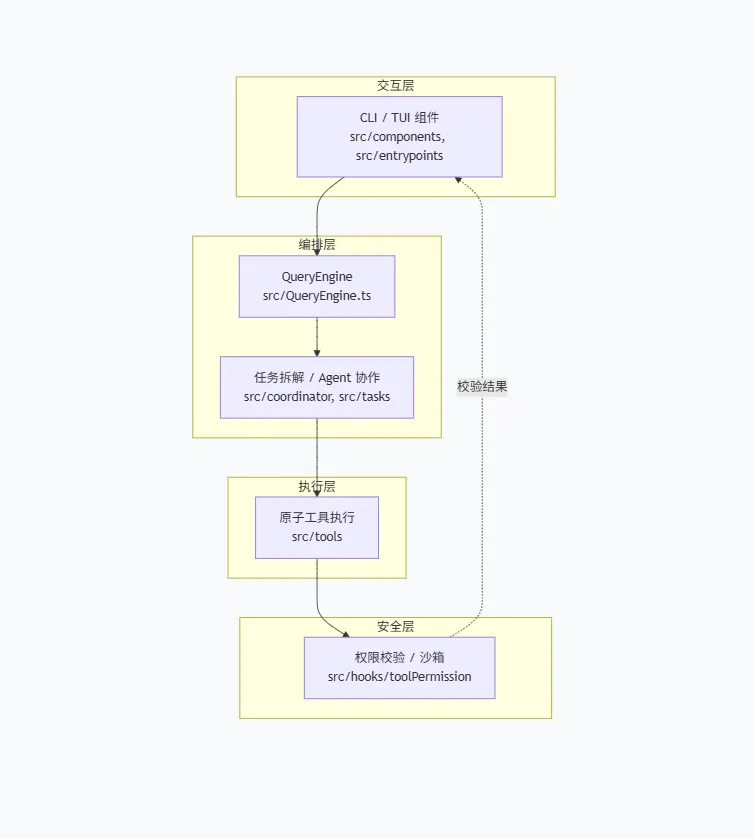

从架构上看,它至少有四层能力:

1. 交互层:CLI/TUI 接收任务、展示执行过程

2. 编排层:把自然语言任务拆成可执行步骤

3. 工具层:调用文件编辑、命令执行、检索等原子工具

4. 安全层:危险动作前置拦截、审批、策略控制

架构图

一句话翻译:它不是“告诉你怎么改”,而是“自己调度工具去改”。

二、一次请求到底发生了什么?

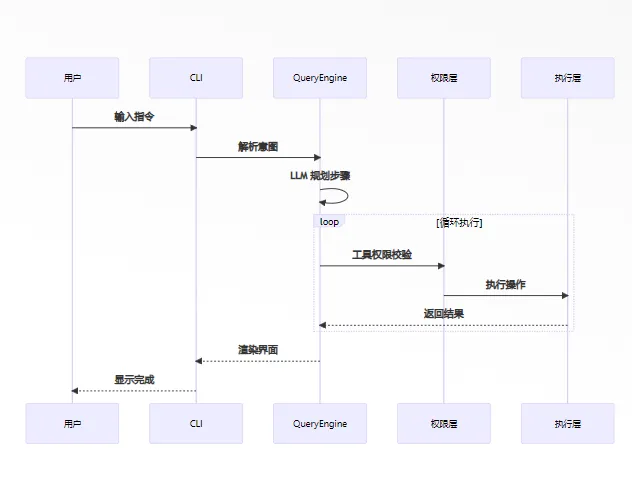

你输入一句“帮我重构这个模块”,系统内部通常是这条链路:

• 读你的输入 + 项目上下文

• 大模型先规划步骤

• 产生 Tool Use(要调用哪些工具)

• 工具执行前先过权限检查

• 执行结果回传给模型

• 模型继续下一轮决策,直到闭环

流程图(从输入到交付)

这套机制的关键点在于:模型负责决策,工具负责落地,权限系统负责兜底。

三、源码里的核心执行循环(代码)

下面这段伪代码,基本能概括 Claude Code 的工作方式:

// src/QueryEngine.ts (简化示意)while (true) { const response = await client.messages.create({ context, history }); for (const block of response.content) { if (block.type === 'tool_use') { await validateToolPermission(block); // 安全前置 const result = await toolExecutor.execute(block); // 工具执行 history.push(createToolResult(block.id, result)); // 结果回灌 } } if (shouldStop(response)) break;}这也是它和“普通问答模型”最大的差别:它不是一次性回答,而是决策—执行—反馈的闭环系统。

四、为什么大家会说它像“多 Agent 编排平台”?

因为复杂任务下,它会拆分子任务,并在父任务里回收结果。

子 Agent 启动示意(代码)

// src/tools/AgentTool/forkSubagent.ts (示意)export async function forkSubagent(parentContext, task) { const childConfig = { ...parentContext.config, permissions: parentContext.permissions.getInheritedRules(), }; const subagent = await spawnSubagent({ task, config: childConfig, streamTo: 'parent', }); return subagent.id;}真正有价值的不在“并行”本身,而在:

• 任务怎么拆,拆到什么粒度

• 子任务怎么回收,结果怎么校验

• 失败了怎么兜底和回滚

五、为什么会“突然被限”?你得用风控视角看

很多人问:“我只是正常用,怎么突然限了?”

问题在于,你看到的是单次操作;平台看到的是整段行为轨迹。

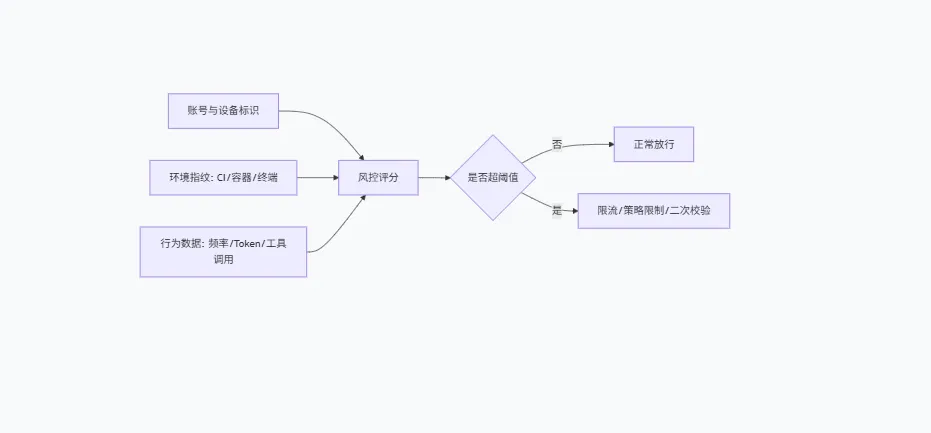

从源码与技术报告看,风控可粗略理解为三层:

1. 身份层:Device ID / Account UUID / Session ID 等

2. 环境层:OS、终端、CI、容器、IDE、部署环境等指纹

3. 行为层:调用频率、token 消耗、模型分布、工具调用路径

风险触发流程图(抽象)

重点不是某一个动作,而是“信号组合”。

六、常见高风险组合

高风险往往来自以下组合信号:

• 同账号多设备/多环境频繁切换

• 短时间高强度请求且持续冲击配额

• 非交互 + CI + 高频 + 大量 token 消耗

• 客户端特征异常(例如请求归因不一致)

• 内容策略触发拒绝

所以“我就多跑了几次”往往只是表象。

七、给开发者的 6 条建议(少踩坑)

1. 一人一号,不要共享账号

2. 控制调用节奏,不要把交互产品当无限 API 压测

3. CI 场景优先走官方推荐的企业/API通道

4. 不要魔改客户端和伪造请求特征

5. 及时升级版本,减少策略不兼容

6. 对敏感项目做最小化暴露与最小权限

结尾

拆完这轮源码后,我最大的感受是:

未来 AI 编程产品比的不是谁更会写代码,而是谁能稳定、可控、低风险地完成工程任务。

会回答问题,是入场券;

能持续交付,才是护城河。

好了,今天的分享就到此结束,咱们下回见;

如果觉得文章对你有帮助,记得点赞、转发、收藏喔!

想一起探讨AI编程、AI智能体、OpenClaw应用落地,欢迎加我:ahui33168

夜雨聆风

夜雨聆风