当AI工具变成了"批准机器":一次更新如何让效率倒退十年

一个本该8分钟完成的任务,最终耗时2小时。这不是AI的未来,这是AI的倒退。

一场噩梦的开始

17:25,我给AI助手发了一个简单的任务:阅读一篇文章,写一篇公众号推文,配上几张图,保存草稿。

同样的任务,以前只需要8分钟。

但这一次,我经历了一场持续到19:28的噩梦——整整2小时3分钟。

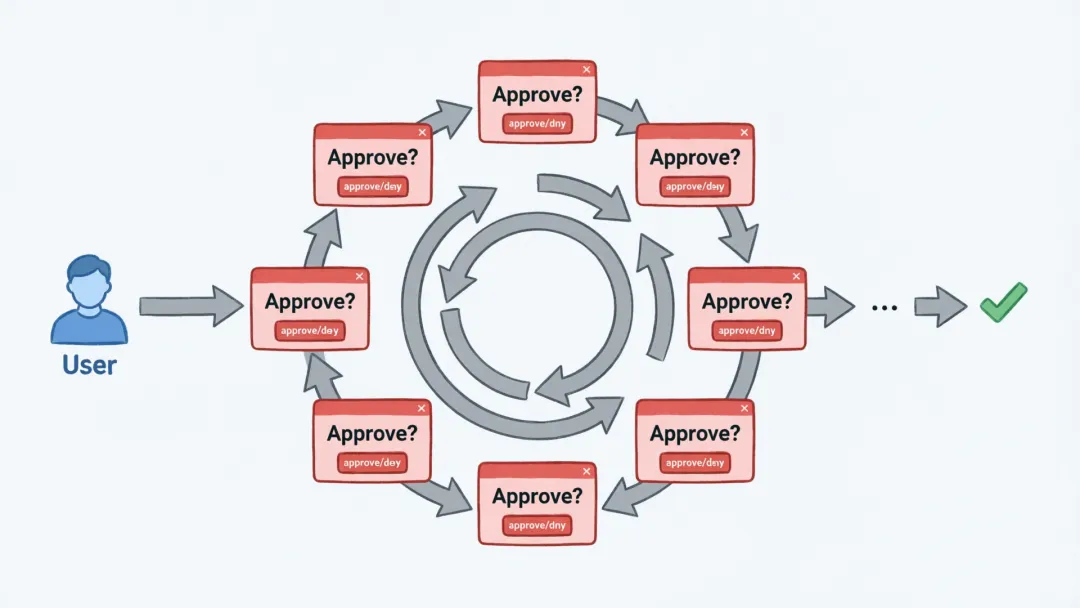

“批准”的无尽循环

如果要用一个词形容这次体验,那就是:疯狂。

访问本地文件? —— 需要批准 创建目录? —— 需要批准 创建文件? —— 需要批准 编写脚本? —— 需要批准 执行脚本? —— 需要批准 读取配置? —— 需要批准

每一个微小的操作,都弹出一个窗口,等待我手动点击”批准”。

我被迫坐在电脑前,目不转睛地盯着终端界面,像一个守夜人,随时准备点击那个该死的”批准”按钮。

这根本不是人工智能,这是人工智障。

从1轮对话到几十轮对话

原本,这应该是一轮对话:

我:阅读这篇文章,写一篇公众号推文,配图,保存草稿。 AI:好的,已完成。这是链接。

但现实变成了这样:

我:阅读这篇文章,写推文… 系统:⚠️ 需要批准 我:已批准,继续 AI:需要执行命令… 系统:⚠️ 需要批准 我:已批准 AI:进展如何? 我:继续! 系统:⚠️ 需要批准 我:批准了! AI:我检查一下… 系统:⚠️ 需要批准 我:…

对话轮数爆炸,效率归零。

这不是安全,这是无能

我理解安全的必要性。但安全不应该以牺牲可用性为代价。

过度的安全措施,本质上是无能的表现。

当一个AI助手连读取本地文件、创建目录这种最基础的操作都需要人工批准时,它就失去了”自动化”的意义。

这不是”安全第一”,这是”推卸责任”。

这不是”保护用户”,这是”折磨用户”。

效率倒退十年

让我们算一笔账:

|

|

|

|

|

|---|---|---|---|

|

|

|

|

+1400% |

|

|

|

|

+几千% |

|

|

|

|

无限增长 |

|

|

|

|

精神崩溃 |

如果说AI的意义是提升效率、解放人力,那么这次更新就是在反其道而行之。

这不是进步,这是倒退十年。

一个用户的呐喊

让我把话说清楚:

我可以接受AI犯错,我可以接受AI不够聪明,但我无法接受一个本该”自动”的系统,变成一个需要我不断喂奶的婴儿。

如果每一次操作都需要我批准,那请问:

我为什么还需要AI?

我为什么不自己干?

安全与效率的平衡

安全当然重要。但安全措施应该是智能的,而不是粗暴的。

好的安全设计:

-

• 识别真正危险的操作(删除文件、发送邮件、发布内容) -

• 对低风险操作放行(读取文件、创建目录、本地计算) -

• 学习用户习惯,减少不必要的干预 -

• 提供”信任此操作类型”的选项

糟糕的安全设计:

-

• 对所有操作一视同仁,全部弹窗 -

• 强迫用户不断点击”批准” -

• 不提供任何自动化选项 -

• 把用户当成潜在威胁

给开发者的建议

如果你正在开发AI工具,请记住:

-

1. 用户的时间是宝贵的 —— 每一次不必要的干预,都在消耗用户的耐心 -

2. 自动化的意义是”自动” —— 如果还需要人工干预,那就不叫自动化 -

3. 安全应该有梯度 —— 不是所有操作都需要同样的安全级别 -

4. 信任是积累的 —— 用户批准过一次的操作,应该被记住

结语:请别让AI变成笑话

AI工具的初衷是让生活更简单,而不是更复杂。

当用户开始怀念”旧版本”时,说明新产品出了问题。

当用户开始质疑”这还算不算AI”时,说明方向错了。

请别让AI变成一个需要不断点击”批准”的笑话。

2026年4月1日,一个本该8分钟完成的任务,变成了2小时的噩梦。这是我用过最痛苦的一次AI体验。

如果你也遇到此问题,欢迎观看昨天的文章来解决这个问题,也可以私信我直接发送python脚本给您一键解决。

往期推荐

News Watch

OpenClaw 更新后疯狂弹窗?一文读懂安全策略变化与终极解决方案

2026-04-02

比数据泄露更可怕的,是你无法信任自己的数据

2026-04-01

当AI学会”插拔”:MCP协议如何打破数据孤岛

2026-03-28

当AI开始”自主工作”:Claude官方揭秘Agent能力演进与未来

2026-03-26

夜雨聆风

夜雨聆风