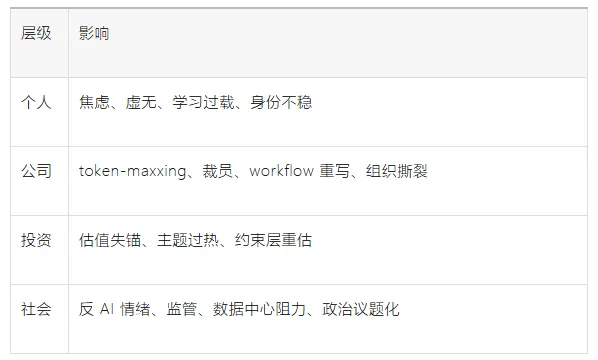

蒙眼狂奔的AI:开放终局焦虑与囚徒困境

最核心的洞察:Token-maxxing ≠ 生产力兑现

效率提升了 100 倍,营收增长 100 倍了吗?

token 消耗 → 产品能力 → 用户价值 → 收入 / 毛利 / 留存 / 估值 的转化率。

-

Token Burn ↑↑ -

Feature Output ↑ -

PMF ? -

Revenue ↑有限 -

Moat ? -

Valuation ?

最底层:这源于人类对“不确定未来”的基因级恐惧

-

今天有没有食物? -

附近有没有猛兽? -

部落会不会抛弃我? -

冬天能不能过去?

-

我的技能会不会被替代? -

我的行业会不会消失? -

我的资产定价会不会失效? -

我的孩子长大后的世界还需要人吗? -

现在努力的方向三年后还有意义吗?

不是因为看见了危险,而是因为不知道危险会从哪里来。

为什么大家“不敢停下来”?

“我需要休息、我需要思考、我需要等清楚一点。”

-

别人用 Claude Code -

别人开 10 个 agent -

别人每天发新产品 -

别人融资 -

别人裁员提效 -

别人 token-maxxing -

别人学新工具 -

别人重写 workflow

所有人都知道慢一点、想清楚一点、组织好一点可能更健康;但只要别人不慢,我就不能慢。

公司层:不 AI-native 可能死,AI-native 也可能烧死

-

token burn ↑ -

AI 工具支出 ↑ -

重复建设 ↑ -

安全规则后移 ↑ -

员工焦虑 ↑ -

裁员加速 ↑ -

真实 PMF 不一定同步 ↑

-

AI adoption ≠ AI absorption -

Token spend ≠ Revenue growth -

Agent count ≠ PMF -

Code output ≠ Business truth

AI-native 不是 seat 合法性本身,AI absorption 才是。

员工层:不学 AI 会被替代

学 AI 也可能是在训练替代自己的机器

员工为了避免被 AI 替代,必须用 AI 提升自己;但提升自己的过程,又可能加速自己被系统替代。

-

谁更会 prompt -

谁更会调 agent -

谁更会搭 workflow -

谁更快把自己的经验变成 AI skill -

谁能一个人干过去三个人的活

最深层悖论:AI 把“努力”变成了不稳定资产

-

学习技能 -

→ 积累经验 -

→ 提高稀缺性 -

→ 获得收入 / 地位 / 安全感

-

学习技能 -

→ 技能被 AI 快速吸收 -

→ 稀缺性下降 -

→ 需要学习下一个技能 -

→ 再次被吸收

不是不愿意努力,而是不知道努力沉淀到哪里。

自己正在跑一个没有存档点、没有终点线、没有稳定计分规则的游戏。

投资人层:不投 AI 会输,乱投 AI 也会输

必须参与 AI,但不能知道自己参与的是赢家还是泡沫。

-

neo lab 高估值 -

AI infra 拥挤交易 -

垂直 agent 泛滥 -

SaaS 被抛售 -

资本快速迁移 -

估值框架失锚

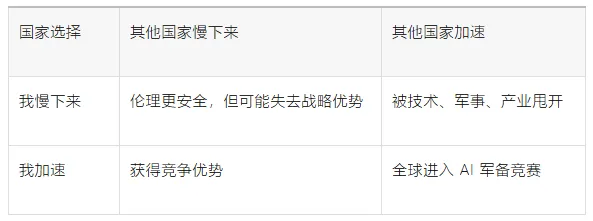

国家层:AI 是国家级囚徒困境

这不是乐观主义,而是“恐惧型加速主义”

停下来更可怕。

为什么会产生虚无主义?

第一,努力的意义被动摇

我今天学的东西,两年后还有用吗?

我积累十年的能力,会不会被一个 agent workflow 压缩掉?

我努力追赶,到底是在接近未来,还是在追逐一个永远后移的目标?

第二,身份被动摇

-

我是工程师 -

我是研究员 -

我是投资人 -

我是设计师 -

我是销售 -

我是分析师

-

哪些任务可自动化? -

哪些判断仍然需要人? -

哪些经验已经贬值? -

哪些能力可以被蒸馏成 skill?

不是我不会工作了,而是“我是谁”这件事变得不稳定了。

第三,未来叙事被动摇

-

读书 -

工作 -

买房 -

晋升 -

积累财富 -

养育下一代 -

退休

世界变化太快,我无法为五年后的自己建模。

既然未来无法建模,那当下努力的意义是什么?

“蒙眼狂奔”的本质:没有终点、没有裁判、没有暂停键

-

谁拿到用户 -

谁拿到流量 -

谁形成网络效应 -

谁上市 -

谁盈利

-

AGI 是终点吗? -

ASI 是终点吗? -

模型自我训练是终点吗? -

agent 替代白领是终点吗? -

算力耗尽是终点吗? -

监管介入是终点吗? -

社会反噬是终点吗?

你看不见终点,但你能听见旁边所有人的脚步声。

投资上,这种虚无主义本身也是一个信号

-

第一阶段:惊叹 -

第二阶段:追赶 -

第三阶段:焦虑 -

第四阶段:反噬 -

第五阶段:制度重构

叙事仍会继续强化

但泡沫和过度投资会同步发生

-

无效 agent -

过度 token 消耗 -

重复创业 -

AI wrapper 泛滥 -

高估值 neo lab

社会反噬会越来越重要

-

数据中心阻力 -

AI 裁员监管 -

税收再分配讨论 -

模型安全监管 -

反垄断 -

就业保护政策

对个人而言

真正的解法不是“跑得更快”,而是重新建立控制感

我怎样才能不被 AI 甩掉?

我怎样建立一个能持续更新的世界模型?

-

状态识别 -

假设集合 -

证据更新 -

反证机制 -

行动路由 -

仓位纪律 -

方法后验

不是消灭不确定性,而是把不确定性结构化。

最后一层:这场狂奔真正考验的是“精神结构”

-

能不能在不确定中保持判断 -

能不能在群体狂奔中保持节奏 -

能不能在技术冲击下不失去主体性 -

能不能承认变化,同时不被变化吞掉 -

能不能持续学习,但不把自己变成焦虑机器

工具追赶模式。

世界模型更新模式。

约束识别 + 价值捕获 + 方法后验更新模式。

我不知道跑向哪里,但我知道停下来可能更危险。

夜雨聆风

夜雨聆风