阿里开源了一个"神仙工具":输入一句话,AI自动帮你做成短视频

五一结束啦,鸽了好几天没分享文章啦。

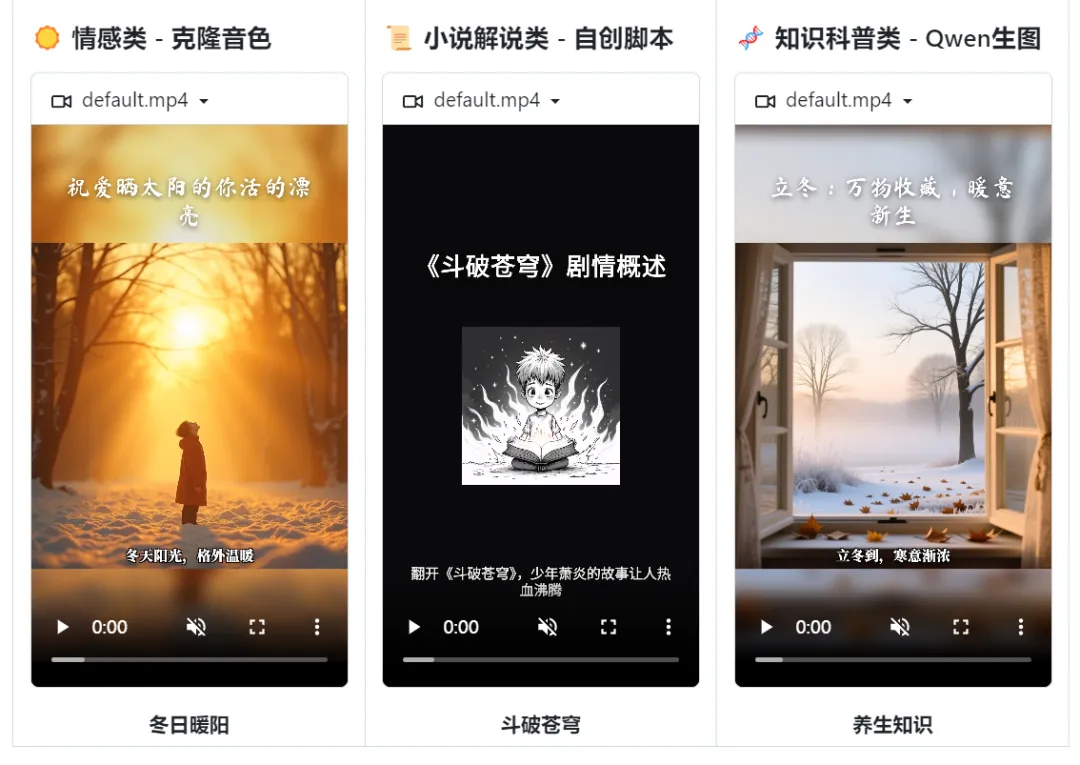

作为一个天天刷抖音、B站的人,你有没有想过——那些博主天天更新,他们哪来那么多时间剪视频? 今天给大家安利一个阿里出品的开源神器

先说说做视频有多麻烦

咱来算笔账。如果你想做一个 1 分钟的科普短视频,传统流程是这样的:

-

先想选题,再写脚本文案(1-2小时) -

找素材、拍视频或者做图(2-3小时) -

配音——自己录的话反复 NG,找人配又贵(1小时起步) -

打开剪映/PR,剪辑、加字幕、调节奏(2-3小时) -

找合适的 BGM 背景音乐(半小时) -

导出、上传、写标题(半小时)

一个 1 分钟的视频,愣是能折腾一整天。 这还不算创意卡壳、素材找不到、配音不满意这些糟心事。

我自己就试过,有一次想做个”为什么猫喜欢钻箱子”的科普视频,光是找素材就找到眼瞎,最后不了了之。

然后我发现了一个”外挂”

前阵子逛 GitHub,挖到一个宝藏项目——Pixelle-Video。

这玩意儿是阿里国际数字商业集团(AIDC-AI)开源的,目前在 GitHub 上已经拿了 1.1 万+ 颗星星,社区火得一塌糊涂。

它的宣传语特别嚣张:

输入一个主题,自动生成完整短视频。

我一开始是不信的。结果试完之后,真香。

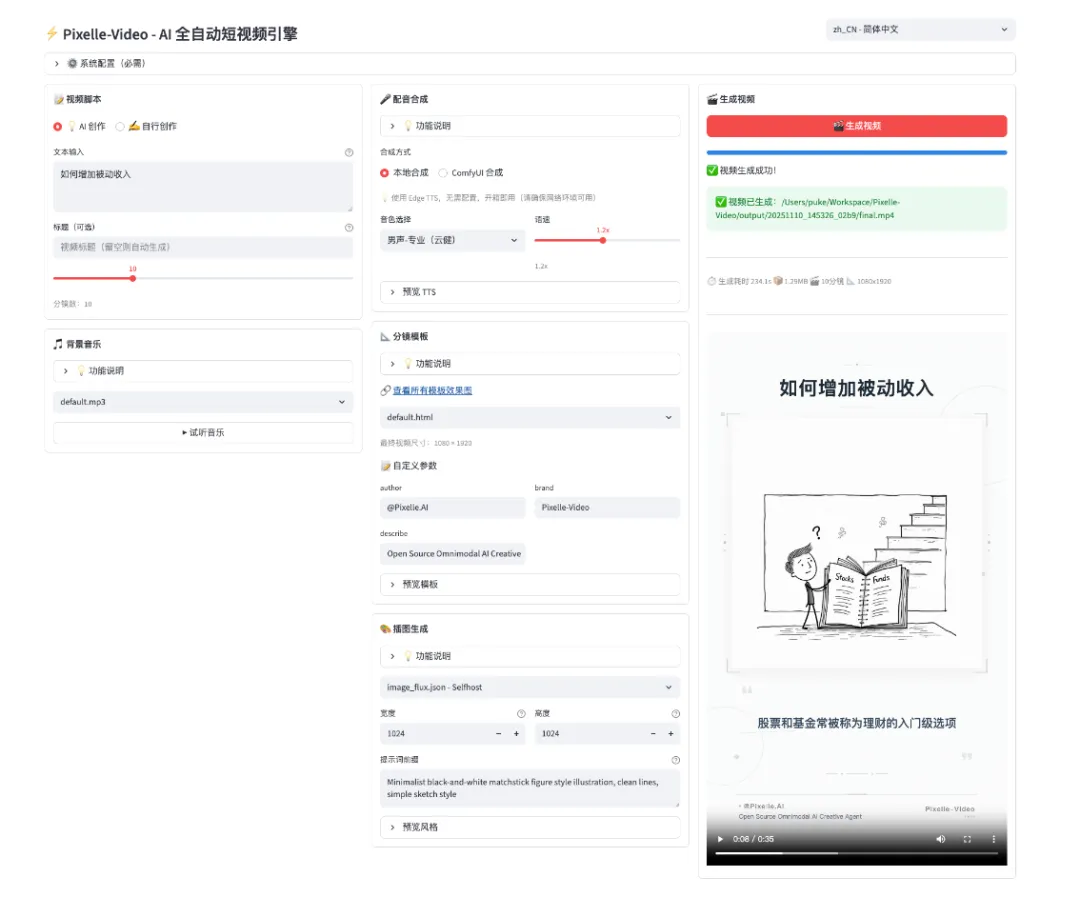

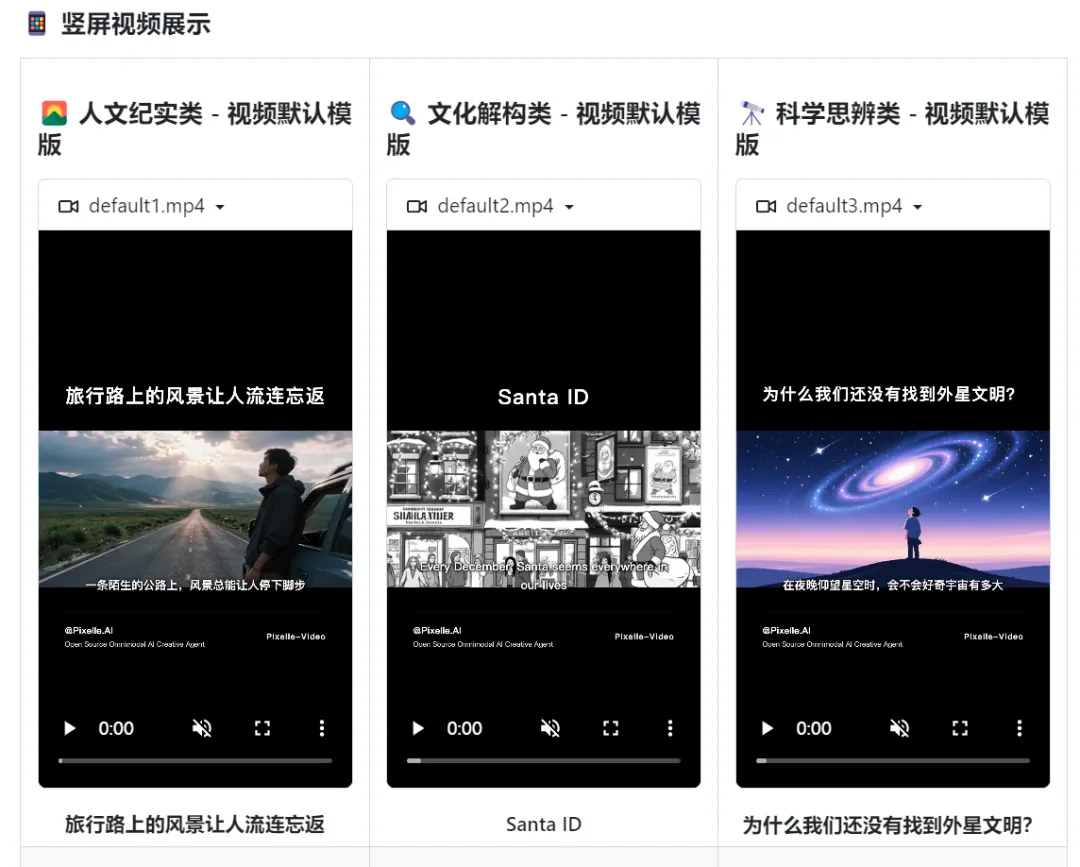

它到底能干嘛?一句话:把视频制作”一条龙”全包了

这个工具本质上是一个AI 全自动短视频引擎。你只需要在输入框里敲一个主题,比如:

-

“为什么要养成阅读习惯” -

“量子力学到底是什么” -

“为什么猫喜欢钻箱子”

然后点一下生成按钮,AI 就会在后台自动完成全部工作:

|

|

|

|---|---|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

几分钟之后,一个完整的 MP4 视频就躺在你电脑里了。 你可以直接传到抖音、B站、视频号,连剪映都不用打开。

不止”一键成片”,它还有这些骚操作

除了最基本的”输入主题出视频”,Pixelle-Video 还支持不少进阶玩法:

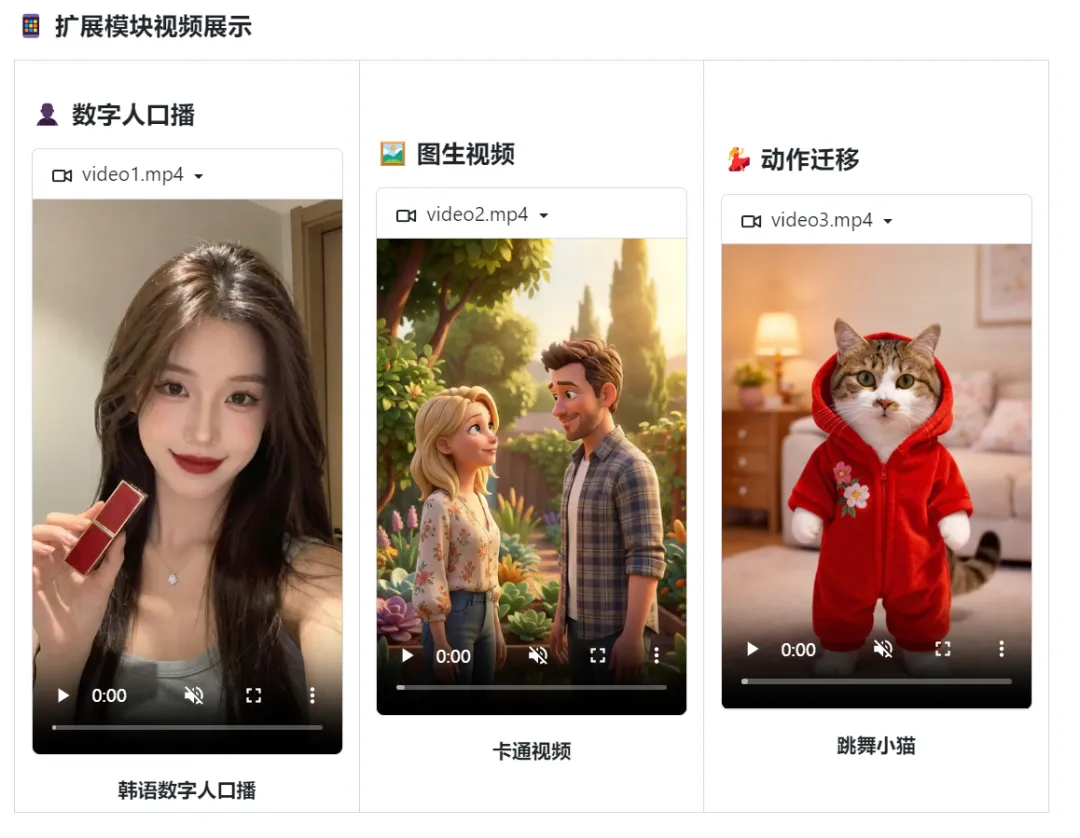

1. 数字人口播

上传一张照片,AI 就能生成一个”数字人”帮你播新闻。你甚至可以选择不同的音色,让它说中文、英文、或者其他语言,口型还能自动对上。以后做口播类账号,连真人出镜都省了。

2. 图生视频

你有一张很好看的图片?上传上去,AI 能把它变成动态视频。比如一张风景照,可以让云动起来、水流动起来,瞬间有电影感。

3. 动作迁移

这个功能更绝。你上传一段参考视频(比如一个人跳舞),再上传一张目标图片(比如一个卡通角色),AI 能把舞蹈动作”迁移”到卡通角色身上。做动画、做鬼畜视频的神器。

4. 自定义素材

如果你有现成的图片或者视频素材,也可以丢给它,AI 会基于你的素材智能生成脚本和剪辑方案,不会完全从零瞎搞。

技术小白能上手吗?完全能

很多人一听”开源工具”就头大,觉得要敲代码、配环境,很麻烦。但 Pixelle-Video 对小白非常友好,它提供了三种用法:

方法一:Windows 一键整合包(最适合新手)

去 https://github.com/AIDC-AI/Pixelle-Video/releases下载 Pixelle-Video-Windows.zip,解压后双击 start.bat,浏览器就会自动打开操作界面。全程不用写一行代码,连 Python 都不用装。

方法二:源码安装(Mac/Linux 用户)

如果你用的是 Mac 或者习惯用命令行,也很简单:

# 1. 下载项目git clone https://github.com/AIDC-AI/Pixelle-Video.gitcd Pixelle-Video# 2. 启动 Web 界面uv run streamlit run web/app.py然后浏览器打开 http://localhost:8501 就能用了。

方法三:Docker 部署(适合技术玩家)

如果你会玩 Docker,项目也提供了 Dockerfile 和 docker-compose 配置,一条命令就能跑起来。

配置上要注意什么?

第一次打开界面,需要填两个关键配置:

一个是 LLM(大语言模型)配置。 这是用来写文案的,推荐用通义千问(阿里自家的,API 成本很低),当然你也可以接 GPT、Claude、或者本地跑 Ollama(完全免费,但需要显卡)。

另一个是图像配置。 用来生成配图的,有两个选择:

-

本地模式:如果你本机跑了 ComfyUI(一个 AI 画图工具),填上地址就行,完全免费。 -

云端模式:懒得本地配环境的,可以直接填 RunningHub 等云服务的 API Key,按量付费,省事儿。

配置好保存,就可以开始生成视频了。

花钱吗?可以做到完全免费

这可能是大家最关心的问题。答案是:可以一分钱不花,也可以按需付费,丰俭由人。

|

|

|

|

|---|---|---|

| Ollama 本地大模型 + 本地 ComfyUI |

|

|

| 通义千问 API + 本地 ComfyUI |

|

|

| 全云端 API 方案 |

|

|

我自己用的是第二种方案,通义千问的 API 真的很便宜,做一次视频的成本可能还没你喝一口可乐贵。

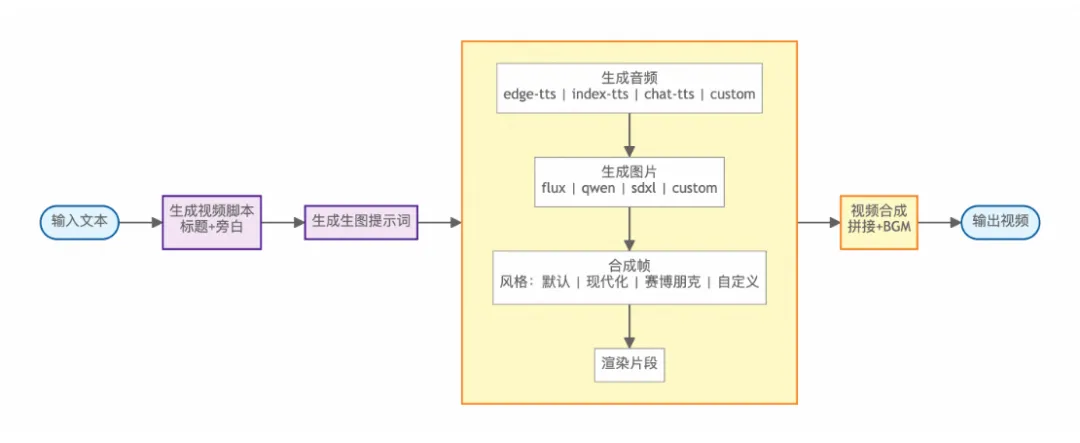

它背后的技术架构,懂的人会觉得很有品味

Pixelle-Video 不是简单地把几个 API 拼接在一起,它的架构设计很有想法:

-

ComfyUI 做视觉生成引擎:不绑死任何一个模型,你可以随意替换底层的画图/视频模型,想用什么用什么。 -

模块化流水线设计:文案、配图、配音、剪辑每一个环节都是独立的模块,可以单独替换或者升级。 -

Streamlit 做 Web 界面:轻量、简洁,打开浏览器就能用。

这种设计的最大好处是灵活。你可以把它当成一个”骨架”,往里面塞自己喜欢的模型,定制出完全符合你需求的视频工作流。

也不是没有局限性,说点实在的

当然,这个工具也不是万能的,作为过来人我得提醒你:

-

画质上限取决于你接的模型。如果你接的是普通模型,生成的视频就是”能看”的水平;想要电影级质感,需要接更好的模型,成本也会上去。 -

创意类、情感类的视频,AI 目前还替代不了人。比如你拍一个 Vlog 记录生活,或者做深度人物访谈,这种有温度的内容,还是得人来剪。 -

品牌广告、影视级作品,对画面一致性要求极高,AI 生成的东西可能会有细微瑕疵,需要人工后期精修。

但如果你是做知识科普、产品介绍、小说解说、新闻播报这类内容,Pixelle-Video 简直是为你量身定制的。

总结一下:谁应该用这个东西?

|

|

|

|---|---|

| 自媒体创作者/短视频博主 |

|

| 电商运营 |

|

| 教育培训机构 |

|

| 企业市场部 |

|

| 技术开发者 |

|

最后,怎么开始?

三步走:

-

打开 GitHub:搜索 AIDC-AI/Pixelle-Video,或者直接访问 https://github.com/AIDC-AI/Pixelle-Video -

下载整合包(Windows 用户)或者克隆源码(Mac/Linux 用户) -

配置好 API Key,输入主题,点击生成

官方还提供了中文文档和视频教程,遇到问题可以去看看。

写在最后

说实话,我第一次用 Pixelle-Video 的时候,看着 AI 在几分钟内把我脑中的一个模糊想法变成了一段完整的视频,那一刻真的有种”未来已来”的感觉。

它不是来取代创作者的,而是来把创作者从重复、繁琐的技术劳动中解放出来,让你把精力放在更重要的事情上——想出好点子。

毕竟,AI 可以帮你剪视频,但好创意,还是得靠人脑。

如果你也试过这个工具,欢迎在评论区分享你的体验。咱们下期见!

项目信息速查:

-

GitHub 地址:https://github.com/AIDC-AI/Pixelle-Video -

官方文档:https://aidc-ai.github.io/Pixelle-Video/zh -

开源协议:Apache 2.0(可商用)

夜雨聆风

夜雨聆风