从“影子AI”到“可见可控”:企业如何管好员工手里的AI工具?

安全治理 | 约1900字 | 阅读约7分钟

一、”影子AI”的崛起:当每个员工都成了”AI用户”

某跨国企业员工将内部核心代码粘贴到ChatGPT中调试,公司商业机密由此泄露。Gartner预测,到2027年,超过60%的企业数据泄露将与员工使用生成式AI工具有关。

“影子AI”——指员工未经IT部门批准,自行使用外部AI工具处理工作数据的现象——正在成为企业安全的最大盲区。员工为了提高效率,将客户数据、源代码、财务报表甚至战略规划输入ChatGPT、文心一言、通义千问、GitHub Copilot等AI工具中。他们不认为自己在违规,只是在”用工具解决问题”。

但AI工具的运作逻辑决定了:输入数据通常会被用于模型训练或存储在境外服务器。当你把客户信息粘贴进去的那一刻,数据安全的第一道防线就已失守。

对于网络安全企业而言,这一风险更为直接——安全运维人员、渗透测试工程师是首批AI工具使用者,也是最容易泄露敏感信息的人群。

影子AI的崛起:员工使用AI工具带来的数据泄露风险

二、四大高风险场景:AI工具正在泄露什么

场景一:代码泄露。 开发人员将包含API密钥、数据库连接字符串、业务逻辑的代码粘贴到AI代码助手中调试或优化。很多开发人员使用个人免费账号——云端代码完全不受企业控制。

场景二:客户数据泄露。 客服人员将客户咨询内容(含姓名、联系方式、业务需求)输入AI助手以加速响应。这些数据可能被用于模型训练,甚至被其他用户查询到。

场景三:内部文档泄露。 员工将战略规划、路线图、会议纪要等内部文档上传到AI工具以获取摘要。超过40%的员工承认曾将内部文档输入过AI工具。

场景四:供应链风险。 第三方供应商通过AI工具处理贵企业相关业务数据,成为数据泄露的”黑盒”——你甚至不知道数据被谁、在什么工具上处理过。

AI工具使用的四大高风险场景一览

三、企业AI安全治理框架:从”被动堵截”到”主动治理”

面对”影子AI”的挑战,简单的”禁止使用”策略已经失效。企业的应对之道不是”堵”,而是”管”。

识别。 企业需要搞清楚:员工在用什么AI工具?处理什么数据?哪些行为涉及敏感信息?通过流量审计、终端检测、应用发现等手段,构建”影子AI”全景地图。

评估。 对已发现的AI工具进行安全风险评估,包括数据存储位置、数据使用政策、是否支持企业数据隔离、是否提供API审计日志等。按风险等级分为”允许””限制””禁止”三个级别。

控制。 部署技术管控手段:对内建设AI使用网关,对外实施数据防泄漏策略。核心原则是:敏感数据不出企业边界,AI赋能不牺牲数据安全。

监控与响应。 持续监控AI工具使用行为,建立异常告警机制。当检测到员工向外部AI工具发送敏感数据时,自动阻断并触发事件响应流程。

AI安全治理四步闭环框架:识别、评估、控制、监控

四、技术落地的关键路径

AI安全网关。 在企业网络出口部署AI安全网关,对所有AI工具API调用进行代理、审计和控制。网关识别敏感数据、记录调用日志、根据用户角色和数据类型动态授权。这是目前业界公认最有效的技术手段。

数据防泄漏增强。 传统DLP主要关注邮件和文件共享,现在需扩展覆盖AI交互场景。DLP系统实时检测粘贴板内容、网页表单提交、API请求体中的敏感数据,在检测到风险时执行阻断、告警或脱敏处理。

IAM升级。 将AI工具纳入企业统一身份认证体系,实现基于属性的访问控制。不同角色、不同密级的员工看到的AI功能应当有所区别——普通员工可用AI写周报,但研发人员不应使用AI调试生产代码。

数据脱敏与匿名化。 员工使用AI工具前,系统自动对输入内容脱敏——真实姓名替换为代号,具体金额替换为区间值,IP地址替换为掩码。脱敏后的数据既能满足AI功能需求,又不泄露核心信息。

AI安全技术落地的四条关键路径

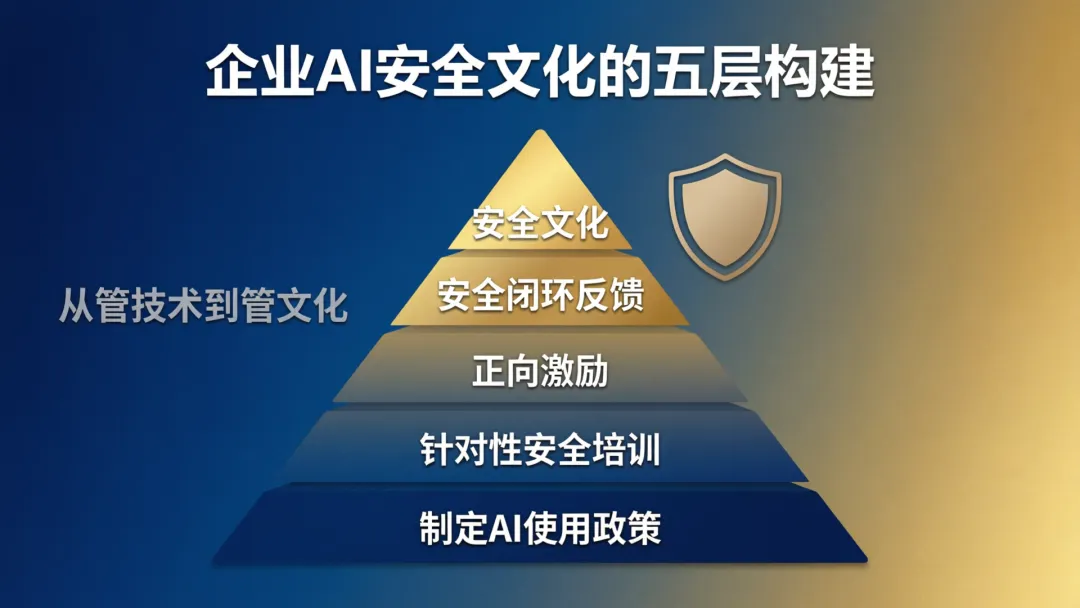

五、从”管技术”到”管文化”:建立AI使用的安全共识

技术手段再完善,如果员工没有安全意识,漏洞依然存在。

制定清晰的AI使用政策。 发布明确的AI使用指南,告诉员工:哪些AI工具可用于工作、可以处理什么级别的数据、哪些操作需要审批。政策要具体、可执行。

开展针对性安全培训。 传统网络安全培训很少涉及AI工具场景。企业应新增AI安全模块,通过真实案例让员工看到:一次不经意的”Ctrl+C/Ctrl+V”,可能带来多大损失。

建立正向激励机制。 鼓励员工主动报告AI工具使用中发现的安全隐患,定期表彰”AI安全使用标兵”,营造”安全使用AI”的文化氛围。

安全产品层面的实践。 安全厂商自身的AI能力建设同样面临上述挑战。我们在开发AI赋能的安全产品时,始终坚持”安全优先”原则——客户的每一行日志、每一个告警都在严格的访问控制和数据隔离策略下处理。AI是提升安全运营效率的工具,不是安全本身的新风险点。

企业AI安全文化的五层构建:从政策到文化

写在最后

“影子AI”的治理不是一场技术竞赛,而是一场管理变革。企业需要从政策、技术、文化三个维度同步推进,才能让AI真正成为安全的助力,而非隐患。

你的企业在使用AI工具时,制定了哪些管控措施?欢迎在评论区分享。

觉得有用请点击「在看」,让更多同行关注AI安全治理这个重要话题。

夜雨聆风

夜雨聆风