AI小火车开进课堂:7步学会机器学习,4问看懂AI靠不靠谱

今天开一趟“AI探险小火车”🚂。目标只有一个:把“机器学习”讲明白,像听故事一样轻松。

第一站:AI到底是啥?

你可以把 AI 想成两类同学:

- • 全能型同学(通用AI):啥都会,语文数学体育全满分。但现实里,这位同学还没正式入学。

- • 偏科但很强的同学(窄AI):只做一件事,但做得很棒。比如识别图片、语音助手、推荐视频。

我们现在用到的大多数 AI,都是第二种。

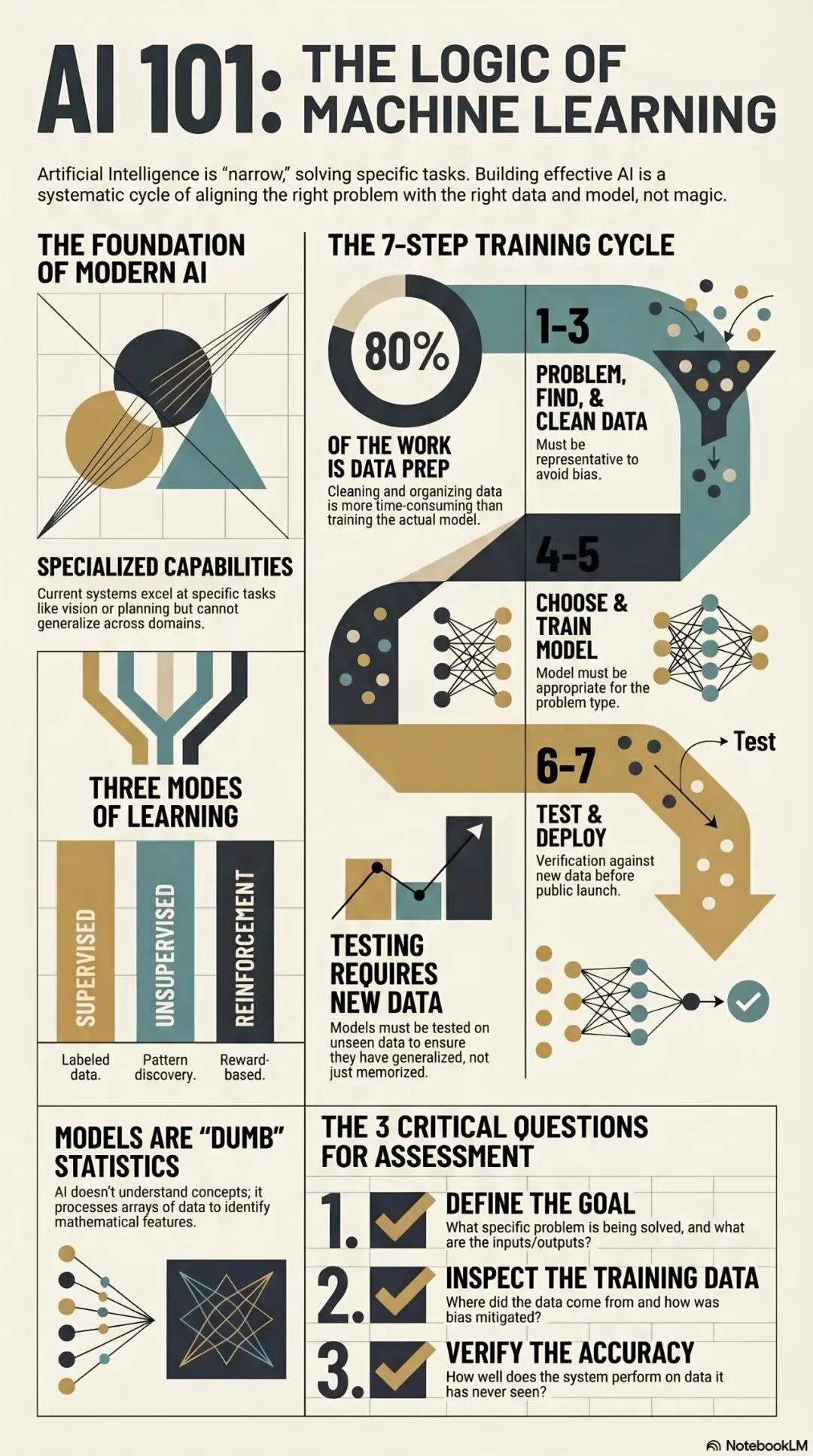

第二站:训练一个AI,要走哪7步?

想教会一个机器人认“猫和狗”,流程像做一道菜:

- 1. 定目标:你到底要它干嘛?(认猫狗?还是预测气温?)

- 2. 找数据:准备足够多的例子。

- 3. 洗数据:把乱七八糟的数据整理干净(这步最费劲,常占80%工作量)。

- 4. 选模型:挑一套合适的“脑回路”。

- 5. 开始训练:让模型反复学习,慢慢抓住规律。

- 6. 做测试:拿它没见过的新题考它,防止“死记硬背”。

- 7. 上线部署:让它去真实世界上岗。

一句话:不是模型越花哨越好,而是问题定义和数据质量先要靠谱。

第三站:看AI靠谱不靠谱,先问4个问题

专家建议,见到一个AI系统,先别急着鼓掌,先问:

- 1. 你的目标是什么? 输入是什么?输出又是什么?

- 2. 你用什么数据训练的? 数据从哪来?有没有偏见?

- 3. 你用了什么模型? 为什么选它?能不能解释它怎么做决定?

- 4. 在新数据上准确率如何? 只会做旧题不算本事,新题才见真章。

这4问就像体检表,能快速看出AI是“真学会”还是“装聪明”。

第四站:什么叫“可解释性”?

“可解释性”就像老师批作业时,除了给分,还告诉你错在哪。如果AI只能说“答案是这个”,却说不出“为什么”,那它就是黑箱。

- • 规则清晰的模型:像“如果…那么…”,容易解释。

- • 深度神经网络:能力强,但内部复杂,常像“魔法盒子”。

所以很多高风险场景(医疗、金融、公共服务)里,大家不仅要“准”,还要“讲得清楚”。

第五站:AI最容易掉进的坑

- • 数据偏差:训练集不全面,现实就会翻车。

- • 模型脆弱:稍微换个场景,表现大变样。

- • 只看技术,不看价值:技术再酷,不解决真实问题也白搭。

最好的AI,不是最炫的那个,而是最能服务真实目标、最经得起追问的那个。

小结:送你一张“AI通关卡”

当你下次再听到某个“超级AI”,记住这张卡:

- • 先看目标清不清

- • 再看数据干不干净

- • 然后看模型能不能解释

- • 最后看新数据表现好不好

只要这四关过了,AI才算真正“毕业”。

夜雨聆风

夜雨聆风