AI替你解忧,替不了你做人 |Vibe Coding 时代的三字心法 —— 品·断·悟 |TJU

— AGI 深度思考系列 —

🌿序:地铁上的那个姑娘

前几天的早高峰,我在地铁上注意到一位姑娘。

她拿着手机,两分钟翻完一篇文章,五秒钟翻下一篇,又五秒钟翻下下一篇。脸上没什么表情,手指却很忙。我再稍微环顾了一下四周,似乎很多人都是这样。在阅读,但仅仅是重复滑动手指的动作。如没入心真不知道。我看了一会儿,忽然有个念头——

我们这个时代的阅读,已经像试穿衣服了。每一件都摸一下、瞄一眼,没有一件真的穿在身上。

不是我们变浅薄了。是世界变得太碎片和焦虑了。

打开任何一个 App,文章是潮水,视频是潮水,AI 生成的图也是潮水。每一篇看起来都似乎很正确,每一段看起来都顺畅,每一句看起来都像那么回事——可你读完了,心里像被人轻轻拂过一下,什么都没留下。

直到我看到一个新词:

「slop」——美国 Merriam-Webster 词典选出的 2025 年度词汇之一,意思是「大量低质量、通常由 AI 批量生成的数字内容」。

原来不是我老了,是这个世界悄悄换了一种活法——机器在拼命生成堆积如山的内容,人在拼命地滑动走神。

这件事真值得深思:当 AI 可以替我们写、画、算、写代码、做 PPT、回邮件 — 一个普通人,手里到底还剩下什么,是机器拿不走的?

📜一、Karpathy 同时讲了两句话,听起来矛盾,其实通了

写这篇文章之前,我反复看了 Karpathy 这一年说过的两段话。这位 OpenAI 早期成员、特斯拉前 AI 负责人——大概是这个星球上最该懂 AI 的人之一。

第一段,是 2025 年秋天接受 Dwarkesh 播客采访的时候。他说——

「这是 Agent 的十年,不是 Agent 的一年。」

意思是:很多人以为 AI 今年就替代白领、明年就接管世界。可在他眼里,真正成熟的AI Agent,不只是“会回答问题”。它还需要有足够聪明的脑子,能观察世界的眼睛和耳朵,能熟练操作电脑的双手,以及像人一样不断学习、不断长大的能力。这些东西和能力,可能还需要十年才补得齐。

第二段,是同一年。Collins 词典把「Vibe Coding」选为 2025 年度词汇——这个词其实就是他本人带火的,意思是:你不再一行一行写代码,张张嘴对 AI 说「我要一个网页」「我要一个工具」,AI 替你把它写出来。

你看出来了吗?

一边说「AI 还差着十年呢」;

一边把「人人都能写代码」推成了世界年度词。

这两句话听起来自相矛盾,其实是同一件事的两面——AI 远远没有替代人,但 AI 已经在悄悄地,重新分类「什么样的人值钱」。

到了 2026 年 4 月的 Sequoia AI Ascent 大会,Karpathy 走上台,说了这样一句话——

❝We’re constantly using new tools to build new things — but we still need human taste, judgment, and understanding.❞▎ 我们不停用新工具造新东西——但人类的品味、判断、理解,仍然不可少。——Andrej Karpathy, Sequoia AI Ascent 2026

Taste、Judgment、Understanding 这三个英文单词的开头,合在一起是 TJU。

我把它们翻译成三个中文字,念起来更顺口、更容易记——

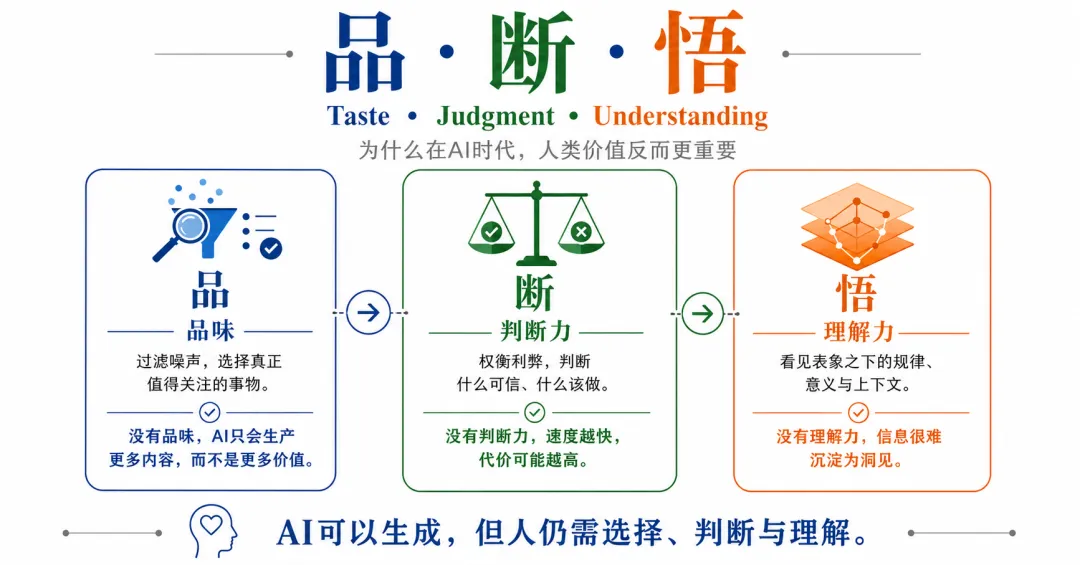

品。断。悟。

这就是这篇文章想跟你聊的事——AI 时代普通人的三字心法。

🌸二、品:舌头比头脑诚实

先讲第一个字:品。

我和 AI 配合写过几十万字。一开始觉得它简直是神——给我十个标题、二十种结构、三十种开头,从早上到晚上都不困、也不抱怨。直到有一天我发现一件怪事——

无论我让它怎么改,它写出来的东西,永远是一杯温吞水。

没什么错误。但是平淡。也不是水平差。就是喝起来没啥味道。语言流畅、结构齐整、观点稳妥、论据周全——读完像吃了一份温度刚刚好的预制菜。能吃饱,但你印象不深刻,食之无味弃之可惜。

我后来才看明白:这不是 AI 偷懒,恰恰这就是它最尽职的样子。

AI 见过几亿篇文章、几十亿张图。它推算出「大多数人会怎么写、怎么画、怎么说」,然后给你一个最不容易出错的版本。

可是亲爱的,创作的本质,刚好相反——

创作不是把平均值复述一遍,而是从平均值里站出来,喊一句:「不对,我不要这样。」

品味是什么?说穿了,就是这一声「不对」从哪里来。

一个常年喝好茶的人,舌头记得什么是真水的甘甜;

一个常年看好画的人,眼睛记得什么是真笔的力道;

一个常年读好书的人,心会记得什么是灵魂渲染出来的句子,什么是凑出来的字数。

品味不是高级,是诚实的感受——

是身体先于头脑的反应:你看到一个糟糕的东西,还没来得及分析,胃已经先收缩了一下。

这种反应,AI 内置不了。因为它的训练目标,刚好是让自己更像「大家的平均值」。可品味的根,千奇百态,各有千秋。

那这种舌头怎么练?

我自己的笨办法只有一个——长期阅读经典和历久弥新的东西。

好文章、好产品、好商业案例、好演讲、好设计——别只刷信息流,建一个自己的「真东西收藏夹」;用Obsidian创建自己的外脑的LLM。织一个永不遗忘的自己|Obsidian + LLM Wiki:Karpathy 卡帕西推荐的第二大脑大模型构建术每周往里面塞几件自己珍视,反复咀嚼的宝贝,并且写一句话:它好在哪里?

看经典的好东西,看多了,你对温吞水,压缩饼干式的东西就会自动皱眉。

到那一天,你就有舌头,有阅读的品味了。

⚖️三、断:警惕那些「太顺」的话

第二个字,断。

如果说品味管的是「值不值得留」,断:管的就是「能不能信」。

这两件事看起来差不多,其实差得很远:失之毫厘谬以千里 — 美的东西不一定是真的,真的东西也不一定都美。

AI 最让人放下警惕的地方,不是它会胡说,而是它会「极有水平地胡说八道」。

它的语气自信,结构齐整,引用也像模像样。九句话都对,第十句话错;大方向对,关键数字错;逻辑读起来很顺,可前提其实站不住。

你想过没有,为什么我们经常被它欺骗?

因为我们的大脑有一个偷懒的习惯——

一段话只要读起来够顺,大脑就会偷偷给它盖一个「对的」的章。

可问题是,「读起来顺」是 AI 的看家本领;「对」从来不是。

这就是我想造的一个新词——「太顺的话要小心」。或者义正严辞,一本正经且逻辑性很强的语言;读起来像滑过一块没有摩擦力的鹅卵石、一气呵成、一字不卡——这时候,警觉的不是大脑,是身体。

MIT 的 CSAIL 实验室在 2026 年初做过一项研究,给出了一组让我印象很深刻的数字——

在美国经济中大量文本任务上,给 LLM 提供正确信息的前提下,它在 60% 的任务里能达到经理眼中的「最低可接受」水准;但只有 26% 达到「优秀」水准。

中间这 34% 的差距,就是「能用」到「真好」之间的距离。

AI 替人类填掉了 60%,剩下这 34%,是你赚钱的地方,是你不可替代的地方,也是你「断」字要去抛光和增强地方。

怎么练这种判断力?我用一个朴素办法——

每次看到一个让你心里一动的结论,停下来问自己三件事:

第一,这个话,根基在哪里?是哪项研究?哪一年?哪个数据库?AI 说「研究表明」「数据显示」的时候,往往答不出这一层——就在那一刻,真相暴露。

第二,这个话,反过来说会怎样?什么情况下它不成立?谁会反对?历史上有没有类似的判断翻过车?任何一个真正深刻的结论,都经得起反例追问;经不起的,往往是漂亮的废话。

第三,这个话,能让我明天做点什么不一样的事吗?激发怎样的行动。如果不能,它就只是「让你感觉懂了」的按摩——按完很舒服,第二天还是原样。

这三问,听起来朴素,但把它变成习惯,你会发现自己慢慢长出了一种新东西——

一种像老中医搭脉一样的本能。

老中医不是不信你的话,他是知道:人哪里容易骗自己,话哪里容易藏破绽。这种功夫,是几十年看着同一个东西、反反复复见到它出错,才慢慢长出来的直觉的判断gut feeling。

AI 时代,这种本能没有过时——它比任何时代都贵。

🌊四、悟:水落进自己的杯子

第三个字,悟。这个字最难讲,可一旦你懂了,前两个字才会真的鲜活起来。

「品」告诉你「什么值得留」,断告诉你「什么值得信」,

悟告诉你——

「这件事,对我,意味着什么。」

AI 可以总结一本书,但不等于你读懂了这本书;

AI 可以解释一个行业,但不等于你看明白了这个行业;

AI 可以把一个复杂问题讲得顺顺当当,但顺,不等于深入。

我想给「悟」找一个具象的画面——

想象一壶水。它倒进玻璃杯,是清亮的;倒进青瓷杯,是温润的;倒进锡壶,是利索的;倒进你的杯子,是只有你认识的那个味道。同一壶水,但容器不一样,结果就不一样。

AI 给你的所有答案,都是那壶水。

可你的杯子是什么样子,AI 不知道。每个人都是不同的容器,会给予这水不同的色彩和味道。

它不知道你今年多大、心里有什么牵挂、上一份工作受过什么委屈、今天早晨和家人吵了什么、为什么你看到「家人」这两个字会停一下——

它不知道你的处境也感受不了。

AI 没有家庭,没有责任,没有昨夜的失眠,没有今早的犹豫,没有三十年走过的弯路。它可以模拟「理解」这件事的样子,但它无法替你「承受」这件事的代价。

所以,所谓悟——

就是把答案,从 AI 的杯子里,倒回你自己的杯子里。

怎么练?也是三件事——

第一,看完一个洞见,先用自己的话复述一遍。讲不出来,就是没懂。一个能用自己的三句话讲清复杂问题的人,永远不会被替代。

第二,把它嵌入到自己的真实生活里——它影响我的工作吗?影响我的收入吗?影响我下周和孩子的那个对话吗?没有「和我」产生互动和链接,理解就是漂在水面上的一粒浮尘。

第三,问自己一句话:明天,我会因为这个洞见,做一件不同的事吗?没有促进行动的洞见,分文不值。

能稳定写出第三条的人——

不只是懂了,是「悟到了」。

🔗五、品·断·悟,是一道菜,不是一份清单

写到这里,必须澄清一件事——

品、断、悟不是三个并排的能力,而是一道菜的三个动作。

品,是看见食材就知道好不好;断,是试一口就知道味道对不对;悟,是端上桌前那一刻问自己——这道菜,配今天这位客人吗?

缺一不可——

有品没断,你审美是对的,但容易被漂亮的错误骗了挑了一筐颜值高、其实坏了的水果回家。

有断没悟,你识别得出真假,但永远停在「我知道」,做不到「我会怎么办」— 像一个知道一千种菜谱、却从来没下过厨的人。

有悟没品,你有处境感,但被淹在 AI 生成的洪流里出不来——你的杯子是好杯子,可水是别人的水。

三个字合起来用,才有「人」的位置。

🛠️六、把 AI 当成你的三个搭子

讲到这里,可能有人会问:那是不是要远离 AI?

恰恰相反。

我自己重度用 AI——但我用它的方式,可能跟很多人不太一样。我不把它当替我思考的工具,我把它当三个不同的搭子——

第一个工具,叫雷达。每天有几百条新闻、几十份报告、上百个推送——我让 AI 替我先扫一遍,告诉我哪十条值得我亲自坐下来看。它干的活是「过滤」,我干的活是「决定哪些值得深挖」。这一步,练的是品。

第二个搭子,叫陪练。这一条最重要——你千万别只让 AI 夸你。

我每写完一篇文章,就让 AI 扮演最苛刻的反方:「你来挑这篇文章里所有立不住的逻辑、所有可能被人反驳的假设、所有让人觉得你在自我感动的句子。」一个只会赞同你的 AI,是最危险的 AI——它会让你的判断力,以你看不见的速度退化。这一步,练的是断。

第三个搭子,叫初稿机。文章框架、PPT 大纲、邮件草稿,都可以让它先写。但我从不让它走完最后一公里——

最后那一公里,必须我自己走。

为什么?因为最后一公里里发生的一切——每一处取舍、每一次删减、每一句加重、每一个停顿——

就是「你」这个人,存在过的证据。

一篇文章如果从头到尾都是 AI 写的,它确实「能用」。但读的人会感觉到一种很难形容的空——像走进一间装修齐全、却没人住过的房子。家具都对,灯也都亮着,可你不想坐下来。

那个「想坐下来」的感觉,不在 AI 那里,在你的最后一公里里。

🌅结语:写给所有不愿将就的人

亲爱的读友们,写到这里,我想跟你说一句心里话——

AI 时代真正的分水岭,不在于你会不会用 AI。

而在于你用 AI 之后,自己变成了什么样的人。

有的人用 AI 逃避思考——AI 越强,他越懒;AI 越懒得帮他想,他就越不会想;最后连自己有没有判断力,都说不清了。

有的人用 AI 训练思考——AI 越强,他越用心;AI 给的越多,他选得越准;最后他练出了一双连 AI 自己都想借走的眼睛。

差别就在三个字:

品。断。悟。

这件事,与年龄无关,与起点无关,与你今天会不会写代码也无关。

它只跟一件事有关——

你愿不愿意,在这个生成过剩的时代,做一个不愿将就的人。

不愿将就那种「读起来顺,其实没营养」的文字;

不愿将就那种「听起来对,其实站不住」的判断;

不愿将就那种「能交差就行,谁也没认真过」的活儿。

这种不将就的人,机器越多,反而越显眼。

因为机器替你解忧,能干无数件事——

但有一件事它替不了——它替不了你做一个「临在」的人。一个用自己的舌头尝过、用自己的眼睛看过、用自己的处境想过的人。

AI 替你解忧。可解忧不是一切。

人这一辈子,最值钱的东西,从来不在被替代的部分里。

它在你那个,从二十岁、三十岁、四十岁一直走到此刻 — 一只属于你的、独一无二的杯子里。

好好端着它。

它就是你的当下。

💬 你最近有没有读到一篇「读起来很顺,但什么都没记住」的文章?是哪句话让你停下来的?留言聊聊,让我们一起练「品·断·悟」。

· · · · · · · · · · · · · · · · · · · · · ·

关注【海谛的AI漫游】,获取更多洞见

「用AI工具,看见时代的底牌。」

喜欢这篇文章的伙伴,请一定点赞、分享和推荐❤️给朋友。

⚠️ 本文为思考分享,不构成任何投资或职业建议。

信息来源

[1] Andrej Karpathy interview, Dwarkesh Podcast, “AGI is still a decade away”, 2025年10月

[2] Stephanie Zhan, “Andrej Karpathy and I are back at Sequoia AI Ascent 2026”, LinkedIn, 2026年4月

[3] Collins Dictionary, Word of the Year 2025: “Vibe Coding”, 2025年11月

[4] The Verge, “Merriam-Webster’s 2025 word of the year is ‘slop'”, 2025年12月

[5] Stanford HAI, The 2025 AI Index Report, 2025年4月

[6] MIT CSAIL, “New MIT research overturns prior view about how AI capabilities could overtake human workers”, 2026年1月

[7] NIST, Artificial Intelligence Risk Management Framework (AI RMF 1.0), NIST AI 100-1

夜雨聆风

夜雨聆风