OpenClaw的龙虾长出手脚了,这次是真能帮你点鼠标的那种

OpenClaw的龙虾长出手脚了,这次是真能帮你点鼠标的那种

事情是这样的。

前两天刷到Peter又在疯狂更新Peekaboo,v3.1.0、v3.1.1、v3.1.2一口气连发三版,我寻思了一下,这人是不是被什么东西刺激到了。

去翻了翻时间线,确实有点意思。Peekaboo这个项目其实去年11月就在搞了,beta1到beta4磨了快半年,突然这两天跟开了狂暴模式一样疯狂大更新。

为啥急,后面再说。先说说这玩意到底干了什么让我觉得值得写一篇。

你用AI Agent的时候,有没有遇到过这种尴尬,你让Claude Code帮你干活,它确实能帮你打开浏览器、跑个脚本、查个文件,但一旦涉及到屏幕上更细的操作,比如点击那个按钮、把这段文字输到那个输入框、拖那个文件到那个文件夹,它就开始装瞎了。

最后那一步还是得你自己上手。

说真的,这种感觉太不爽了。就像你雇了个助手,什么都会说,但就是不干活,关键时刻还得你亲自操刀。

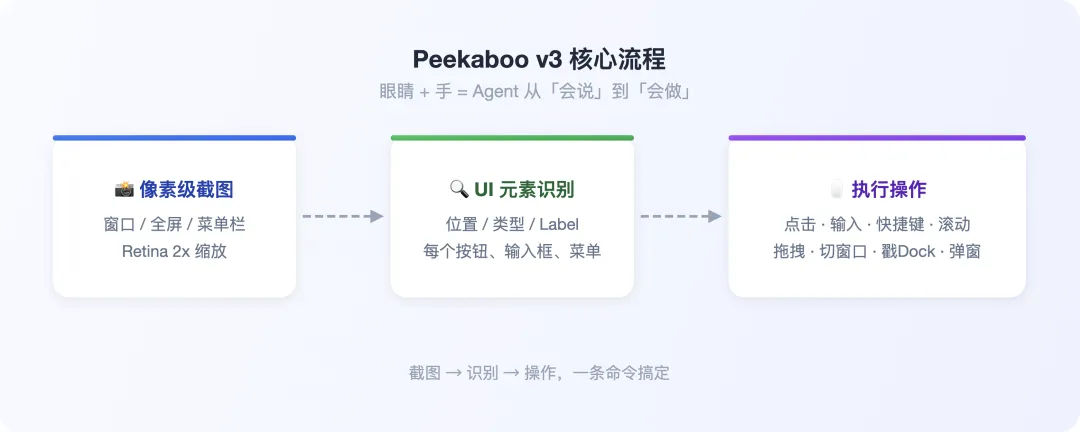

Peekaboo v3干的事就是把这道墙给凿穿了。

它给你的Mac装了一双眼睛和一双手。眼睛是像素级截图加上UI元素识别,手是点击、输入、快捷键、滚动、拖拽、切窗口、切桌面、戳Dock、点系统弹窗,一整套人类操作Mac会干的事。

我第一次跑通的时候真就愣住了。。。

你想想看,以前Agent是指手画脚的甲方,告诉你「你需要去点那个按钮」,现在是真能自己上手点。

先说「看」的能力。

Peekaboo能截全屏、截单个窗口、截菜单栏,支持Retina 2x缩放,这不是重点。重点是它能读取macOS上每个UI元素的位置、类型和label,等于它不只是看到了一张图,它看到了每个按钮在哪、每个输入框是什么、每个菜单项叫什么名字。

这跟普通截图有本质区别。普通截图是给AI一张照片让它猜,Peekaboo是给它一张带标注的地图让它找。

然后是「动」的能力。

这条命令能截屏并点击一个按钮,看到没,一条命令就搞定了,截屏、定位、点击三步合一。

peekaboo click --on "Reload this page" --snapshot "$SNAPSHOT"

它能做的事情太多了,点击、输入文字、按快捷键、滚动、拖拽、切换窗口、切换Space、操作Dock、处理系统弹窗,甚至还能直接设置UI元素的值和触发无障碍操作。

这不是脚本男孩的玩具,这是真刀真枪的桌面自动化。

但是,Peekaboo v3真正让我觉得牛逼的不是这些基础能力,而是两个杀手锏。

第一个,自然语言Agent模式。

你不用写什么复杂脚本,直接用大白话就行。

peekaboo agent "Open Notes and create a TODO list with three items"

一条自然语言指令,它自己截图、自己识别、自己点、自己输入,全程不需要你干预。我第一次跑这个的时候,看到备忘录自己弹出三个待办项,那种感觉太特么赤鸡了。

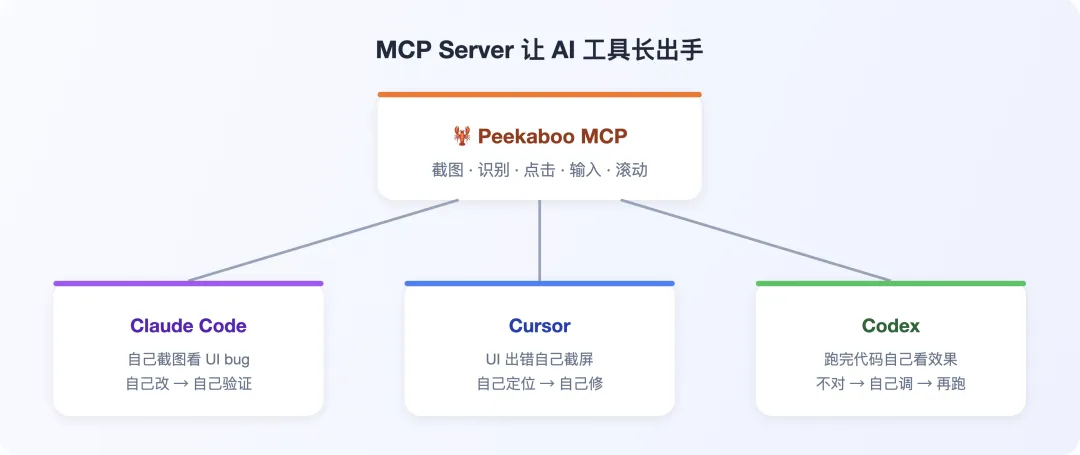

第二个,MCP server。

这才是真正改变游戏规则的设计。Peekaboo把所有能力打包成MCP协议,直接喂给Claude Code、Cursor、Codex这些AI编程工具。

什么意思呢,以前你在Cursor里写代码,UI出了bug,你得自己截图发给Cursor看。现在Cursor自己就能截图、自己看、自己改、自己再跑一遍验证,全程不用你插手。

这个设计太聪明了,不是再造一个AI工具,而是让现有的AI工具长出手来。

安装方式四条路,各取所需。

先贴一下项目地址,https://github.com/openclaw/Peekaboo,3890星,macOS原生Swift写的。

说真的,这项目的安装体验是少有的舒服,四条路,哪种习惯就用哪种。

第一条路,你用命令行搞自动化的。

Homebrew一行,别的啥都不用管。

brew install steipete/tap/peekaboo

装完验证一下

peekaboo --version

看到版本号就OK了。然后截个图试试

peekaboo image --mode screen --path ~/Desktop/test.png

桌面多出一张截图,就说明装好了。

第二条路,你用Claude Code、Cursor、Codex这些AI编程工具的。

MCP server模式,更香。因为装了之后,你的AI工具自己就有了截图和控制Mac的能力。

npx -y @steipete/peekaboo mcp

然后在你的AI工具里加一下MCP配置

{"mcpServers": {"peekaboo": {"command": "npx","args": ["-y", "@steipete/peekaboo"],"env": {"PEEKABOO_AI_PROVIDERS": "openai/gpt-5.5,anthropic/claude-opus-4-7" } } }}

第三条路,你不想碰命令行。

去GitHub Releases直接下Mac桌面版app,拖进Applications就行。有可视化UI,截图反馈、权限管理全部图形化,不看终端一眼也能用。

第四条路,你是Swift开发者想嵌到自己App里。

Swift Package Manager直接引,GitHub Releases里也有Framework包。

对了,如果你是OpenClaw用户,更简单,直接装Skill就行。相当于给龙虾装了个操作Mac的插件,录屏和辅助功能权限走OpenClaw一次性过,不用再单独给Peekaboo开一遍。

说到这个,我之前最头疼的就是权限问题。macOS的屏幕录制和辅助功能权限,每个工具都要单独授权一遍,搞得我每次装新工具都要去系统设置里点半天。OpenClaw整合之后确实省心不少。

装好之后第一次用,系统会弹窗问你要屏幕录制和辅助功能权限,全点允许就行。这步躲不掉,macOS的安全机制,任何截屏和自动化工具都绕不过去。

回到开头那个问题,Peter为啥突然狂更新。

其实也很好理解。这两年AI操作电脑这条赛道卷疯了,Anthropic的Computer Use、OpenAI的Operator、各种browser-use工具,全在抢这个位置。开源Agent领域也是,各种Computer Use替代方案疯狂冒头。

Peter必须快。不快就被后来者追上了。

而且说实话,Peekaboo在macOS这个赛道上有一个天然优势,它是原生Swift写的,不是套个浏览器脚本那种半吊子方案,像素级截图、无障碍API调用、系统级弹窗处理,这些都是系统原生能力,不是什么hack出来的workaround。

这个护城河还是蛮深的。

我自己用了一周下来的感受是,Peekaboo目前最好的使用场景不是那种全自动「帮我做完一整个工作流」,而是半自动的「帮我在这个界面上点几下」这种小但频繁的操作。比如在某个App里反复点来点去填表单、在系统设置里改配置、在测试的时候反复跑UI操作验证。

全自动化当然也能做,agent模式就支持,但说实话目前的AI视觉理解还不够稳,复杂场景偶尔会翻车。简单的操作它很靠谱,复杂的还需要人盯着。

不过这已经是质的飞跃了。之前Agent是会说不会做,现在是会做但偶尔做不好,这完全是两个层面的事情。

从不会做到会做,是0到1。从做不好到做好,是1到100。Peekaboo v3完成的是0到1。

如果你也在用AI Agent做Mac上的事情,我真心建议装一个试试。不用全自动化,哪怕只是用它帮你点几下按钮、填几个输入框,那种AI真的在替你干活的感觉,跟以前那种只会说不会做的体验完全不一样。

龙虾这次是真的长出手脚了,不是摆设,是真能用的那种。

夜雨聆风

夜雨聆风