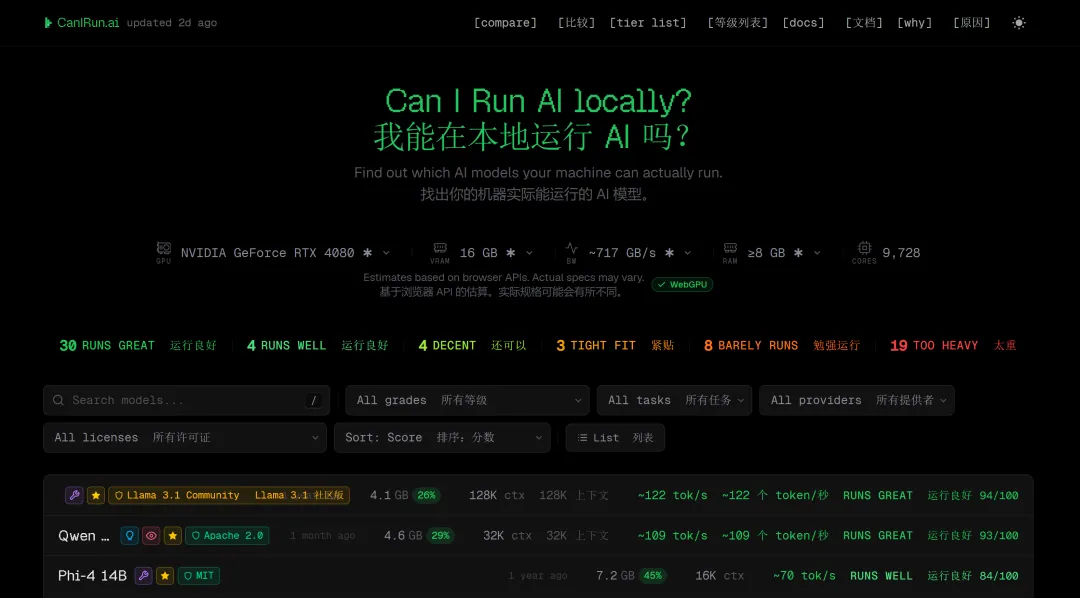

别再瞎下AI模型了!这个神器一秒测出你的电脑能跑啥

今天给大家安利一个免费无广、即用即走的神仙工具https://www.canirun.ai/Can I Run AI,堪称本地AI模型的「硬件体检官」,不用复杂操作,一秒精准匹配你的设备能驾驭的AI模型,从此部署AI不踩雷、不白耗流量!

为什么需要它?本地AI部署的痛点全解决

现在开源AI模型遍地开花,Llama、Qwen(通义千问)、Mistral、Gemma等模型覆盖聊天、代码、推理、多模态等所有场景,本地部署不仅隐私性拉满,还能摆脱网络延迟和API调用限制。

但显存不够、硬件不匹配成了最大难题:8G显存想跑14B模型,16G内存想试MoE大模型,最后只能以「报错」收场;新手看不懂模型参数、量化版本,对着一堆Q2_K、Q8_0版本无从下手;不同品牌显卡(NVIDIA/AMD/Intel)、苹果M系列芯片的适配性差异,更是让人摸不着头脑。

而Can I Run AI直接把这些问题一网打尽,无需下载、无需安装、无需懂专业知识,打开网页就能得到精准答案,堪称新手友好、老手高效的必备工具。

核心亮点:这款工具到底强在哪?

🌟 硬件库超全,覆盖所有主流设备

不管你用的是苹果M1-M5全系列芯片(从8G的M1到192G的M4 Ultra)、NVIDIA RTX全系列显卡(RTX 30/40/50系、专业Quadro/A系列)、AMD RX显卡(RX 5000/6000/7000/9000系),还是Intel Arc核显、移动端Adreno/Mali/Xclipse显卡,甚至是入门级的UHD核显,都能在工具里找到对应的型号,堪称「硬件百科全书」。

🌟 模型库超新,热门模型一网打尽

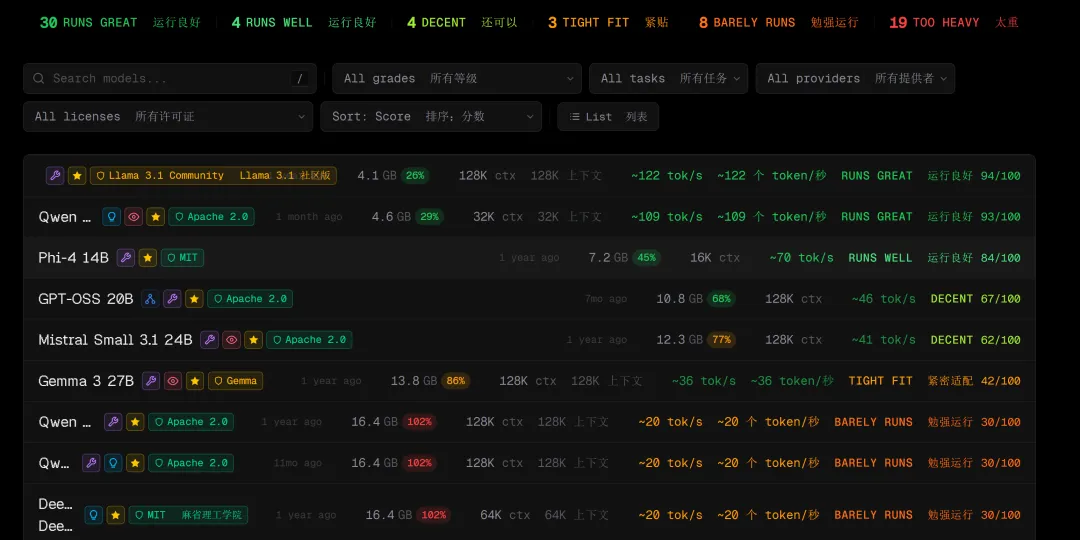

工具收录了目前全网最火的上百款开源AI模型,覆盖国内外主流厂商,从0.8B超轻量边缘模型到1T参数超大MoE模型,全量级覆盖:

-

海外爆款:Llama 3/3.1/3.2/4系列、Mistral全系列、Gemma 2/3、Phi 3/4、Mixtral MoE

-

国产之光:Qwen(通义千问)2.5/3/3.5全系列、GLM-4(智谱)、DeepSeek R1/V3、Kimi K2

-

专业方向:代码模型(Qwen Coder、Devstral)、推理模型(Phi Reasoning、DeepSeek)、多模态模型(Llama Vision、Qwen 3.5 multimodal)

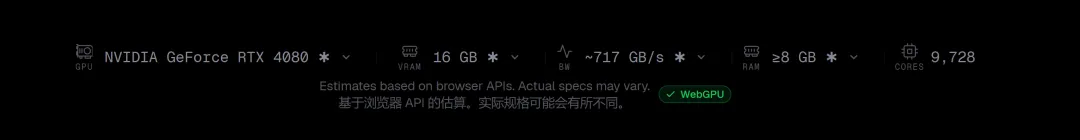

🌟 检测结果超精准,维度超详细

选定你的硬件型号后,工具会直接给出每款模型的适配结果,核心信息一目了然,新手也能轻松看懂:

-

显存占用:精准标注模型量化后的实际占用显存(如Llama 3.1 8B占用4.1GB);

-

硬件占用率:显示模型对当前硬件的显存占用比例(如51%、90%);

-

运行评级:用Decent(流畅运行)、Tight fit(勉强适配)、Barely runs(艰难运行)、Too heavy(无法运行) 四个等级直观标注,还附带百分制评分;

-

模型核心信息:发布厂商、参数量、发布时间、模型架构(Dense/MoE)、支持场景(chat/code/vision/reasoning)、上下文窗口(ctx);

-

量化版本:标注模型支持的量化版本(Q2_K-Q8_0/F16),方便后续精准下载。

🌟 操作超简单,零基础也能上手

整个工具没有复杂的按钮和设置,三步就能得到结果,全程不超过10秒:

① 打开网页https://www.canirun.ai/Can I Run AI,在顶部选择你的硬件型号(支持搜索,直接输入显卡/芯片型号即可);

② 网页自动加载并匹配所有模型的适配结果,支持「All models」查看全部,也可按场景筛选;

③ 查看结果,选择「Decent/Tight fit」的模型,直接根据标注的量化版本去开源平台下载即可。

🌟 网页端即用,跨平台无限制

基于WebGPU技术开发,支持所有主流浏览器(Chrome/Edge/Safari/Firefox),Windows、Mac、Linux、平板甚至高端手机都能打开,无需安装任何软件,不占本地内存,临时使用超方便。

实用场景:谁最需要这个工具?

✅ AI新手:想入门本地部署,不知道自己的电脑能跑啥模型,用它快速定方向,避免盲目下载;

✅ 开发者/研究员:需要测试不同模型在不同硬件上的表现,用它快速筛选适配模型,提升工作效率;

✅ 硬件升级党:想换显卡/电脑,用它提前测试目标硬件能跑的模型,精准匹配升级需求,不花冤枉钱;

✅ 场景化使用:做代码开发选Qwen Coder,做日常聊天选Llama/Mistral,做多模态选Qwen 3.5/GLM-4,用它快速筛选对应场景的适配模型。

小技巧:用好这个工具,部署AI更高效

-

优先选Decent评级模型:这类模型硬件占用率低,运行流畅,体验最好,是新手首选;

-

量化版本看需求:新手优先选Q2_K/Q3_K_M低量化版本,显存占用更小,入门更轻松;追求模型效果选Q5_K_M/Q8_0版本;

-

苹果芯片专属福利:M系列芯片对开源模型适配性极佳,8G的M1/M2就能流畅运行3B以内的轻量模型,32G以上的M Max/Ultra可挑战中大模型;

-

NVIDIA显卡优势:RTX 30/40系显卡支持CUDA,对大部分模型的加速效果更好,12G以上显存可尝试7B-14B模型;

-

轻量模型首选:如果硬件配置一般,优先选Qwen 3.5 0.8B/2B、Llama 3.2 1B、TinyLlama 1.1B等超轻量模型,手机/平板也能轻松跑。

写在最后

在AI大模型全民化的时代,本地部署已经不再是技术大佬的专属,而https://www.canirun.ai/Can I Run AI就是让普通人轻松入门本地AI的。

它没有花里胡哨的功能,却把「精准、高效、实用」做到了极致,直接解决了本地部署最核心的硬件匹配问题,让每一台设备都能发挥最大的AI价值。

如果你也想体验本地AI的乐趣,摆脱网络和API的限制,赶紧收藏这个工具👉https://www.canirun.ai/,下次部署模型前,先查一查,告别踩坑!

最后想问大家:你的电脑是什么配置?想尝试哪款AI模型?评论区聊聊,一起交流本地部署技巧~

✨温馨提示:收藏本文+工具链接,下次需要直接找,不迷路~

夜雨聆风

夜雨聆风