苹果向“垃圾应用”宣战:App Store 封禁潮下的 AI 软件分发危机

全球软件生态正处于一场史无前例的剧变前夜。2026 年,当我们回顾这一年的技术轨迹时,苹果公司对“垃圾应用”(Slop)的宣战,或许将被视为传统分发范式崩塌的里程碑事件。随着“情绪编程”(Vibecoding)的兴起,任何人都能在几分钟内通过 AI 生成并发布应用,这不仅令 App Store 维持了十余年的审核机制难以为继,更触动了苹果作为数字守门人的核心利益。

一、 围墙花园的裂痕:苹果的“垃圾应用”战争

长期以来,苹果的 App Store 凭借严格的审核标准和封闭的生态系统,确立了其在全球软件分发领域的绝对霸权。然而,这一霸权正面临来自 AI 浪潮的直接挑战。近期,苹果开始基于政策原因大举封禁 Replit 和 Vibecode 等支持“即时编程”的应用[7]。表面上看,这是出于对应用质量和审核流程的维护,但在更深层次的行业观察者眼中,这标志着传统应用商店模式与 AI 原生分发模式之间的正面冲突。

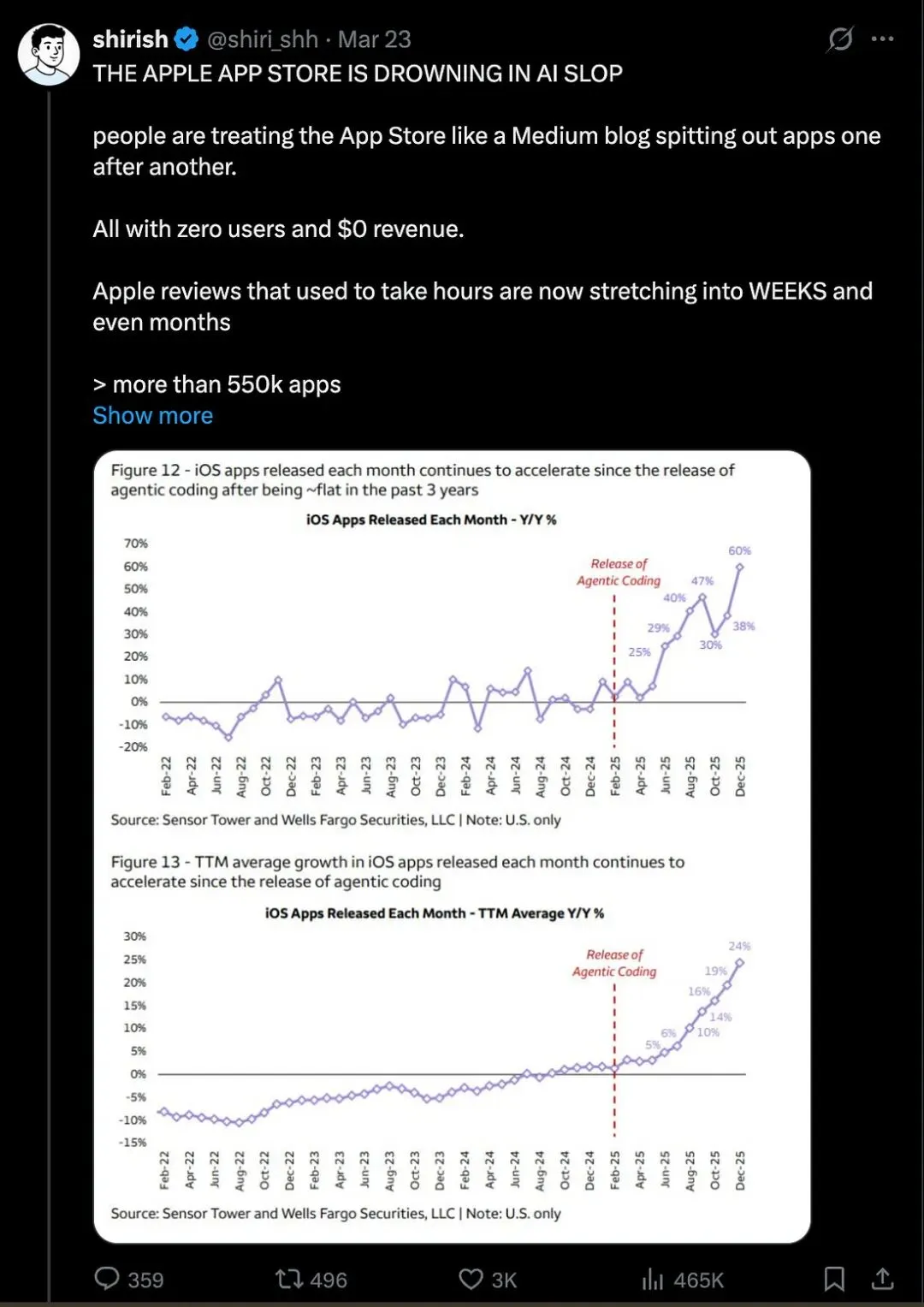

我们必须关注到一份关键的数据图表:随着 AI 辅助开发工具的普及,应用商店中低质量、重复性极高的“垃圾应用”呈现出指数级增长。这种现象不仅让传统的审核人员疲于奔命,也稀释了高质量应用的可见度。更重要的是,像 Dreamer[4] 这样的 AI 原生应用商店正在崛起,它们提倡的是一种完全不同的分发逻辑:基于 Web、即生成即使用,完全绕过了苹果的“围墙花园”。

这种趋势引发了一个激烈的行业讨论:AI 是否正在扼杀传统的 SaaS 模式[5]?当一个 18 岁的辍学高中生能凭借 AI 工具迅速开发出一款功能齐备的应用,并寻求上亿美元的退出机会时[6],传统的软件开发周期和估值模型都已失效。2026 年被定义为“垃圾应用战争”的关键元年[8],这场战争的胜负将决定未来十年软件分发的权杖究竟掌握在谁的手中。

二、 供应链危机:LiteLLM 漏洞暴露的 AI 底座脆弱性

如果说分发层面的危机还只是商业博弈,那么近期爆发的 LiteLLM 供应链污染事件则给整个 AI 工程界敲响了安全警钟。据多个安全渠道证实,PyPI 上的 LiteLLM 1.82.8 版本已被恶意代码渗透[3]。攻击者利用了 Python 的 .pth 文件漏洞,使得恶意代码在解释器启动时无需显式导入即可执行,这种极具隐蔽性的攻击手段让传统的代码审计几乎失效。

资深技术专家 Andrej Karpathy 对此进行了详尽剖析[16]。他指出,这次攻击的 blast radius(爆炸半径)远超想象,包括云端凭证、SSH 密钥、Kubernetes 配置、CI/CD 密钥甚至是 shell 历史记录,都在其窃取范围内。更令人不安的是,由于 DSPy 等大量主流 AI 框架都深度依赖 LiteLLM,这次污染具有极强的传染性。

英伟达资深研究科学家 Jim Fan 提出了一个更为深刻的见解:在智能体(Agent)时代,整个文件系统都已成为攻击面。当 AI 智能体在文件系统中自主读写、调用工具时,任何一个被加载到上下文中的文件都可能成为注入攻击的载体。这迫使开发者必须重新思考智能体软件的权限管理。过去那种 --dangerously-skip-permissions 的粗犷式开发模式已经走到了尽头,“去情绪化”和严格的权限沙箱将成为 2026 年 AI 产品的标配[11]。

三、 战略大收缩:OpenAI 与微软的资源重组

在技术底层波澜起伏的同时,科技巨头内部的权力结构和战略重点也在发生剧变。最为引人注目的是,微软 AI 再次展现了其强大的“人才收割”能力,成功“以雇佣代收购”了 AI2(艾伦人工智能研究所)的核心领导层,包括 Ali Farhadi 和 Hanna Hajishirzi 在内的顶尖专家已悉数加入微软 Superintelligence 团队[1]。这一举动引发了学术界的广泛担忧:当开放研究机构的顶尖人才被超大规模算力持有者垄断,开源研究的未来在哪里?

与此同时,曾经风光无限的视频生成模型 Sora 竟成了 OpenAI 战略调整的牺牲品。根据多方消息,OpenAI 正在关闭 Sora 的独立应用和产品足迹,以释放极其紧缺的计算资源[2]。这是“侧线任务大屠杀”的开始,OpenAI 显然正在收缩战线,将全部精力集中在代号为“Spud”的新一代推理大模型上。

为了应对日益增长的公众质疑和监管压力,Sam Altman 宣布 OpenAI 基金会将在未来一年投入至少 10 亿美元,用于提升 AI 韧性和应对各类社会风险[31]。这种一边收割人才、一边缩减边缘产品、同时加大安全投入的做法,清晰地揭示了大模型厂商在“算力紧缺”与“监管合规”双重压力下的生存逻辑。

四、 智能体底座演进:从聊天框架到多智能体治理

在工程实践层面,我们观察到开发者对 AI 的使用正从“单次对话”转向“系统化治理”。Anthropic 近期发布的工程报告详细展示了他们如何通过 多智能体治理(Multi-agent Harness) 来处理复杂的软件任务[9]。这种模式强调的是编排而非提示词工程,通过 Retries(重试)、Rollbacks(回滚)和 Structured Logging(结构化日志)来解决生产环境中的不确定性。

1. 生产力工具的“画布化”

工具调用正变得“产品原生化”。Figma 推出的 MCP(Model Context Protocol)服务器标志着设计画布正式成为智能体可直接操作的领地[13]。现在,Cursor 等开发工具可以直接读取团队的设计系统,并在 Figma 画布上自动生成组件代码。这种从“设计到行动”的闭环,比单纯的代码生成更具革命性。

2. 智能体的“睡眠机制”

另一个有趣的技术创新来自 Claude Code 的 /dream 命令[53]。为了解决长会话带来的内存膨胀(Memory Bloat)问题,开发团队引入了模拟人类 REM 睡眠的机制。智能体会在后台自动审阅对话历史,剪除过时或矛盾的信息,并将核心知识固化到组织化的文件中。这种对上下文窗口的“动态修剪”,反映了业界对处理长时程记忆的全新思路。

五、 性能极限与全球博弈:Blackwell 与开源之争

在硬件与算子层,FlashAttention-4 的发布再次刷新了推理性能的上限。在英伟达 Blackwell B200 GPU 上,FA4 达到了惊人的 1613 TFLOPs/s,利用了理论峰值性能的 71%,比 Triton 快 2.7 倍[22]。这一进步直接推动了如 Fox 这样基于 Rust 开发的高性能推理引擎的崛起,其吞吐量达到了 Ollama 的两倍,而延迟降低了 72%[19]。

然而,技术的演进并非在真空中进行。美国咨询机构近期发出警告,称中国在开源 AI 领域的领先地位正威胁到美国的技术主导权[29]。这种担忧并非空穴来风:国产模型 Kimi K2.5 在 Cursor 的评测中被公认为当前最强的开源基础模型之一[28]。中国开发者对 AI 的接受度和应用深度(约 87%)远超美国(约 32%),这种草根式的 AI 素养提升,正在形成一股不可忽视的力量。

甚至在 AGI 的定义权上,各方也存在激烈争论。黄仁勋在近期采访中宣称 AGI 已经实现[36],而“AGI”一词的共同提出者 Mark Gubrud 则认为目前的模型确实达到了他当初预想的人类水平。无论共识何时达成,底层技术的加速迭代、分发渠道的权力重组以及供应链安全的严峻挑战,都已构成了 2026 年技术画卷的核心底色。

参考链接

- [1] https://www.microsoft.com/en-us/research/blog/ai2-leadership-joins-microsoft/

- [2] https://www.openai.com/blog/sora-update/

- [3] https://pypi.org/project/litellm/1.82.8/security/

- [4] https://dreamer.ai/app-store

- [5] https://www.latent.space/p/ai-killing-saas

- [6] https://www.bloomberg.com/news/articles/2026/high-school-dropout-ai-exit

- [7] https://developer.apple.com/app-store/review/guidelines/#generative-ai

- [8] https://www.latent.space/p/2026-war-on-slop

- [9] https://www.anthropic.com/engineering/agent-harness

- [10] https://twitter.com/glennko/status/1772154621

- [11] https://twitter.com/Yuchenj_UW/status/1772165732

- [12] https://twitter.com/kerrsee/status/1772189045

- [13] https://www.figma.com/blog/introducing-mcp-server/

- [14] https://github.com/features/copilot/mcp

- [15] https://cursor.sh/blog/figma-integration

- [16] https://twitter.com/karpathy/status/1772210098

- [17] https://github.com/berriai/litellm/issues/24512

- [18] https://www.lmstudio.ai/blog/security-false-positive

- [19] https://github.com/fox-inference/fox

- [20] https://huggingface.co/RYS-research/Qwen3.5-27B-RYS-II

- [21] https://github.com/Dao-AILab/flash-attention

- [22] https://www.nvidia.com/en-us/data-center/blackwell/

- [23] https://github.com/SillyTavern/SillyTavern

- [24] https://www.waymo.com/blog/computing-requirements-next-gen

- [25] https://www.bytedance.com/ai/seedance

- [26] https://www.alibabacloud.com/product/qwen

- [27] https://hunyuan.tencent.com/

- [28] https://kimi.moonshot.cn/k2-5-details

- [29] https://www.state.gov/reports/ai-open-source-dominance

- [30] https://huggingface.co/blog/hf-mount

- [31] https://www.openai.com/foundation/1b-commitment

- [32] https://twitter.com/sama/status/1772256789

- [33] https://twitter.com/woj_zaremba/status/1772267890

- [34] https://twitter.com/Teknium/status/1772289012

- [35] https://www.nousresearch.com/hermes-agent-v04

- [36] https://www.youtube.com/watch?v=jensen-interview-agi

AI群: 欢迎加我微信 tsla10timesAI交流,拉你进群!我们刚刚建立这个AI交流社群,正在寻找志同道合的朋友一起成长!

夜雨聆风

夜雨聆风