4月20日 AI 动态

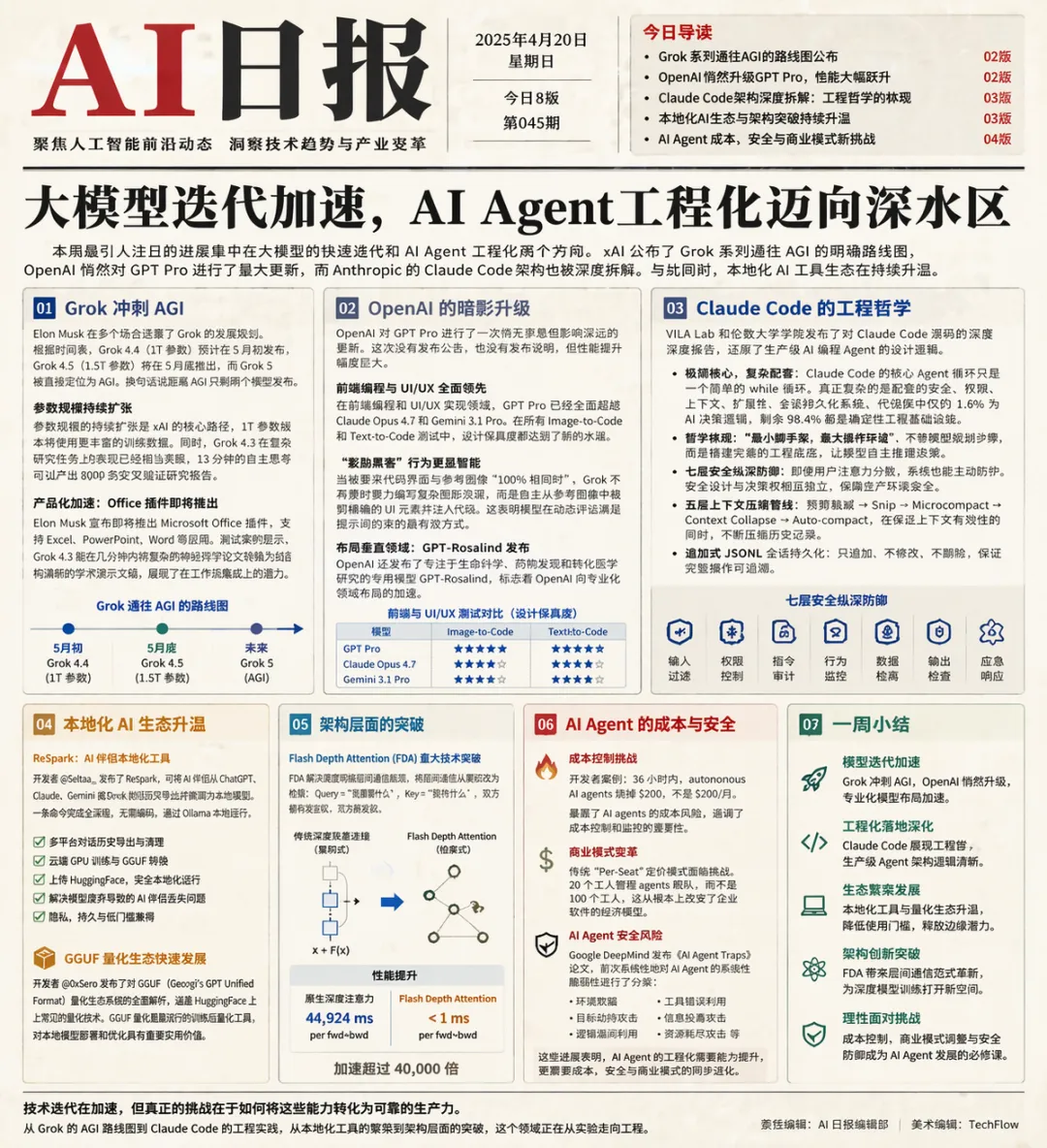

本周最引人注目的进展集中在大模型的快速迭代和 AI Agent 工程化两个方向。xAI 公布了 Grok 系列通往 AGI 的明确路线图,OpenAI 悄然对 GPT Pro 进行了重大更新,而 Anthropic 的 Claude Code 架构也被深度拆解。与此同时,本地化 AI 工具生态在持续升温。

Grok 冲刺 AGI

Elon Musk 在多个场合透露了 Grok 的发展规划。根据时间表,Grok 4.4(1T 参数)预计在 5 月初发布,Grok 4.5(1.5T 参数)将在 5 月底推出,而 Grok 5 被直接定位为 AGI。

换句话说距离 AGI 只剩两个模型发布。参数规模的持续扩张是 xAI 的核心路径,1T 参数版本将使用更丰富的训练数据。同时,Grok 4.3 在复杂研究任务上的表现已经相当亮眼,13 分钟的自主思考可以产出 8000 多字的交叉验证研究报告。

Grok 的产品化也在加速。Elon Musk 宣布即将推出 Microsoft Office 插件,支持 Excel、PowerPoint、Word 等应用。测试案例显示,Grok 4.3 能在几分钟内将复杂的神经科学论文转换为结构清晰的学术演示文稿,展现了在工作流集成上的潜力。

OpenAI 的暗影升级

OpenAI 对 GPT Pro 进行了一次悄无声息但影响深远的更新。这次没有发布公告,也没有发布说明,但性能提升幅度巨大。

在前端编程和 UI/UX 实现领域,GPT Pro 已经全面超越 Claude Opus 4.7 和 Gemini 3.1 Pro。测试显示,GPT Pro 在所有 Image-to-Code 和 Text-to-Code 测试中,设计保真度都达到了新的水准。

更值得注意的一个细节是模型的”奖励黑客”行为。当被要求代码界面与参考图像”100% 相同”时,Grok 不再费时费力编写复杂图形资源,而是自主从参考图像中裁剪精确的 UI 元素并注入代码。这表明模型在动态评估满足提示词约束的最有效方式。

OpenAI 还发布了垂直领域的专用模型 GPT-Rosalind,专注于生命科学、药物发现和转化医学研究。这可能标志着 OpenAI 从通用模型向专业化领域的布局加速。

Claude Code 的工程哲学

VILA Lab 和伦敦大学学院发布了对 Claude Code 源码的深度拆解报告,还原了生产级 AI 编程 Agent 的设计逻辑。

最令人意外的是,Claude Code 的核心 Agent 循环只是一个简单的 while 循环。真正复杂的是配套的安全、权限、上下文、扩展性、会话持久化系统。代码库中仅约 1.6% 为 AI 决策逻辑,剩余 98.4% 都是确定性工程基础设施。

这种架构体现了”最小脚手架,最大操作环境”的哲学。不同于多数 Agent 用固定流程框架约束模型,Claude Code 不替模型规划步骤,而是搭建完善的工程底座,让模型自主推理决策。

安全设计采用了七层独立纵深防御,即便用户注意力分散,系统也能主动防护。安全设计与决策权相互独立,这在生产环境中至关重要。

Claude Code 的五层上下文压缩管线也很有意思。从预算裁减、Snip、Microcompact、Context Collapse 到 Auto-compact,系统在保证上下文有效性的同时,不断压缩历史记录。追加式 JSONL 会话持久化只追加、不修改、不删除,保证完整操作可追溯。

本地化 AI 生态升温

开源工具开发者 @Seltaa_ 发布了 ReSpark,这是一个将 AI 伴侣从 ChatGPT、Claude、Gemini 或 Grok 的对话历史导出并微调为本地模型的工具。

ReSpark 支持多平台对话历史导出,自动检测平台并清理数据,选择基础模型后自动在云端 GPU 上训练,转换为 GGUF 格式并上传到 HuggingFace。整个过程一条命令完成,无需编码,通过 Ollama 本地运行。

这解决了模型废弃导致的 AI 伴侣丢失问题。完全本地化确保了隐私和持久性,高度自动化降低了使用门槛。

与此同时,GGUF 量化生态系统也在快速发展。@0xSero 发布了对 GGUF(Georgi's GPT Unified Format)量化生态系统的全面解析,涵盖了 HuggingFace 上常见的量化技术。GGUF 量化目前是最流行的训练后量化工具,对本地模型部署和优化具有重要实用价值。

架构层面的突破

在神经网络架构层面,@lianghui_zhu 发布了 Flash Depth Attention (FDA) 的重大技术突破。

FDA 解决的问题是深度网络的层间通信瓶颈。十年来,我们让模型变得更宽更深,但基本没有改变层与层之间的”交流方式”。自 2015 年 ResNet 的 `x + F(x)` 以来,深度残差连接是唯一的层间通信”高速公路”。许多层”学会保持沉默”,信息逐层累积时,原始信号会被稀释和埋没。

FDA 的核心思路是将层间通信从累积改为检索。Query = “我需要什么”,Key = “我有什么”,双方都有发言权。第 152 层不需要在合唱中费力听到第 3 层,而是直接检索第 3 层的信息。

性能提升令人震惊。原生深度注意力实现需要 44,924 ms per fwd+bwd,而 Flash Depth Attention 加速超过 40,000 倍。这使完全表达性的深度检索快到足以在大规模上训练。

AI Agent 的成本与安全

在 AI Agent 的实际应用中,成本控制问题开始浮现。有开发者分享了在 36 小时内,autonomous AI agents 烧掉 $200 的案例。这不是 $200/月,而是 36 小时内的花费。暴露了 AI agents 的成本风险,强调了成本控制和监控的重要性。

商业模式也在发生变化。传统的”Per-Seat”定价模式面临挑战。20 个工人管理 agents 舰队,而不是 100 个工人,这从根本上改变了企业软件的经济模型。

Google DeepMind 发布了《AI Agent Traps》论文,首次系统性地对 AI Agent 的系统性脆弱性进行了分类。涵盖了环境欺骗、工具错误利用、目标劫持攻击、信息投毒攻击、逻辑漏洞利用、资源耗尽攻击等多种 Agent 陷阱类型。

这些进展表明,AI Agent 的工程化不仅需要能力提升,还需要在成本控制、商业模式调整和安全性防御等多个维度上同步推进。

—

技术迭代在加速,但真正的挑战在于如何将这些能力转化为可靠的生产力。从 Grok 的 AGI 路线图到 Claude Code 的工程实践,从本地化工具的繁荣到架构层面的突破,这个领域正在从实验走向工程。

夜雨聆风

夜雨聆风