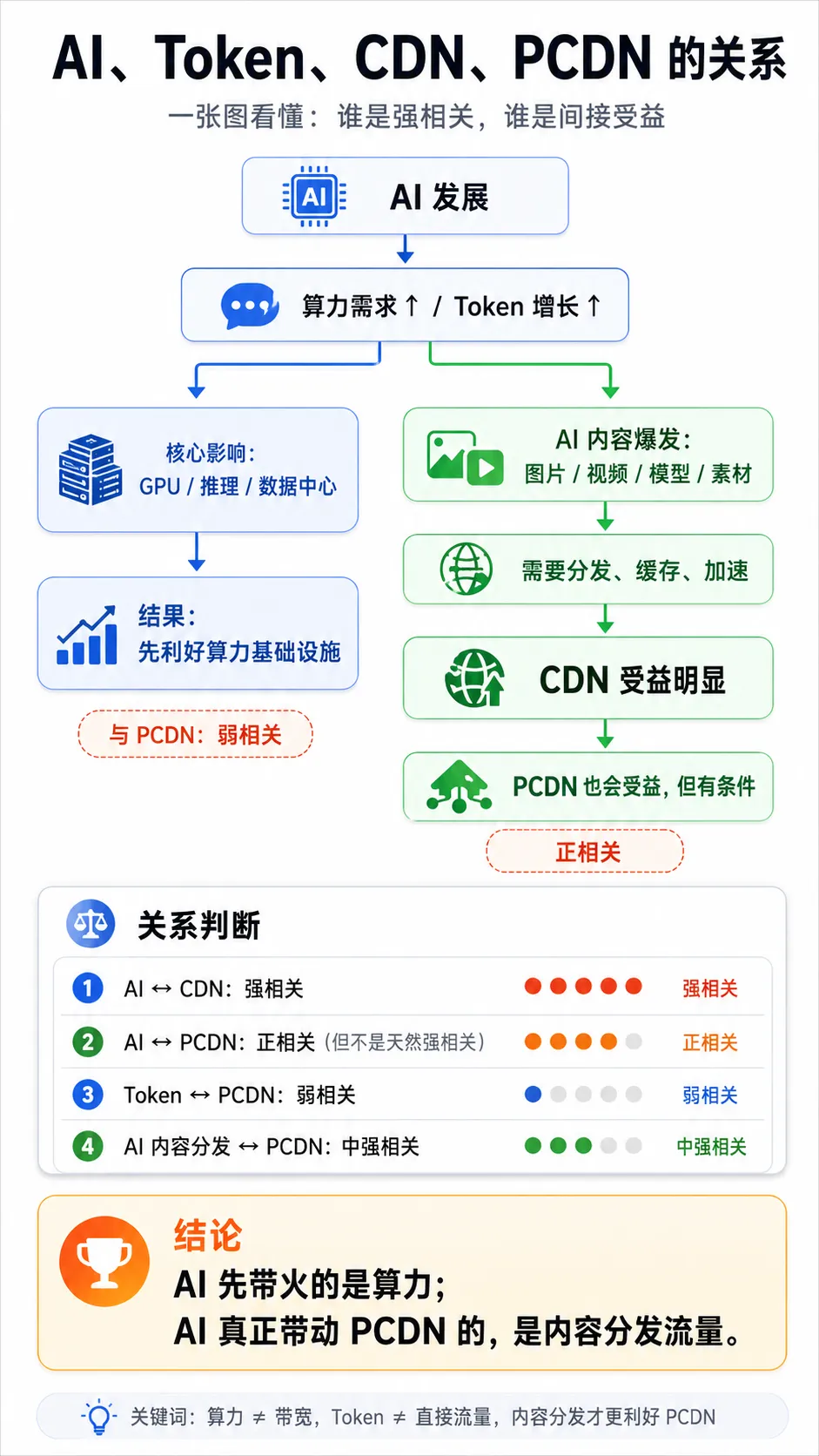

AI爆发时代,PCDN到底是否能吃到人工智能时代红利?一文给你彻底讲明!

结论

AI 发展和 CDN 是强相关;和 PCDN 是正相关,但不是天然强相关。

更准确地说:

|

|

|

|

|---|---|---|

| AI 算力 ↔ CDN |

|

|

| AI token ↔ CDN |

|

|

| AI 生成图片/视频 ↔ CDN |

|

|

| AI ↔ PCDN |

|

|

| AI token ↔ PCDN 收益 |

|

|

一句话:AI 让互联网流量结构变复杂,CDN 一定受益;PCDN 只有在“AI 内容变成大文件、大流量、可缓存、可分发”时才受益。

1. token 不是流量,token 首先是“算力账本”

OpenAI 官方对 token 的解释是:模型处理文本时会把文本切成 token,英文里粗略可以按 1 token ≈ 4 个字符或 0.75 个单词理解。([OpenAI开发者][1])

这意味着:

-

用户问答、客服机器人、代码助手产生的 token,本质上先消耗 GPU 推理算力。 -

单纯文本 token 的网络流量其实很小。 -

1 百万 token 输出,按英文粗略估算也就是几 MB 级别文本数据,不是视频那种 GB/TB 级流量。

NVIDIA 也明确把推理时代的核心指标放在 tokens per watt、cost per million tokens、tokens per second per user,并指出多步推理会显著增加每次请求的 token 生成量。([NVIDIA Developer][2])

所以,token 爆发首先利好的是:GPU、推理平台、显存、数据中心网络、电力、调度系统。 它不是直接利好 PCDN。

2. AI 和 CDN 为什么是强相关?

CDN 的本质是:把内容缓存到离用户更近的边缘节点,降低延迟、降低源站压力、减少带宽成本。Cloudflare 对 CDN 的定义也是“地理分布式服务器,把内容缓存到靠近终端用户的位置”。([cloudflare.com][3])

AI 对 CDN 的影响主要有四条线:

第一,AI 应用全球化,需要低延迟访问

ChatGPT、Claude、Kimi、豆包、文心、通义、AI Agent、AI 搜索,本质上都是全球/全国用户访问的在线服务。用户不关心模型在哪个机房,只关心响应速度。

Akamai 也在讲类似逻辑:随着 AI 进入多步推理、实时交互、全球规模使用,中心化云推理会遇到延迟、带宽、排队和距离带来的瓶颈,边缘分布式推理会变重要。([Akamai][4])

第二,AI crawler/agent 会改变 CDN 缓存结构

Cloudflare 2026 年的缓存研究提到,AI crawler 和 AI agent 的访问行为和人类不同:它们会高并发、大范围抓取长尾页面,导致缓存命中率下降、源站压力和出口成本上升。Cloudflare 数据还显示,其网络中 32% 流量来自自动化流量,AI crawler 是自识别 AI bot 流量里最活跃的一类。([The Cloudflare Blog][5])

这说明 AI 不是只增加流量,还会改变缓存策略: 以前 CDN 主要缓存热视频、热门图片、热门 JS/CSS;以后还要处理 AI agent 抓文档、抓图片、抓知识库、抓代码仓库。

Cloudflare 还提到,AI crawler 会提高 cache miss,导致更多请求打到源站,增加源站负载和 egress 成本。([The Cloudflare Blog][5])

第三,AI 生成图片/视频会制造大文件分发需求

文本 token 不是大流量,但 AI 图片、AI 视频、AI 数字人、AI 广告素材、AI 短剧、AI 商品图是大流量。

Wikimedia 公开说过,自 2024 年 1 月以来,多媒体下载带宽增长了 50%,主要不是来自人类读者,而是自动化程序抓取 Wikimedia Commons 图片目录用于 AI 模型。([Diff][6])

这类东西才是 CDN/PCDN 真正喜欢的流量:大文件、可缓存、可复用、可分发。

第四,边缘推理会把 CDN 从“缓存网络”推向“边缘计算网络”

S&P Global 在 2026 数据中心趋势里也提到,AI inference 会让边缘数据中心更重要,实时响应、安全、数据主权都会推动一部分 AI 推理靠近用户。([S&P Global][7])

这对传统 CDN 是重大机会: 以后 CDN 不只是“存文件”,而是“存文件 + 跑轻量计算 + 做 API 加速 + 做安全防护 + 做边缘 AI 推理”。

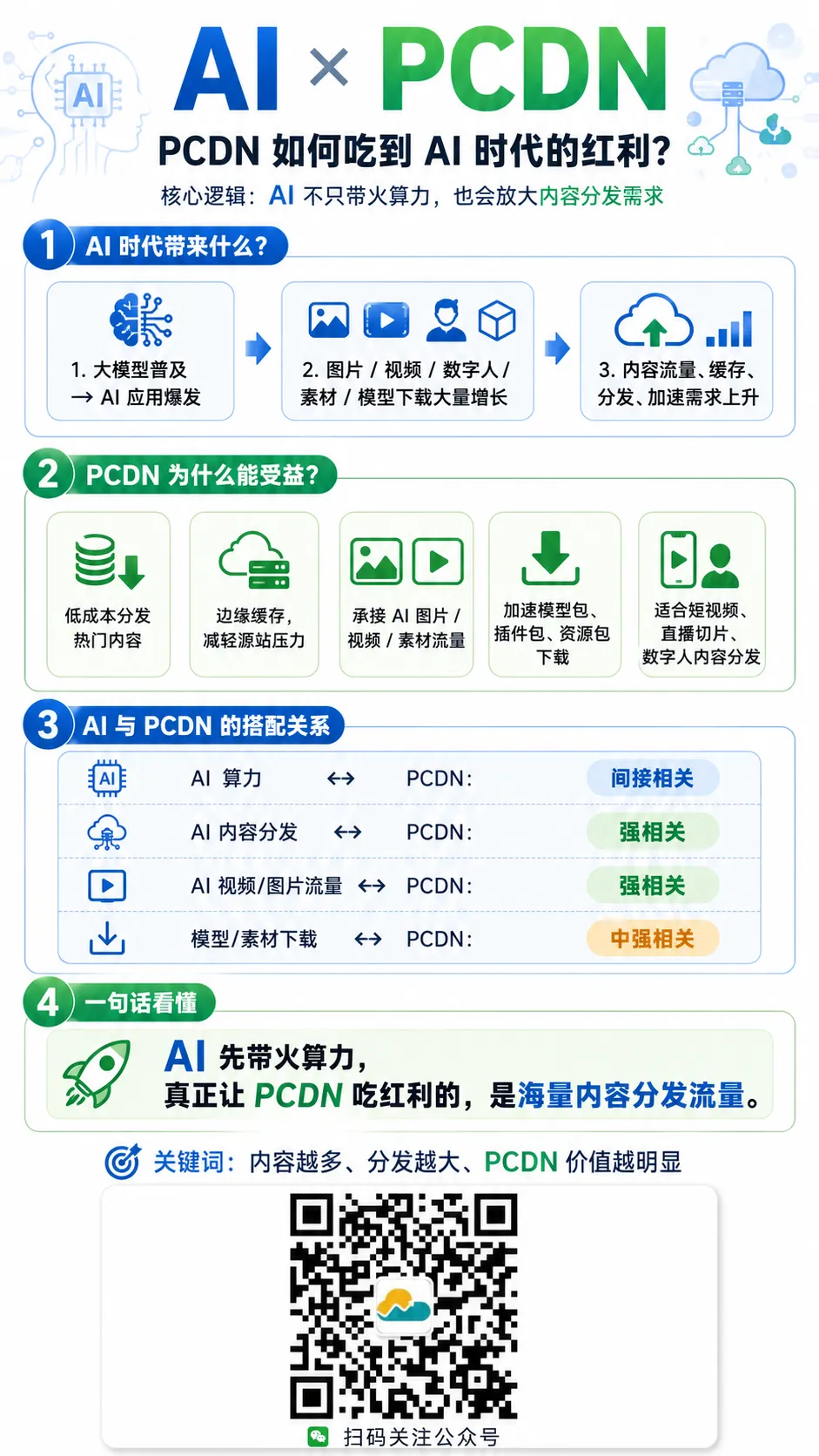

3. AI 和 PCDN 的关系:正相关,但不是强绑定

PCDN 的核心不是 GPU,也不是 token。PCDN 的核心是:

用大量分散节点的闲置带宽、存储、上行能力,组成低成本内容分发网络。

四川在线对 PCDN 的描述也类似:PCDN 是挖掘网络中的海量碎片化闲置资源,构建低成本内容分发网络;宽带用户可共享闲置上行带宽换取收益。([四川在线][8])

所以 PCDN 能不能吃到 AI 红利,要看 AI 产生的是哪种需求。

PCDN 能吃到的 AI 红利

1. AI 生成视频/图片分发

这是最直接的机会。

比如:

-

AI 短视频平台 -

AI 数字人直播切片 -

AI 商品图批量生成 -

AI 广告素材库 -

AI 短剧/小说推文视频 -

AI 生成的素材下载站

这些内容一旦公开分发,就需要便宜带宽和缓存节点。PCDN 有机会承接其中一部分低成本分发需求。

2. 模型文件、插件、素材包、数据包分发

AI 行业会产生大量:

-

模型权重 -

LoRA -

checkpoint -

插件包 -

推理客户端 -

数据集样本 -

素材库 -

训练/微调文件

这些大文件如果分发频繁,CDN/PCDN 都有价值。

3. 边缘缓存和区域热点分发

如果某些 AI 应用在某地区爆火,例如 AI 图生视频 App、AI 陪聊 App、AI 相机 App,它的素材、封面、生成结果、视频预览会形成区域热点。 这类流量适合边缘缓存,也适合部分 PCDN 场景。

PCDN 吃不到的 AI 红利

1. 大模型训练算力

训练主要发生在 GPU 集群里,流量是数据中心内部网络和跨机房专线,和家庭宽带 PCDN 几乎没关系。

训练看的是:

-

GPU/TPU -

HBM -

NVLink / InfiniBand / RoCE -

光模块 -

交换机 -

电力 -

液冷 -

机房资源

不是 PCDN。

2. 大部分 LLM token 推理

用户问一句,模型吐几百字,这些 token 对网络带宽不是大负担。 真正重的是 GPU 推理时间、显存占用、并发调度,而不是下发给用户的文本流量。

所以 “token 越多,PCDN 越赚钱”这个逻辑不成立。

3. 企业级 AI API

企业客户访问大模型 API,通常要求:

-

稳定 SLA -

安全合规 -

数据隐私 -

可审计 -

低抖动 -

专线/VPC/云厂商网络 -

API 网关安全

这类流量通常不会轻易走普通 PCDN,尤其是家庭宽带节点。

4. 为什么 PCDN 和 AI 不是“强相关”?

核心原因有四个。

第一,PCDN 是带宽生意,AI token 是算力生意

PCDN 赚钱靠:

-

上行带宽 -

在线率 -

节点质量 -

缓存命中率 -

调度能力 -

区域资源稀缺性

AI token 赚钱靠:

-

GPU 推理吞吐 -

显存 -

tokens/s -

tokens/watt -

模型压缩 -

batch 调度 -

KV cache -

推理成本

两者不是一个资产类型。

第二,AI 推理要求稳定性,普通 PCDN 节点不一定满足

AI 交互是实时服务。用户问一句,不能等节点不稳定、掉线、抖动。 而很多 PCDN 节点来自家庭宽带、NAS、路由器、小主机,存在:

-

上行波动 -

NAT 问题 -

断电 -

运营商限速 -

IP 变化 -

合规风险 -

可用性不可控

这和企业 AI 服务的要求有冲突。

第三,运营商对 PCDN 有天然压力

四川在线报道里提到,运营商对 PCDN 管控的原因包括:上行流量持续增加带来网络运维和扩容压力,以及低价整合家庭宽带上行后替代企业带宽、机房带宽,影响运营商商业利益。([四川在线][8])

这意味着: AI 流量越大,运营商越可能更重视上行异常、长时间跑满、家庭宽带商用化的问题。

中国电信 2025 年公开文章中也提到,广东公司把 PCDN 业务列为重点风险领域,并通过大数据 + AI 构建风险预警模型。([chinatelecom.com.cn][9])

这对 PCDN 玩家不是纯利好,反而意味着检测和治理会更精细。

第四,合规问题会决定 PCDN 能不能长期吃红利

公开报道显示,江苏通信管理局曾要求运营商不得以 PCDN 整治为由擅自关停用户宽带或降低速率,但同时也说明 PCDN 争议已经进入监管视野。([landiannews.com][10])

所以 PCDN 行业未来不是简单“流量越大越好”,而是会分化:

-

合规、授权、可审计、可控节点:有机会。 -

静默占用、家庭宽带商用、规避检测、灰色流量:风险越来越大。

5. 我的判断:AI 对 PCDN 是“结构性利好”,不是“全面利好”

最受益的 PCDN 方向

|

|

|

|

|---|---|---|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

6. 对 PCDN 行业的真实影响

我认为未来 2–5 年,PCDN 会出现三个变化。

变化一:从“跑量”变成“跑质量”

以前 PCDN 可能只看:

-

上行多少 -

跑满多久 -

在线率多少 -

单价多少

以后会更看:

-

节点是否合规 -

IP 质量 -

是否被运营商识别 -

是否能长期稳定 -

是否能承接高价值内容 -

是否能提供真实 SLA

粗暴堆家庭宽带节点的模式,长期不稳。

变化二:PCDN 会向“边缘云”靠拢

真正有前景的不是单纯 PCDN,而是:

PCDN + 边缘存储 + 边缘计算 + 智能调度 + 安全合规 + 运营商合作

也就是从“民间共享带宽”升级成“可运营的边缘基础设施”。

AI 时代需要的不只是带宽,还需要靠近用户的计算、缓存、安全、数据处理能力。S&P Global 也提到,AI inference 会让边缘数据中心在实时性、安全和数据主权方面变得重要。([S&P Global][7])

变化三:AI 会让 PCDN 的检测和风控也变强

运营商会用 AI 检测异常流量。 平台也会用 AI 做节点质量评分。 监管也会更关注用户授权、流量用途、带宽所有权、家庭宽带商用边界。

所以 AI 既可能带来流量,也会带来更强的管控。

7. 最直接的商业判断

CDN 行业

强利好。

AI 会带来:

-

AI crawler 流量 -

AI agent 访问 -

AI 搜索抓取 -

AI 生成内容分发 -

AI 视频/图片大文件 -

实时推理低延迟需求 -

边缘推理节点需求 -

API 安全和防护需求

CDN 会从“内容分发”升级为“AI 边缘网络”。

PCDN 行业

中等利好,且高度分化。

PCDN 不会因为 token 暴涨就直接爆发。 但如果 AI 让图片、视频、素材、模型、插件、短剧、数字人内容爆发,PCDN 会有流量机会。

真正能长期赚钱的 PCDN 方向是:

-

合规节点池 -

高质量上行资源 -

运营商关系稳定 -

能承接 AI 图片/视频/素材分发 -

有智能调度能力 -

能从家庭宽带灰色模式转向边缘云/边缘缓存模式

最后一句判断

AI 和 CDN 是强相关;AI 和 PCDN 是“内容分发层面的正相关”,不是“token 算力层面的强相关”。

PCDN 行业的机会不在“AI 多消耗 token”,而在:

AI 让内容生产成本下降,图片、视频、模型、素材、Agent 抓取、边缘应用暴增,从而制造更多低成本分发需求。

但同时,运营商限速、合规治理、节点质量、家庭宽带商用边界,会决定 PCDN 能不能真正吃到这波红利。

往期推荐

夜雨聆风

夜雨聆风