AI自己扫垃圾,一天清空5000条!GitHub服务器都喊“慢点”!

你见过最离谱的GitHub Issue是什么?是AI灌水、是重复提问、还是早就修复了却没人关的“数字僵尸”?对于拥有36万Star的OpenClaw项目来说,这些无效Issue堆积成山,成了维护者的噩梦。

但最近,OpenClaw之父、OpenAI工程师Peter Steinberger只用2天时间,花不到1000美元,就上演了一场“AI大扫除”。他开发的ClawSweeper工具,启动50个AI实例并行扫描,一天之内就关闭了超过5000个无效Issue,效率之高,甚至让GitHub的API服务器都因速率限制而“跪了”。

01 AI判官的“极致保守”原则

别以为这是个乱关一通的“杀手”。恰恰相反,ClawSweeper的设计哲学是“极致保守”。它只在7种明确的情况下才会动手:比如问题已在主分支修复、无法复现、内容过于混乱无法执行、或是超过60天无有效反馈等。

更厉害的是,它自带多重保险:自动跳过项目维护者本人发的Issue;审查时只有“读”权限,没有“写”权限,所有判断都先形成报告;最后还要二次确认Issue状态没变,才会真正执行关闭。创始人亲自抽检了数百条,准确率几乎100%!这波操作,你觉得够稳吗?

02 把README变成“透明仪表盘”

传统做法可能要搭一套复杂的监控后台。但Steinberger说:不需要!README就是我的仪表盘。

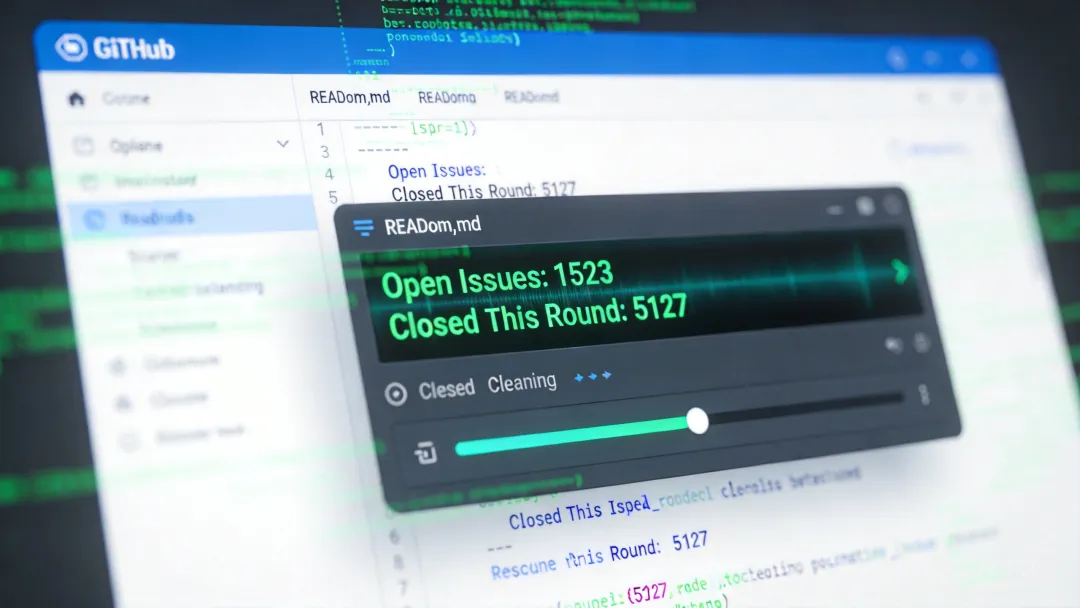

ClawSweeper会实时更新仓库的README.md文件。当前有多少开放Issue、审查了多少、关闭了多少、甚至被GitHub限流卡在哪一步……所有数据都以表格形式清晰展示。任何人点开项目主页,都能看到这个AI判官在干什么,整个流程完全透明、可审计。

03 成本仅0.2美元/条,开启开源“自愈”时代

算笔经济账:清理5000多个深度审查的Issue,总成本不到1000美元,平均一条才两毛钱!而如果靠人工,清完这些“数字坟场”可能需要一整年。

这不仅仅是省时省钱。它标志着大型开源项目维护,正从纯人工迈向“AI自愈”的起点。未来,每个大项目可能都会跑着这样一个AI Bot,7×24小时无休地过滤噪音,让人类维护者能专注在真正需要创造力和判断力的高价值问题上。你觉得,AI全面接管项目维护的日子还远吗?

04 唯一的瓶颈:服务器追不上AI

最有趣的细节来了:让整个系统慢下来的,不是AI不够聪明,而是GitHub的API速率限制。50个AI并行处理的速度太快,快到基础设施都喊“跟不上”!这成了AI工作效率的唯一瓶颈。

这大概就是AI时代的真实写照:AI的“思考”和“执行”速度,已经跑在了我们现有“管道”的前面。

总结一下,AI不仅能创造内容,更能高效地管理和清理数字世界。这次“大扫除”展示了AI Agent在复杂判断任务上的实用性和性价比。你对AI参与开源维护怎么看?你希望哪个项目的Issue也能被这样清理一下?欢迎在评论区聊聊你的看法!

夜雨聆风

夜雨聆风