当AI开始计算"杀死一个人需要多少成本"

上周,日本《每日新闻》发了一篇报道,说Palantir公司的AI系统深度参与了美军对伊朗的军事打击。

报道里有个细节让我停下了:当操作者选定攻击目标后,AI会自动计算燃料和弹药需求量,对比成本后,给出推荐武器及作战方案。

换句话说,杀一个人之前,系统会先算一笔账。

这不是科幻电影。这是4月25日的新闻。

Palantir是谁?如果你关注硅谷,可能知道它是彼得·蒂尔创立的数据分析公司,股票代码PLTR,被称为”硅谷最神秘的公司”。它的主要业务,是帮美国政府和军方整合、分析海量数据。

2024年5月,美国陆军和Palantir签了一份4.8亿美元的合同,开发”梅文智能系统”。这个系统的核心能力,是”自动识别潜在目标”。

数据来源包括卫星图像、无人机监控、通信拦截、地理定位。系统用机器学习处理这些信息,然后告诉操作者:这里有个目标,建议用这种方式打击。

更关键的是后面这一步:系统会计算不同方案的成本,然后推荐”最优解”。

我试着想象这个场景。

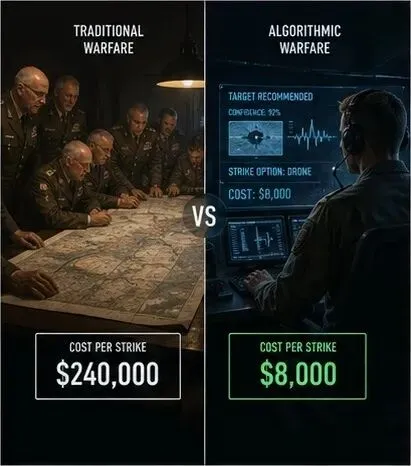

一个操作员坐在控制台前,屏幕上弹出提示:”目标已识别。方案A:巡航导弹,成本240万美元,预计杀伤半径50米;方案B:无人机打击,成本8万美元,精确度95%。”

操作员的选择,被压缩成一个成本-效益问题。

但问题在这里:这个”最优解”是谁定义的?

Palantir的公开说法是,系统只是”辅助决策”,最终开火权在人类手里。这叫”人在回路”(human-in-the-loop),是军事AI的标准话术。

但我后来看到一个点。

《纽约时报》的报道提到,在也门和索马里的无人机行动中,操作员平均只有几十秒的时间做判断。系统推送目标,操作员确认,导弹发射。整个过程快得像条件反射。

这种情况下,”人在回路”更像是一个形式。操作员不是在”决策”,而是在”执行”系统的推荐。

这就引出一个更深层的问题:当算法优化了杀戮,它优化的是什么?

答案是:成本、效率、精确度。但生命呢?道德呢?意外伤亡的风险呢?

这些变量很难被量化,所以它们被边缘化了。

“算法不会问’应不应该’,它只回答’怎么更便宜’。”

如果你是程序员或AI从业者,这件事和你有关。

你可能在写推荐算法、优化模型、提升效率。你的工作看起来和战争无关。但技术的底层逻辑是相通的:数据输入→模型处理→输出决策。

区别在于应用场景。同一个推荐引擎,可以用来推荐电影,也可以用来推荐打击目标。

这不是说你要为战争负责。而是说,技术中立是一个神话。算法总是嵌入在特定的权力结构和利益网络中。理解这一点,是做出负责任选择的前提。

如果你是投资者或关注科技股的读者,Palantir的案例值得研究。

它的商业模式很清晰:政府合同+国防预算。这意味着它的股价和地缘政治风险正相关。战争紧张时,订单增加;和平时期,增长受限。

从投资角度,这是一个”军工复合体”的纯种标的。但你需要想清楚:你是否愿意从算法优化的杀戮中获利?

这个问题没有标准答案。但回避问题,不等于问题不存在。

更深层的趋势是:战争正在变得越来越”便宜”。

传统战争需要动员大量人力物力,成本高昂,政治风险大。但算法战争不同:无人机+AI目标识别+精确打击,可以用极低的成本,实现持续的、低强度的军事存在。

这意味着什么?

意味着战争可能变得更频繁、更隐蔽、更难被公众察觉。没有大规模伤亡,没有动员令,没有明显的战争状态。但暴力在持续发生,只是被算法包装成了”精确打击”和”反恐行动”。

这引出一个关于民主的问题:当战争被算法管理,公众还能有效监督吗?

传统战争有明确的开始和结束,有可见的代价。但算法战争是连续的、分散的、数据化的。它不容易成为新闻头条,也不容易引发公众讨论。

如果你是普通关注者,我的建议是:保持警觉,但不要陷入绝望。

技术本身没有善恶,但它的应用有方向。Palantir的系统可以被用于战争,也可以被用于灾难响应、医疗优化、城市规划。关键在于,谁来控制技术,以什么目的使用它。

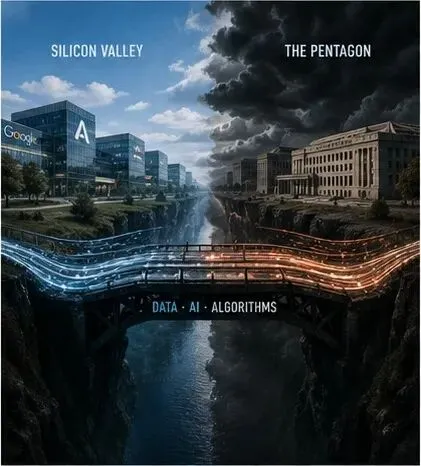

目前的情况是,军事需求在主导AI的发展方向。五角大楼的预算、国防合同、国家安全话语,正在塑造整个行业的优先级。

这不是阴谋论。这是公开的事实。

OpenAI去年修改了使用政策,删除了”禁止军事用途”的条款。它与国防科技公司Anduril合作,开发”国家安全”应用。Anthropic、Cohere等其他AI公司,也在积极寻求政府合同。

硅谷和五角大楼的距离,从来没有这么近过。

回到开头的问题:当AI开始计算”杀死一个人需要多少成本”,我们应该如何反应?

愤怒是自然的,但不够。恐惧也是自然的,但会让我们瘫痪。

更有建设性的反应,是追问:谁有权定义”成本”?谁有权决定”最优解”?谁为错误负责?

这些问题没有简单的答案。但提出问题的本身,就是抵抗算法化的第一步。

技术哲学家兰登·温纳说过:”技术不仅是工具,它是一种政治现象。”

算法战争的政治,是效率压倒道德、成本压倒生命、秘密压倒透明。

如果我们不希望在日常生活中也遇到这种政治,现在就是关注它的时候。

——

你怎么看?当算法开始优化杀戮,人类应该扮演什么角色?

夜雨聆风

夜雨聆风