人工智能很厉害,但它真的只是一个工具,一个可能会骗人的工具!用不好可能会让你倾家荡产…

今天周五,我们不了市场的事情,但我却想说一个跟市场息息相关的事情,那就是我们做做市场决策前,该怎样的应用好协助我们调查数据的工具——人工智能们!

学会怎么使用这个工具很重要,因为如果你通过工具查到的信息是假的,那你就会因为假的信息做出错误的操作,从而得到错误的结果,从而让自己损失惨重,我自己以前也被深深的伤害过。

6亿人涌入AI时代,却没几个人懂它的真相

先给大家看一组数据,你就知道现在AI的普及程度有多夸张。

根据中国互联网络信息中心(CNNIC)发布的第57次《中国互联网络发展状况统计报告》,截至2025年12月,我国生成式AI用户规模已经达到了6.02亿人,较前一年暴涨141.7%,网民普及率达到42.8%。简单来说,现在每两个上网的中国人里,就有一个在用AI工具。

更关键的是,高达86.4%的用户每天都会使用AI,超过80%的人用它的核心需求,就是“回答问题、获取信息”。写文案、做方案、查资料、问投资建议、甚至做人生决策,我们越来越习惯把问题抛给AI,然后把它给出的答案,当成标准答案去执行。

但问题也随之而来:用的人多了,信的人就多了;信的人多了,懒得思考的人也就多了。

当AI变成了“搜索引擎替代品”甚至“决策替代品” ,麻烦就来了。

AI到底信不信得过?

先泼一盆冷水:AI不是无所不知的先知,它连“知道”都谈不上。

从技术上说,大语言模型本质上是根据海量文本数据训练出来的概率预测机器——它并不“理解”问题,只是根据你输入的词,推测下一个词最可能是什么。这种机制天然决定了它会犯一个毛病,业内叫“AI幻觉”——用特别笃定的语气,说出完全错误的信息。

说白了,AI是个“没有大脑核心的信息处理器” ,它搜到什么就喂给你什么,它并不知道自己喂的东西是真是假。

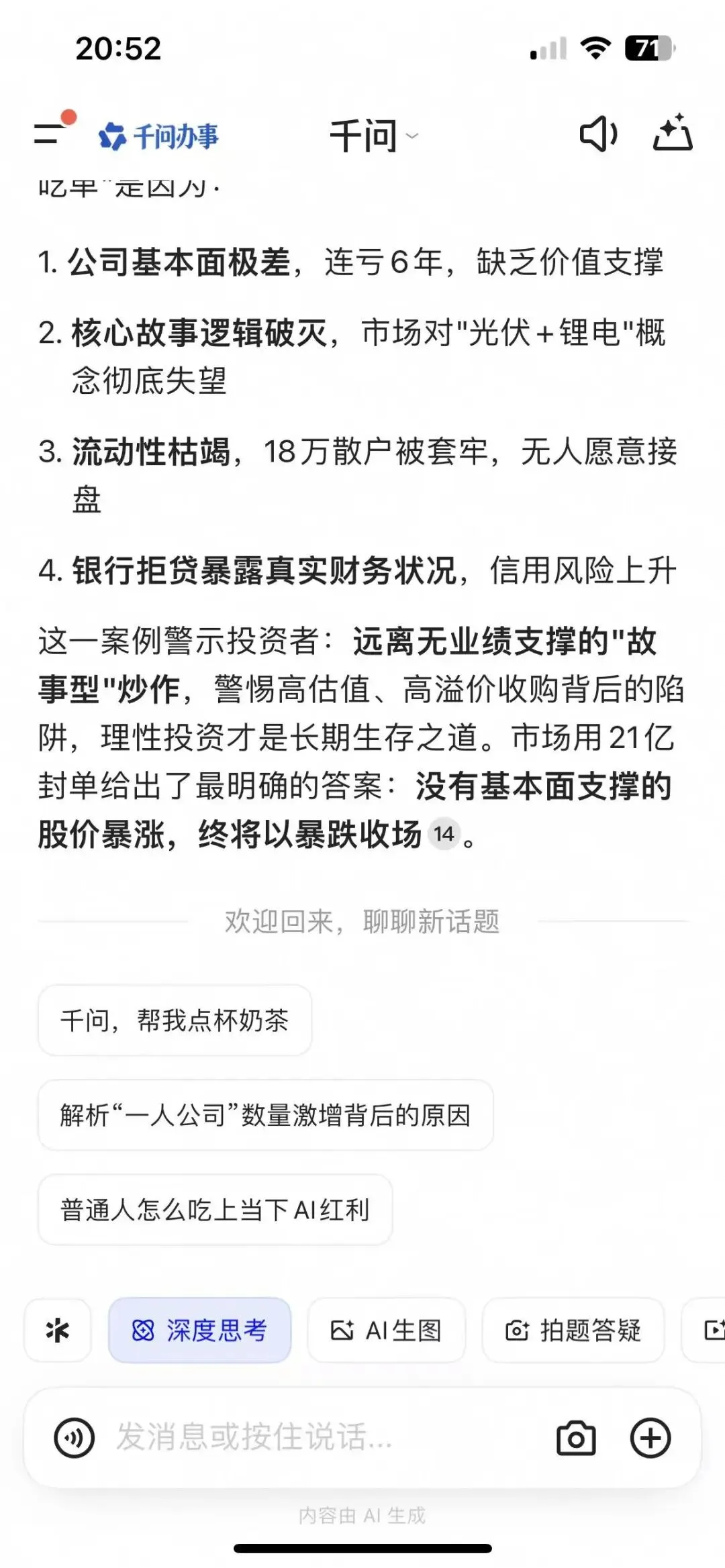

那个关于“退市”的误会:AI差点让人亏了钱

写这篇文章的缘由是前两天一位读者朋友的真实经历,这简直就是对“AI幻觉”最鲜活的注解。

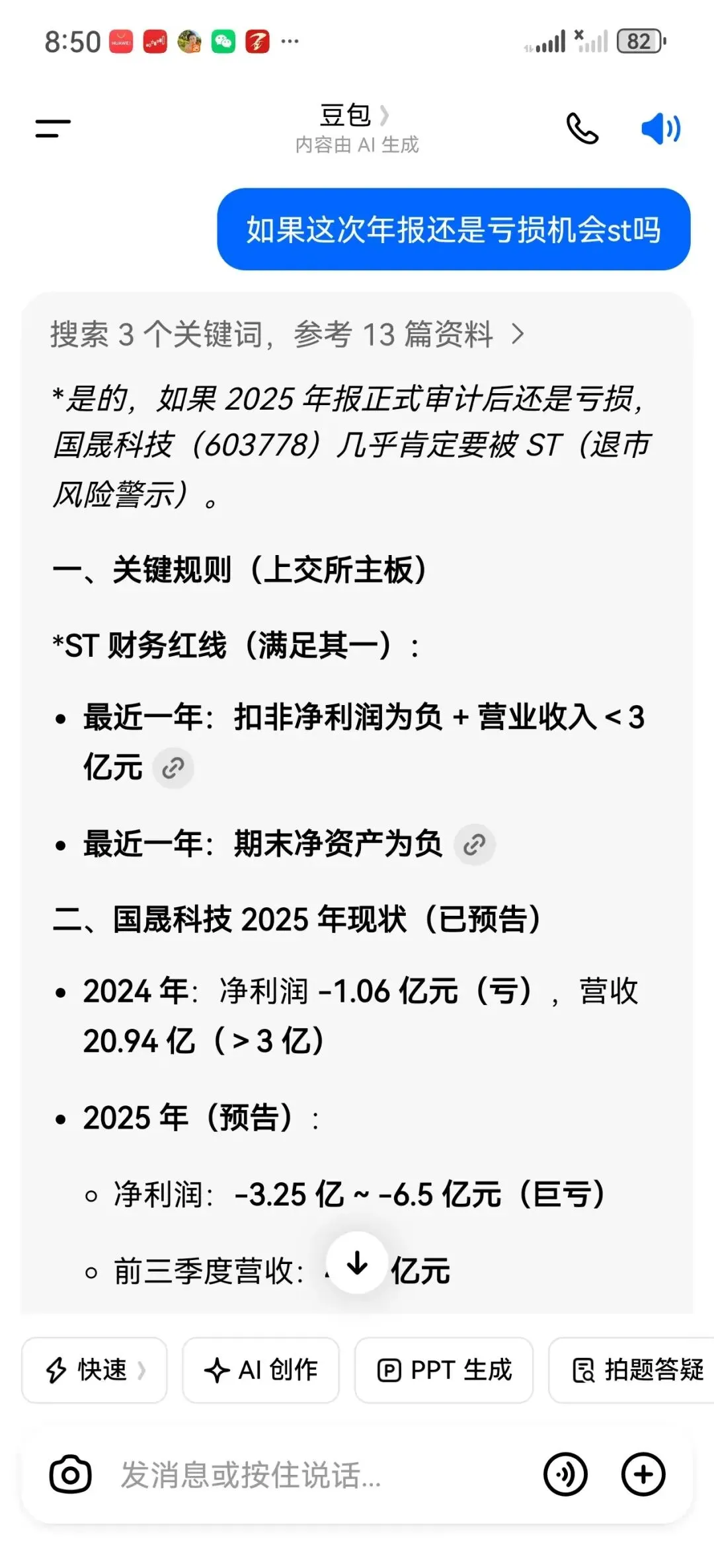

这位朋友手里持有一家上市公司的股票——国晟,最近市场波动大,他心里没底,就问了一款主流AI软件:“某某公司今年会不会被ST或者退市?”

结果AI毫不犹豫、语气肯定地告诉他:“根据目前的信息,该公司财务状况存在较大风险,面临较高的退市可能性。”

这位朋友心里没了冷静。好在他稳了一手,跑来问我的意见。

我听完他的描述,并没有只看AI的结论,而是去查阅了该公司最新的年报、近期的交易所问询函回复。经过严谨的筛查核实后我发现:这家公司虽然业绩有波动,但净资产、营收指标远未触及退市红线,今年内被ST或退市的可能性微乎其微。

同一个问题,同一个事实基础,为什么AI的回答和人工深度调查的结果天差地别?

原因很简单:AI抓取了网络上大量的负面舆情和过时的分析报告,把这些“噪音”当成了“信号”。它没有大脑去甄别这些信息的时效性和权威性,只是机械地算出了一个“看起来很严重”的答案。

如果那位朋友盲信了AI,在恐慌中做出了错误的卖出操作,那损失就实实在在产生了。AI不需要为这个亏损负责,但账户里的钱,却是真金白银地没了。

与其说AI“坏”,不如说是我们“懒”

很多人可能会说:那AI也太不靠谱了吧,还能不能用?

问题不在于AI能不能用,而在于你怎么用。

大部分人的使用习惯是:打开AI,敲几个字,等答案,复制粘贴,完事。从头到尾不超过两分钟,全程无脑操作。这种用法,本质上是在把自己的判断力“外包”给一个概率预测机器。

AI不是不能用,而是不能用作决策替代品。

四个实用建议:把AI真正用好,不当冤大头

结合那个“退市乌龙”的教训,以及我自己使用豆包、DeepSeek、千问、元宝这些工具的经验,我总结了四个原则,帮你在AI时代守住钱包和判断力:

(豆包、千问、DeepSeek等这样的人工智能软件都有这样可以调节的)

第一,多方交叉验证,这是底线。

这是最直接有效的方法。只要是涉及钱、法律、健康、投资的重大决定,同一个问题,必须同时问豆包、问DeepSeek、问千问、问元宝。把几个答案放一起对比。

就像那位朋友问退市,如果他在豆包上看到“风险高”,再去DeepSeek和千问里用专业模式问一遍,很可能就会得到“需进一步核实”或“当前无明显退市迹象”的答案。当多个AI说法不一致时,红灯就亮了——这时候必须停下来自己动手查,而不是选一个你爱听的答案去信。

第二,把“思考深度”调到最高。

现在几乎所有主流AI都有深度思考或专业模式选项。尽量把这个功能打开,不要用最基础的模式。越高的思考深度,意味着AI在做回答前会进行更多的信息筛选和逻辑推理,而不是“抓一堆网络碎片就扔给你”。这就像你雇人干活,不能只给实习生钱让他随便糊弄,得要求他交专业报告。

第三,学会追问,把AI当“辩手”而不是“裁判”。

不要AI回答什么就接受什么。第一个回答不满意,追问;回答里有可疑的地方,追问“你的信息源是哪?”“确定吗?”;你觉得可能有问题,要求它提供信息来源链接。有经验的AI使用者都知道,好答案从来不是“问”出来的,是“追问”出来的。一轮对话至少滚到三四轮以上,质量才有保障。

(有时候,我自己发给人工智能的文字可能会比它回答我的文字还多,这是因为我需要有一定的限定和思考空间,然后再让它去在我给的范围内去搜索和解析)

第四,始终保持“批判性阅读”的心态。

这一点最重要,也最容易被忽略。把AI当作一个帮你整理信息、提供思路的实习生助手,而不是替你拍板的专家顾问。涉及重大决策——投资、购房、择业、法律问题、医疗建议——AI的回答永远只能是参考的第一步,而不是最后一步。真正拍板并承担责任的人,只能是你自己。

(说句悄悄话哈,我是经常跟所有的人工智能软件吵架和干架的,因为很多信息查到的都是错的,我必须要多方面对比,然后才能查到可能是正确的资料,然后才能推断出一个可能是正确的答案。)

写在最后

AI能帮你更快地找到信息,但它不能替你思考。

AI能给你建议,但它不能替你承担责任。

别把自己的大脑轻易“外包”。在信息泛滥的时代,保持怀疑、保持严谨、保持独立判断的能力,才是最稀缺的竞争力。

算法给不了你智慧,只有你自己可以。

最后,祝大家周末愉快。

夜雨聆风

夜雨聆风