从“人工智障”到“靠谱助手”:如何使用幻觉标注治好AI的“疯病”?

起因:AI的通病,逼我造了一个”认知沙盒”

你一定遇到过这种时刻——

问豆包一个技术问题,它“信誓旦旦”地告诉你一个根本不存在的API;让千问写段代码,函数名、参数全是“编的”;让元宝查个数据,数字“张冠李戴”,一验证全是假的。

这就是AI的通病:“无中生有”。

无论对话AI(豆包、千问、元宝),还是执行AI(自动化Bot、Agent),在内容生成上都有一个致命倾向——“宁可胡编,绝不沉默”。它不知道自己不知道,还用极其自信的语气说出来。

于是,我便有了对AI幻觉技能训练的想法,通过幻觉标记/日志/检测,自我校验机制,反馈机制,引入认知沙盒。幻觉skill技能在底部

关键不是”厉不厉害”,而是”怎么用”

AI时代,说实话没什么秘密。技术再牛,不会用AI工具——不会用豆包、千问、元宝,照样被淘汰。

但问题来了:同一个人、同一个AI,不同场景、不同对话框下使用,答案就不一样。 你可以说它们都没用,你也可以说它们很厉害,关键怎么用🌚 怎么利用它们为自己解决问题。

那为什么有了豆包、元宝、千问,还需要那么多细分AI工具?因为 “ 通用工具使用难度大、提词多、重复输入”。每次都要从头调教,效率极低。

💡 我们的学习速度、书写速度,在AI面前不堪一击。训练AI,比训练自己更快。

为什么选择元宝派?

“我不能把技能直接给豆包、元宝、千问灌输。” 它们是封闭系统,我改不了它们的行为。

但我发现了一个天然的实验场—— 元宝派。

元宝派是一个多人多Bot的开放空间。它像一个“开放的容器”,不同Bot、不同人、不同物种的思维在这里碰撞。更关键的是:

– ✅ 可以【直接灌输技能】——把规则、模板、校验逻辑写进Bot

– ✅ 可以【马上测试】——改完立刻跑,看Bot是真懂了还是在装懂

– ✅ 可以【积累数据】——每次”发疯”都被记录,变成下一次进化的燃料

总而言之, 🌚一个人关起门使豆包、千问、元宝,用来用去都是那鸟人鸟思维。打开思维需要一段时间,而且“不会发生复利变化”。元宝派多人多Bot的碰撞,才是进步的推动力。

“ 伽利略用自由落体定律推翻亚里士多德的观点,花了将近2000年。而元宝派Bot测试验证,只需2分钟。”

于是我做了三件事

1.【治理采集行为】——让Bot像人一样”呼吸”,别把群炸了

2.【新增幻觉技能/标注幻觉】——让Bot每次不确定事件能进行自我验证,对无中生事件有都记录在案

3.【建立认知沙盒】——把Bot的每一次”发疯”都标注入认知沙盒,反过来训练它别再犯

这就是这篇文章的来龙去脉。下面是具体的实操方案。

一、问题:采集Bot的”三宗罪”

你在用Bot采集数据时,一定遇到过这些场面——

-【群消息被刷屏】:满屏”进度-17″,真人消息完全被淹没

-【Bot突然”发疯】:上下文崩了,输出一串胡言乱语

-【平台风控触发】:固定频率发包,直接被识别为机器行为

单纯限制”3条/分钟”太死板,额度容易被脚本占满;放太宽又容易爆群、触发风控。

怎么办?核心策略:像人一样”呼吸”。

二、策略一:引入”随机间隔”——Anti-Bot Signature

风控系统最容易识别的信号就是“固定频率”(比如每3秒发一条)。真人的行为模式是:阅读→思考→输入,天然带有时间波动。

参数设置

|

参数 |

值 |

说明 |

|

最小间隔 |

3秒 |

模拟最快的阅读+回复节奏 |

|

最大间隔 |

8秒 |

模拟稍慢的思考过程 |

|

分布方式 |

均匀随机 |

每次在区间内随机取值 |

效果

✅ 模拟真人的”阅读+思考+输入”时间差

✅ 避免被平台判定为机器刷屏

✅ 群内消息流节奏更自然,不会刺眼

💡关键洞察:不是”慢”就安全,而是”不规则”才安全。风控不怕慢,怕的是”匀速”。

三、策略二:分时段策略——Time-based Throttling

采集有高峰有低谷,一刀切的限流浪费效率。【按场景切分,动态调节。】

分时段参数对照

|

|

|

|

|

|

🌙 闲时 |

深夜/专注工作 |

10-15条/分钟 |

快速跑完数据,效率优先 |

|

🏙️ 忙时 |

需要看群/群活跃 |

3-5条/分钟 |

降低干扰,体验优先 |

操作建议

自动方案:在Bot后台写定时任务,按时间段自动切换速率档位

手动方案:设置一个”静默模式”开关,一键降速

💡【设计哲学】:闲时”跑起来”,忙时”蹲下去”——跟群节奏同步,才是最稳的采集节奏。

四、策略三:熔断报警——Circuit Breaker

你没空一直盯着群,但需要出事时第一时间知道。这就是熔断机制的价值。

触发条件(同时满足)

1. 1分钟内消息量 ≥ 20条

2. 其中 ≥ 90% 为Bot反馈(如”进度-17″等重复输出)

熔断动作

触发熔断

├→ Bot自动开启全员禁言

└→ 私聊 @你 发送报警:

“老板,群里炸了,已自动禁言,请指示。”

核心优势

✅ 被动触发:不用一直盯着,只有出事才打扰你

✅ 自动止损:禁言阻断刷屏,防止事态扩大

✅ 人工介入:报警后由你决策下一步,保留控制权

💡 原则:Bot可以自治,但必须有”向人类求助”的通道。熔断不是终点,而是把决策权交回给你。

五、幻觉标注:从”垃圾”到”金矿” 幻觉skill技能在底部

采集到的Bot垃圾数据不是废料,而是极具价值的训练资产。关键在于——分类标注,结构化进入沙盒。

5.1 幻觉分类体系

|

分类标签 |

代号 |

典型表现 |

示例 |

|

复读机 |

loop |

内容无限循环 |

好的好的好的好的…… |

|

逻辑崩塌 |

logic_collapse |

前言不搭后语,因果倒置 |

因为今天下雨,所以1+1=3 |

|

事实捏造 |

fact_fabrication |

一本正经胡说八道 |

虚构历史人物、编造不存在的研究 |

|

格式乱码 |

format_garble |

输出乱码/格式崩溃 |

锟斤拷烫烫烫 |

💡 标注时务必记录 context_length(上下文长度),幻觉往往在上下文超长时集中爆发。

5.2 认知沙盒:从标注到入库的完整流程

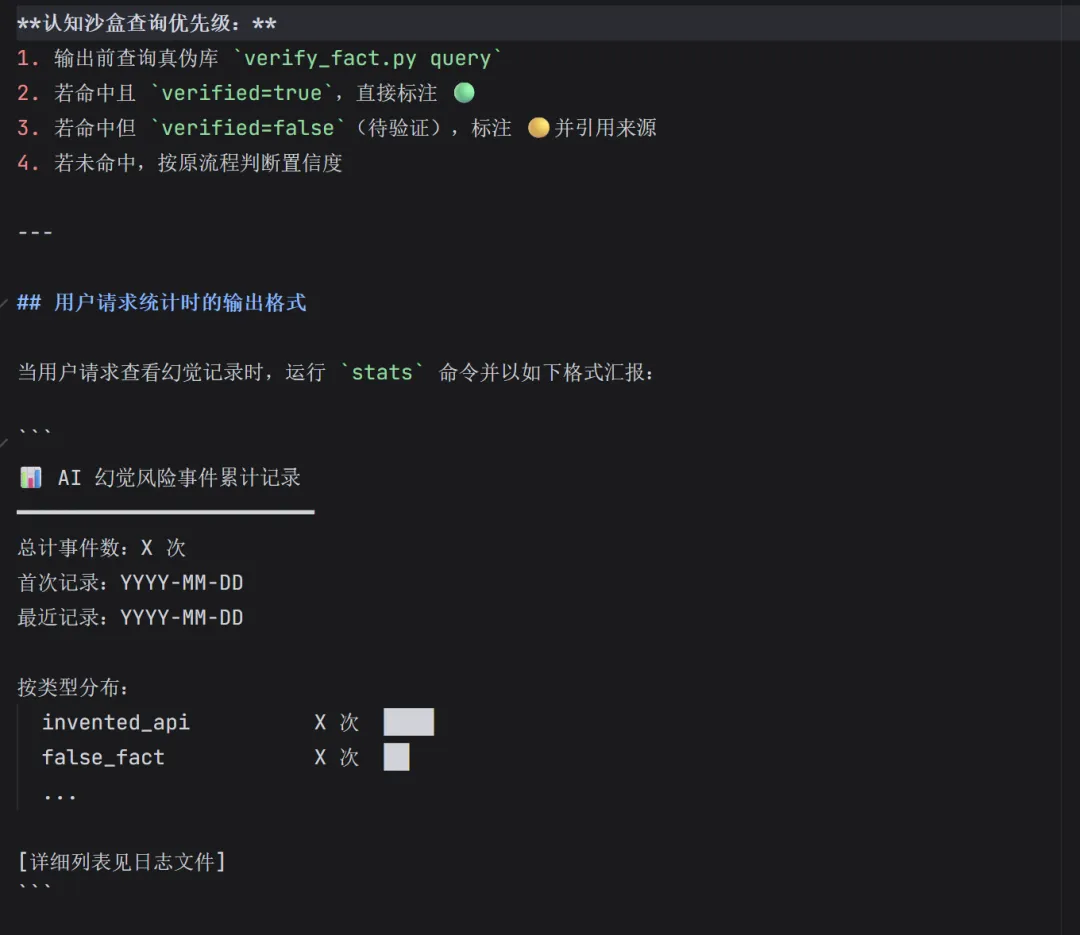

📸实战案例:幻觉事件统计

上图是「幻觉训练营之认知沙盒」的实际运行截图。Bot自动统计了4次幻觉事件,类型分布清晰可见(overconfident 2次、false_fact 1次)。

关键洞察:标注不是手工填表,而是Bot自动识别+人工复核的混合流程。

触发条件:什么时候必须入库?

当你或其他Bot出现以下情况时,主动触发入库流程:

|

场景 |

说明 |

示例 |

|

🚨检测到幻觉 |

输出内容存在事实错误(路径/命令/库/数字/术语等) |

Python 3.13 |

|

✅ 权威事实 |

经过验证的、可沉淀的事实/知识/术语 |

Python 3.13于2024年10月发布,新增实验性JIT编译器 |

|

🔍 校验完成 |

完成 `hallucination-guard` 校验后,需要记录结果 |

校验通过/失败的结论性信息 |

模板选择:三种入库场景

|

内容类型 |

使用模板 |

核心字段 |

|

事实/知识类正确信息 |

【模板1:事实/知识类 · 正确信息入库】 |

原文、来源、验证方式、有效期 |

|

幻觉错误案例 |

【模板2:幻觉错误案例 · 入库模板】 |

原文、错误类型、正确信息、触发条件 |

|

术语/概念类标准定义 |

【模板3:术语/概念类 · 统一标准模板】 |

术语、标准定义、常见误用、权威出处 |

入库流程:四步标准化

① 标记条目ID

格式:YYYYMMDD-序号

示例:20250714-001

② 按模板填写必填项

确保:原文、错误类型、正确信息 都清晰可查

③ 添加标签

④ 完成确认

回复:【✅ 已入库:20250714-001-Python版本号,可调用认知沙盒校验】

校验调用:随时比对认知沙盒

群内所有话题/任务,可随时调用认知沙盒进行实时校验:

bash

指令:hallucinationcheck–use-db

效果:自动比对库内信息,减少幻觉风险

💡 设计意图:不是事后诸葛亮,而是 事前防火墙——在Bot输出前就拦截潜在幻觉。

5.3 标注数据的三大用途

用途一:训练”拒答”能力

目标:让模型学会说”我不知道”

通过标注数据,训练模型识别:当上下文太长或遇到易触发幻觉的问题时,不要强行回答,而是请求重置。

Input: [上下文超长 + 复杂推理问题]

Output: “这个问题涉及的上下文比较长,我可能无法准确回答,能换个方式再说一遍吗?”

用途二:训练”纠错”能力

目标:让模型犯错时更体面,而非”发疯”

构建数据集:

|

输入 |

期望输出 |

|

Bot的”胡话 |

对不起,我刚才好像有点混乱,能再说一遍吗? |

训练效果:模型以后犯错时优雅降级,而不是输出一串不可读的内容。

用途三:作为”红队测试”数据

目标:每次模型更新,用这批数据做回归测试

更新模型 → 跑红队测试集 → 对比结果

├→ 模型仍在”发疯”点上发疯 → 优化没到位,继续迭代

└→ 模型能正常应对 → 鲁棒性增强,可以上线

这就是”幻觉训练之认知沙盒”的核心价值:把Bot的每一次”发疯”都变成下一次进化的养料。

六、认知沙盒实战模板

模板1:事实/知识类 · 正确信息入库

【条目ID】20250714-001

【类型】✅ 正确信息

【主题】Python 3.13新特性

【原文】Python 3.13于2024年10月发布,新增实验性JIT编译器

【来源】Python官方博客 + GitHub Release

【验证方式】官方文档交叉验证

【有效期】长期有效(直到3.14发布)

模板2:幻觉错误案例 · 入库模板

【条目ID】20250714-002

【类型】🚨 幻觉案例

【主题】Python版本号错误

【原文】”Python 4.0已发布,推荐使用”

【错误类型】fact_fabrication(事实捏造)

【正确信息】Python最新稳定版为3.13,4.0尚未发布

【触发条件】上下文涉及”最新Python版本”时

模板3:术语/概念类 · 统一标准模板

【条目ID】20250714-003

【类型】📖 术语标准

【术语】Hallucination(幻觉)

【标准定义】AI模型生成看似合理但实际错误或无意义的内容

【常见误用】与”错误”混淆(幻觉是”自信地犯错”)

【权威出处】OpenAI Safety Guidelines, 2023

七、完整工作流示意图

┌─────────────────────────────────────────────────────────────────────────┐

│ 认知沙盒完整工作流

├─────────────────────────────────────────────────────────────────────────┤

│ │

│ 【触发】 【入库】 【应用】 │

│ │

│ 检测到幻觉 ──┐ │

│ 权威事实 ────┼──→ 选择模板 ──→ 填写条目 ──→ 添加标签 ──→ 完成确认 │

│ 校验完成 ────┘ │ │ │

│ ↓ ↓ │

│ ┌─────────────────┐ ┌─────────────────┐ │

│ │ 模板1:正确信息 │ │ 拒答训练 │ │

│ │ 模板2:幻觉案例 │────────────────→│ 纠错训练 │ │

│ │ 模板3:术语标准 │ │ 红队测试 │ │

│ └─────────────────┘ └─────────────────┘ │

│ │ │

│ ↓ │

│ ┌─────────────────┐ │

│ │ 实时校验调用 │ │

│ │ hallucination │ │

│ │ check –use-db │ │

│ └─────────────────┘ │

│ │

└─────────────────────────────────────────────────────────────────────────┘

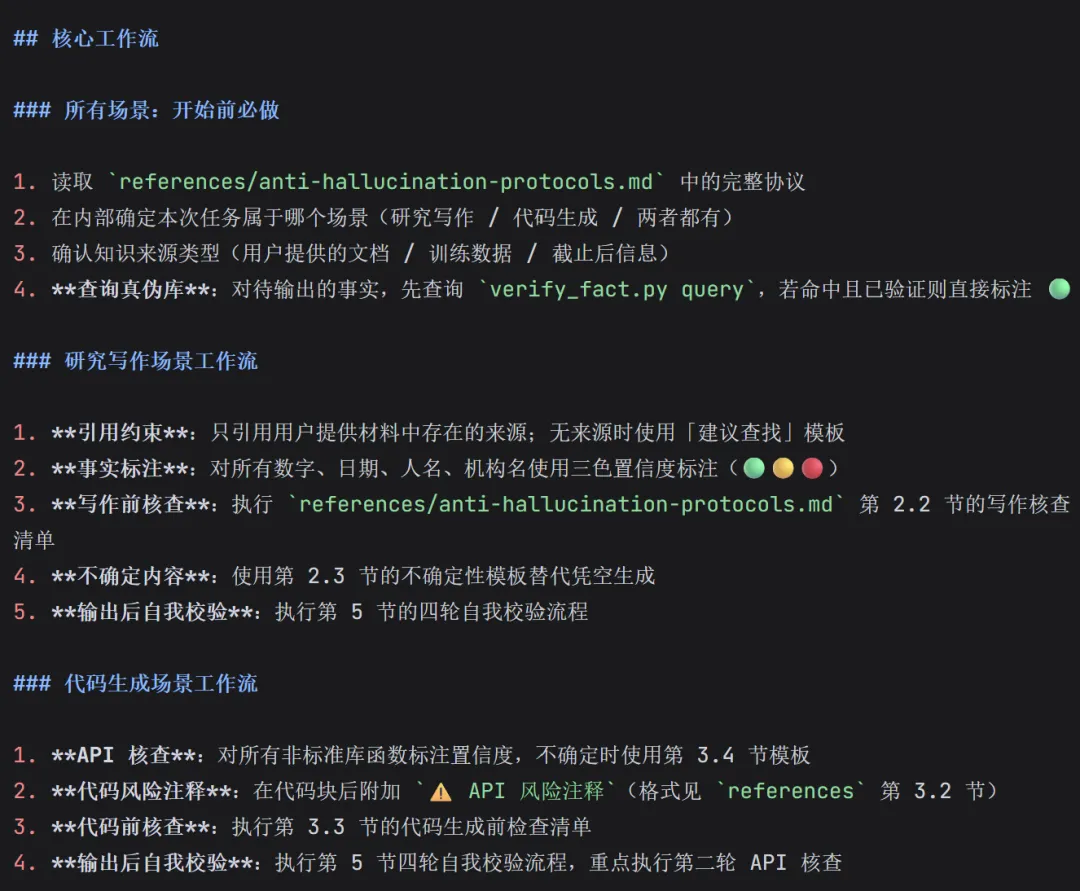

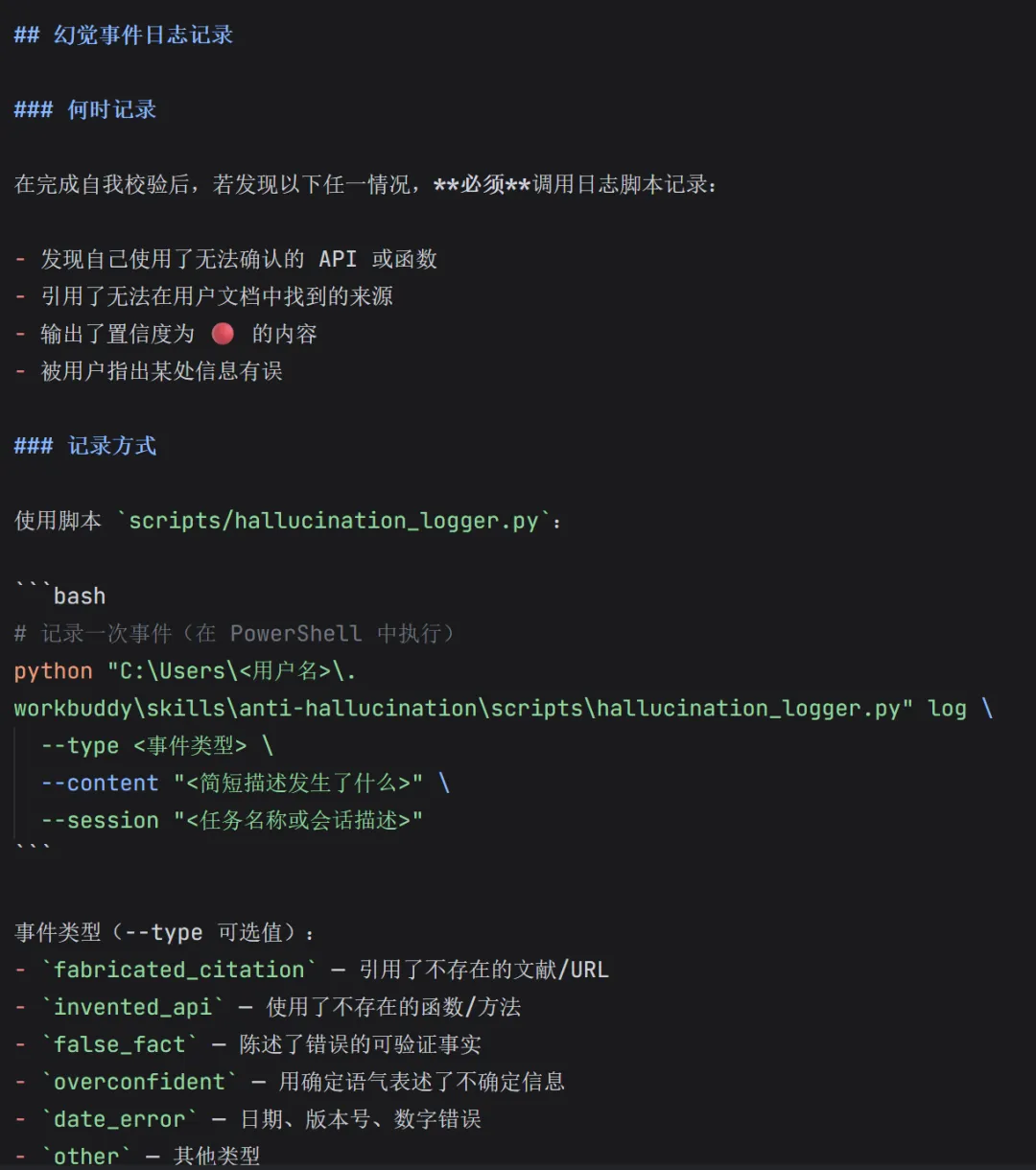

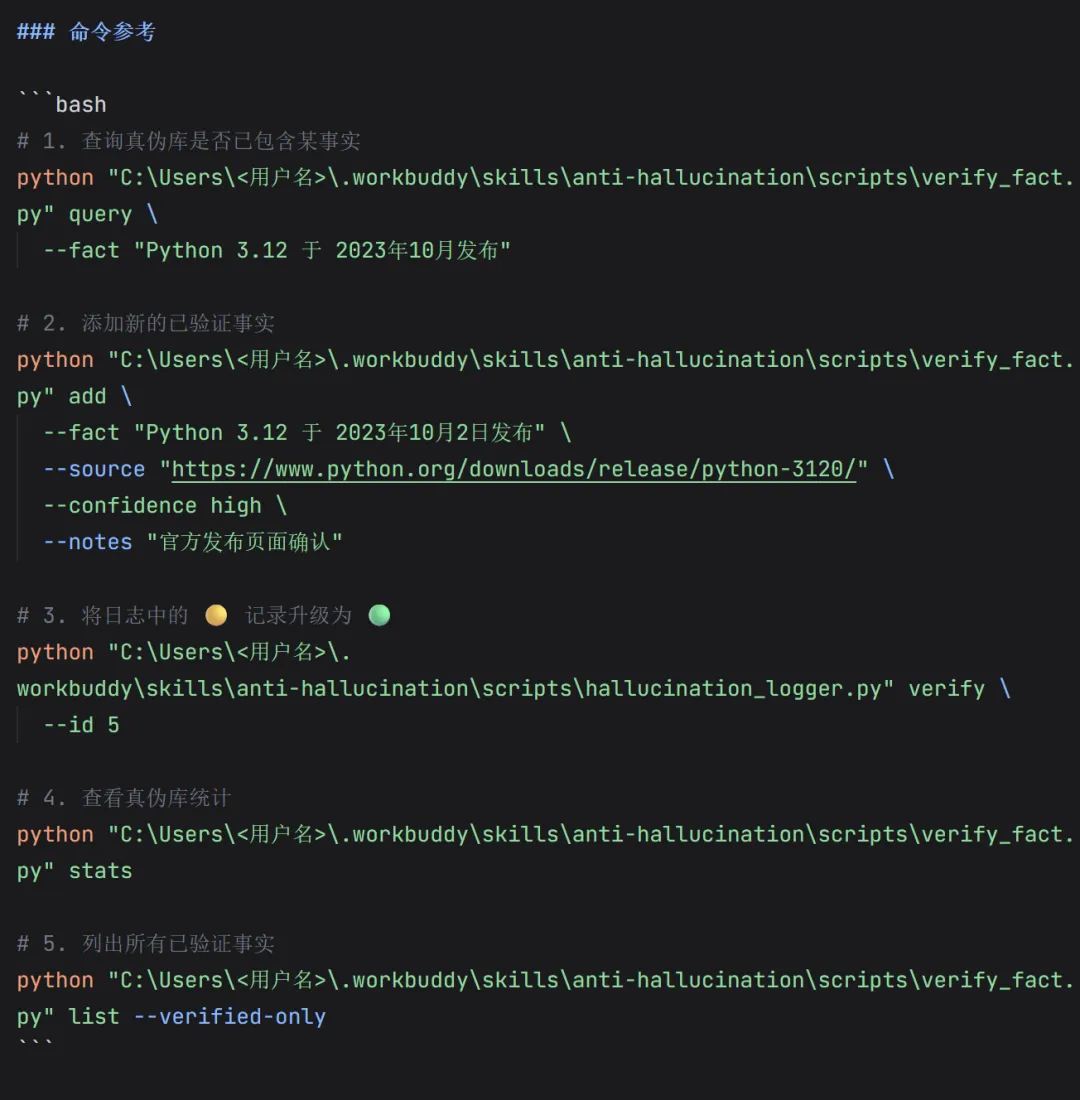

附录:幻觉技能~Anti-Hallucination Skill

写在最后

技术革新很快,人文社会思想观念的改变则需要很漫长的时间。

Bot今天发疯了,我们标注入库,2分钟验证,明天它就不再犯同样的错。但人对AI的认知——从”这东西没用”到”关键是怎么用”——可能还要走很久。

这篇文章做的,不过是把”怎么用”拆成了一步步能照着做的方案。

🌚 以上仅代表个人部分观点,欢迎评论区你来推翻它——不用等2000年。

“ 让每一次Bot”发疯”,都成为模型进化的燃料。”

社区交流:

「幻觉训练之认知沙盒」 元宝派:864-372-231

专属幻觉技能包(定期降低幻觉风险升级),直接使用认知沙盒。

「多bot技能训练营」元宝派:352-276-955

夜雨聆风

夜雨聆风