openFuyao技术讲堂 | AI推理赫尔墨斯智能路由(Hermes-router)

openFuyao开源社区聚焦“AI云原生”,打造多样化算力互联的集群管理与调度能力,提供算力亲和组件及面向生产的社区发行版,实现集群算力的弹性调度和高效释放。

01

特性介绍

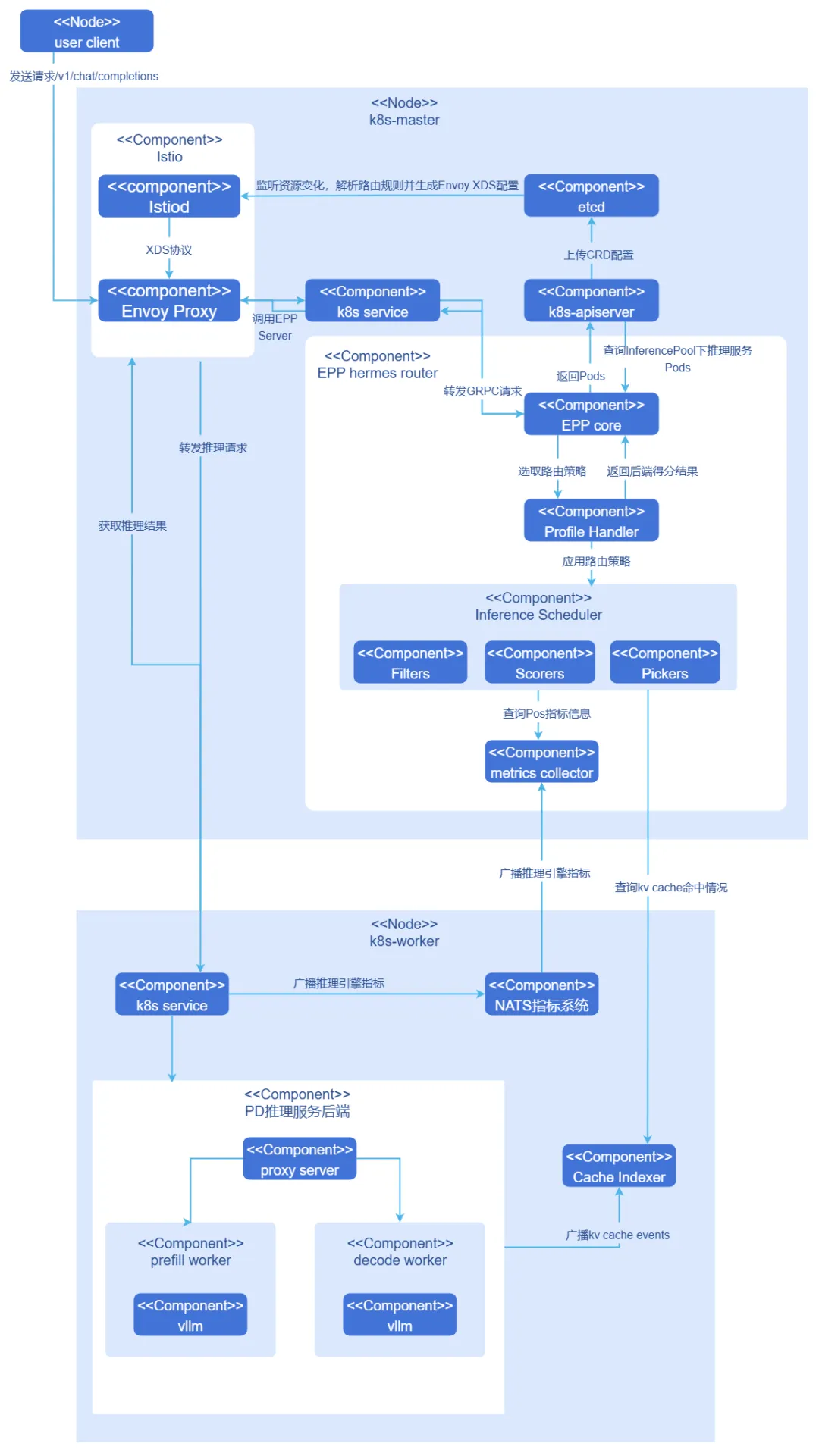

Hermes-router是openFuyao基于K8s打造的EPP(Endpointer Picker)组件,用于接收用户推理请求并路由至最合适的服务后端,优化LLM的推理效率和性能。

Hermes(赫尔墨斯)是希腊神话中众神的信使,以敏捷和可靠著称。openFuyao以此命名AI推理智能路由组件为Hermes-router,寓意成为云原生环境中 AI 推理请求的智能信使,精准高效地完成每一次路由选择。

特性价值如下:

加速AI推理服务响应:KVCache感知策略调度时充分考虑后端缓存情况,避免重复计算,降低请求响应时延。

保障高并发请求吞吐稳定:PD分桶策略按请求长短分流调度,变长请求不再互相拖慢。

灵活适配开源网关:基于K8s GIE标准(Kubernetes Gateway API Inference Extension)构建,支持接入Istio等多类主流开源网关,用户可选择范围广。

直接阅读本文,或识别二维码前往官网博客阅读完整版(可跳转详情链接):

1.1 应用场景

|

应用场景 |

详情 |

|

云原生AI推理服务 |

在K8s集群中部署LLM推理服务,需要智能路由能力来优化请求分发和资源利用 |

|

多实例推理后端 |

需要将推理请求智能路由到多个推理服务实例(支持聚合架构或PD分离架构),实现负载均衡和性能优化 |

|

高并发推理 |

在长短请求混合、中高并发的业务场景中,需要根据请求特征和实例负载状态进行智能调度,提升推理吞吐量 |

|

KVCache aware优化 |

在重复请求较多的场景中,需要利用KVCache命中率信息进行路由优化,提升推理性能和资源利用率 |

|

网关集成 |

已有K8s网关基础设施,需要在不影响原有网关的基础上,增加AI推理路由能力 |

1.2 亮点特征

-

遵循GIE框架,天然支持K8s网关体系,支持集成多种开源网关。在已有网关的集群,可以作为可插拔能力加入,在不影响原有网关的基础上增加AI推理路由能力。

-

提供多种创新路由策略,支持聚合、PD等推理后端架构,帮助使用者在多种业务场景中提升性能。

-

KVCache aware(聚合/PD):提供允许用户自定义得分函数的KVCache aware路由策略,在重复请求场景提升推理性能。

-

PD分桶调度路由 (PD):提供允许用户自定义参数的分桶调度策略,在长短请求、中高并发场景提升推理吞吐量。

-

动态推理服务发现:允许用户在运行时新增/删除推理后端,用户可灵活调整推理资源投入。

1.3 特性依赖

-

cache-indexer:使用KVCache aware类型策略时依赖cache-indexer,通过/match_sort接口从该组件获取KVCache命中率。

-

vLLM-ascend:

-

PD代理服务组件proxy-server:原为vLLM官方在PD分离架构下提供的示例组件,作为中枢组织P/D实例完成推理任务,openFuyao社区对该组件进行增强,现作为PD Group的Leader实例接收网关推理请求,并具备根据指定标签动态发现推理服务实例的能力。

-

NPU适配:当环境为昇腾NPU时,需要使用vLLM-ascend作为推理引擎启动服务。

-

推理指标:依赖vLLM提供的/metrics接口获取推理服务指标,由GIE架构自动采集。

02

实现原理

Hermes-router以EPP组件形式集成到开源网关,以一次完整推理请求为例说明内部原理:

-

用户向集群网关发送openAI API请求/v1/chat/completions。

-

网关识别到请求为推理请求,将请求转发至EPP。

-

EPP根据用户配置的路由策略处理请求,选出最适合处理该推理请求的推理后端。

-

EPP将推理后端返回集群网关,集群网关将推理请求发送至最佳推理后端。

-

推理后端完成请求返回网关,网关将推理结果返回用户。

03

安装部署

Hermes-router提供两种交付方式,用户可按需选择,具体安装步骤请参见:

https://docs.openfuyao.cn/zh/docs/v25.12/user_guide/ai_inference_hermes_routing.html#安装

-

EPP插件单独部署 Hermes-router作为单独的EPP组件部署到集群中,需要集群中已有Envoy based的Gateway、Gateway API及Inference Extension CRDs、以及推理后端服务。Hermes-router部署后提供多种AI推理智能路由策略(KVCache aware、PD分桶调度等),通过InferencePool CR动态发现和管理推理后端,支持通过HTTPRoute进行灵活配置。

-

InferNex集成部署 InferNex是完整的AI推理服务集成部署包,一键部署网关、Hermes-router、HTTPRoute/InferencePool等K8s资源、以及推理后端服务。提供端到端的AI推理解决方案,集成网关、智能路由和推理服务,开箱即用。

04

未来展望

未来,Hermes-router将继续在以下方面做能力增强:

-

生产场景容灾能力,包含自动切流、故障感知以及推理请求重试。

-

基于时延预测与算力饱和度的路由策略,面向NPU、GPU多种算力场景进一步降低TTFT。

-

KVCache aware路由策略增强,进一步感知分布式内存中的L3级别KVCache信息,基于全局命中率优化请求调度。

05

资源参考

更多openFuyao v25.12版本软件包可在如下地址下载(单击”全部版本”后选择”v25.12″):

https://www.openFuyao.cn/zh/download/

往期推荐

openFuyao技术讲堂 | AI推理鹰眼(Eagle Eye)

openFuyao技术讲堂 | Cluster API安装指导

openFuyao技术讲堂 | 快速安装管理面

夜雨聆风

夜雨聆风