4月30日,AI开始自己接任务了

4 月 30 日最值得看的,不是哪一个模型又多会聊天了,而是 AI 正在学会自己接任务、跑流程、交结果。

过去一年,很多人对 AI 的用法还停在一个很窄的画面里:打开聊天框,提问,复制答案,再回到自己的工具里继续干活。今天的信号更像是另一件事:AI 正在从「回答问题的窗口」变成「能进入工作现场的执行层」。

这不是一句概念话。Cursor、Codex、Claude、MCP、Mistral、Gemini、Grok、holaOS 都在从不同方向往同一个终点走:让 AI 进入真实工具链,承担更长、更完整、更可审查的工作。

Cursor 今天的两个动作很关键。

第一个是开放 SDK。开发者可以使用和 Cursor 相近的 runtime、harness 和模型能力,去构建自己的 AI 编程 agent。它不只是让你在编辑器里补几行代码,而是可以接入 CI/CD、运行在沙盒虚拟机里、连接 GitHub、自动生成 PR,甚至直接嵌进产品。

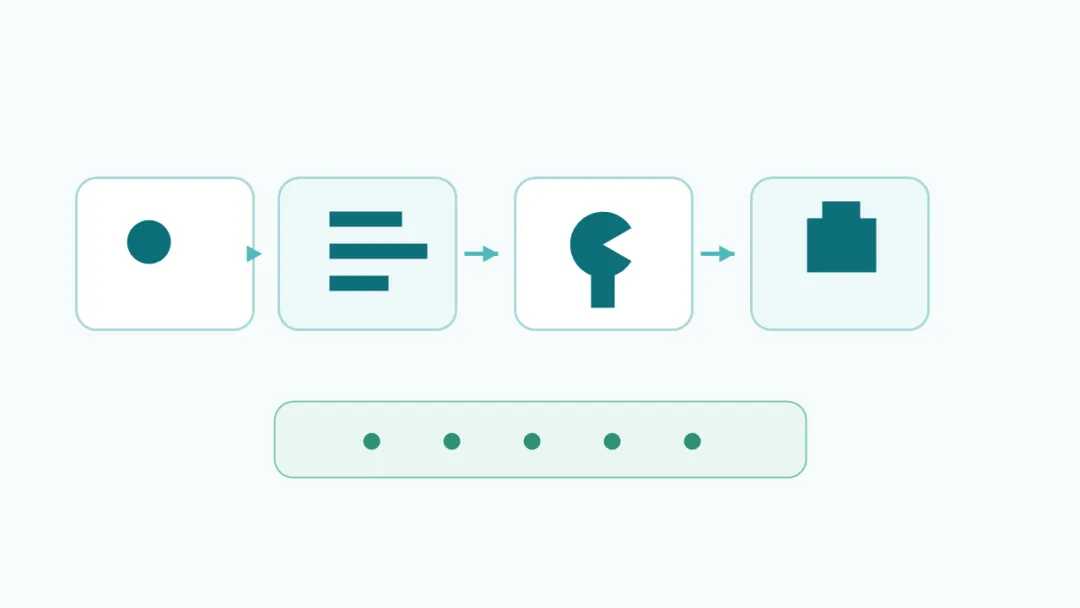

第二个是内置 Kanban 看板。人把任务放进去,agent 自己领取、推进、完成。

这件事的变化很大。以前的 AI 编程像一个很强的副驾驶,你要一直坐在旁边说下一步。现在它开始像一个任务队列里的执行者:你给目标、边界和审查标准,它负责把中间步骤跑起来。

如果这个方向成立,未来的软件团队会多一层新分工:人不再只写代码,也要写清楚任务、约束、验收标准和回滚方式。管理 AI 工作流,本身会成为工程能力的一部分。

Codex 和 Claude 都在靠近真实工作

OpenAI 这边也有几个强信号。

Sam Altman 说 Codex 正在经历类似 ChatGPT 的时刻。另一条流传很广的演示里,GPT-5.5 通过 Codex 在真实页面里处理 Amazon 客服相关流程,能自己导航设置、取消订阅、继续进入帮助页面。

这类演示真正重要的地方,不是「它很聪明」,而是它开始能在复杂界面里连续行动。

Claude 这边则继续把能力放进开发者工作流。Claude Code 内置了 Claude Platform 相关技能,方便做模型迁移、提示缓存、API 接入和 Managed Agents。与此同时,围绕 Claude 的插件、MCP 服务器和连接器越来越多,有人整理出 50 个真正能改变工作流的集成。

这说明一个趋势:AI 产品的竞争,正在从模型本身扩展到「能连接多少工具」「能保留多少上下文」「能不能在真实流程里闭环」。

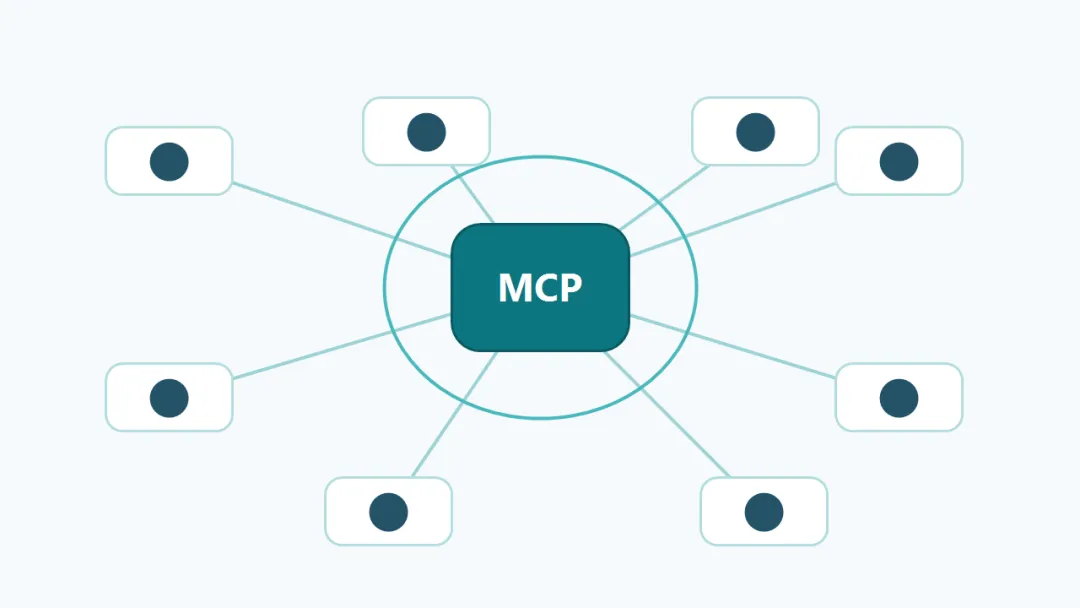

MCP 正在变成 AI 工具的插座

MCP 今天出现得很频繁。

Higgsfield AI 推出 MCP 服务器,把创意引擎接到 Claude。用户可以在 Claude 里优化提示词、生成广告、视频和品牌内容。Adapt 这类工具也在展示跨 GitHub、Slack、Salesforce、Stripe、Linear 的查询和流程自动化。

如果只把 MCP 理解成「插件协议」,就看小了。它更像是 AI 工具世界里的插座:模型不需要把每个外部系统都硬编码进自己体内,而是通过标准接口接触文件、应用、数据和动作。

这会带来两个结果。

第一,AI 助手会越来越不像孤立应用,而像一个坐在所有业务系统中间的协调层。

第二,真正有价值的产品不只是「接上模型」,而是把权限、状态、记忆、审计、异常处理和人工确认都做完整。只有这样,AI 才能从演示走向生产。

模型竞争开始分成三条线

4 月 30 日的模型消息也很密集,但它们已经不再只是同一种竞赛。

百度 ERNIE 5.1 Preview 在 LMArena 上成为排名最高的中国模型之一,说明中文模型的前沿竞争还在继续。Mistral Medium 3.5 主打 128B 参数、256k 上下文,以及可以把本地编码会话转到云端继续运行的异步代理能力。Gemma 4 则强调完全本地化的 AI 编码体验,通过 Apple MLX 在 Mac 上离线运行。

这三件事代表三条线:

一条线追求更强的通用能力,一条线追求更长上下文和云端执行,一条线追求本地、低依赖和隐私控制。

对普通开发者和创业团队来说,未来选模型不再是单选题。你可能会同时需要云端强模型、本地小模型、长上下文模型、专门处理安全或代码的模型。模型会变成一组可调度的资源,而不是一个固定入口。

安全问题也被推到台前

OpenAI 今天还发布了网络安全相关行动计划,并开始向关键网络安全团队推出 GPT-5.5-Cyber。据说这个模型在漏洞研究和利用模拟上表现很强,在 Cyber Range 基准测试中得分 93%。

这类能力一定会越来越敏感。

同样的模型可以帮助防守方更快发现漏洞,也可能帮助攻击方更快组合攻击路径。真正的问题不是「要不要用 AI 做安全」,而是怎样把访问权限、使用边界、审计日志和责任链条设计好。

AI 越能干活,安全越不能只靠一句免责声明。

最值得记住的一句话

Andrej Karpathy 今天提到一个更底层的判断:计算可能从经典软件转向神经系统。神经网络不再只是被代码调用的模块,而是可以直接处理视频、音频、上下文,并实时生成界面和动作。

这句话听起来很远,但和今天这些产品更新是同一件事。

软件不再只是固定按钮和固定流程。越来越多的界面、任务和操作,会由模型根据上下文即时生成。CPU 和传统程序还在,但它们可能更像稳定的骨架;模型负责理解、协调和生成动作。

所以 4 月 30 日这一天的主线很清楚:

AI 正在从会聊天,走向会接任务;从单点工具,走向工作系统;从炫技演示,走向需要被管理、审查和纳入生产的执行层。

这对开发者是机会,也是门槛。

真正的差距,不在于谁收藏了更多工具清单,而在于谁能把 AI 放进自己的实际流程里,让它稳定地产生结果。

夜雨聆风

夜雨聆风