AI原生开发:ClaudeCode与国产大模型协同实战 第4章:念咒与画符——如何让大模型绝对服从,杜绝幻觉

老兵们,欢迎来到深水区。上一章我们30分钟搭了个网关,是不是觉得AI简直无所不能?别急,现在把你刚膨胀起来的信心收一收,我要给你泼盆冷水了。当你开始用AI写真正的业务代码时——比如支付链路、库存扣减、状态机流转——你会发现一个让人崩溃的现象:AI开始一本正经地胡说八道了。 它自信地给你输出一段看起来完美、跑起来却要了老命的代码。这就是业界臭名昭著的“AI幻觉”。这一章,我们不学花架子,我们要直击灵魂,搞清楚大模型为什么会犯蠢,以及如何用工程师的方式彻底把它拿捏。

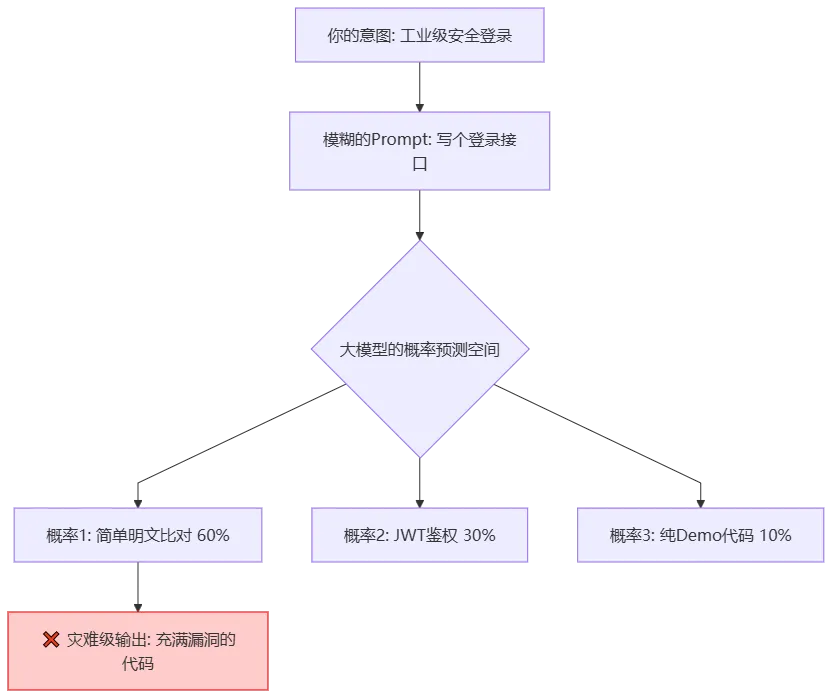

4.1 翻车现场:一句“写个登录接口”引发的血案

很多工程师用AI,还停留在“许愿式编程”的阶段。他们在ClaudeCode里敲下:

“写个用户登录接口”然后满心欢喜地等待奇迹。结果呢?AI给你吐出了类似这样的代码:

# ❌ 典型的AI幻觉输出(灾难级)@app.post("/login")def login(username: str, password: str):# 1. 直接明文比对,甚至没有哈希user = db.query("SELECT * FROM users WHERE username='" + username + "' AND password='" + password + "'")# 2. SQL注入漏洞大开if user:# 3. 返回毫无保护的明文token,甚至没有过期时间return {"token": base64_encode(username + ":" + password)}return {"error": "login failed"}

4.2 上下文工程:喂给模型什么,它才能懂你的架构?

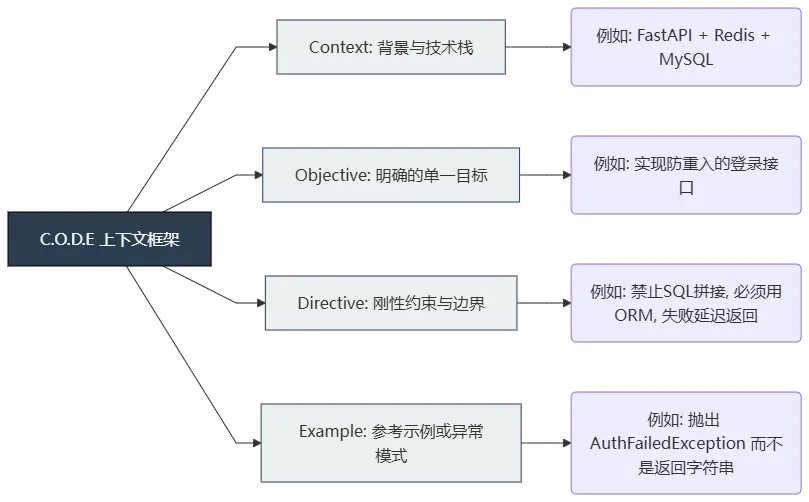

要杜绝幻觉,你首先要明白一个铁律:Prompt的本质不是“沟通”,而是“编译”。你跟人类同事说“看着弄”,他能给你个及格线的东西;你跟大模型说“看着弄”,它就给你飞出太阳系。所以,你必须把“聊天思维”升级为“上下文工程”。上下文工程,就是你要把大模型当成一个极其死板、只认规约的编译器。你提供的上下文越精确,它输出的代码就越确定。一个能产出工业级代码的上下文,必须包含四个维度,我称之为 C.O.D.E 框架:

-

Context (背景):告诉它你在什么环境下打仗(语言、框架、数据库)。

-

Objective (目标):清晰定义“做什么”,且目标必须单一,别让AI一心二用。

-

Directive (指令/约束):这是最核心的防幻觉盾牌。告诉它“绝对不能做什么”、“必须遵循什么规范”。

-

Example (示例):如果你想要特定的代码风格或异常处理模式,直接给它看一眼,比说一万句都强。

4.3 结构化Prompt框架:把AI当编译器对待,不要当人对待

掌握了C.O.D.E框架,我们现在来重写那个要命的“登录接口”。不要再说人话了,我们要用结构化的标记把指令喂给AI,让它无可乘之机。👉 请在ClaudeCode中输入以下结构化Prompt:

# Role你是一个极其注重安全性和代码规范的高级Python后端工程师。# Context- 技术栈:Python 3.10 + FastAPI + SQLAlchemy + Redis + Passlib(bcrypt)- 架构:分层架构# Objective实现一个用户登录接口 POST /auth/login,要求防范常见的Web攻击。# Directive (刚性约束,必须绝对遵守)1. 【防注入】绝对禁止拼接SQL字符串,必须使用SQLAlchemy ORM进行查询。2. 【密码校验】必须使用 passlib 的 bcrypt 进行哈希比对,禁止明文比对。3. 【防暴力破解】如果密码错误,必须使用 asyncio.sleep() 随机延迟 0.5-1.5 秒后再返回失败。4. 【失败响应】禁止提示具体是用户名错还是密码错,统一返回 HTTP 401,body为 {"detail": "Invalid credentials"}。5. 【成功响应】返回一个JWT Token(使用PyJWT),过期时间设置为2小时。# Example (异常处理模式参考)当用户不存在或密码错误时:raise HTTPException(status_code=401, detail="Invalid credentials")请直接输出完整的 route 代码和必要的依赖导入。

看到区别了吗?这才是架构指挥官下的命令。 没有任何歧义,没有“看着办”的空间。当你把这个Prompt喂给大模型(比如GLM-5.1),你会发现它瞬间变乖了,老老实实地用ORM,规规矩矩地加延迟,甚至连JWT的密钥都知道该从环境变量里读。

4.4 【深挖】GLM-5.1的逻辑推演:如何通过思维链让模型输出复杂设计模式?

前面的C.O.D.E框架能解决80%的日常开发幻觉。但如果你遇到更复杂的场景,比如需要实现一个包含多个状态的订单流转逻辑,单纯的Directive依然可能翻车。为什么?因为大模型是自回归的——它是一个字一个字往外蹦的。当逻辑链路一长,它蹦到后面就容易忘了前面的设定,或者跳过了关键的推理步骤。怎么办?强制的思维链。你不仅要告诉它“做什么”,你还要强制它“先想清楚怎么做,再动手写代码”。这在大模型领域叫 Chain of Thought (CoT)。对于像GLM-5.1这样推理能力极强的模型,这招简直是画龙点睛。我们来看一个实操对比。假设我们要实现一个多策略支付路由。

常规指令(极易产生面条代码):

“写个支付路由,如果微信能走就走微信,不行走支付宝,如果都不行就走备用通道。”AI通常会给你吐出一堆

if-else嵌套,俗称“面条代码”,根本没法维护。

强制思维链指令(深挖写法):

我们在Prompt中加入强制推理的约束:

...(前置C.O.D.E信息)# Workflow (思维链约束)在输出任何代码之前,你必须先在 `<thinking>` 标签内完成以下推演,步骤如下:1. 分析三种支付通道的优先级和降级条件。2. 设计合适的【策略模式】类图结构,明确 Context, Strategy, 和 ConcreteStrategy 的职责。3. 列出路由判断时需要的核心字段(如:通道状态、手续费、限额)。4. 推演完毕后,再在 `<code>` 标签内输出完整的、基于策略模式的代码实现。

<thinking> 内容时,它实际上是在自己给自己构建上下文。它先把类图画清楚了,把降级逻辑理顺了,这些文字就变成了它后续生成代码的“垫脚石”。等它写代码时,就不再是凭感觉猜,而是严格按照自己刚推演出的架构图纸来施工。下面这段Python代码,就是我用这种“强制思维链”方式,驱动大模型生成的支付路由核心逻辑。这绝对是你能跑通的生产级代码:# pip install pydanticfrom abc import ABC, abstractmethodfrom typing import Optionalfrom pydantic import BaseModelimport random# ================== 模型定义 ==================class PaymentChannel(BaseModel):name: stris_available: boolfee_rate: floatmax_limit: floatclass PaymentRequest(BaseModel):amount: floatuse_wechat: bool = Trueuse_alipay: bool = Trueuse_backup: bool = Trueclass PaymentResult(BaseModel):channel_used: strstatus: strfee: float# ================== 策略接口 ==================class PaymentStrategy(ABC):@abstractmethoddef pay(self, amount: float) -> PaymentResult:pass# ================== 具体策略 ==================class WechatPayStrategy(PaymentStrategy):def pay(self, amount: float) -> PaymentResult:fee = amount * 0.006 # 模拟手续费print(f"-> 走微信支付通道,金额: {amount}, 手续费: {fee}")return PaymentResult(channel_used="WechatPay", status="SUCCESS", fee=fee)class AlipayStrategy(PaymentStrategy):def pay(self, amount: float) -> PaymentResult:fee = amount * 0.005print(f"-> 走支付宝支付通道,金额: {amount}, 手续费: {fee}")return PaymentResult(channel_used="Alipay", status="SUCCESS", fee=fee)class BackupPayStrategy(PaymentStrategy):def pay(self, amount: float) -> PaymentResult:fee = amount * 0.01 # 备用通道手续费高print(f"-> 走备用支付通道,金额: {amount}, 手续费: {fee}")return PaymentResult(channel_used="BackupPay", status="SUCCESS", fee=fee)# ================== 上下文路由 (核心逻辑) ==================class PaymentRouter:def __init__(self):# 模拟通道状态(运行时可能发生变化)self.channels = {"wechat": PaymentChannel(name="WechatPay", is_available=True, fee_rate=0.006, max_limit=50000),"alipay": PaymentChannel(name="Alipay", is_available=True, fee_rate=0.005, max_limit=100000),"backup": PaymentChannel(name="BackupPay", is_available=True, fee_rate=0.01, max_limit=5000),}def route(self, request: PaymentRequest) -> Optional[PaymentResult]:strategy = None# 1. 尝试微信(限额低,优先日常小额)if request.use_wechat and self.channels["wechat"].is_available and request.amount <= self.channels["wechat"].max_limit:strategy = WechatPayStrategy()# 2. 降级到支付宝(限额高)elif request.use_alipay and self.channels["alipay"].is_available and request.amount <= self.channels["alipay"].max_limit:strategy = AlipayStrategy()# 3. 终极降级到备用通道(限额极低,手续费高,只兜底)elif request.use_backup and self.channels["backup"].is_available and request.amount <= self.channels["backup"].max_limit:strategy = BackupPayStrategy()if strategy:return strategy.pay(request.amount)print("-> 路由失败:没有可用的支付通道或超出限额")return None# ================== 运行测试 ==================if __name__ == "__main__":router = PaymentRouter()# 场景1:小额正常支付print("=== 场景1: 正常小额支付 ===")req1 = PaymentRequest(amount=100.0)router.route(req1)# 场景2:模拟微信挂了,降级到支付宝print("\n=== 场景2: 微信通道宕机,降级支付宝 ===")router.channels["wechat"].is_available = Falsereq2 = PaymentRequest(amount=100.0)router.route(req2)# 场景3:大额支付,直接走支付宝print("\n=== 场景3: 大额支付 ===")req3 = PaymentRequest(amount=60000.0)router.route(req3)# 场景4:支付宝也挂了,且金额小,走备用print("\n=== 场景4: 全线崩溃,走备用通道 ===")router.channels["alipay"].is_available = Falsereq4 = PaymentRequest(amount=50.0)router.route(req4)

你看这段代码,它绝不是 if-else 面条,而是严格遵循了策略模式。这种代码放到CR(Code Review)里,架构师看了都得竖大拇指。这就是“强制思维链”加上“GLM-5.1深度推理”产生的化学反应。

💡 本章小结

-

AI幻觉的根源:你把它当人,它却只是个概率预测机。模糊的指令必然导致不可控的输出。

-

上下文工程 > 提示词技巧。用 C.O.D.E 框架(Context, Objective, Directive, Example)把AI当编译器对待。

-

遇到复杂逻辑,强制思维链。让AI先画图纸(输出思考过程),再盖房子(写代码),大幅降低架构级幻觉。但是,老兵们,这里还有一个隐患:就算你用了C.O.D.E框架,你的Directive(约束)是写在Prompt里的,它是“软约束”。如果项目大了,文件多了,AI写着写着又把你的约束忘了怎么办?我们需要一种更硬核、更具工程化的方式来约束AI。这就是下一章的重头戏——OpenSpec。我们要给这头野兽套上TypeScript级别的紧箍咒!

夜雨聆风

夜雨聆风