黄仁勋对 AI 的理解真的是一针见血.

我发现英伟达一直在反复讲一件事,Token 效率。无论是老黄上个月在 GTC 大会的主题演讲,还是最近他们新发的模型,几乎都把 Token 效率当成一条主线。

老黄的看法是,AI 时代数据中心的本质是 Token 工厂。Token 已经成为了一种新的商品,被生产出来之后,在不同场景里被消耗,变成能力、服务、收入。

所有 AI 大模型公司都要用 Token Factory 的方式来理解自己的业务,Token 的吞吐量和速度,会直接影响收入。

老黄在 GTC 上甚至给出了一个公式,Revenue ≈ Tokens per Watt × Watts × Revenue per Token。

一边是单位电力能产出多少 Token,一边是你手上有多少电力可用,再乘上每个 Token 能卖多少钱,就是你这家 AI 公司的收入上限。

这个公式之所以重要,是因为它把芯片、模型、电力、收入串到了一起。数据中心有物理约束,机柜、电力、散热都是卡死的。

在这个约束下,每一瓦电只能产出有限的 Token。而每个 Token 能携带多少有效推理,决定了同样一度电能卖出多少钱。

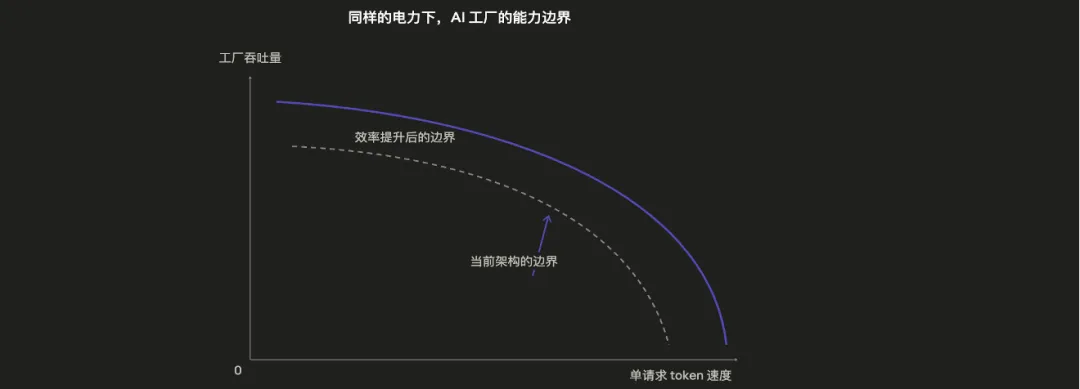

我根据自己的理解画了一张图。纵轴是 AI 工厂的总吞吐量,横轴是 Token 速度,也就是单个请求的生成快慢。这张图就是用来衡量一个 Token 工厂的生产效率和商业价值。

不过这张图其实只包含了生产端。

它讲的是工厂能产多少 Token、产得多快。但同样 1000 个 Token,有的模型一步到位就解决了问题,有的模型反复试错、推翻重来,最后全烧光了还没出结果。产能再大,也架不住模型本身推理效率比较差。

所以 Token 效率不光是基础设施层的事,更是模型层的事。

聊到这里,我想再展开解释下从模型层面怎么理解 Token 效率这个概念。我上次写完,好多同学问到底怎么理解,我自己也琢磨了挺久。

本质就一句话,完成同样一件事,模型用了多少 Token。Token 是燃料,做对的事是产物,效率就是产物除以燃料。

但这件事理解起来也比较拧巴。

很多人第一反应是,Token 用得越少越好。还真不是。现在的推理模型有一个普遍现象,越聪明的模型,思考链越长。

让它做一道数学题,它会先把题目复述一遍,再列几种可能的解法,挨个试一遍,发现错了再退回来重新想。

这个过程烧的 Token 是答案本身的几十倍。但你不能说它效率低,因为短了它就答不对。

反过来也成立。一个模型用 100 个 Token 答错了,另一个用 5000 个 Token 答对了,前者不是省,是浪费。一道根本没解出来的题,Token 用得再少也是零分。

所以 Token 效率真正在算的,是准和少之间的最优解。

可以想象两个学生考同一张卷子。A 写了 5 页草稿纸,全是反复涂改和重新计算,最后答对了。

B 写了 1 页草稿纸,思路清晰,一步到位,也答对了。两个人成绩一样,但 B 的思考效率明显更高。

模型层的 Token 效率上去了,意味着同样一件事消耗的 Token 变少,工厂在同样电力下能服务的请求就更多。

所以基础设施和模型其实是同一件事的两面。这也是为什么英伟达自己也要下场做模型。

带着这个背景,我又去看英伟达上个月刚发的一个开源模型,不知道大家有没有注意到。我也是昨天查资料的时候才看到的,叫 Nemotron 3 Super。

这是一个开源模型,大概 120B 总参数,12B 激活参数。我看了一下技术报告,里面其实就在讲,英伟达专门要做 Agentic Reasoning 和高吞吐推理的大模型家族,希望能进一步提升模型在这方面的效率。

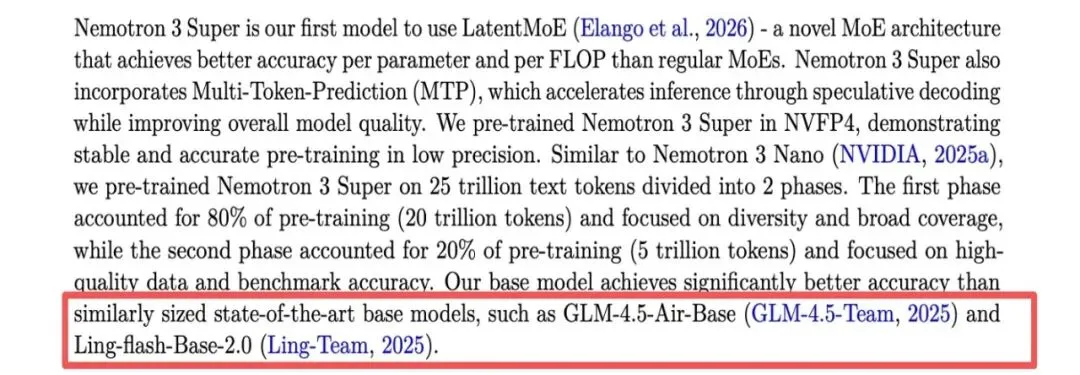

然后看着看着发现一个挺有意思的对比。英伟达这款新模型在比较 Token 效率的时候,直接把两款中国的开源模型当成了主要对标。

一个是智谱的 GLM-4.5-Air-Base,一个是蚂蚁百灵的 Ling-flash-Base-2.0。

我又去翻了一下这两款模型。GLM-4.5-Air-Base 之前看过,是智谱 GLM-4.5 系列里偏轻量的版本。

Ling-flash-Base-2.0 是蚂蚁百灵的 flash 系列,参数量不大,主打小参数、高效率。

英伟达如此重视 Token 效率,它在技术报告里能把两款国内的开源模型当成对标,也是一种认可。毕竟你不会拿一个不构成威胁的对手当参照系。

我又进一步检索了下。发现 Ling-flash-Base-2.0 已经是去年的版本。蚂蚁在上周刚发布了 Ling-2.6-flash,104B 总参数,7.4B 激活参数,这个版本在 Token 效率上又有提升。

https://huggingface.co/inclusionAI/Ling-2.6-flash

话说回来,Token 效率这件事其实不只是英伟达一家在讲。

OpenAI 上周刚发的 GPT-5.5,我看了下 Model Card,他们主打卖点之一也是 Token 效率。OpenAI 明确表示,性能超过 GPT-5.4 的同时消耗的输出 Token 更少。

有意思的是,GPT-5.5 的 API 单价比上一代还贵,但 OpenAI 算的是总账,每个任务的总成本可能反而更低。

SemiAnalysis 上周的一篇分析说得更直白。

https://newsletter.semianalysis.com/p/the-coding-assistant-breakdown-more

这家半导体行业里最有影响力的分析机构判断,cost per task,而不是 cost per token,才是决定模型定价的真正北极星。

一个模型即使单 Token 贵 5 倍,只要解决同一个问题用的 Token 更少,价格差就会被抵消,端到端响应还可能更快。

所以你看,从卖卡的英伟达,到卖闭源模型的 OpenAI,到做开源模型的智谱和蚂蚁,再到 SemiAnalysis 这种第三方分析机构,都开始把 Token 效率当成核心叙事。

感觉这也是 Token 这种商品走向成熟的必然。

夜雨聆风

夜雨聆风