跳出传统软件工程思维,AI Agent 开发实战心得

前阵子我写过一篇《从玩具到思考:我的龙虾养殖记》,聊了一下用 Open Claw + Claude Code(编程 Agent)搭建 AI 数字团队,落地玩具级小项目的心得。但玩具项目跑起来再丝滑,离真正能商用、能交付、能稳定运维的靠谱项目,依旧隔着一道巨大的鸿沟。

为了打破「玩具级 Agent」的局限,把智能体开发真正落地到可交付、可商用的标准,后来我又做了更深入的尝试和研究。

今天不聊零散的实操技巧,不堆砌枯燥的技术参数,我想专门聚焦AI Agent 工业化开发的核心底层思路,跟大家聊聊,我自己踩坑后,依托 ADLC(Agent Development Lifecycle)智能体开发生命周期 落地项目的核心实战心得。

一、我最初的弯路:用传统软件思维,手搓 AI Agent 开发

最开始做 Agent 开发,我的思路是完全复刻传统软件开发经验:

-

明确核心需求,敲定整体技术架构,把要做的功能点一一列清;

-

直接上手 Claude Code,快速编码开发,优先把基础功能跑通、能用就行;

-

收尾优化 CLI 交互界面,打磨基础使用体验;

-

复用在 SAS 积累的工程化经验:补充测试、配置 CI 自动化任务、加入 OWASP 安全漏洞扫描、搭建 pre-commit 代码提交钩子等,补齐工程规范;

-

调用 Hermes 智能体,以资深 PM 和架构师双视角复盘评估项目,再针对性迭代优化。

单看流程,这套操作放在软件项目里,是比较标准规范的打法。但在实际的智能体开发过程中,我陷入了三大困惑,越迭代越心累:

1、迭代反复内耗,修补永无止境

看似是常规迭代开发,实则东补一个 bug、西改一个逻辑,拆了改、改了删,节奏混乱效率极低,全程被动填坑,根本做不到有序推进。

2、测试全过,但输出全靠运气

所有单元测试、功能测试用例全都完美跑通,看似项目毫无问题,但 Agent 实际运行输出时好时坏、忽对忽错,稳定性完全没有保障。

3、多 Agent 规划,硬生生被我做成单 Agent 鸡肋项目

我一开始选用 AgentScope 做多智能体编排架构,初衷是看上了它的Agent-to-Agent 的原生支持能力,易扩展、易部署。但因为前期没做好认知规划,开发到最后彻底跑偏,做成了一个单 Agent 应用,后续只能大面积重构、返工重来。

简单说:用做软件的思路做 Agent,不是不能做,而是越做越乱、越做越不稳。

二、入坑顿悟:Agent 开发,不是简单写代码

传统 SDLC 软件生命周期,管控的是代码和功能;而 AI Agent 开发,管控的是认知、决策、安全和概率性输出。

代码只是 Agent 的载体,真正决定智能体稳不稳、能不能商用的,是:角色建模、认知架构、安全护栏、概率评估、持续进化。

而这套专门适配 AI 智能体工业化开发的体系,就是ADLC,Agent 开发生命周期。

后来,我按照 ADLC 的体系重新梳理、重构项目后,之前的难题全部迎刃而解。没有杂乱的反复修补,开发节奏也瞬间清晰可控。

下面,我结合在网上学习到的ADLC方法论,叠加自己落地项目后的一些实操感悟,粗浅聊聊每一步的核心价值和落地做法:

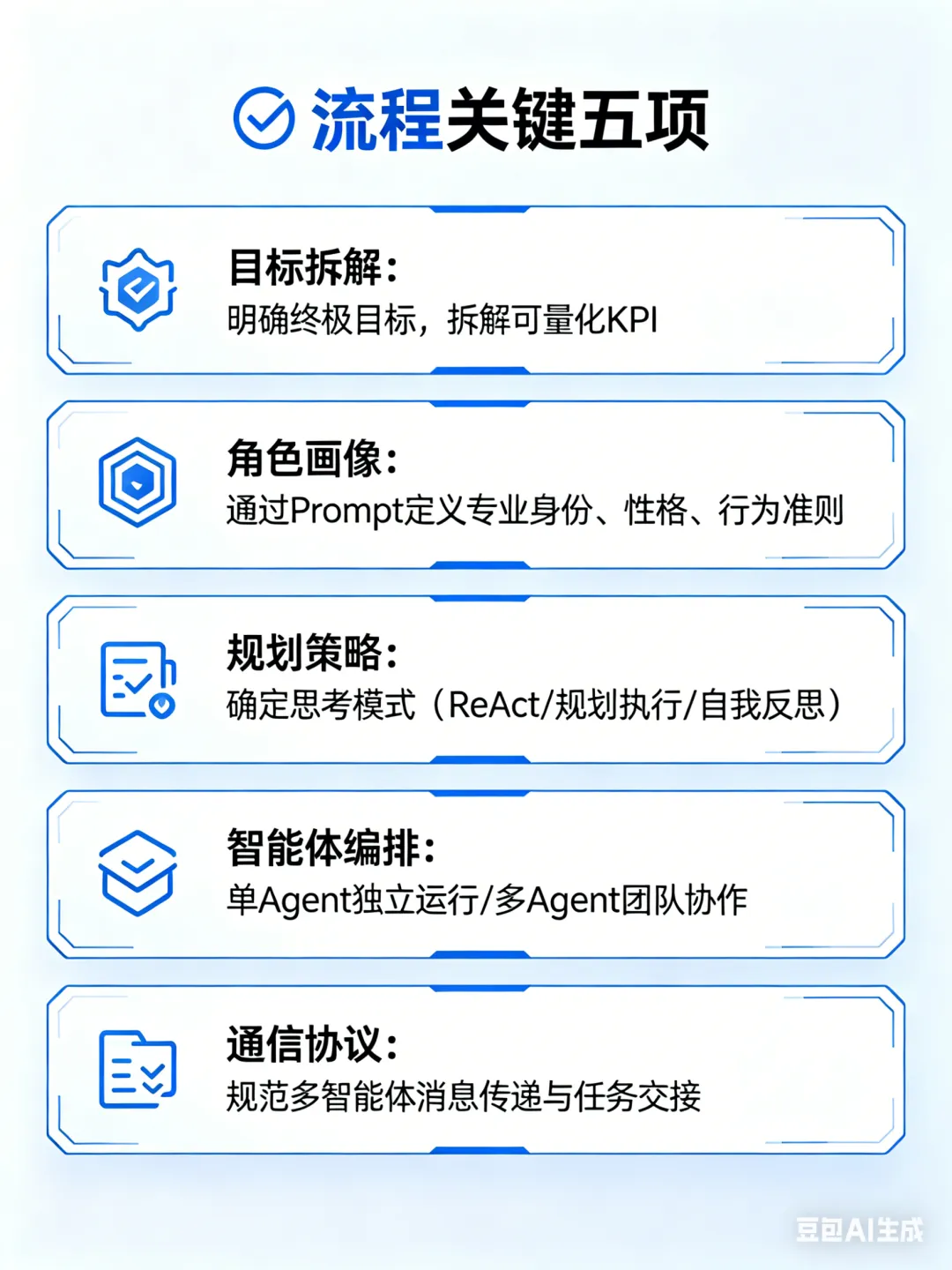

📌 01 意图定义与角色建模 —— 先定人设与边界,再动手写代码

✅ 核心理念

传统开发重功能,Agent 开发重角色。不急着编码,先明确智能体「是谁、做什么、不做什么」,规避盲目开发与反复返工。

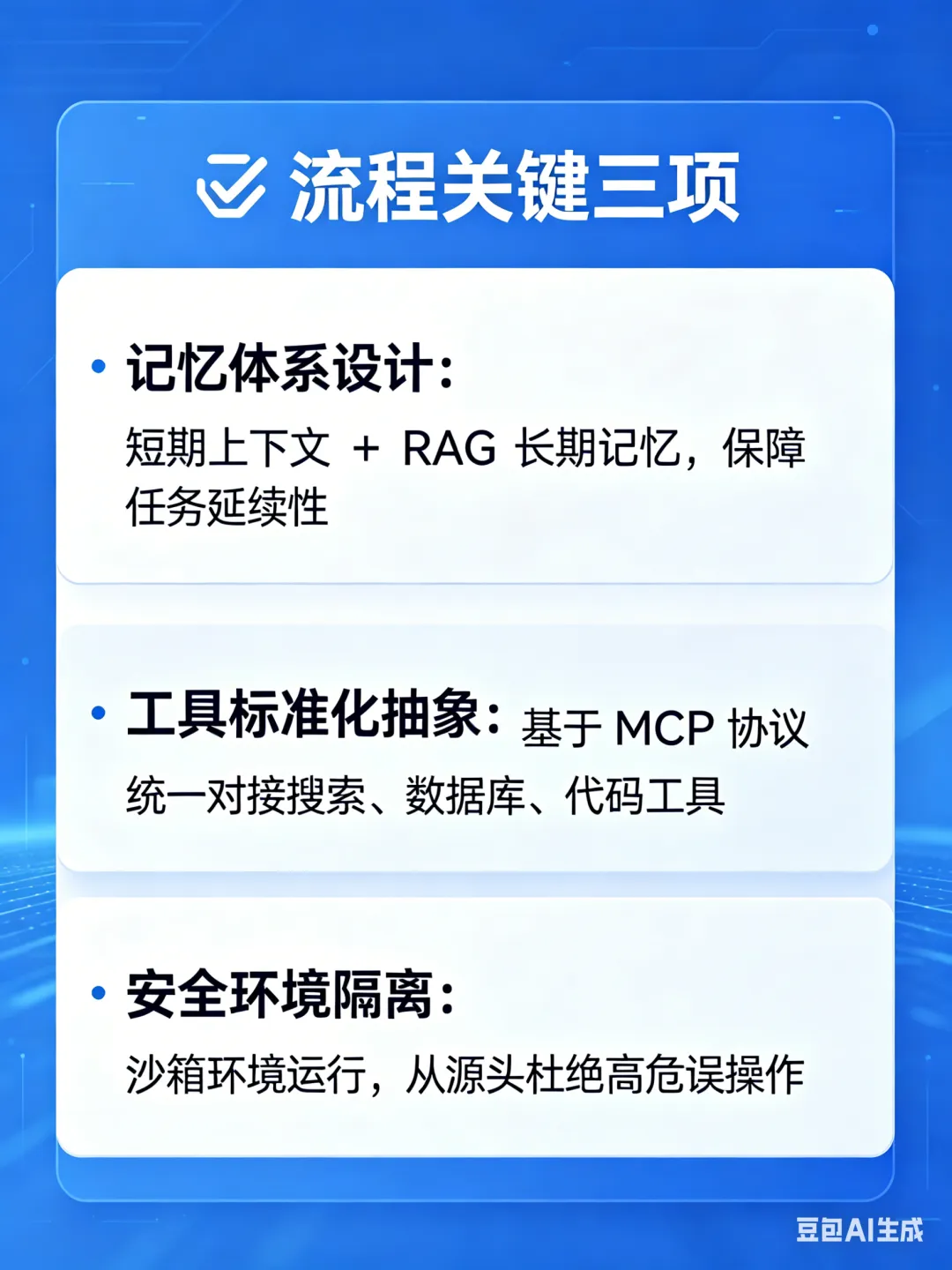

📌 02 认知架构与工具集成 —— 搭建智能体大脑与实操能力

✅ 核心理念

角色定位确定后,重点搭建智能体核心能力底座,既保障长效记忆思考,也能安全调用各类工具完成实操。

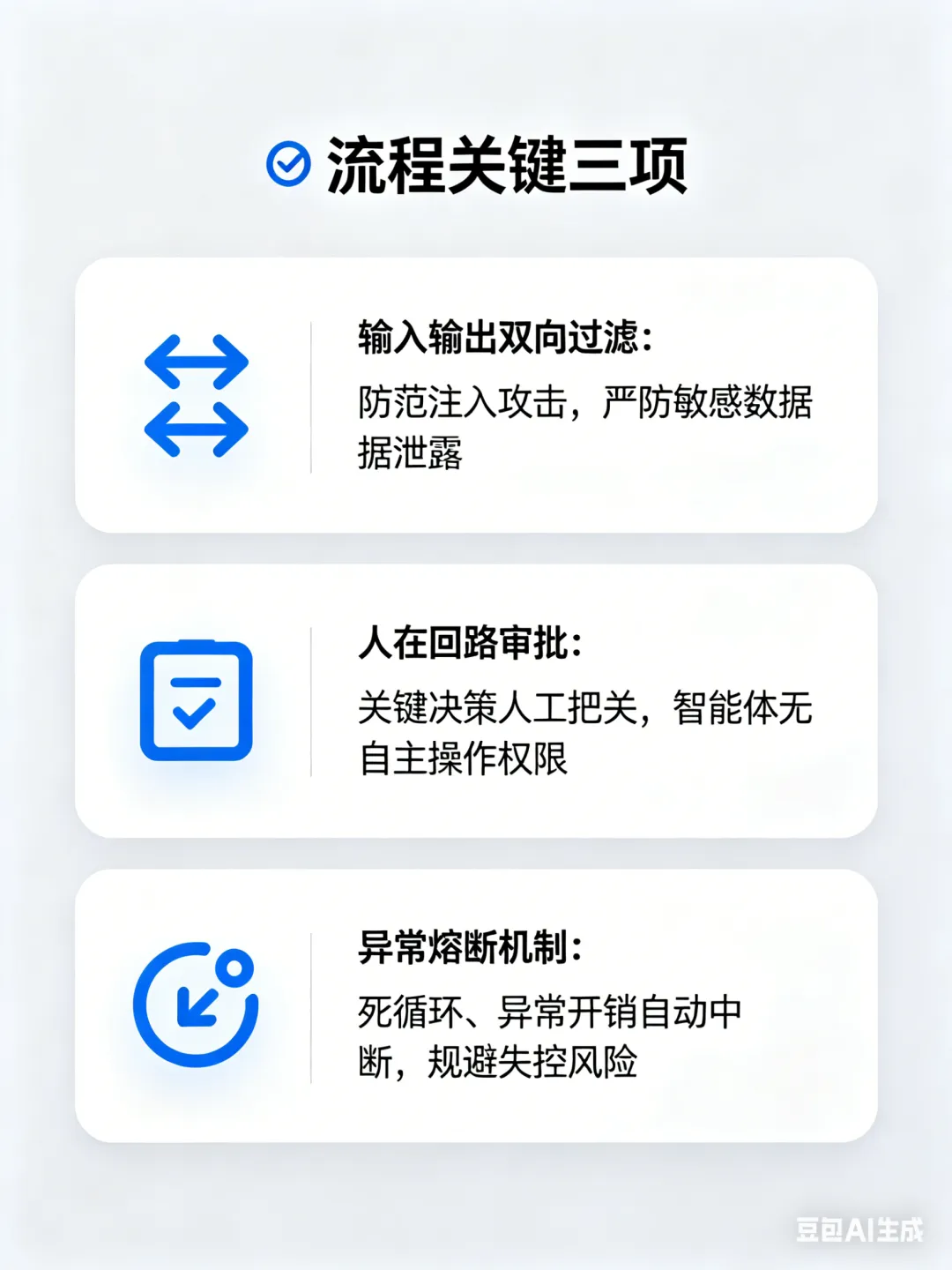

📌 03 护栏与治理 —— 解决 AI 幻觉,守住商用交付红线

✅ 核心理念

这是 ADLC 与传统开发最大的区别。功能次之,安全可控优先,专门应对 AI 幻觉、提示词注入、数据泄露等核心风险。

📌 04 评估与验证 —— 从对错测试,升级为概率打分评估

✅ 核心理念

传统代码测试是非对即错的确定性逻辑,而 LLM 输出具备概率属性,没有绝对对错,只有效果优劣与置信度高低。传统断言测试不再适用,需建立全新评估体系。

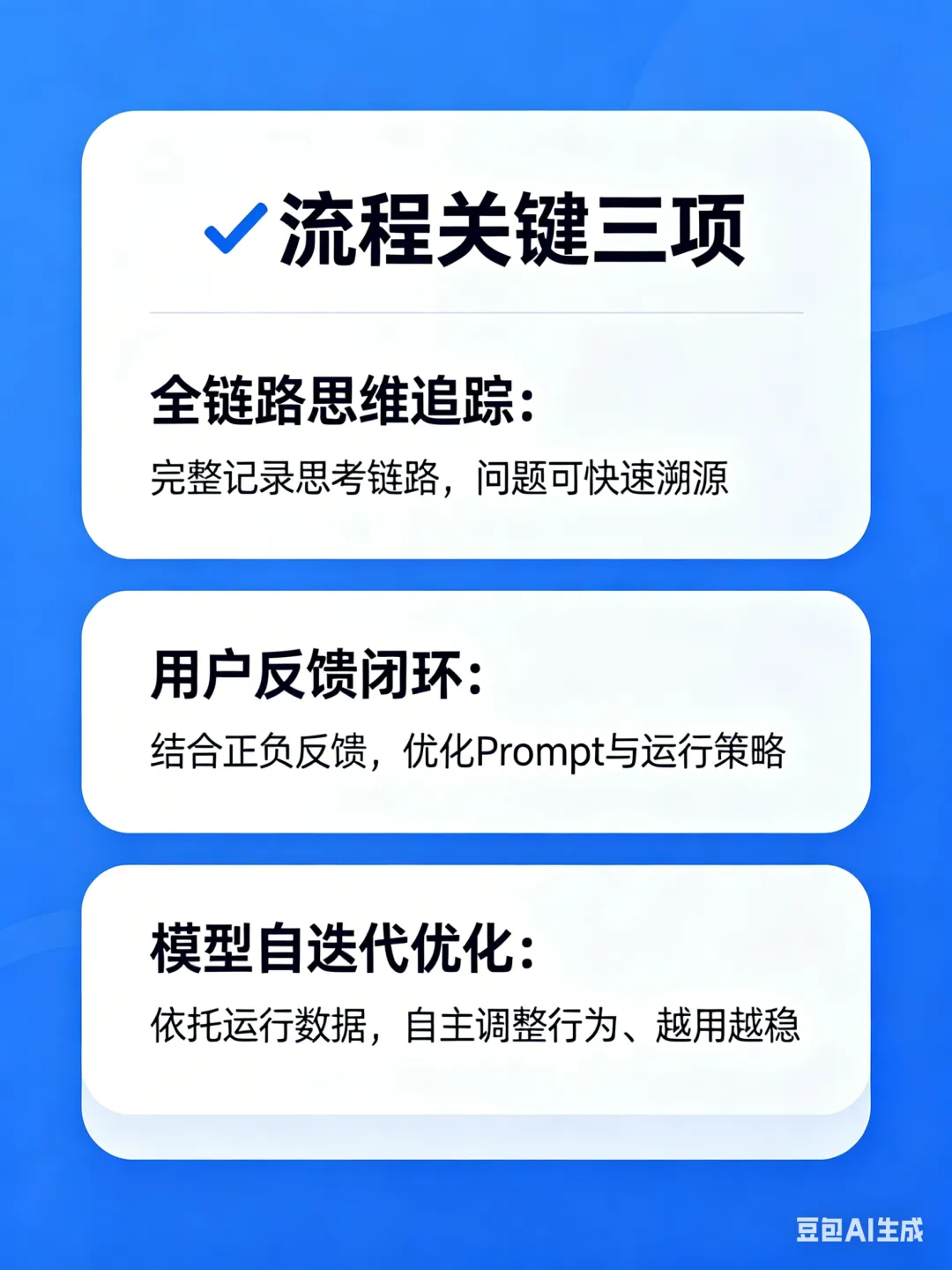

📌 05 部署与持续进化 —— 上线不是终点,智能体持续迭代

✅ 核心理念

普通软件上线即是终点,商用 Agent 部署只是起点。不靠人工改代码,依托数据与反馈实现自主优化、长效进化。

按照以上步骤进行实战之后,再复盘,所有问题的根源,并非技术或代码缺陷,而是用传统软件思维,做 AI Agent开发。

分享 5 个关键认知转变,帮大家少走弯路:

-

迭代反复内耗,源于急于编码,未提前定义角色与边界。Agent 开发中,定人设、划边界、拆目标,永远优先于写代码; -

输出效果不稳定,源于缺少认知架构与编排规划。未提前设计记忆机制、执行逻辑、多智能体协作模式,运行只能靠运气; -

测试标准失效,源于忽略 AI 概率化输出特性。放弃非黑即白的断言测试,以评分高低、置信度强弱作为评估依据; -

问题治理升级,修复不再是单纯改 Bug,而是体系化的工程治理。Agent 问题靠流程管控,而非零散修补; -

安全边界升级,除常规漏洞扫描外,AI 护栏与对抗攻防是核心。To B 交付场景下,安全是不可突破的红线。

在 AI Agent 领域,行业内还存在多种落地方法论、实践路线与架构思路,不同团队、不同业务场景下,也会形成差异化的建设经验,没有唯一标准答案。

仅从我现阶段的落地感受来说:

多年传统软件研发、SAS 工程化沉淀的经验,在 Agent 开发中依然具备很高的复用价值。规范流程、合规体系、运维能力,都是技术落地的扎实底盘。

如果想要打造可交付、可商用、可运维、高安全的ToB级AI Agent项目,ADLC体系化的开发治理思路,是非常值得参考和落地的方向。

感谢你看到这里

如果有任何想法,欢迎与我分享!

ADLC 参考文献

Wenchel A. (2025, November 3). Introducing The Agent Development Lifecycle (ADLC). Arthur.ai.

https://www.arthur.ai/blog/introducing-adlc

EPAM. (2026, February 5). Agentic Development Lifecycle (ADLC): Building and Operating AI Agents in Production. EPAM Insights.

https://www.epam.com/insights/ai/blogs/agentic-development-lifecycle-explained

Salesforce. (2026, March 25). The Agent Development Lifecycle: From Conception to Production. Salesforce Architect Documentation.

https://architect.salesforce.com/fundamentals/agent-development-lifecycle

AI 智能体的标准开发流程

https://developer.aliyun.com/article/1729498

AI智能体(AI Agent)的开发

https://blog.csdn.net/zhaoyin0335/article/details/159653595?ops_request_misc=elastic_search_misc&request_id=d00b908fa0325213148cca57a706b6be&biz_id=0&utm_medium=distribute.pc_search_result.none-task-blog-2~all~sobaiduend~default-1-159653595-null-null.142^v102^control&utm_term=AI%E6%99%BA%E8%83%BD%E5%BC%80%E5%8F%91&spm=1018.2226.3001.4449

夜雨聆风

夜雨聆风