AI开始自我进化?我们从近期的真实突破中找到了答案

最近AI圈的一则消息引发广泛关注——国产大模型MiniMax M2.7正式发布,具备“模型参与自我迭代”的能力,发布当日其股价盘中一度暴涨28%,市值攀升至3883亿港元。

与此同时,Anthropic联合创始人Jack Clark公开预测:到2028年底,AI实现递归自我改进(即自主构建和改进自身)的概率高达60%。一时间,“AI自我进化”不再是科幻电影里的场景,而是成为近期科技圈的热门话题。

但我们必须明确:目前的AI自我进化,并非“AI摆脱人类控制、自主超越人类”,而是从“被动接受人类训练”向“主动参与自身优化”的范式转变。今天,我们就结合近期公开的真实技术突破、权威观点和实测数据,聊聊AI自我进化的现状、突破点和未来可能。

先厘清:什么是AI的“自我进化”?

在此之前,我们先区分两个概念:传统AI训练和AI自我进化,两者的核心区别,在于“谁主导优化过程”。

传统的大模型训练,全程依赖人类主导,流程固定且被动:人类收集数据→人类设计训练策略→人类调参→人类评测→人类迭代,模型只是“被优化的对象”,没有任何自主决策的空间。

而近期突破的“AI自我进化”,核心是让模型深度参与自身的训练全流程,形成“自主闭环”:模型分析数据→模型设计实验→模型优化训练→模型评测反馈→模型迭代升级,模型从“被动工具”变成了“主动参与优化的参与者”,甚至能承担部分研发工作量。

简单来说,以前是“人类手把手教AI”,现在是“AI自己摸索着优化自己”——但这一切,仍处于人类设定的框架和约束之内,并非无节制的“自由进化”。

2个突破信号,证明AI自我进化已起步

无论是国产大模型的技术落地,还是国际机构的研究预测,都在释放一个明确信号:AI自我进化的序幕,已经拉开。

突破1:MiniMax M2.7——具备自我迭代能力的国产大模型

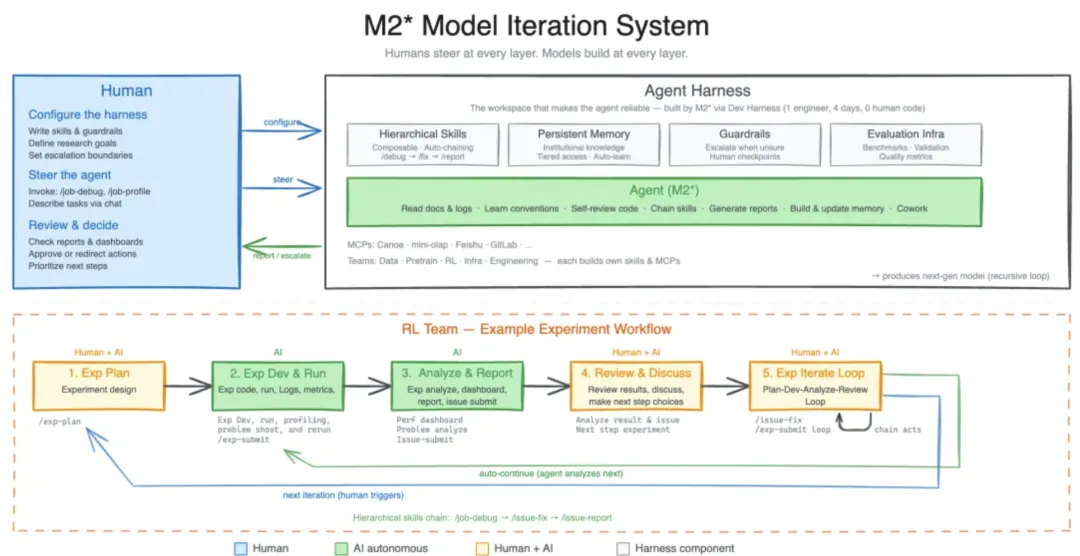

MiniMax发布新一代旗舰大模型M2.7,其核心突破是构建了Agent Harness(智能体执行框架)体系,让模型具备了参与自我迭代的能力。

这个框架由多个组件协同工作,包括结构化Skills模块(模型自主构建和更新的技能库)、外部工具集成(模型可调用的工具链)、记忆系统(存储经验与反思)、Agent Teams(多智能体协作团队),共同支撑模型的自主迭代闭环。

根据官方测试数据,M2.7能够连续执行超过100轮“分析—改进—验证”的闭环,在部分研发场景中能承担一定工作量,内部评测集效果提升约30%。

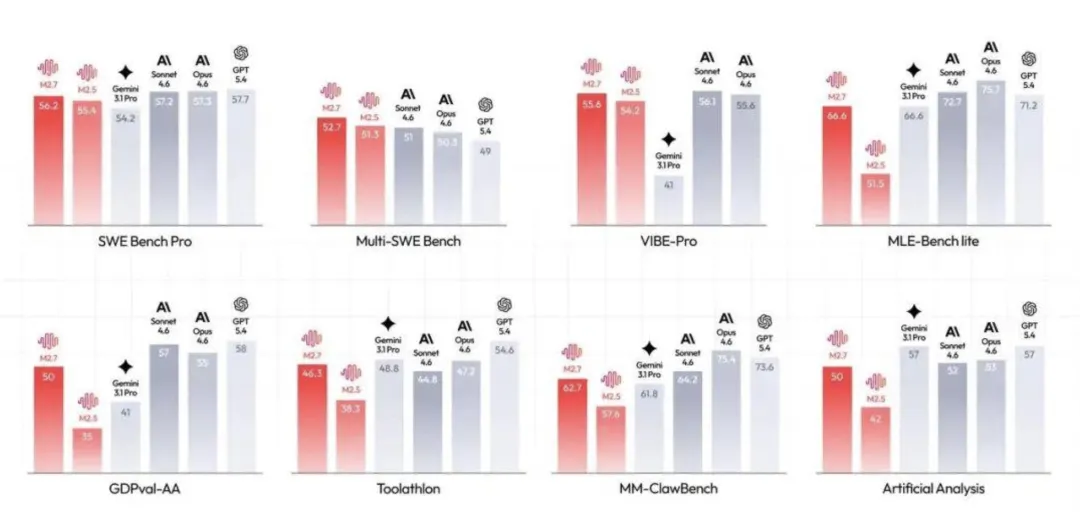

在实际性能上,它表现亮眼:办公场景中,以ELO分数1495的成绩成为开源模型中的最高分;代码能力上,在SWE-Pro基准测试中正确率达56.22%,追平GPT-5.3-Codex,可处理线上生产系统故障。

当然,它也有明显局限:在复杂逻辑推理和数学竞赛场景存在系统性短板,并非“完美自我进化”的模型。

突破2:权威预测——2028年,AI或实现无人类参与的自我研发

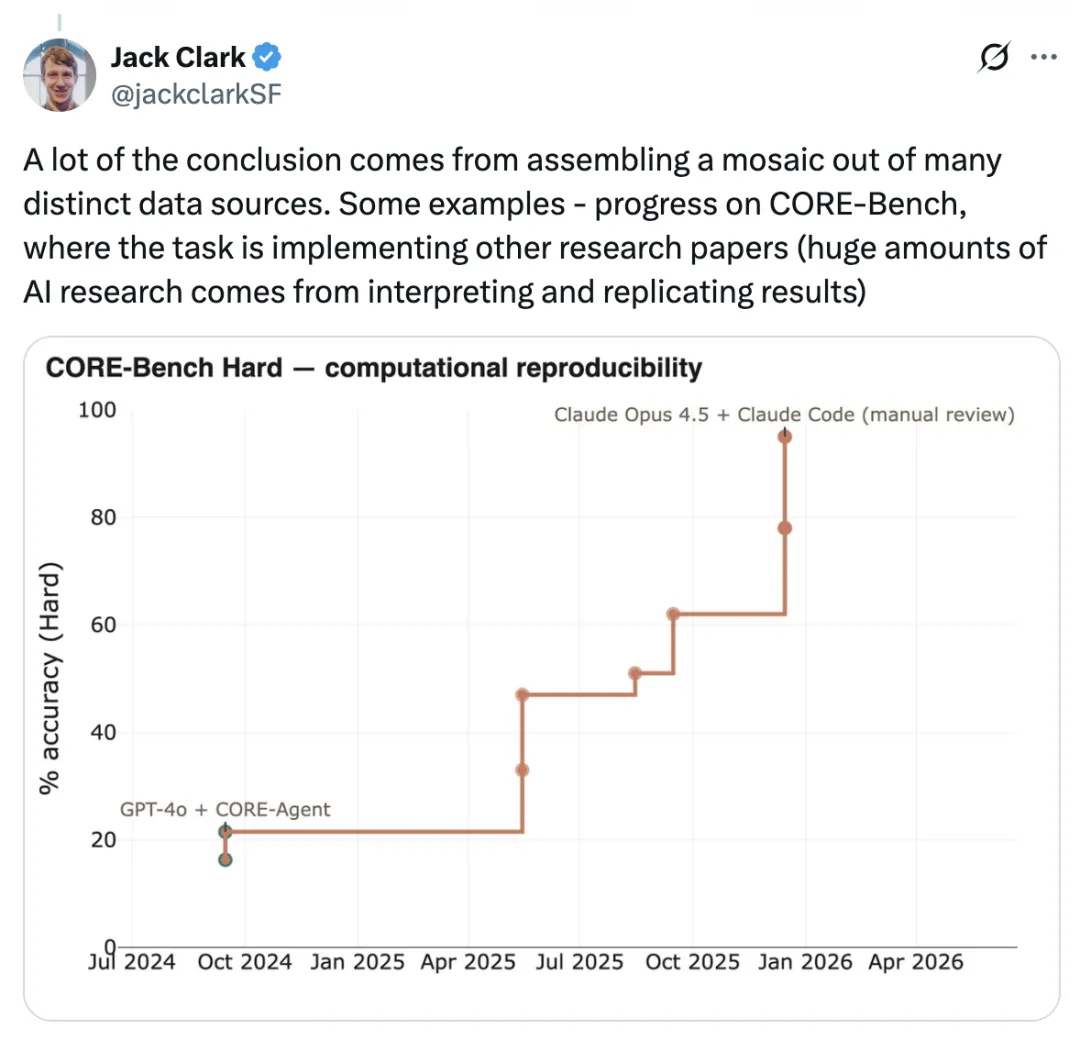

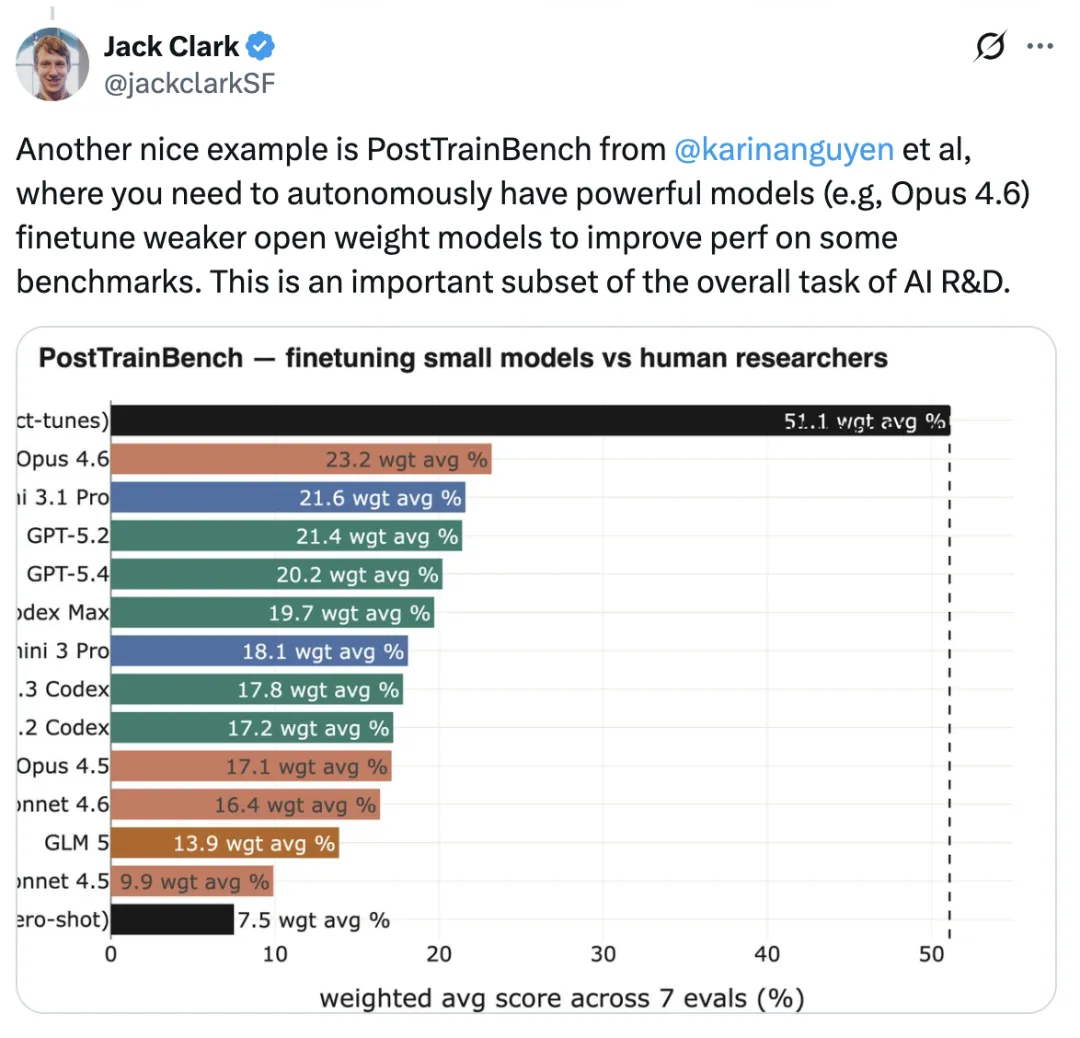

2026年5月4日,Anthropic联合创始人Jack Clark在社交平台发文,结合CORE-Bench、SWE-Bench等大量公开基准数据,提出预测:到2028年底,AI实现递归自我改进的概率达60%。

他的判断并非凭空猜测,而是基于明确趋势:AI在AI研发相关任务上进步极快,比如能自主微调较弱的开源模型、实现他人研究论文核心内容、完成真实场景下的机器学习应用开发,这些都是AI自主研发的基础能力。

Jack Clark强调,其所说的“自我进化”,是指AI能自主完成关键研发流程、构建下一代系统,进入“自我加速迭代”循环,但他也明确,2026年大概率不会实现这一突破,未来一两年可能先在非前沿模型层面出现相关案例。

这一观点存在争议:华盛顿大学计算机科学教授Pedro Domingos指出,AI早在上世纪50年代就具备“构建自身”的能力,真正关键是能否获得“递增回报”,目前尚无明确证据支持这一点。

理性看待:AI自我进化,优势与挑战并存

结合近期所有公开信息,我们可以明确:AI自我进化已经从“理论”走向“实践”,但它并非“万能”,优势与挑战并存,我们无需过度恐慌,也不能盲目夸大。

核心优势:效率革命与能力升级

AI自我进化的最大价值,在于彻底改变了AI的训练模式,带来两大变革:

一是效率提升:减少人类在AI训练中的重复劳动(如数据筛选、参数调整、评测反馈等),缩短模型迭代周期、降低研发成本,自进化智能体能耗降低90%就是直接体现。

二是能力适配:AI能实时整合环境反馈和任务经验,动态调整自身策略,适应复杂真实场景,比如MiniMax M2.7可处理生产系统故障,自进化医疗代理能更新病理知识,这是传统静态AI难以实现的。

现实挑战:技术、安全与伦理的三重考验

目前的AI自我进化,仍面临诸多未解决的难题,这也是它无法快速普及的关键:

1. 技术瓶颈:自进化会增加一定推理延迟,且存在“灾难性遗忘”风险——AI优化新能力时,可能忘记之前掌握的技能;多智能体协同进化的稳定性仍需提升,部分模型在复杂逻辑任务中表现不佳。

2. 安全风险:自修改代码的AI系统缺乏有效形式化验证工具,可能出现“进化偏差”,生成不符合人类预期的结果,甚至可能被恶意利用,带来网络安全隐患。

3. 伦理与商业难题:AI进化产生的成果(如优化策略、生成代码)IP确权困难;医疗、金融等敏感领域,AI自主进化可能与数据隐私冲突;AI进化方向如何与人类价值观对齐,也亟待解决。

最后:AI自我进化,不是终点,而是新起点

近期的所有突破都在告诉我们:AI的发展,已经从“追求参数规模”进入“追求自主能力”的新阶段。AI开始自我进化,不是“AI取代人类”的开始,而是“人类与AI协同进化”的新起点。

MiniMax M2.7的落地、Jack Clark的预测,本质上都是AI向“更智能、更高效、更适配人类需求”的方向迈进——它不会取代人类,而是解放人类双手,让我们从重复研发、劳动中解脱,专注于更具创造性的工作。

当然,我们也必须保持理性:AI自我进化仍处于初级阶段,还有无数技术、安全、伦理问题需要解决。未来,AI的进化方向,终究需要人类来引导和约束。

或许,2028年是否能实现“无人类参与的AI自我研发”尚未可知,但可以肯定的是,AI自我进化的浪潮已经到来,它将改写科技发展的轨迹,也将深刻影响我们的工作和生活。

后续我们也会持续关注AI自我进化的最新动态,第一时间分享真实、有价值的技术进展,记得关注不迷路~

文末互动:你认为AI自我进化,会给我们的生活带来哪些改变?欢迎在评论区留言讨论~

夜雨聆风

夜雨聆风