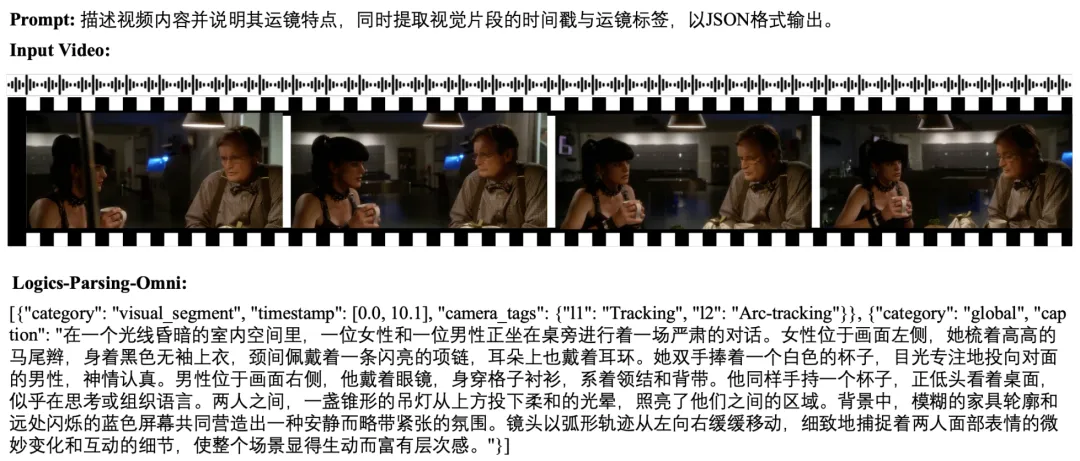

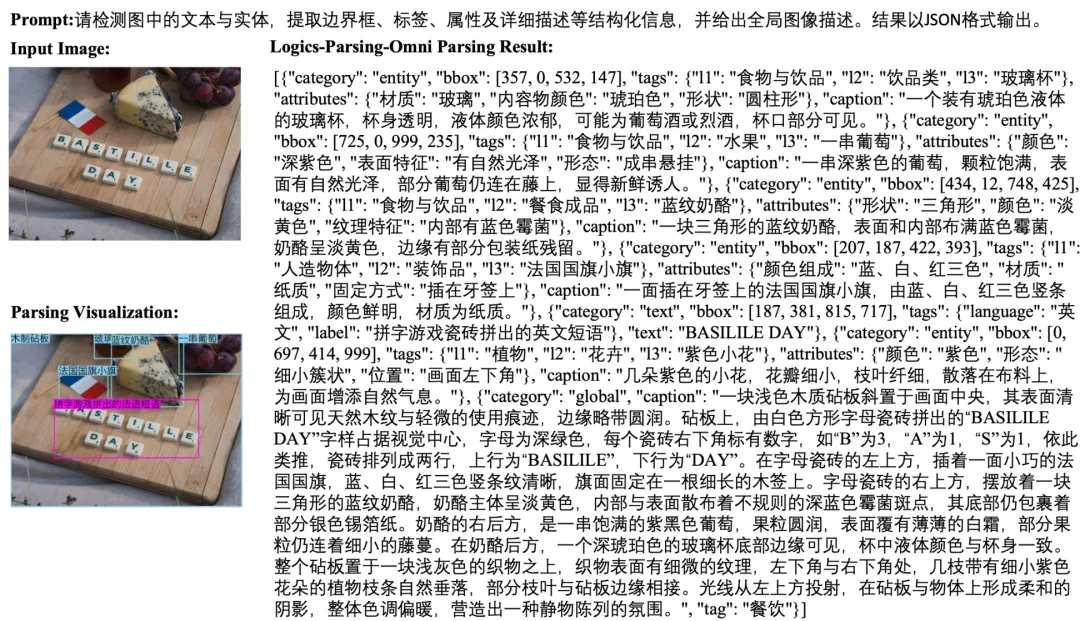

阿里开源了个全模态解析模型,把文档、图像、视频、音频统一为可追溯的JSON

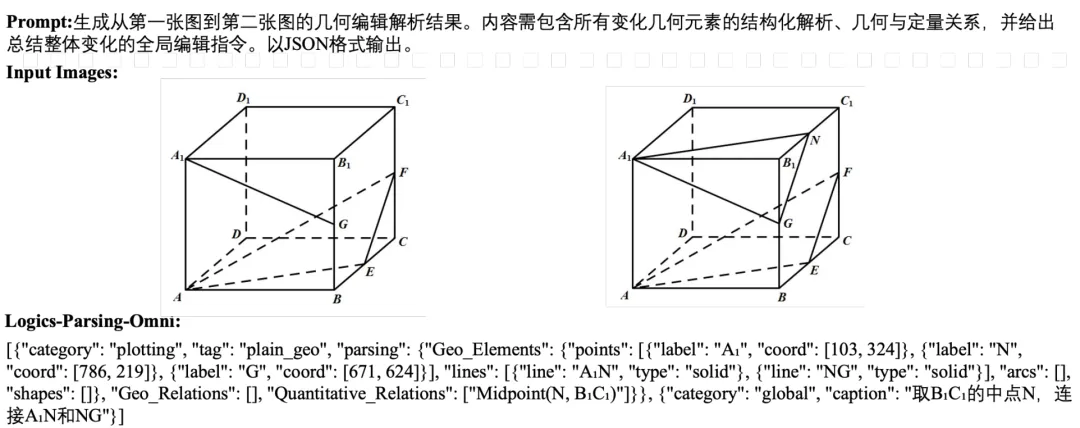

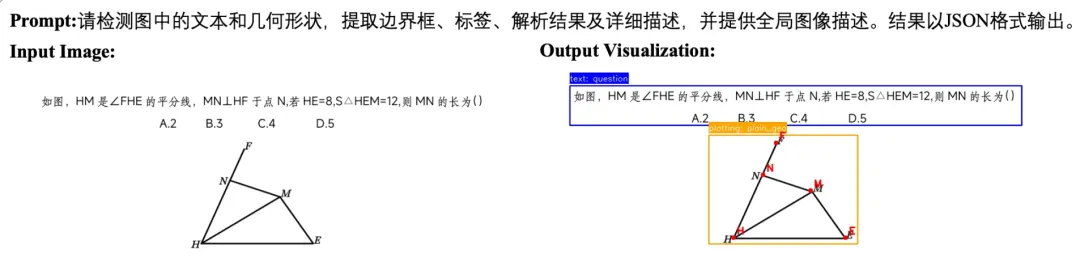

逐项列出两张图的所有变化,并给出全局描述

在视觉丰富的文档和长格式视频中,仅靠低层次的OCR或高层次的语义描述是不够的。阿里开源了一种能够将可靠的、细粒度的解析与面向应用的语义理解统一起来的系统。

我们一直在说多模态大模型既能看懂图、又能听懂话,最典型的代表就是当下的全民应用豆包。

但在处理知识密集型内容时,当前的MLLM要么给出流畅但缺乏细节的描述,要么能定位物体却无法理解其深层含义。

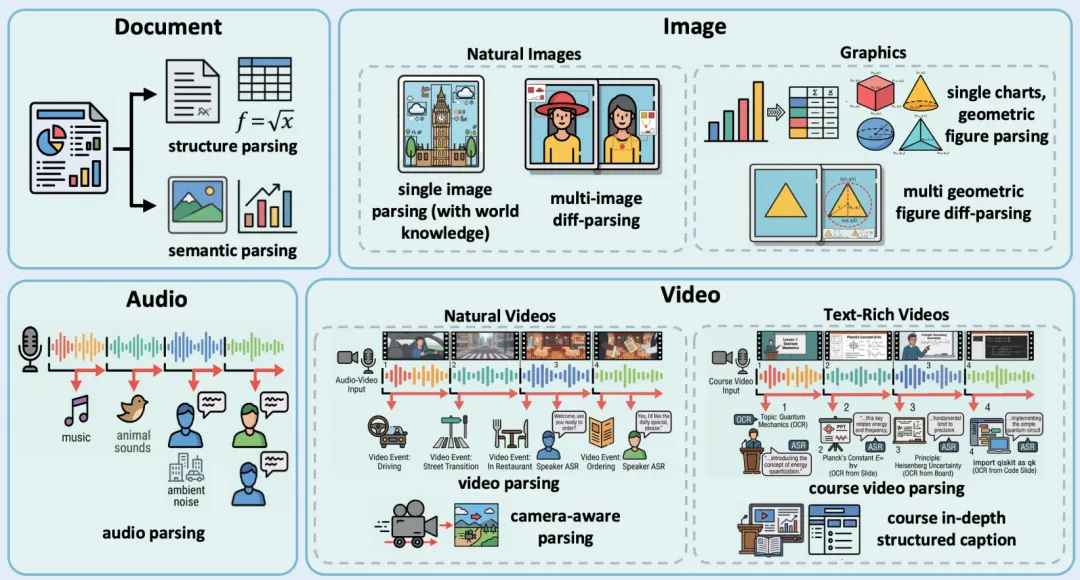

在文档领域,传统OCR能精确定位文字和表格,但遇到图表、插图时,图表中的趋势、比较、因果关系可能全部丢失。

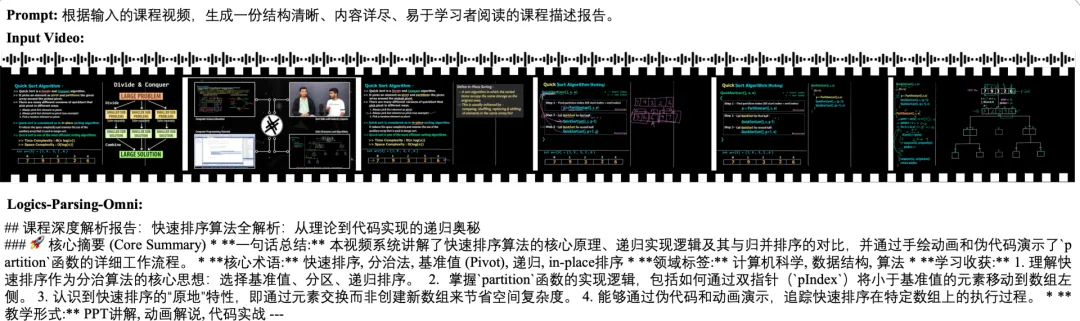

在视频领域,多数模型只依赖ASR语音转文本,然后进行检索或问答。而视频是多维的,其中非语音的声学事件、视觉上下文等信息,全部被忽略。

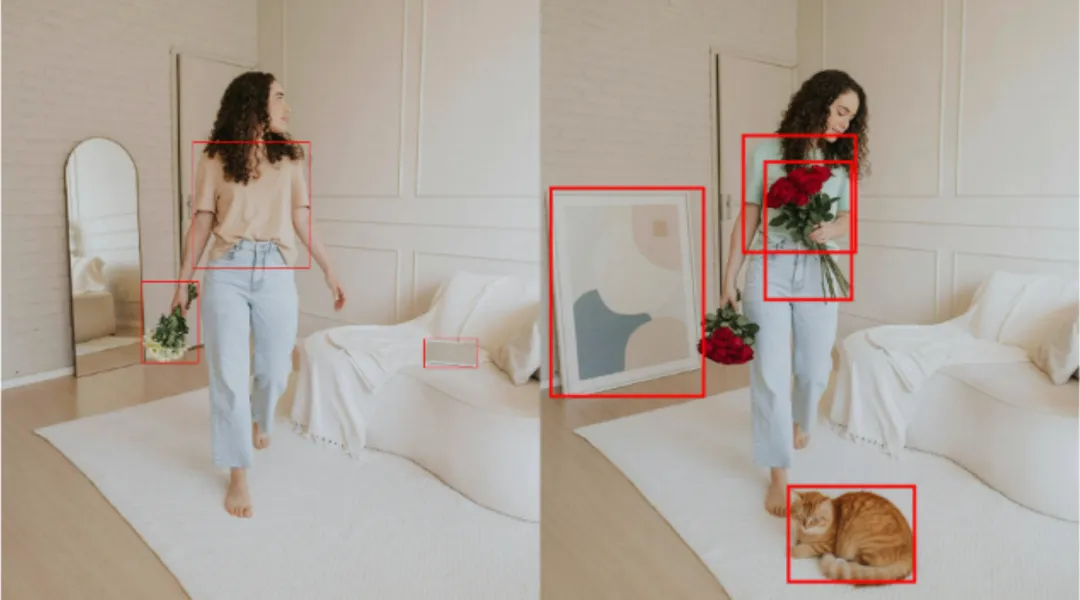

在图像领域,通用MLLM通常难以捕捉复杂推理所需的、属性丰富的信息,要么产生幻觉描述不存在的东西,要么描述过于笼统。

文档、图像、视频三种模态,存在同一个困境:当前的多模态模型的幻觉问题无法避免,且不具备可解释性,无法“证明”它看到了什么。

那如何让AI的每一句理解,都有据可查、可追溯、可验证?

最近,阿里巴巴Logics团队发布的 Omni Parsing 的全新框架,建立了一个覆盖文档、图像和音视频流的统一分类体系,目前已经开源了源代码和权重。

三层次渐进式—全模态解析

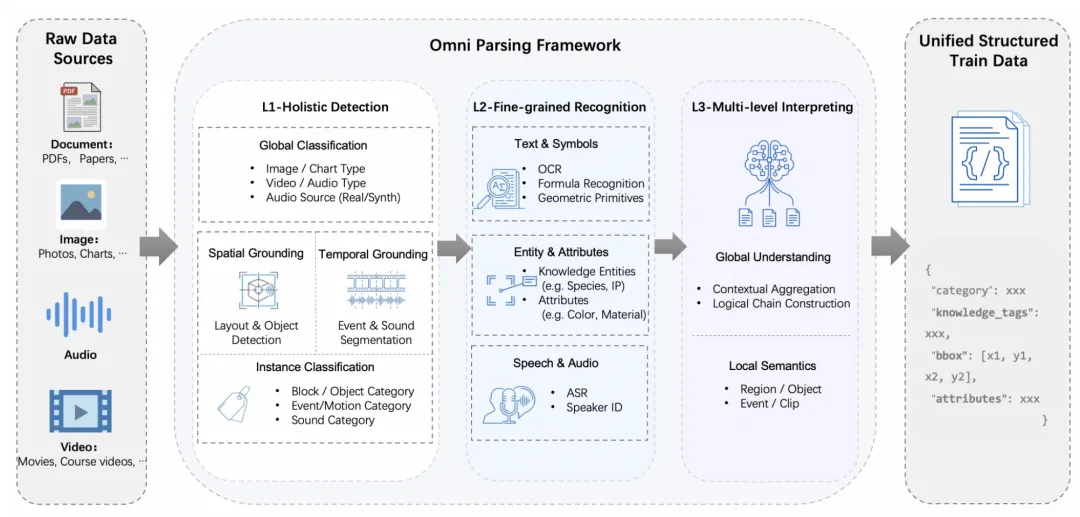

Omni Parsing框架的核心思路是:将感知与认知解耦,再通过结构化的方式重新连接。

最终输出格式统一为结构化JSON,可直接供下游RAG、QA系统使用。

L1:整体检测,执行时空定位和粗粒度分类,建立感知的几何基准。

模型需要精确地定位物体或事件的位置。对于文档,是文字块、表格、图表的边界框;对于视频,是镜头切换的时间点、关键物体出现的时空坐标。

L2:细粒度识别,对定位到的物体进行符号化和属性提取。

OCR/ASR方面提取文字和语音内容;属性提取包含了物体的颜色、数量、类别;结构化知识覆盖图表的数据点、几何图形的点线关系。

L3:多层次解释,从局部语义构建全局逻辑,形成可追溯的推理链。

基于L1和L2的结构化信息,模型进行推理:图表传达了什么趋势?视频的叙事逻辑是什么?几何图形中存在哪些关系?

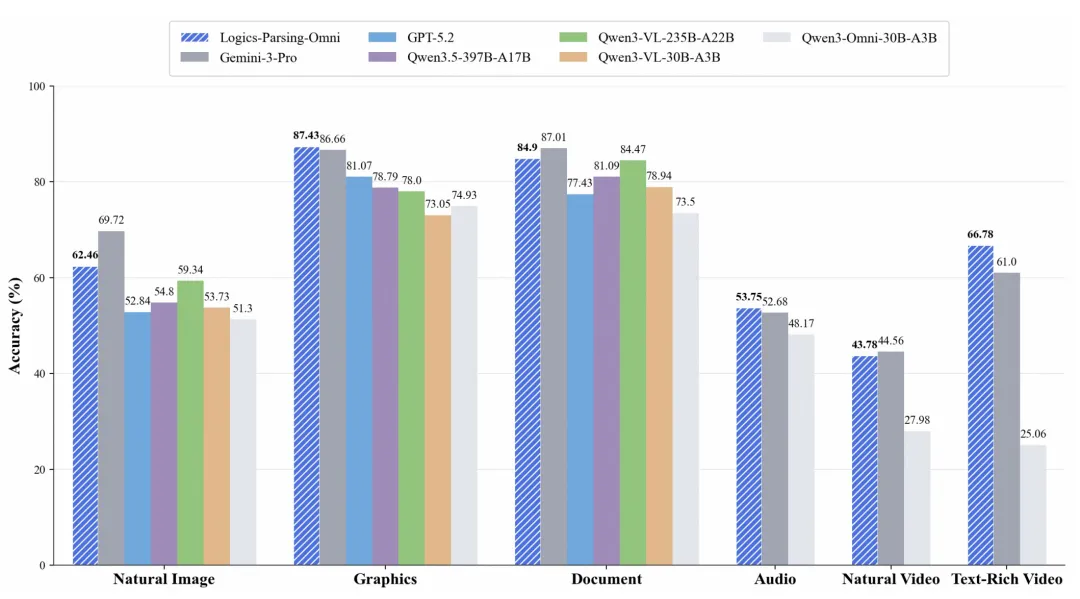

覆盖四大模态解析的基准

为了定量评估全模态解析能力,团队开源了OmniParsingBench基准,覆盖文档、图像、音频、视频四大模态,强调:

-

细粒度定位:模型能否准确框出/定位到关键元素?

-

结构保真度:输出是否保留了原布局的逻辑关系?

-

逻辑推理:基于结构化信息,模型能否进行正确的归纳和推理?

以 Qwen3-Omni-30B 为基线模型,在图形认知(图表+几何)任务上做了以下的消融实验。

仅用描述微调反而有害:纯Caption数据让模型在逻辑推理任务上从73.97掉到68.04。

结构化解析带来飞跃:引入细粒度感知数据(图表的HTML结构、几何的坐标拓扑)后,逻辑推理飙升至90.87,数量关系达到96.08。

为什么这很重要?

覆盖文档、图像、音频、视频的统一框架,实现了全模态处理。

并且输出标准化JSON,直接服务下游应用,无需二次加工。

在复杂文档解析方面,如包含大量图表、公式、插图的财务报告、学术论文等,有了结构化的知识,能直接对接RAG系统,实现“从文档到知识”的无缝转化。

在智慧教育培训方面,可以实现将幻灯片切换、板书内容与语音同步的对齐,以及最重要的可追溯问答,比如回答老师在第几分钟讲了那个公式的问题。

感兴趣的可以查看原论文及代码:

开源地址:https://github.com/alibaba/Logics-Parsing/tree/main/Logics-Parsing-Omni最后,文末推荐三篇多模态解析的相关文章,小伙伴们可留言回复‘加群’进入大模型交流群、视觉应用落地交流群!

想涨知识,点击下方卡片,关注 Mark·AI

点个“小爱心”吧

夜雨聆风

夜雨聆风