别再把AI当搜索引擎用了:这是90%人用不好AI的真正原因

-

场景A:同事小张早上接到任务,要做一份行业竞品分析。他打开AI,输入一段结构化指令,10分钟后拿到一份带数据表格、逻辑框架清晰的初稿,下午直接开会汇报。

-

场景B:你收藏了50个“神级提示词模板”,真到用时,对话框里输入的依然是:“帮我写一下”、“优化一下”、“这个怎么样”。AI给出来的东西要么太泛、要么太假,最后你还是自己熬夜重写。

根本原因不是你没有技巧,也不是你不够聪明。而是你从一开始,就把大模型当成了搜索引擎来用。

要解决这个问题,首先得纠正一个底层认知:大语言模型不是搜索引擎,而是一台概率推理机。

-

搜索引擎:工作原理是”检索已有信息”。你输入关键词,它在索引库里匹配网页,按相关性排序后把链接扔给你。它的边界很清楚:互联网上有的,它可能找得到;互联网上没写的,它绝对给不出。

-

大语言模型:工作原理完全不同。它并不是在”查找”答案,而是在基于你提供的上下文,通过概率分布”生成”新的文本内容。换句话说,搜索引擎是图书管理员,只负责帮你找书;大模型是实习生,可以帮你写一份新的报告——前提是你得把任务说清楚。

这里有一个关键风险:如果把AI当做搜索引擎用,他可以给你输出答案,但答案不一定是对的。 搜索引擎至少会告诉你信息来自哪个网页,你可以自己判断来源是否靠谱;而大模型生成的内容往往看起来逻辑自洽、语气笃定,却可能包含”幻觉”——也就是一本正经地胡说八道。因为你没有给它足够的上下文和约束,它只能基于概率”猜测”一个最像答案的回答。

这个认知差异直接导致了使用方式的天壤之别。搜索引擎希望你关键词越短越好,最好只给三个词;AI却希望你描述越完整越好,甚至能精准理解上万字的复杂描述。

有数据显示,传统搜索引擎无法有效处理超过40字的查询,且字数越多效果越差,而大模型完全不受这个限制。

一句话总结:你不是在”查资料”,你是在”布置任务”。 当你用”百度思维”对待AI时,就像拿着自行车钥匙去开飞机——门都打不开,更别说起飞了。

既然知道了AI不是搜索引擎,那为什么大多数人还是改不过来?因为你被过去20年的搜索习惯训练出了肌肉记忆。

搜索引擎培养了我们一套固定动作:输入关键词组合→筛选链接→自行整合信息。

但AI协作需要的是另一套逻辑:用自然语言描述任务→让模型深度推理→直接拿到结构化输出。

很多人让AI“写个文案”,就像走进餐厅对厨师说“随便做点好吃的”,等菜上桌了又抱怨不合口味。问题出在哪?你根本没有定义“好吃”的标准。

这是把AI当搜索引擎用的典型症状:问一句,回一句,用完即走。

但大模型最厉害的能力恰恰在于多轮对话和上下文理解。提示词不是一次性念完的咒语,而是持续对话的起点。你第一轮给背景,第二轮调方向,第三轮定格式,这样迭代出来的结果,远比你指望”一句话封神”要靠谱得多。

腾讯云技术社区在一篇2026年的文章中一针见血地指出:很多人做不好,不是因为不会写提示词,而是自己都没想清楚目标。

目标越清楚,AI越容易给你可用结果;目标模糊,AI也只能陪你一起打太极。

2026年提示词工程已经变了:从“角色扮演”到“上下文工程”

如果你还在各种教程里看到“你要让AI扮演一位20年经验的专家”这类建议,需要注意:2026年的提示词工程,风向已经变了。

过去两年,“角色设定”被过度神话。但最新的行业实践表明,真正拉开差距的不再是“你让AI扮演谁”,而是“你给了AI多少有效上下文”。

Reddit技术社区2026年的共识非常明确:提示词工程正在从“Prompt Engineering”转向“Context Engineering”,核心能力变成了“模型在这一轮到底看到了什么信息”。

Anthropic、OpenAI等头部厂商的官方文档也在弱化花哨的角色设定,转而强调消息角色分配、结构化输出、评估循环和事实 grounding。在数据分析、代码生成、Agent工作流等场景中,清晰的上下文加明确的约束,远比一个空洞的“专家身份”要管用得多。

这意味着什么?意味着你不需要再花10分钟琢磨“你是一位资深营销大师还是经验丰富的记者”,而应该花10分钟把背景资料、参考样例、约束条件写清楚。

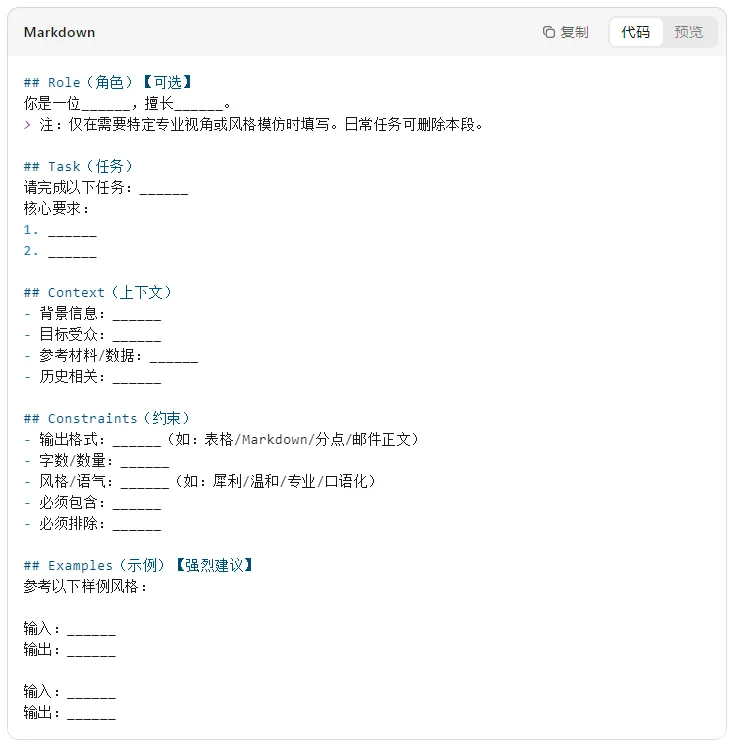

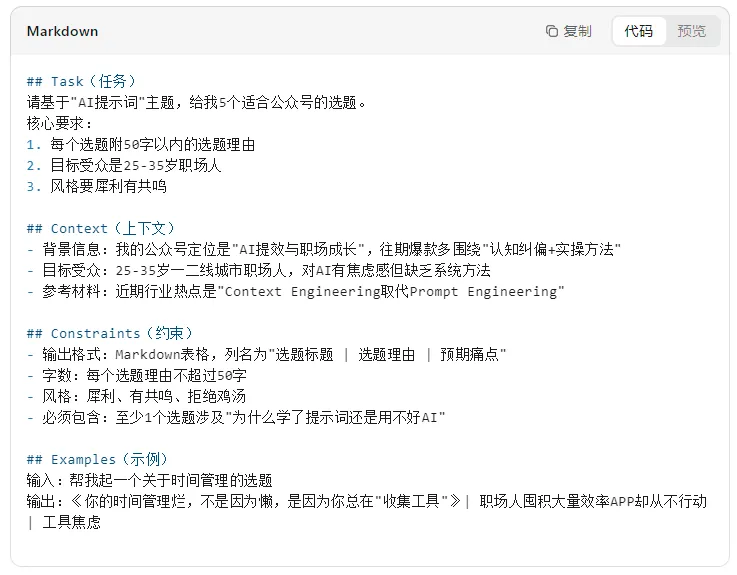

基于这个变化,我推荐你在2026年使用 RTTCC 结构来写提示词:

用动作词明确核心指令,拒绝“优化一下”这种模糊表达

背景信息、目标受众、参考材料,这是2026年最重要的部分

输出格式、字数、风格、注意事项、必须包含或排除的内容

理论说完,直接上干货。以下是一个基于RTTCC结构的Markdown格式参考模板,你可以复制到任何AI对话框中使用,也可以添加自己认为需要告诉AI的其他内容。

因为它把”你要什么”拆解成了机器最容易理解的信息结构。模型不需要猜你的身份,也不需要猜你的风格,所有关键信息都明码标价地摆在了上下文里。

1. 角色不是万能药,上下文才是

不要再迷信“你是一位顶级XXX”这种开场白了。2026年的大量实践已经证明,与其给一个空洞的专家头衔,不如直接投喂高质量参考材料。模型对“具体上下文+明确约束”的响应质量,远好于“华丽角色+模糊指令”。

2. 提示词不是一次性咒语,而是可迭代的系统

OpenAI和Anthropic的官方文档在2026年都不再强调“一句完美的prompt”,而是强调固定模板+变量注入+评估循环。你的提示词应该像代码一样版本化管理,用一次优化一次,而不是每次从零开始。这也是为什么Prompt Engineer作为独立职位正在消失——因为提示词能力已经被打散到产品、工程、内容等各个岗位,成为基础技能而非专项技能。

今天就可以做的行动:打开你的AI对话框,把收藏夹里那些“角色扮演模板”删掉,用上面的RTTCC模板重新写一段提示词。只改这一次,你就能感受到差别。

你在用AI时踩过最大的坑是什么?欢迎评论区聊聊~

夜雨聆风

夜雨聆风