AI编码工具接入国产模型:GLM-5.1 / DeepSeek V4

Claude Code只能用Anthropic模型?Cursor不支持国产?错——本文给出每个工具接入国产模型的完整配置方案,所有模型统一通过硅基流动接入,一个Key搞定GLM-5.1、DeepSeek V4、Kimi,新用户还送16元代金券。

一、国产模型API准备

在配置工具之前,先拿到API Key——这是所有方案的前提。

1.1 一站式接入:硅基流动

不要分别去智谱、DeepSeek、月之暗面官网注册API!用硅基流动一次性搞定——一个账号、一个API Key,直连三大国产模型。

什么是硅基流动?硅基流动(SiliconFlow)是国内领先的模型推理平台,聚合了GLM、DeepSeek、Kimi等主流国产模型,统一提供OpenAI兼容API。好处:

-

🔑 一个Key调所有模型——不用分别注册智谱、DeepSeek、月之暗面 -

💰 新用户送16元代金券——注册+实名认证即到账,够用很久 -

⚡ 统一计费入口——所有模型消费汇总,不用管理多个账户余额 -

🔄 同一API格式——切换模型只改一个model参数

立即注册(送16元代金券):

👉 https://cloud.siliconflow.cn/i/sZPuKE9a

💡 注册后完成实名认证,16元代金券自动到账

硅基流动提供的国产模型:

|

|

|

|

|

|---|---|---|---|

| GLM-5.1 | Pro/zai-org/GLM-5.1 |

|

|

| GLM-4-Flash | THUDM/GLM-4-Flash |

|

|

| DeepSeek V4 | deepseek-ai/DeepSeek-V4 |

|

|

| DeepSeek R1 | deepseek-ai/DeepSeek-R1 |

|

|

| Kimi k2 | moonshotai/Kimi-k2 |

|

|

1.2 统一API格式

硅基流动使用 OpenAI API格式,这意味着:

-

所有模型共用同一个 baseUrl和apiKey,只改model即可切换 -

同一个工具,切换国产模型只需改一行配置

|

|

|

|---|---|

| Base URL | https://api.siliconflow.cn/v1 |

| API Key |

|

| GLM-5.1 | Pro/zai-org/GLM-5.1 |

| DeepSeek V4 | deepseek-ai/DeepSeek-V4 |

| DeepSeek R1 | deepseek-ai/DeepSeek-R1 |

| Kimi k2 | moonshotai/Kimi-k2 |

| GLM-4-Flash | THUDM/GLM-4-Flash

|

1.3 一站式接入:英伟达免费大模型

参考 英伟达免费大模型白嫖攻略:NVIDIA NIM + OpenClaw 实战 获取 API Key

二、Claude Code 接入国产模型(cc-switch方案)

2.1 为什么需要cc-switch

Claude Code官方绑定Anthropic模型,无法直接配置第三方API。cc-switch 是解决这个问题的社区方案——它是一个跨平台桌面应用(GitHub 50K+ Stars),作为协议转换层拦截Claude Code的请求并转发到国产模型。

cc-switch支持的工具:Claude Code / Codex / OpenClaw / OpenCode / Gemini CLI

2.2 安装与配置

Step 1:安装cc-switch

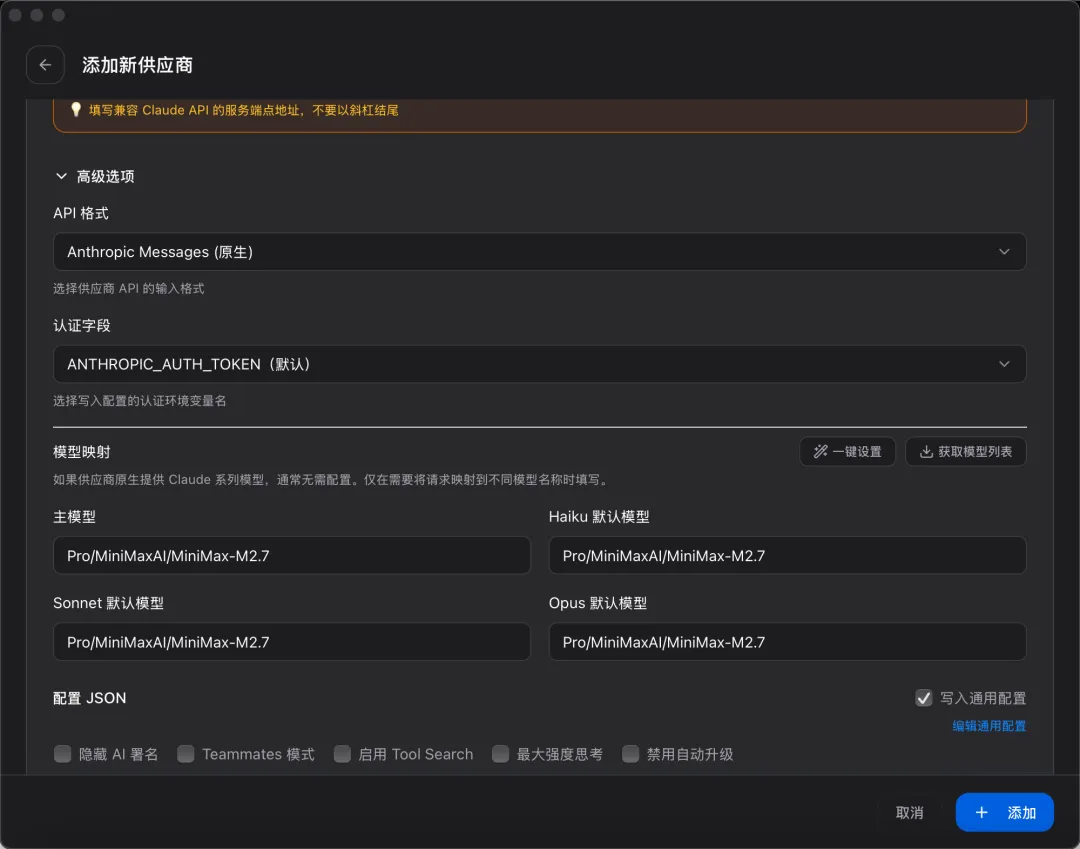

# macOSbrew install--cask cc-switch# 或从 GitHub Releases 下载# https://github.com/farion1231/cc-switch/releasesStep 2:启动cc-switch,添加供应商

打开cc-switch桌面应用 → 顶部切换到 Claude Code 选项卡 → 点击右侧 + 添加供应商:

选择SiliconFlow,只需要填写API Key,其他保持默认即可。

2.3 三级模型配置(Haiku / Sonnet / Opus)

Claude Code 内部按三级模型路由任务——简单问题走 Haiku(快+便宜),日常走 Sonnet(均衡),攻坚走 Opus(最强)。通过 cc-switch,我们可以用硅基流动的国产模型完美替代这三档:

|

|

|

|

|

|---|---|---|---|

| Haiku |

|

THUDM/GLM-4-Flash |

|

| Sonnet |

|

Pro/zai-org/GLM-5.1 |

|

| Opus |

|

deepseek-ai/DeepSeek-R1 |

|

在 cc-switch 中配置三级模型:

在 cc-switch 桌面应用中,分别为三个档位添加供应商:

配置完成后,Claude Code 的 /model 命令可以直接选择这三个模型:

/model THUDM/GLM-4-Flash # Haiku档:快速补全/model Pro/zai-org/GLM-5.1 # Sonnet档:日常编码/model deepseek-ai/DeepSeek-R1 # Opus档:深度推理💡 省钱技巧:日常挂在 Sonnet 档(GLM-5.1),只在需要深度推理时手动切到 Opus 档(DeepSeek-R1)。Haiku 档由 Claude Code 内部自动调用,不用手动切。

2.4 注意事项

|

|

|

|---|---|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

2.5 验证方法

配置完了,怎么确认请求真的走了国产模型?

方法一:看 /model 输出

/model# 应显示当前模型为 Pro/zai-org/GLM-5.1 或其他硅基流动模型# 如果显示 claude-sonnet-4-xxx 则还没切过去方法二:问模型自己

你是哪个模型?请告诉我你的模型名称和提供商。走 GLM-5.1 回复会提到”智谱”或”GLM”;走 DeepSeek 会提到”DeepSeek”;如果提到 Claude,说明配置有问题

方法三:检查 cc-switch 日志

-

cc-switch 桌面应用底部有请求日志,确认转发到了 api.siliconflow.cn -

如果日志出现 api.anthropic.com,说明该请求没走 cc-switch

三、OpenCode 接入国产模型(原生方案)

OpenCode原生支持75+模型供应商,配置最简单。

3.1 基础配置

在项目根目录创建 .opencode/config.json:

单一模型(GLM-5.1):

{"provider":"openai-compatible","baseUrl":"https://api.siliconflow.cn/v1","apiKey":"你的硅基流动API-Key","model":"Pro/zai-org/GLM-5.1"}3.2 多模型切换配置

日常用便宜的,攻坚用强的——一个配置文件搞定:

{"providers":{ "siliconflow":{ "type":"openai-compatible", "baseUrl":"https://api.siliconflow.cn/v1", "apiKey":"你的硅基流动API-Key" } }, "models":{ "fast":"siliconflow/THUDM/GLM-4-Flash",// 免费,日常补全 "default":"siliconflow/Pro/zai-org/GLM-5.1",// 默认主用 "reasoning":"siliconflow/deepseek-ai/DeepSeek-R1",// 深度推理 "chat":"siliconflow/moonshotai/Kimi-k2"// 长文档对话 }}3.3 验证方法

方法一:启动时看模型信息

opencode# 启动时会打印当前模型,应显示 siliconflow/Pro/zai-org/GLM-5.1方法二:对话中切换并确认

/model# 列出当前可用模型,确认包含硅基流动的模型方法三:问模型自己

你是哪个模型?方法四:curl 直接验证 API(首次配置推荐!)

curl https://api.siliconflow.cn/v1/chat/completions \-H"Authorization: Bearer 你的硅基流动Key"\-H"Content-Type: application/json"\-d'{"model":"Pro/zai-org/GLM-5.1","messages":[{"role":"user","content":"你是谁"}]}'# 返回正常JSON就说明 Key 和 Model ID 都正确四、Cursor 接入国产模型

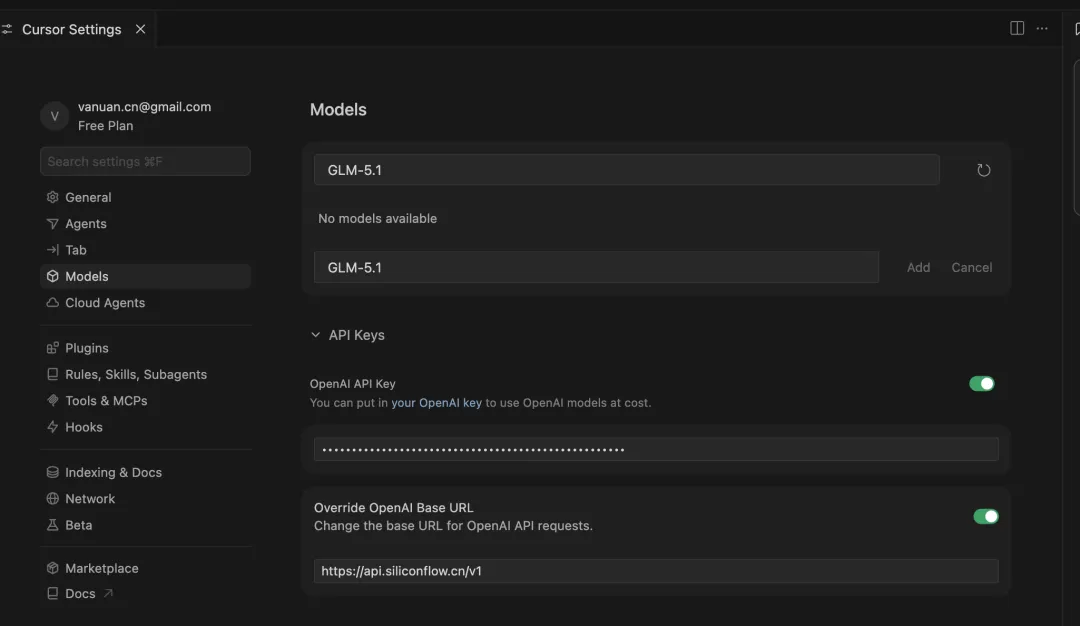

Cursor支持OpenAI兼容API,可接入国产模型,但需手动配置。

4.1 配置步骤

Step 1:打开设置

Settings → Models → Add Model

Step 2:接入GLM-5.1

类型:OpenAI API CompatibleBase URL:https://api.siliconflow.cn/v1API Key:你的硅基流动KeyModel ID:Pro/zai-org/GLM-5.1

Step 3:接入DeepSeek V4

类型:OpenAI API CompatibleBase URL:https://api.siliconflow.cn/v1API Key:你的硅基流动KeyModel ID:deepseek-ai/DeepSeek-V4Step 4:接入Kimi

类型:OpenAI API CompatibleBase URL:https://api.siliconflow.cn/v1API Key:你的硅基流动KeyModel ID:moonshotai/Kimi-k24.2 使用与注意事项

注意:由于 Cursor 的限制,只有订阅了 Cursor 高级会员及以上的用户才支持自定义配置模型。

4.3 验证方法

方法一:模型下拉菜单

-

在 Composer 或 Cmd+K 面板中,点击模型选择下拉菜单 -

应该能看到你添加的 Pro/zai-org/GLM-5.1等模型 -

当前选中的模型名称会显示在输入框旁

方法二:问模型自己

你是哪个模型?告诉我你的具体模型名称。方法三:查看网络请求

Help → Toggle Developer Tools → Network-

发一条消息,查看请求是否发往 api.siliconflow.cn -

如果发往 api.openai.com则没走国产模型

五、Codex 接入国产模型

❌ 不可行。

Codex运行在OpenAI云端沙盒,所有请求走OpenAI通道,目前无法接入任何第三方模型。这是架构层面的限制,不是配置问题。

如果你需要云端Agent+国产模型,目前没有替代方案。

六、Trae 接入国产模型

6.1 配置步骤

Settings → Model → Add OpenAI Compatible

接入GLM-5.1:

Endpoint:https://api.siliconflow.cn/v1API Key:你的硅基流动KeyModel:Pro/zai-org/GLM-5.1接入DeepSeek V4:

Endpoint:https://api.siliconflow.cn/v1API Key:你的硅基流动KeyModel:deepseek-ai/DeepSeek-V46.2 注意事项

-

Trae默认豆包模型免费无限使用,接入国产模型需额外付API费 -

Pro版 ¥79/月 + 国产模型API费 = 双重付费,但Pro主要买的是高级功能而非模型额度 -

免费版+国产模型API是最经济方案

6.3 验证方法

方法一:模型选择器

-

对话框顶部有模型选择下拉,确认当前选中的是硅基流动配置的模型

方法二:问模型

你是哪个模型?请告诉我你的模型名称。七、Lingma IDE 接入国产模型

Lingma IDE是阿里的独立AI IDE(区别于通义灵码插件版),内置Agent模式,支持自定义模型配置。

7.1 配置步骤

Settings → Model → Add Custom Model

接入GLM-5.1:

类型:OpenAI CompatibleBase URL:https://api.siliconflow.cn/v1API Key:你的硅基流动KeyModel:Pro/zai-org/GLM-5.1接入DeepSeek V4:

类型:OpenAI CompatibleBase URL:https://api.siliconflow.cn/v1API Key:你的硅基流动KeyModel:deepseek-ai/DeepSeek-V47.2 注意

-

IDE版内置Agent模式,插件版没有 -

默认Qwen3模型免费用,切国产模型需另付API费 -

企业版支持私有化部署接入自选模型

7.3 验证方法

方法一:设置页确认

Settings → Model

,确认自定义模型已保存且选中

方法二:问模型

你是哪个模型?请说出你的模型ID。八、Qoder 接入国产模型

Qoder是阿里推出的Agentic编程平台,主打Quest长任务和Spec驱动开发。

8.1 配置

Settings → Model → Switch Model

Qoder采用自动模型路由(默认Qwen3-Coder),支持手动切换到其他模型。具体接入国产模型的方式随版本迭代更新,建议在Qoder的模型设置页面查看最新支持的供应商列表。

8.2 注意

-

Qoder更依赖自家Qwen3-Coder的Spec理解和长任务能力 -

切换国产模型可能影响Quest Mode的执行质量 -

预览期Pro功能免费体验(每月2000额度)

8.3 验证方法

Settings → Model → Switch Model

页面确认当前选中的模型 -

对话中问”你是哪个模型?”确认回复提到国产模型名称

九、CodeGeeX 接入国产模型

9.1 GLM-5.1(硅基流动接入)

CodeGeeX本就是智谱AI产品,GLM系列是”亲兄弟”:

-

插件设置中直接选择GLM-5.1云端模型(走智谱官方通道) -

或通过硅基流动API接入,配置方式同其他工具:

Base URL:https://api.siliconflow.cn/v1API Key:你的硅基流动KeyModel:Pro/zai-org/GLM-5.19.2 DeepSeek V4(硅基流动接入)

Base URL:https://api.siliconflow.cn/v1API Key:你的硅基流动KeyModel:deepseek-ai/DeepSeek-V49.3 验证方法

原生GLM:插件设置中选择的模型直接显示,无需额外验证

硅基流动API:问模型”你是谁”,确认回复提到对应国产模型名称

十、快速对比:9个工具 × 3个国产模型

以下所有模型均通过硅基流动统一接入,一个API Key搞定。

|

|

|

|

|

|

|---|---|---|---|---|

| Claude Code |

|

|

|

|

| OpenCode |

|

|

|

|

| Cursor |

|

|

|

|

| Codex |

|

|

|

|

| Trae |

|

|

|

|

| Lingma IDE |

|

|

|

|

| Qoder |

|

|

|

|

| 通义灵码插件 |

|

|

|

|

| CodeGeeX |

|

|

|

|

配置难度说明:

-

⭐ 改一行配置 → OpenCode -

⭐⭐ 填API端点 → Cursor、Trae、Lingma IDE(统一填硅基流动端点) -

⭐⭐⭐ 需要额外工具或付费 → Claude Code(需cc-switch)、通义灵码插件(需企业版)

十一、推荐方案

|

|

|

|

|---|---|---|

| 国内最低成本 |

|

|

| 保留Claude Code体验 |

|

|

| IDE党用国产模型 |

|

|

| 最省心中文体验 |

|

|

| 阿里生态一体化 |

|

|

| 企业合规 |

|

|

| 断网离线 |

|

|

本文为「AI编码工具实战」系列第2篇。接下来,我们逐一深入每个主力工具——Claude Code、OpenCode、Cursor、Codex,各出一篇完整使用指南。

夜雨聆风

夜雨聆风