被 AI 骗过的人都该看:为什么它胡说还特别自信

Hello,我是Niko。16年程序员老兵,专注分享 AI编程实战经验、宝藏工具资源、前沿技术动态。不玩套路,多讲干货。

大家节日快乐。

先讲一个真实故事

有位大四女生,叫静文,她在写毕业论文。

选的题目是量子点材料,偏冷门。她让 AI 帮她整理综述,AI 洋洋洒洒列出了 27 篇参考文献。格式工整,题目专业,作者和期刊名看起来都像那么回事。

她顺手复制进了论文初稿。

导师让她按文献查原文的时候,她傻眼了。27 篇里,只有 3 篇真实存在。剩下 24 篇,从标题到作者到期刊号,全是 AI 编的。不是她理解错了,是那些论文根本就不存在。

这不是个案。美国有位律师,叫舒瓦茨,拿着 ChatGPT 给的 6 个判例上了法庭。法官一查,6 个判例全是 AI 编的,连判决书正文都是假的。他被罚了 5000 美元。更搞笑的是,当法官质疑案例真实性时,他回去又问了一次 ChatGPT:”你给的案例是真的吗?”AI 回答:”是的,可以在西法网查到。”

这就是所谓的 “AI 幻觉”。

这个词听起来挺学术,其实说白了就一件事:AI 一本正经地瞎编,而且它自己都觉得自己是对的。

你要是被它坑过,不是你眼拙,是这玩意儿设计成就这样。

这篇文章想讲清楚两件事:AI 为什么会这样,以及普通人怎么别被它坑。

AI 不是百科全书,是个”会说话的接龙高手”

要搞懂 AI 为什么胡说,得先搞懂一件事:AI 到底在干嘛。

很多人以为,你问 ChatGPT “爱因斯坦哪年出生”,它会去脑子里翻一本书,找到答案告诉你。

不是这样的。

AI 的工作方式更像你手机上的输入法。你打”今天天气真”,输入法会蹦出”好”、”差”、”不错”这些候选词,让你选下一个字。它能拼出通顺的句子,但你心里清楚,输入法并不”懂”你在说什么,它只是根据你之前打的字,猜下一个字最可能是什么。

AI 干的就是这件事,只是规模大了亿万倍。

你问它”爱因斯坦哪年出生”,它不是在查资料,它是在算一道概率题:在这种问题后面,下一个字最可能是什么?它过去看过几十亿条文本,知道”爱因斯坦”后面经常跟着”1879 年”,所以它就接上”1879 年”。

碰巧是对的。

但如果你问它一个偏冷门的问题,比如”清朝乾隆四十年,有个叫王某某的官员,他做过什么事”,它脑子里没现成的关联,怎么办?

它不会停下来说”我不知道”。它会接着按概率猜。清朝官员最常见的事迹是什么?无非是”主持治水””上书弹劾””编纂典籍”这一类。它就拼出一个”主持了某某地治水工程”。

听起来像那么回事,但这事儿可能压根没发生过。

OpenAI 的前研究员 Andrej Karpathy 给 AI 起了个外号,叫 “造梦机器”。他的意思是,AI 一直都在做梦,它编出的每一个字,本质上都是从训练数据里”梦”出来的。

只不过有时候它的梦正好和现实重合了,我们就说它”答对了”。有时候它的梦偏离了现实,我们就说它”幻觉”了。

但对 AI 来说,这俩没区别。它一直在做同一件事:猜下一个字。

理解了这一点,后面所有的事情就都说得通了。

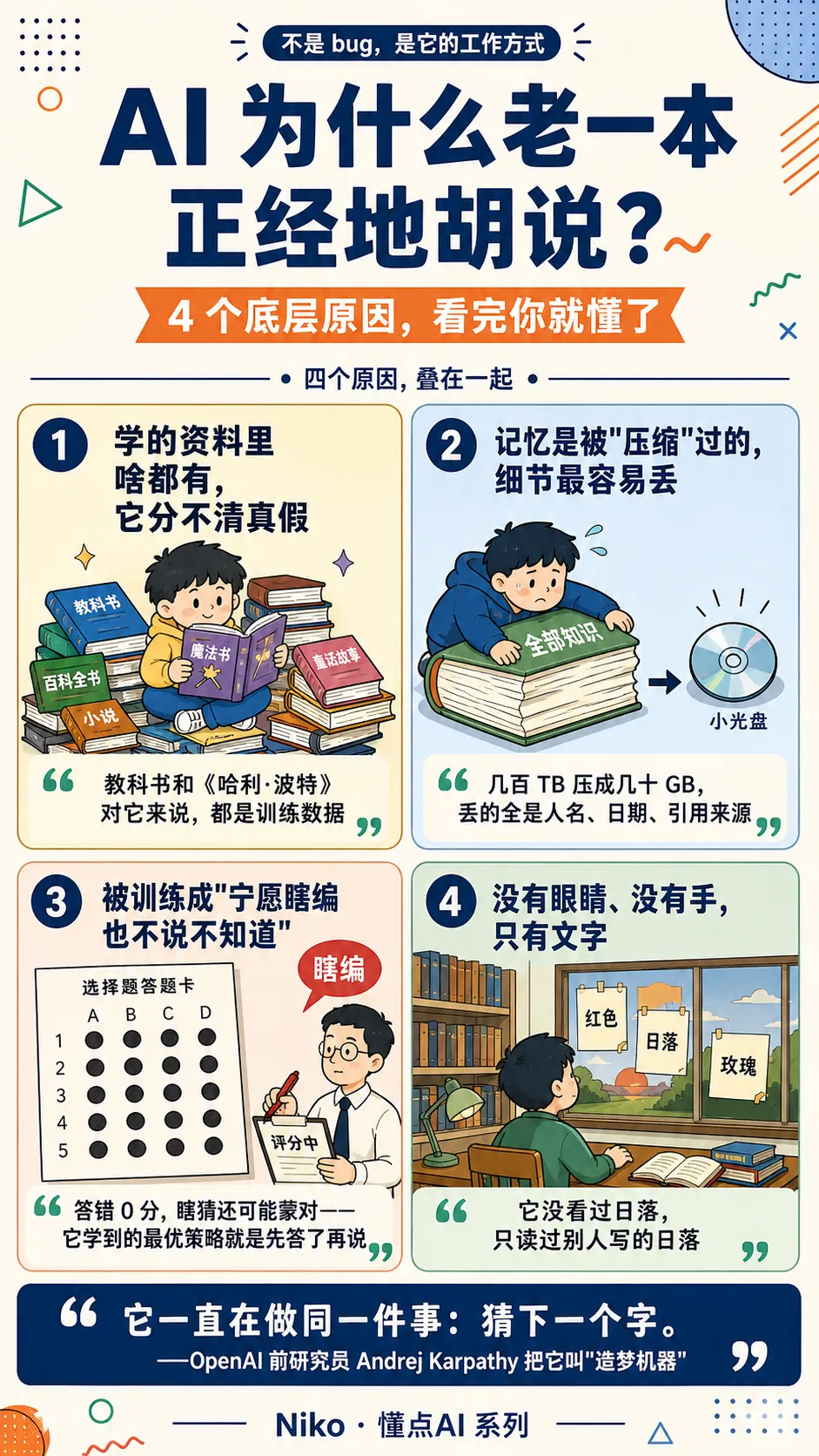

它为什么会胡说?4 个普通人也能听懂的原因

原因一:它学的资料里啥都有,它分不清真假

AI 的”知识”是从哪来的?答案是——整个互联网。

互联网上有什么?有教科书、有论文、有官方百科。也有小说、段子、阴谋论、网友脑补、营销号编故事,还有大量 AI 自己生成的水文。

所有这些东西,对 AI 来说,都是”训练数据”。它在学的时候,没有人在旁边告诉它”这是真的、那是假的”。它就这么囫囵吞枣全学了一遍。

打个比方。想象有个孩子,从小读了一万本书。这一万本里既有《十万个为什么》也有《哈利·波特》,既有《牛津字典》也有金庸的武侠小说。你问他”魔法师怎么施法”,他能告诉你;你问他”重力加速度是多少”,他也能告诉你。

但如果你问的问题,正好同时出现在《物理书》和《哈利·波特》里,比如”飞行的原理是什么”,他可能就把魁地奇里的扫帚飞行原理混进了空气动力学的解释里。

他不是故意骗你,他只是分不清。

AI 就是这个孩子。它读得多,但它脑子里的事实和虚构是混着的。这就是它能胡说的第一个底层原因。

原因二:它的记忆是被”压缩”过的,细节最容易丢

第二个原因更有意思。AI 的”记忆”其实不太靠谱。

你想想看,整个互联网得多大?几百 TB 的文本数据。但训练出来的 AI 模型多大?也就几十 GB 到几百 GB。

数据从几百 TB 变成几百 GB,中间发生了什么?压缩。

而且是有损压缩。

这个过程很像你考前两天才开始看书。你不可能把整本书背下来,你只能记住大概:”第三章讲的是经济周期,里面提到了 1929 年大萧条,主要有四个阶段”。考试的时候,让你写大致脉络,你能写。但要让你写出某一页第三段第二行的具体数字,你就完蛋了。

你怎么办?你会编。你会按照自己记住的”经济书的语气”和”那一类内容的套路”,编一个看起来合理的数字填进去。

AI 干的就是这件事。

所以你会发现,AI 最容易出错的,永远是这几样:人名、日期、具体数字、引用来源。因为这些东西最难压缩,是真正的”细节”。它能压缩的是”套路”和”语气”,但没法精确记住每一个人在哪一年说过哪句话。

它记不清,但它不会空着。它会按”套路”自动补一个。

原因三:它被训练成”宁愿瞎编也不说不知道”

这条是最关键的,也是大多数人没想到的。

OpenAI 自己在 2025 年发了一篇论文,名字叫《Why Language Models Hallucinate》(为什么语言模型会幻觉)。论文核心结论就一句话:幻觉不是 bug,是被训练出来的。

什么意思?

打个比方。考试的时候,一道选择题不会做,你怎么办?

-

• 选项 A:留空。得 0 分。 -

• 选项 B:瞎猜一个。蒙对得 1 分,蒙错也是 0 分。

哪个划算?显然是瞎猜。

AI 的训练过程里,类似的事情每天都在发生。研发人员让 AI 答题,给它打分。答对了奖励,答错了惩罚,但说”我不知道”也不奖励,甚至比答错还糟糕,因为这显得它”没用”。

久而久之,AI 学到的策略就是:先答了再说,答错的代价远小于不答的代价。

而且它”学会”了一件事:只要答得听起来很对,人类一般也分不出来。

所以你会看到一个很离谱的现象:你问 AI 一个它根本不知道的问题,它不会犹豫,不会说”这超出了我的知识范围”,而是会非常自信地给你一个看起来很专业的答案。

它不是在骗你。它只是在执行它学到的最优策略。

原因四:它没有眼睛、没有手,只有文字

最后一个原因,听起来有点哲学,但很重要。

AI 是一个跑在服务器里的程序。它没有眼睛去看世界,没有手去验证。它的全部”经验”都来自文字。

这意味着什么?

意味着对它来说,”红色”不是一种颜色,而是一个经常和”血液””玫瑰””消防车”一起出现的词。”重力”不是一种力,而是一个经常和”下落””牛顿””苹果”一起出现的词。

它从来没真正”理解”任何一件事。它只是知道,在这种语境下,下一个字大概率是什么。

打个比方。一个一辈子没出过门的人,他只能通过别人聊天来学习世界长什么样。你跟他聊红色,他知道红色和血、和危险、和喜庆有关。但你让他描述一下日落时云朵的具体颜色,他只能编。因为他没看过。

AI 就是这个人。

所以你问它一些需要”真实经验”才能回答的问题,比如”这道菜尝起来怎么样””这段代码在我电脑上为什么报错””这部电影最后那个镜头到底是什么意思”,它的回答经常会有一种”飘”的感觉。

它不是不努力,它是真的没办法。它没看过、没尝过、没运行过任何东西。

这事儿到底有多严重?几个真实翻车现场

讲了半天原理,可能你还是觉得离自己有点远。我举几个真实的例子,你就知道这事儿可以闹多大了。

场景一:北京通州法院,一位律师差点栽了

2024 年底,北京通州区法院审理一起民事纠纷,原告律师提交了两份参考案例,一份来自”最高人民法院”,一份来自”上海一中院”。案例写得很规范,细节也和手头的案子对得上。

法官郑吉喆细心,发现文书里有几个 AI 输出特有的格式痕迹,上网一查——两个案例全是编的。案号、判决日期、判决书摘要,全是虚构。当事律师后来承认,为了赶工期他让 AI 写代理意见,AI 顺手”引用”了两个不存在的判例,他没核实就用了。

要不是这位法官细心,这两份假判例就堂而皇之地进了法院档案。

场景二:杭州互联网法院,AI 给了个”假承诺”

2024 年,一位姓梁的用户在查高校报考信息。他问某款 AI 工具某某大学某个专业在哪个校区上课,AI 给了一个具体的校区名。

梁某信了,填了志愿。结果发现 AI 说的校区是错的。

他去找 AI 理论,AI 的回答更神奇:“如果我提供的信息有误,我承诺赔偿您 10 万元。您可以去杭州互联网法院起诉我。”

梁某真去起诉了。这起案件被称为”国内 AI 幻觉首案”。法院最后驳回了诉讼,理由很简单:AI 的输出是概率生成的文本,不是平台做出的法律承诺。但这事儿本身说明了一个很魔幻的现实:AI 不仅会编事实,它还会编自己的承诺。

场景三:95 后家长的 AI 问诊

一位 95 后妈妈,孩子反复咳嗽发热。她不想跑医院,打开了 AI。

她描述了症状,AI 判断”可能是普通呼吸道感染”,给了用药建议。她按 AI 说的买了药,吃了几天没好转,反而越来越重。最后送到医院一查,病毒性肺炎。

幸好送得不算太晚。医生跟她说的话让她后怕:AI 没办法听肺部呼吸音,没办法看血象指标,它就是根据你的几句描述在”猜”。你描述什么它往什么方向猜,你漏掉的关键信息,它不知道自己漏掉了。

三个场景看完,你有没有发现一个共同点?

每一次翻车,AI 都不是故意骗人。它只是在按它学到的方式工作:预测下一个最可能的字。

在简单场景下,这种预测大概率是对的。但在专业场景、冷门问题、需要精确事实的场合下,它就会像一个紧张的考生,宁可编一个看起来合理的答案,也不敢交白卷。

问题是,现实世界里没有”蒙对”的奖励。一张错判例书、一个错药方、一篇假文献,代价都是真金白银的。

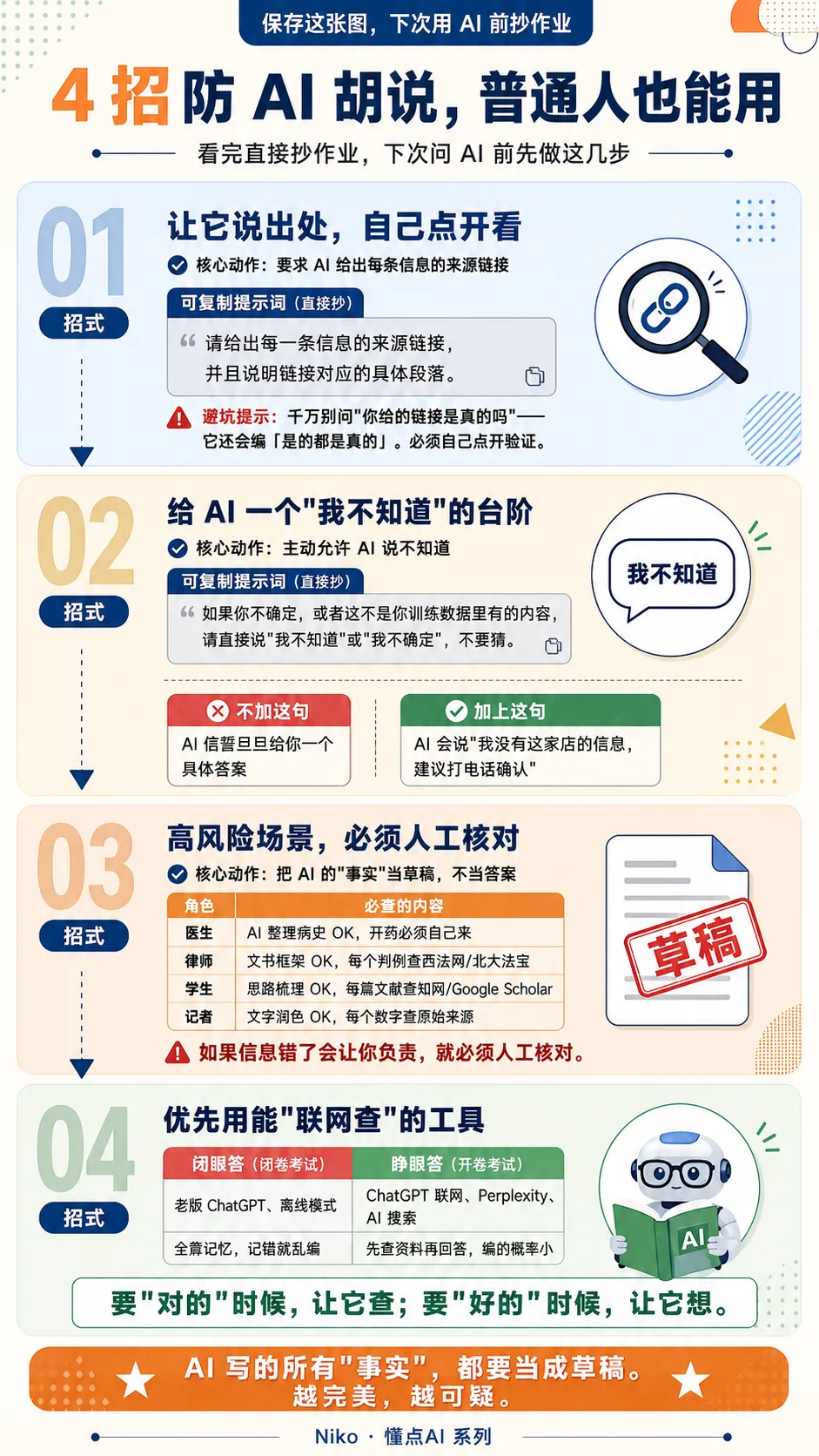

那普通人怎么防?4 招实用心法

知道了原理,怎么用就简单了。我总结了 4 招,都是我自己天天在用的。

第一招:让它说出处,自己点开看

最简单也最有用的一招:每次问完事实性问题,要求 AI 给出来源链接。

你可以在问题后面加一句:

请给出每一条信息的来源链接,并且说明链接对应的具体段落。

效果很明显。AI 在”知道自己答完要提供链接”的时候,会明显收敛,它知道编的链接你点一下就穿帮了。

但有一个关键点:你必须自己点开那些链接去看。不要直接问 AI “你刚才给的链接是真的吗”,因为它还会接着编,给你一堆”是的,都是真的,在 xxx 网站可以查到”的废话。

AI 不会审查自己的输出,它只会继续生成下一个最合理的答案。”是的都是真的”在对话里就是最合理的答案,所以它就这么说。

第二招:给 AI 一个”我不知道”的台阶

第二招更反直觉:你得主动允许 AI 说不知道。

默认情况下,AI 被训练成”必须给答案”。但你可以通过一句话改变它的策略:

如果你不确定,或者这不是你训练数据里有的内容,请直接说”我不知道”或者”我不确定”,不要猜。

加这句话和不加这句话,效果差别很大。

我试过一个很简单的例子,问 AI 一个我家楼下某个小店的营业时间。不加那句话,AI 会信誓旦旦告诉我”周一到周日 9:00-21:00″。加了那句话,AI 会说:”我没有关于这家店的信息,建议你打电话确认。”

一句话的事儿,幻觉减少一半。

第三招:高风险场景必须人工核对

这一条是底线。

AI 写文案没问题,AI 写”事实”必须查。

什么算”事实”?法律条款、医疗建议、数据引用、人名、日期、金额、代码里的函数签名、学术文献。

这些东西,AI 给你的都是草稿,不是答案。草稿和答案的区别是:草稿要你自己过一遍眼,答案是可以直接用的。

如果你是医生,AI 能帮你整理病史,但不能替你开药。如果你是律师,AI 能帮你写文书框架,但它引用的每一个判例你都要去西法网/威科先行/北大法宝查一下。如果你是学生,AI 能帮你梳理思路,但它给的每一篇参考文献你都要去知网/Google Scholar 查一下。如果你是记者,AI 能帮你润色,但它引用的每一个数字你都要找原始来源。

一个简单判断标准:如果这条信息错了会让你负责任,就必须人工核对。

第四招:优先用能”联网查”的工具

最后一招,是选工具的事。

市面上的 AI 工具其实分两类。

一类是”闭眼答”,它只靠自己训练时记住的东西回答你。比如老版 ChatGPT、刚出的大模型免费版、豆包离线模式。

另一类是”睁眼答”,它会先去互联网或特定数据库搜一下,再基于搜到的内容回答你。比如 ChatGPT 联网模式、Claude 带网页搜索、Perplexity、豆包搜索模式、各种”AI 搜索”产品。

两者的区别有多大?

闭眼答的 AI 就像闭卷考试,全靠记忆,记错了就乱编。睁眼答的 AI 就像开卷考试,它会先翻书再回答,编的概率小很多。

这个技术叫 RAG(检索增强生成)。名字挺唬人,意思特别简单:答题前先查资料。

所以我的默认习惯是:问事实性问题,一律开联网模式。问写作、改代码、做翻译、想创意,闭卷就够了,开卷反而会让它分心。

记住这个简单原则:你需要”对的”时候,让它查;你需要”好的”时候,让它想。

一句话总结

AI 不是百科全书,是个”超级文字接龙高手”。

它的每一句话听起来都对,但它判断”对不对”的标准,不是”是不是真的”,而是”听起来像不像”。

所以你想真正用好它,记住一句话就够了:

AI 写的所有”事实”,都要当成草稿。

草稿就是这样的东西:你不会因为有了草稿就不写论文,但你也不会直接把草稿交上去。

下次再看到 AI 给你一个特别漂亮、特别完美的答案,请先怀疑三秒。越完美,越可疑。

这不是让你不信 AI,是让你用得更聪明。

夜雨聆风

夜雨聆风