字节跳动的AI资本开支分析:谁在花钱,花在哪,为什么花

字节跳动,是中国AI算力链上最大的需求引擎之一。理解它的投入规模和结构,是理解整条AI产业链的关键。

01. 字节的AI资本开支规模

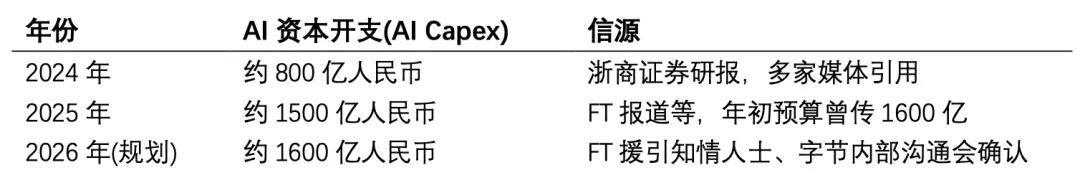

根据多个信源交叉验证,字节的AI相关资本开支轨迹如下:

2024年字节800亿的资本开支,接近腾讯+百度+阿里三家的总和(约1000亿元)。但到了2025年,BAT追赶了上来,阿里资本开支已突破千亿达到1039亿,腾讯增至792亿。但即便BAT在追赶,字节仍然是最大的单一玩家。一个很有意思的对比是:腾讯2024年回购分红和偿债的净总金额达到1681亿,是当年资本开支的2倍多;阿里2024年股份回购加分红合计1457亿,同样是当年AI资本开支的2倍以上。而字节没有上市,不需要分红回购,可以把利润全部投入AI。这是字节在AI军备竞赛中的结构性优势。

对比美国大厂,字节2025年约1500亿人民币(约205亿美元),大约是谷歌的1/4,Meta的1/3,微软的1/3。

02. 1600亿花在哪里?

根据浙商证券研报的估算以及FT等多家外媒的报道,我们可以大致拆出两大板块和四个流向。

总体结构:芯片占大头,AI数据中心基建占剩下的部分。以2025年初期预算1600亿为基准(实际执行约1500亿),资金大致分成两大块:AI算力采购(芯片+服务器):约900亿元,占比约56%;IDC基建 + 网络设备:约700亿元,占比约44%。

到2026年(据FT2025年12月报道),芯片预算微调至850亿,总量维持1600亿。芯片依然是最大的单一支出项,但围绕芯片的配套基础设施加起来也接近一半。这意味着,分析字节的AI投入,不能只盯着芯片,基建侧同样重要。

更值得注意的是地域分布。在算力采购部分,在国内支出400亿,海外(主要东南亚)支出500亿。IDC基建部分,则是国内500亿,海外200亿。可以看到,海外合计支出约700亿,占总预算的44%。这说明字节的算力布局已经是一个全球化战略。

流向一:AI芯片

芯片采购是字节AI capex中最大的单项支出,也是供应链最复杂、地缘政治风险最高的环节。字节在这个方向上分散供应风险,采用买英伟达、买国内替代和自研芯片三条腿走路的策略。

1)英伟达(海外主力)

据Omdia数据,字节跳动是中国境内英伟达AI芯片的最大买家,也是英伟达在亚洲的最大客户。2024年字节和腾讯各订购了约23万枚英伟达Hopper芯片,仅次于微软的48.5万枚。截至2025年底,字节已储备近12万张英伟达A100/A800/H800系列加速卡,以及近百万片H20、L20、L40芯片。同时,字节已下了2万颗H200的测试订单,每颗价格约2万美元。

一个关键细节是,海外芯片预算(500亿)大于国内(400亿)。这背后的逻辑是,字节通过在马来西亚、泰国等海外数据中心部署算力,可以合法使用高端英伟达芯片,绕过对中国大陆的出口限制。海外数据中心不仅服务TikTok等海外业务,也承担部分AI模型训练任务。

需要说明的是,字节目前没有被列入美国实体清单,这使它与华为的处境完全不同。华为2019年被列入实体清单后,全球供应链几乎被切断;而字节目前受到的只是普遍性的对华芯片出口管制,仍然可以正常采购合规型号的英伟达芯片、使用Synopsys的EDA工具、找三星代工。但这个窗口并非永久敞开,如果中美关系进一步恶化,字节被列入实体清单的可能性不能排除。

2)华为昇腾+国产芯片(国内替代)

字节在国内的算力部署中,已经引入了相当数量的国产AI芯片,包括华为昇腾、海光信息、寒武纪以及百度旗下的昆仑芯等,数量在数千至数万片不等。虽然与英伟达的近百万片的量级相比占比仍然较小,但渗透率在快速提升。

采购华为昇腾的一个好处是,华为可以提供从芯片到服务器(Atlas系列)到集群互联方案的全栈交付,字节不需要自己操心组装的问题。

据此前的报道,字节跳动在2025年的推荐算法集群中,非英伟达芯片的占比首次突破了40%。这个数字反映出国产芯片在推理和微调这类对单卡极致性能要求较低的场景中,已经具备了实用价值。

3)自研SeedChip(长期布局)

字节自研AI芯片的项目代号为”SeedChip”,隶属于2023年成立的Seed部门,芯片研发团队规模约500人,核心成员来自英伟达、AMD、英特尔、华为海思等。

据路透社2026年2月报道,SeedChip V1计划2026年3月底前在三星晶圆厂完成流片并产出工程样片。初期年产能规划10万颗,优先满足字节内部算力需求,剩余产能通过火山引擎向外部客户开放。远期产能目标提升至35万颗。

值得注意的是,代工方选择了三星而非中芯国际。同时,与三星的合作还可能涉及HBM(高带宽内存)的供应安排,相当于一举两得。

不过字节对上述报道的回应是”信息不准确”,未做进一步说明。SeedChip的具体进展仍需持续跟踪。

流向二:IDC基建

字节在数据中心上的策略正在经历一次重大转向。从之前依赖第三方租赁,转向大规模的自建。

字节目前已公开的国内自建项目包括:安徽芜湖”火山引擎长三角算力中心”(总投资80亿元,设计服务器机柜21,824台)、山西大同”火山云太行算力中心”二期(投入45亿元,6栋两层数据中心,规划机柜15,604台)、内蒙古和林格尔算力中心(一期总投资约56亿元),以及河北张家口数据中心的持续扩建。

海外方面,字节在马来西亚柔佛建设区域AI算力中心,在泰国的数据中心,此前还在爱尔兰投资5亿美元建设数据中心。

除了自建数据中心,还在自建变电站,连电力都要自主可控。2025年1月,字节发布了自建数据中心变电站设计框架采购寻源公告,计划为中国区自建园区设计110kV和220kV变电站的标准方案。这个细节值得注意,因为变配电系统占数据中心固定投资成本的25%-30%,电力成本占运营成本的55%-60%。连变电站都要自己建,说明字节的自建规模和决心已经到了需要从电力源头实现自主可控的程度。

但第三方租赁仍然重要,自建不意味着完全抛弃第三方。润泽科技作为字节的核心IDC/AIDC服务商,字节相关业务占其营收比重超过60%,双方通过中国电信签订了长达10年的合作协议。短期内,字节的存量业务仍大量运行在润泽科技的机房中。不过,字节自建比例的提升对第三方IDC运营商来说是一个需要关注的信号。有业内人士指出,字节自建算力中心能够对外展示自建能力,获得更好的议价权,这也意味着大厂给第三方IDC的订单利润可能承压。

流向三:网络设备

数据中心内部的交换机和光模块虽然在总资本支出中占比不算最大,但这是一个技术迭代快、确定性高的环节。

交换机方面,锐捷网络是字节跳动等头部互联网企业的数据中心交换机主流供应商。2024年,锐捷网络中标了字节跳动的智算中心建设项目并陆续供货交付。光模块方面,光迅科技是国内光模块龙头,字节跳动是其主要客户之一。随着数据中心内部带宽需求从400G向800G甚至1.6T跃升,光模块是技术迭代最快的细分赛道之一。

光模块和交换机不像AI芯片那样受到严格的出口管制,国内厂商既可以供国内数据中心,也可以打入海外CSP的供应链。中际旭创、新易盛等中国光模块企业已经是全球市场的重要供应商。

流向四:液冷散热

随着AI芯片功耗密度的急剧上升,传统风冷已经无法满足散热需求,液冷正在成为AI数据中心的标配。液冷在总capex中的占比目前约5%-10%,但这个比例正在快速上升。以英伟达GB200 NVL72机柜为参照,单机柜功耗达120kW,冷却液需要以每秒2升的速度持续流过。这个量级的散热需求,只有液冷才能解决。高澜创新、润泽科技都是这个领域为字节提供液冷设备的供应商。

03.为什么要花这么多钱?

截至2025年12月,豆包日活用户(DAU)正式突破1亿,月活(MAU)超过1.7亿。这使它成为国内首个日活破亿的AI原生应用。抖音之后,字节的亿级日活产品家族再添一员QuestMobile 2025年第三季度数据显示,豆包月活1.72亿,占据国内AI应用约一半的月活用户份额,远超第二名的Kimi和文小言。而到12月底,豆包把月活的数字变成了日活,通常工具类产品MAU到DAU的折损非常大,豆包能做到这一点,说明用户粘性远高于行业平均。

更值得注意的是获客效率。据字节内部人士透露,豆包的用户增长和市场推广费用,是字节历史上所有破亿DAU产品中花费最低的。作为对照,腾讯元宝自2025年2月起累计投放近60亿元推广费,一度登顶App Store免费榜,但在日活上仍与豆包有显著差距。豆包的增长更多来自产品本身的口碑传播和抖音生态的导流,而不是砸钱买量。

如果说日活是用户端的表象,那么Token调用量才是算力需求的真实量度。

截至2025年12月,豆包大模型日均Token调用量已突破50万亿,较2024年同期增长超过10倍。可以做一个对比帮助理解这个数字的规模:2025年上半年,整个中国公有云大模型市场的调用量为536.7万亿Tokens(IDC数据),其中火山引擎以49.2%的市场份额排名第一。也就是说,火山引擎一家(主要由豆包驱动)占了全中国大模型调用量的近一半。

Token消耗量的构成也值得拆解。火山引擎总裁谭待透露:企业端占Token调用的80%,个人端占20%。这意味着豆包App本身虽然DAU过亿,但真正消耗算力的大头反而是通过火山引擎云服务服务的企业客户,超过100家企业在火山引擎的年累计Tokens使用量超过一万亿。

每一个Token都在消耗GPU推理算力。DAU越高、Token调用量越大,对推理算力的需求就越大。这就是为什么字节的资本开支在2025年下半年骤然加码,不是因为要训练更大的模型,而是在推理侧,豆包的用户增长速度超出了算力储备的承载能力。

字节正在批量推出AI产品,而每一个新产品都会创造新的算力需求。2025年底推出的Seedance 2.0仅凭内测就引发现象级关注。AI视频生成对算力的消耗是文字对话的数十倍甚至上百倍,一段10秒的视频生成可能消耗百万级Token。另外还有AI图像生成的Seedream,全双工语音大模型Seeduplex,以及火山引擎云服务(包括汽车智能座舱、零售、茶饮等场景)。

每一个产品线的增长,都意味着新增的推理算力需求。而且这些产品之间会形成交叉促进,豆包拉来的用户尝试了AI生图功能,生图功能的传播又拉来新用户,新用户可能转而使用视频生成,持续消耗着大量的GPU算力。

如果字节不这么花钱,会如何?

AI竞赛有一个残酷的特点,算力规模直接决定了模型能力的上限(Scaling Law),而模型能力又决定了产品体验和用户留存。如果字节在算力投入上慢一拍,豆包的模型升级会落后、产品体验会下降、用户会流向竞争对手(DeepSeek、腾讯元宝、阿里千问都在快速追赶),而失去的用户几乎不可能挽回。

同时,在B端,火山引擎的云服务收入取决于能否提供足够的算力。如果企业客户想要调用更多Token但发现算力不够,他们会转向阿里云或其他平台。算力短缺不只是技术问题,更是商业问题。

对字节来说,这1600亿是在保卫豆包已经建立的用户规模优势,保卫火山引擎正在快速增长的B端收入,保卫字节在中国AI产业中的领先地位。

04.钱花出去了,然后呢?

回看字节跳动的1600亿AI资本开支,它不是一个孤立的数字,而是中国AI产业在2025-2026年这个关键节点上最浓缩的缩影。

它反映了需求侧的真实性,豆包DAU破亿、日均50万亿Token不是虚构的数字。它也反映了竞争的残酷性,不投入就会被超越,投入了也不一定能赢。它还反映了中国AI产业的独特处境,在出口管制的约束下,走出一条效率优先、应用先行的差异化路径。

对于关注这个产业的人来说,字节的AI资本开支是一个极好的观察窗口。它的规模变化反映行业景气度,它的结构变化反映技术路线的演进,它的供应商变化反映产业链的重构。持续跟踪这些变化,比任何单一时间点的分析都更有价值。

这也是我们这个系列的初衷。这是第一篇,后续我们会持续跟踪字节及其他中国大厂的AI资本开支动向,以及这些资金在产业链中的传导路径。如果你有新的信息或不同的观点,欢迎交流。

参考资料

1.《字节的 AI 军备竞赛——大模型行业点评》,浙商证券,12/2024

2.《拟70亿美金采购AI芯片?字节跳动或引领新一轮资本开支浪潮》,21财经,12/2024

3.《分析师预测字节2025年AI算力开支超千亿国内算力需求黎明已至》,财联社,01/2025

4.<ByteDance Signals Major AI Infrastructure Push With $23BN Investment Plan>, World-Energy, 12/2025

5.《深度|字节AI投入更加激进,明年资本开支或冲到1600亿,百亿美元利润为冲刺全球第一梯队备足弹药》,腾讯网,12/2025

6.《消息称字节跳动自研芯片团队已超千人》,DoNews,02/2026

7.《15名美议员联名致信商务部部长,呼吁将字节跳动列入实体清单》,知乎,02/2024

8.《字节:AI芯片SeedChip曝光》,腾讯网,02/2026

9.《从芜湖到新加坡:字节跳动的算力版图扩张之路数据中心》,微云,01/2025

10.《深度绑定字节,迎接AIDC时代》,兴业证券,01/2025

11.《36氪独家|豆包DAU破亿,成字节史上推广费用最少的破亿产品》,36氪,12/2025

12.《字节跳动,正在变成“Token跳动”》,腾讯网,12/2025

13.《2025年净利下滑超70%、海外营收增长近50%:字节跳动的AI豪赌是远见也是冒险》,每经网,04/2026

夜雨聆风

夜雨聆风