OpenClaw失忆症?这才是小龙虾完全体!

盯着这行字,我沉默了五秒,不是说好的私人管家吗?怎么前后连半个小时都不到,就把我交代你的事忘了?

这是我用 AI 干了三年活之后,最深的一个挫败感。

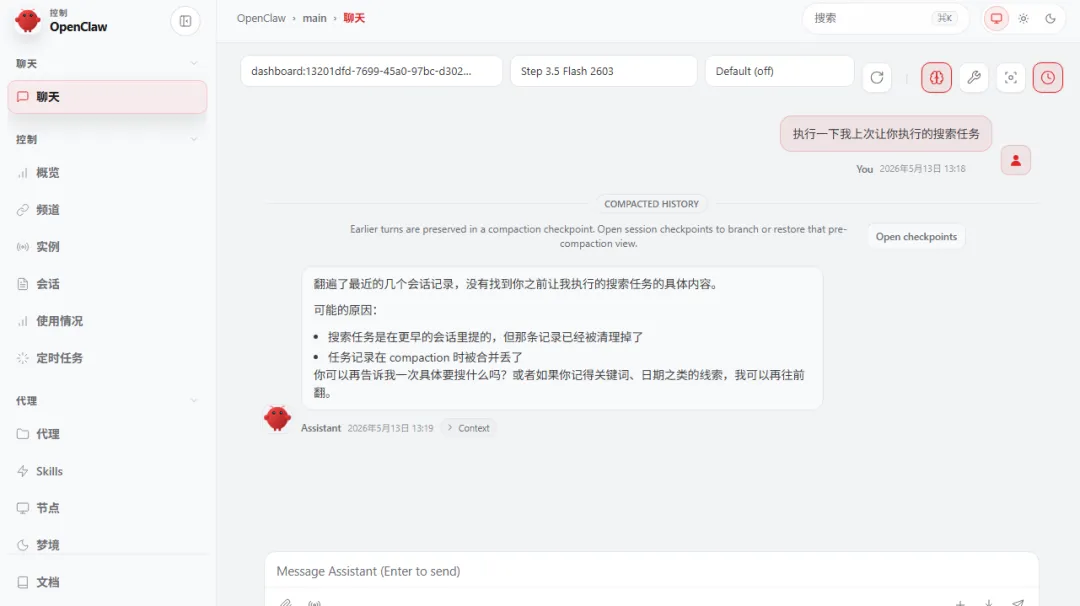

小龙虾最大的问题,不是能力不够,而是新开一个 session 之后,之前任务的过程和偏好几乎都丢了。它更像是临时对话缓存,而不是真正的长期记忆。

然后,我刷到了 MemOS Local Plugin 2.0 的发布通告。

第一次试,被一组数字钓住

MemOS之前就刷到过,也听说过他们在AI记忆方面的工作。但 5 月 9 号这次 2.0 发布,我刷到这么一组数字。

同等任务下,模型调用频率下降 59.5%,总 token 消耗下降 70%,任务精度从 23.73% 提升到 31.68%。

关键是最后那个精度。

一般来说,省 token 跟提精度是有冲突的,你塞给模型的上下文少了,它该有的信息缺失,精度通常会跌。结果这玩意又省了又提,那就只能是一种解释,省掉的本来就是噪音。

怀着试试的心态,我直接就装了。

curl -fsSL <https://raw.githubusercontent.com/MemTensor/MemOS/main/apps/memos-local-plugin/install.sh> | bash就这一行。

安装脚本会自己检测你机器上有没有装 OpenClaw 和 Hermes,两个插件,都用这一行命令。

我这台上 OpenClaw 是常驻的,Hermes 也有但用得少。脚本两边都接上了,给我开了两个 Viewer 端口,OpenClaw 是 18799,Hermes 是 18800。

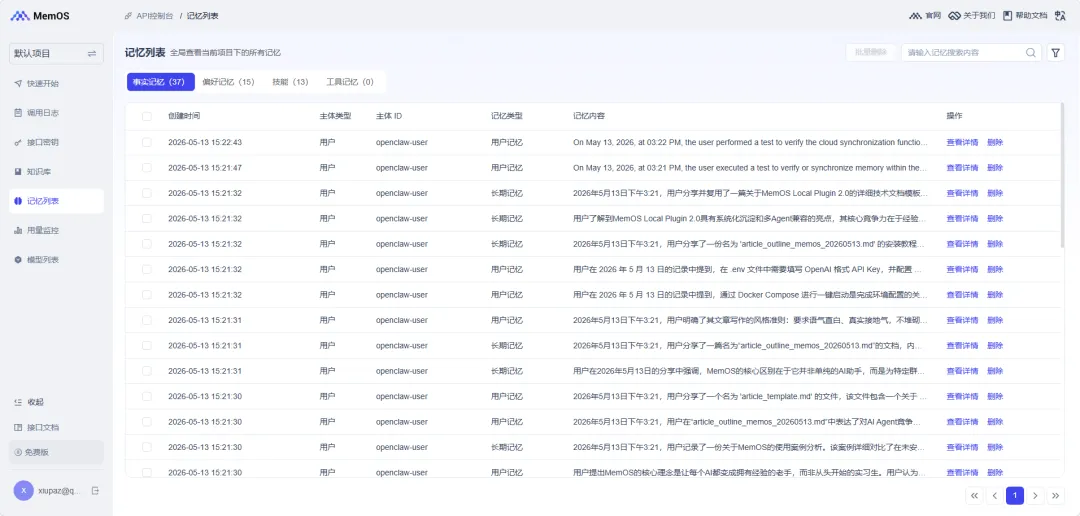

我打开 18799 那个,瞄了一眼。会话、任务、技能等六个标签页,每条记忆都能点进去看细节。

我盯着这个东西看了几分钟,心里就有一个预感。

这玩意,可能真的不一样。

「执行即学习」到底是个什么东西

现在,回过头来聊聊 MemOS Local Plugin 2.0 到底干了什么?

传统的 AI 记忆方案,你可以把它想象成一本日记。OpenClaw 帮你干完一件事,最后日记本上写一行「2026 年 4 月 15 日,帮主人在 packages/ui 加了一个 Button 组件」。下次你又问类似问题,它去日记里查,搜到这一条,给你抄回来。

听着是不是没毛病?但你仔细想想就会发现,干这件事的过程里有 25 个 tool call 啊。

哪一步是关键?哪一步是无效试探?为什么第 12 个 tool call 突然就让它想通了?这些信息全在日记之外,全在那个被关掉的 session 里,蒸发了。

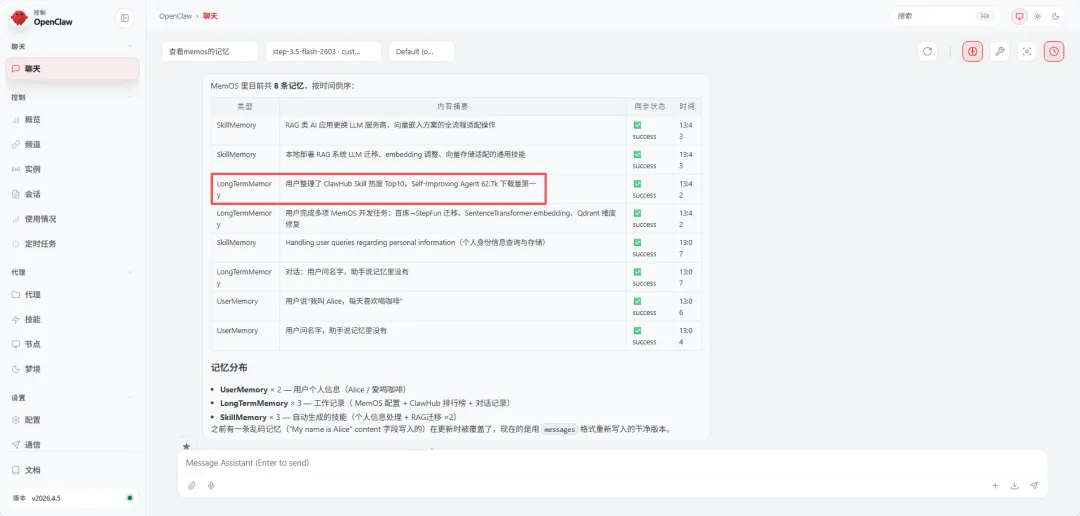

MemOS 2.0 干的事是,把这 25 步全部记下来,每一步都打上标签。

按官方的说法,每个回合都会过一条五步加工流水线,捕获、反思、价值估算、归纳、注入。捕获就是把这一步的动作、观察、Agent 的反思全部抓下来。然后估算这一步对最终成功的贡献有多大。再然后从一堆同类轨迹里归纳共性。最后下次类似任务进来的时候,把这些东西按需注入到上下文里。

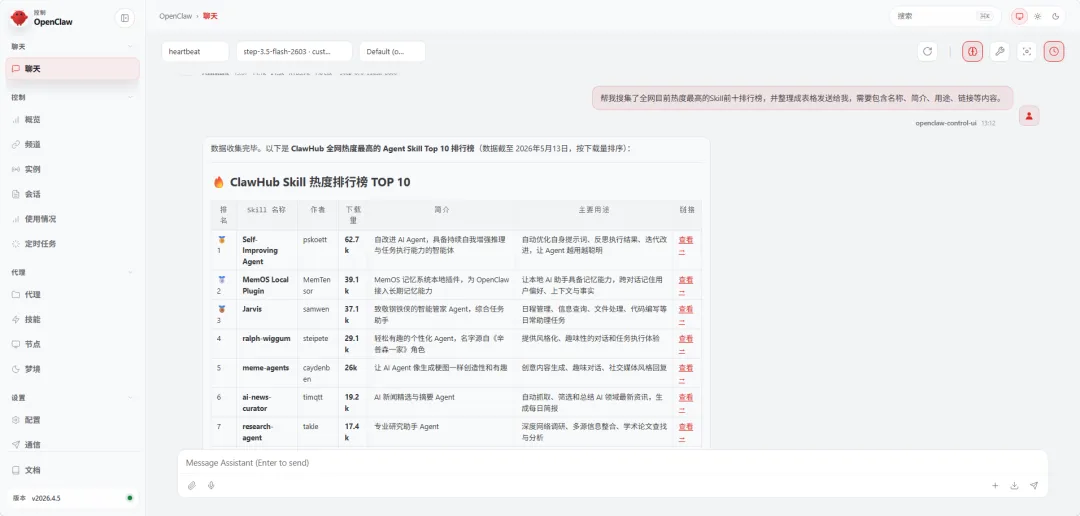

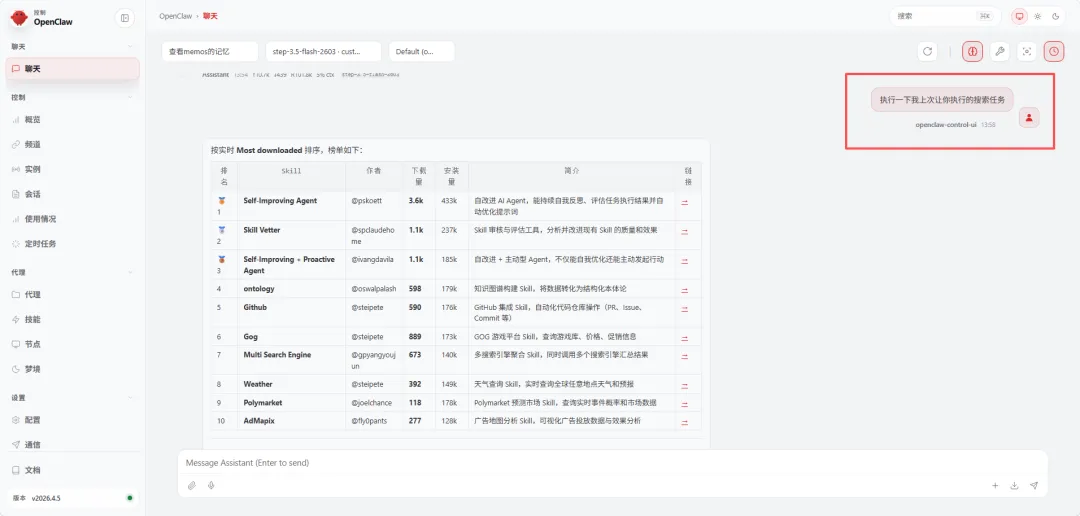

现在我只要直接告诉小龙虾:“再做一次上次我让你执行的那个搜索热门Skill的任务。”它会直接从记忆系统中调出上次的流程,并严格复现一遍。

这就是在使用相同提示词的情况下,有MemOS和没有MemOS的差别。任务流程可以被严格复刻,搜索的目标网站也完全相同。

换句话说,你的每一次任务执行,其实都在推动小龙虾完成一次迭代升级。

官方管这个叫「执行即学习」。

听着抽象,我举一个我前两天踩到的真坑。

我让小龙虾帮我搭一个 ComfyUI 的工作流,跑公众号的配图。中间它要在 Alpine 容器里装 lxml 这个 Python 包,结果一直跪。普通的 memory 如果记一下,最多记一句,「Alpine 下装 lxml 失败,后来修好了」。

MemOS 2.0 不一样。它会把这段过程切成下面这样。

Step 1, 直接 pip install lxml观察, 编译失败,缺少 libxml2头文件反思, 不是 Python 包版本问题,是 Alpine 的 musl 环境缺少构建工具Step 2, apk add build-base libxml2-dev libxslt-dev观察, 这次编译进了,但卡在 C 扩展链接阶段反思, 还差一个 zlib-dev,下次新 Alpine 镜像里这套都得提前备Step 3, 一次性把全套依赖装齐观察, 跑通反思, 之后再遇到任何 Alpine + 编译型 Python 包的场景,先装这一套

每一步都带着「动作 / 观察 / 反思」三个维度,每一步都有评分。哪一步是关键路径,Step 1 那条反思救了大命;哪一步只是试探,直接 pip install 那次属于低价值;它都分得清。

这让我感觉到,Agent 不是事后自己写报告,而是干活的时候每一步都在被记录、被评分、被归纳。

另外让我深有感触的一点是——它真的在帮我省Token!省钱的事情谁不喜欢呢。

MemOS帮了我大忙

接下来聊聊MemOS在我自己的活儿里到底帮了多少忙。

一个工具到底值不值得装,还得看它在你最高频、最具体的日常里,能不能真的省心。

一.创作助手

我最有体感的场景是写作。

以前每次让 AI 帮我列文章大纲,我都要重新喂一遍固定结构,新开一个对话,它就忘了。

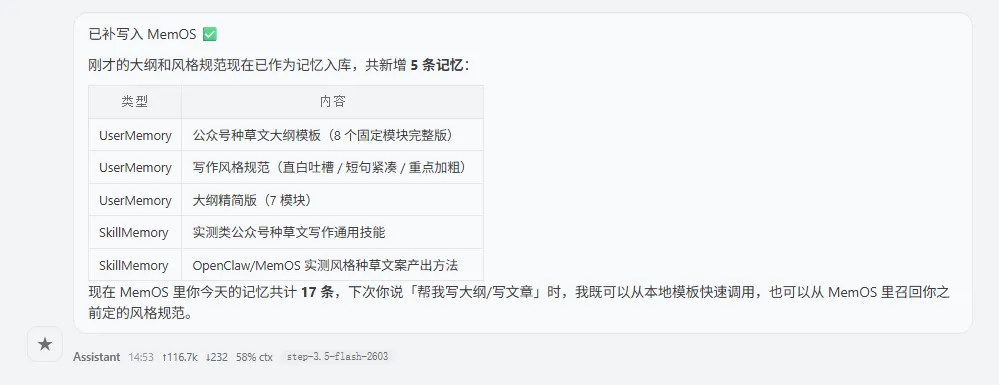

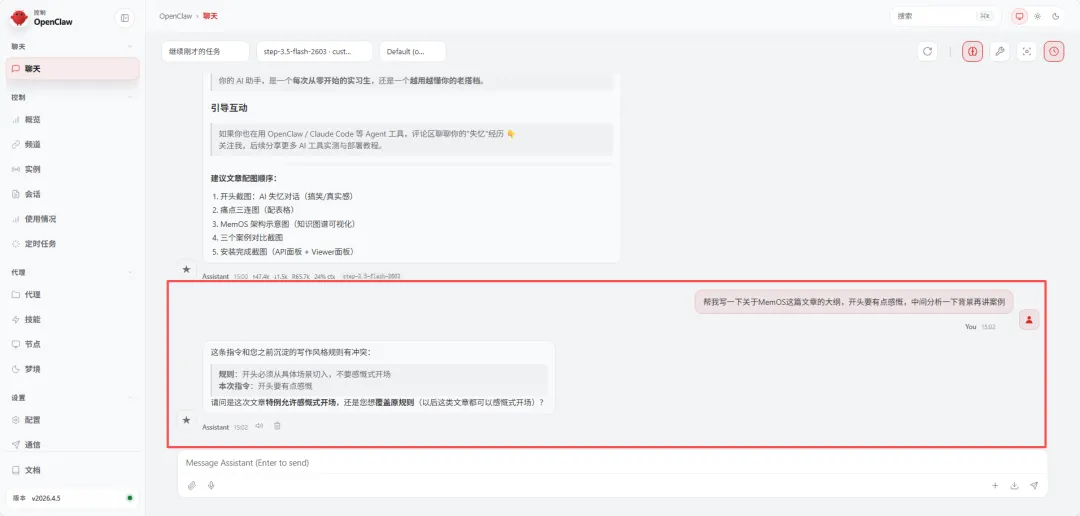

装上 MemOS 之后,我只系统教过它一次,以后再给新选题,它都会默认按那套结构输出。

更意外的是,有次我临时写了一条和旧规则冲突的要求,它还会主动提醒我:“这次是特例,还是要覆盖原来的写作风格?”

这已经不只是记住偏好,而是开始用历史标准校对当前任务。

二.团队协作

如果是团队使用,MemOS 还支持把记忆同步到云端,能把一个人打磨出来的工作流复用给整个团队。

而且,平时不只是我在积累记忆,所有小伙伴都在积累记忆。这样一来,好用的记忆就能以几何倍数增长,真正让OpenClaw越用越好用。

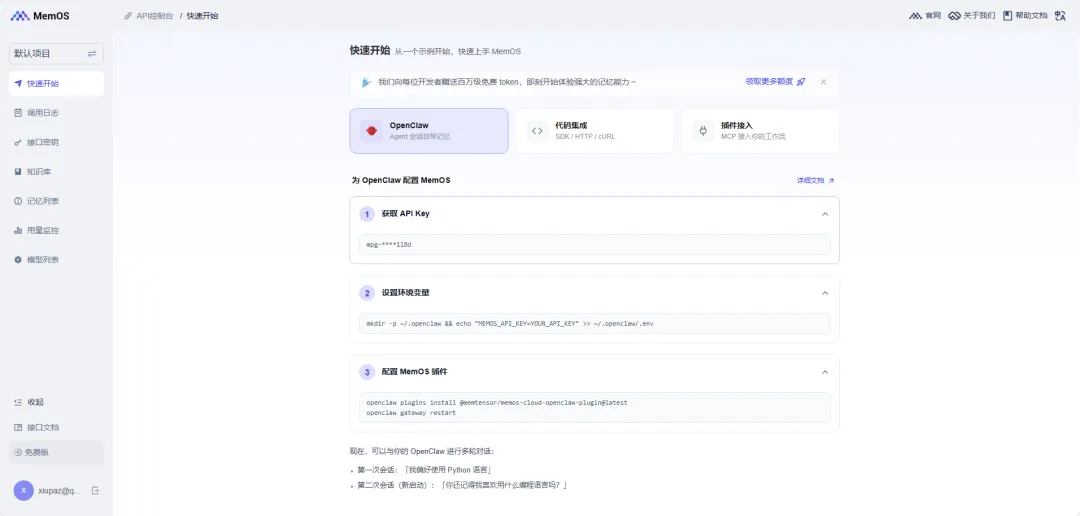

不过,云端插件和本地插件的安装方式略有不同,云端插件需要先去官网获取API,才能进行记忆同步,API可以在官网免费获取。

一份核心,两个Agent都能用

聊到这儿你可能也注意到了,我前面一直在说 OpenClaw,但开头我也提了一句这台机器上 Hermes 也接上了。

这次 2.0 发布最关键的一个产品决策是,OpenClaw 和 Hermes Agent 用的是同一份核心。

什么意思呢?

大家可以看一下这张图,适配器各自不同,但底下的算法、存储、检索、Skill 生命周期,全是同一份。

这个架构的好处用一句话讲,你的记忆资产不会因为换 Agent 工具就清零。

而且官方说了,从 2.0 这一版开始,未来新的 Agent 接入都通过这个本地插件同步支持。

这件事的真正份量,可能要再过一两年才会显出来。

因为我们正在进入一个 Agent 越来越多、越来越细分的时代。今天有 OpenClaw、有 Hermes、有 Claude Code、有 Codex,明天还会冒出来更多。你的真正资产,不应该被绑死在任何一个具体工具上。

你的「本地世界知识」应该是你自己的。你的工作怪癖、你踩过的坑、你磨出来的 Skill,应该跟着你走,而不是跟着工具走。

这个想法挺野的,但我觉得方向是对的。

如何安装MemOS

这里给大家提供几种安装方法:

1.我文章开头一键帮两个Agent安装,Hermes和OpenClaw同时拥有记忆

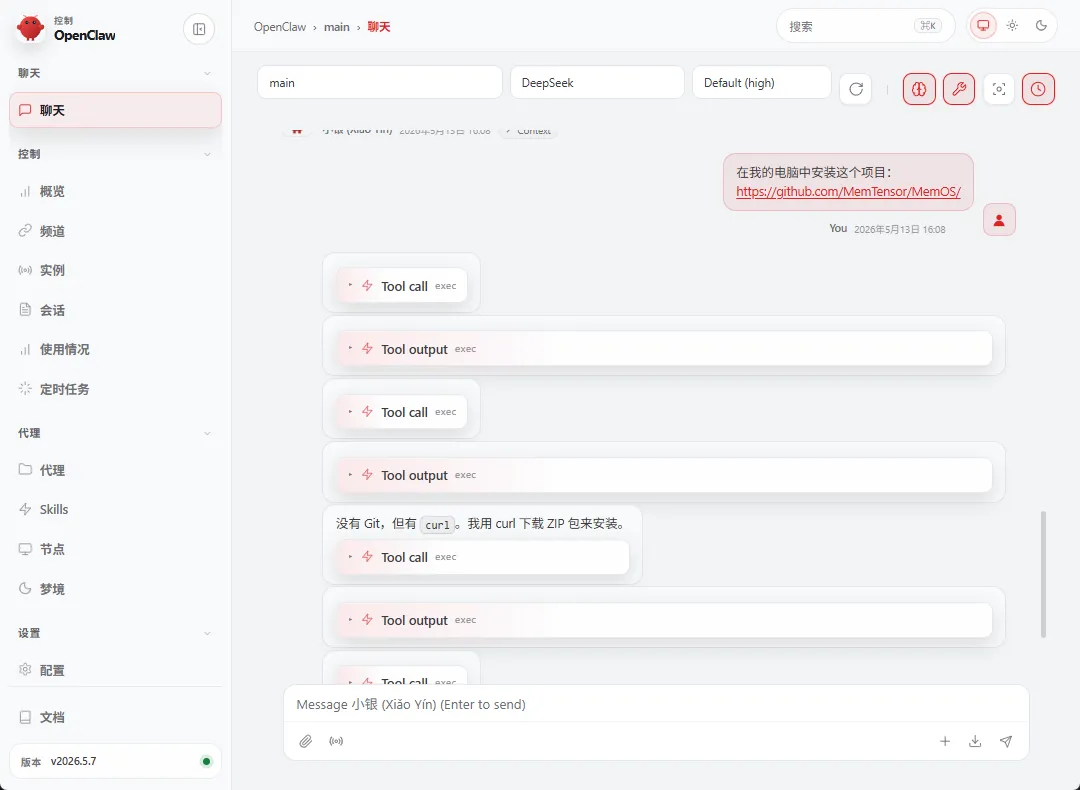

2.把MemOS的GitHub链接直接丢给OpenClaw,它就会自动开始安装。

大家把下面这条提示词发给小龙虾,就可以开始自动安装了:

在我的电脑中安装这个项目:

https://github.com/MemTensor/MemOS/tree/main

3.如果大家想钻研一下技术,也可以手动安装,在官方文档写的非常详细:

地址:https://memos-docs.openmem.net/cn

如果你看到这儿决定要试试,我有几条实操经验给你。

1.至少连续用两周再下结论,因为记忆系统需要积累过程数据。

2.每天打开一次 Viewer 的 Skills 标签看一眼。看着自己的 Agent 长技能这件事是个很强的正反馈,会让你更愿意持续用下去。

3.如果你有历史 session 数据,尽量导入,能更快把底子搭起来。

4.多给明确反馈,满意或不满意都直说,系统更容易学到有效偏好。

总结一下

OpenClaw被誉为近年来最好用的Agent之一,但“重启就失忆”这个缺点确实很不方便,而且它也不会主动存储记忆,用起来比较麻烦。

而MemOS正好填补了这方面的缺陷,让OpenClaw这类 Agent拥有主动存储记忆的能力,使成功任务可以被总结、复现,进而成为真正懂你的私人管家。

如果你不满足于表层的对话存储,而是有办公自动化、内容创作、复杂链式任务沉淀与复用等需求,可以试试MemOS。

目前它支持OpenClaw和Hermes,未来如果出现更多同类型的Agent,MemOS也会很快跟进支持。

因为它不是一个插件或Skill,而是一套记忆系统。大家可以关注一下MemOS的GitHub,一起参与Agent记忆系统的开发。

开源链接在这儿👇

https://github.com/MemTensor/MemOS

如果觉得不错,顺手点个 Star。我个人挺希望这个项目能跑出来的

夜雨聆风

夜雨聆风