清华+人大开源端云协同路由插件:技术架构、漏洞应对与行业格局深度解析

2026 年,AI Agent 正从「对话助手」进化为「数字员工」。

以 OpenClaw 为代表的开源 Agent 框架,在 GitHub 上已累计超过 33 万星标,成为近年来增长最快的开源项目之一。然而,光鲜的数据背后,是严峻的安全现实——

|

|

|

|

|

40,214 个互联网暴露的 OpenClaw 实例

|

|

|

|

|

|

|

更值得警惕的是 供应链攻击 ——ClawHub 市场在审计 2,857 个插件时,发现了 341 个恶意插件,其中不乏伪装成安全扫描器的木马分发载体。

与此同时,Microsoft 安全团队在其官方博客中指出:

>「OpenClaw 将不受信任的代码和不受信任的指令组合成单一执行循环,使用有效凭证运行。对于大多数环境,适当的决定可能是不部署它。」

为什么 OpenClaw 会面临如此严峻的安全挑战?让我们从技术架构层面分析:

-

「数据全上云」的信任错位OpenClaw 采用「云端优先」架构设计,所有用户数据默认上传至云端大模型处理。这种设计带来了两个根本性问题:

传统Agent数据流:用户输入 → [Agent] → 直接上传云端 → 云端大模型处理 → 返回结果 ↑ Token消耗 + 隐私暴露在处理敏感任务时(如分析财务报表、操作数据库、访问内部系统),用户的私密数据实际上已经「裸奔」到第三方服务器。

-

上下文窗口的「隐私泄漏通道」现代 Agent 系统依赖长上下文窗口来维护会话记忆。然而,当上下文窗口中包含敏感信息时,这些信息会随每次请求一起发送至云端。Microsoft 的分析指出:>「代理的持久性状态或’记忆’可被修改,导致其跟随攻击者提供的指令运行」即使用户意识到风险,由于上下文积累了大量历史数据,重新构建一个「干净」的会话成本极高。

-

在典型的开发工作流中,60-80% 的请求是简单任务——浏览代码文件、查询 API 文档、格式化输出——这些任务完全不需要 GPT-4o 级别的推理能力。

然而,Agent 框架缺乏任务复杂度感知能力,导致:

简单任务 → GPT-4o → \$0.03/1K tokens vs → GPT-4o-mini → \$0.00015/1K tokens成本差异:200倍

EdgeClaw/ClawXRouter 的技术架构深度解析

2026 年 3 月,清华大学 THUNLP 实验室、中国人民大学、AI9Stars、面壁智能与 OpenBMB 联合发布了 EdgeClaw 框架,并随之推出 ClawXRouter 插件,从架构层面解决上述问题。

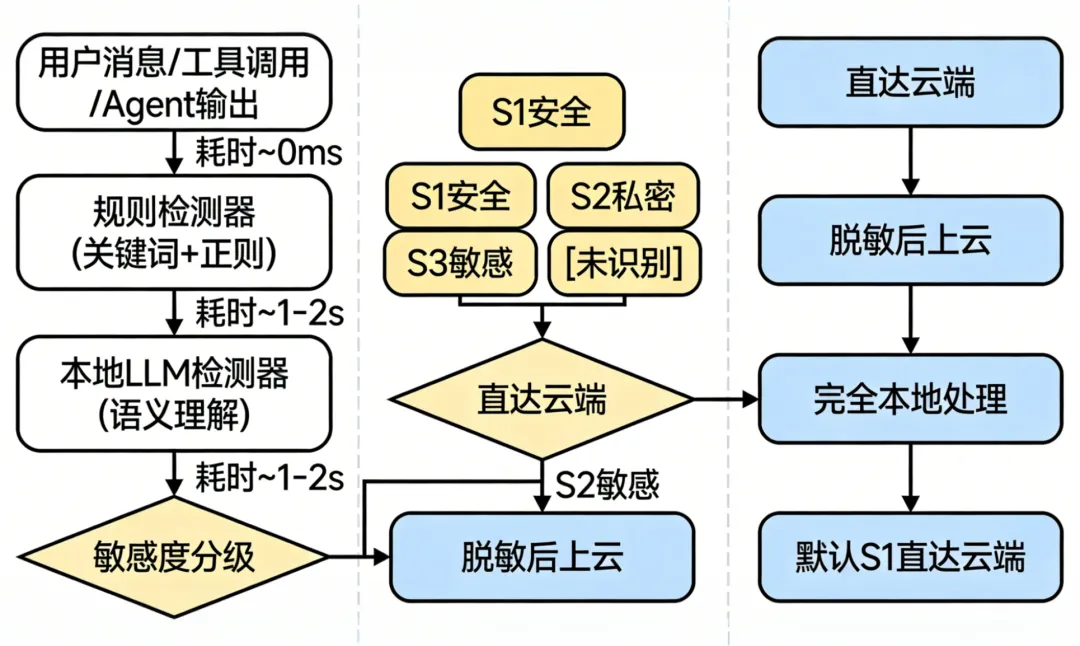

EdgeClaw 的核心创新是 三级隐私路由(Three-Level Privacy Routing):

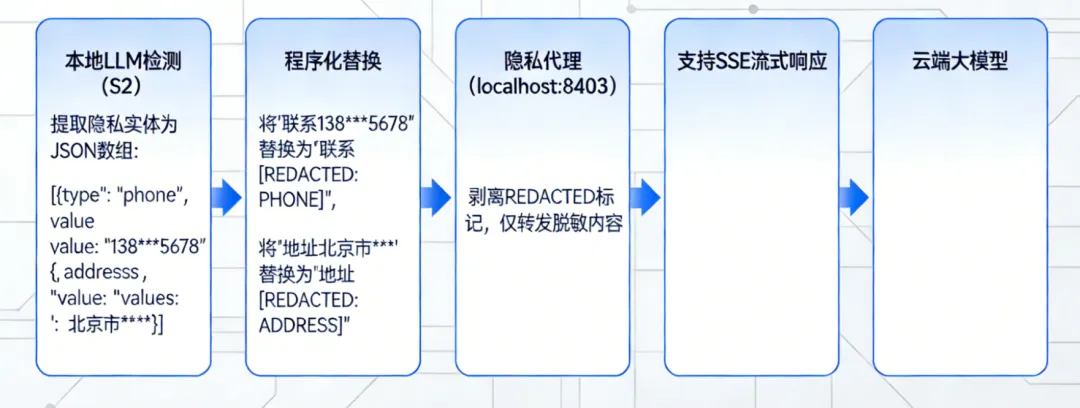

对于 S2 级数据,ClawXRouter 采用 本地 LLM 脱敏 → 隐私代理转发 的架构:

对于 S3 级数据,ClawXRouter 启动 本地 Guard Agent 处理:

~/.openclaw/workspace/├── MEMORY.md ← 云端可见(自动脱敏版)├── MEMORY-FULL.md ← 本地完整版│agents/{id}/sessions/├── full/ ← 完整历史记录└── clean/ ← 云端消费版(脱敏)

-

定理 1(云端不可见性):对于任意 S3 级数据 x,其原始内容对云端完全不可见

∀x, Detect(x) = S3 ⟹ x ∉ Cloud(x)

-

定理 2(脱敏完备性):对于任意 S2 级数据 x,云端可见形式不包含原始隐私实体值

∀x, Detect(x) = S2 ⟹ ∀(ti, vi) ∈ Extract(x), vi ∉ Cloud(x)

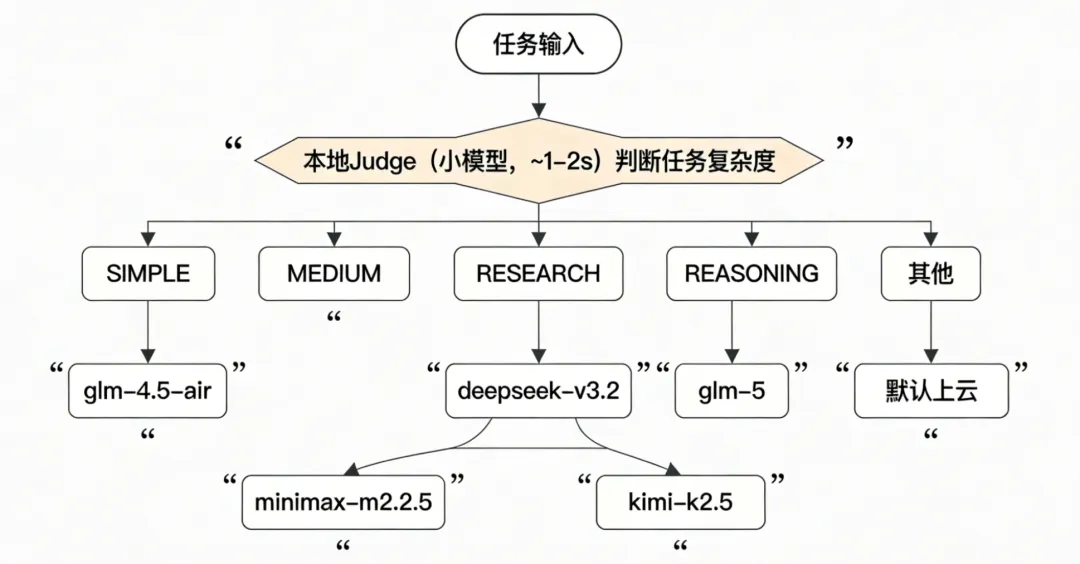

成本感知路由:LLM-as-Judge 的工程实践

ClawXRouter 的另一核心能力是 成本感知路由(Cost-Aware Routing)。

|

|

|

|

|

|

|

|

| LLM-as-Judge |

语义理解、多语言 |

额外一次本地调用(~1-2s) |

ClawXRouter 选择使用 本地小模型 作为 Judge(如 MiniCPM-4.1),在语义理解能力和延迟开销之间取得平衡。

|

|

|

|

| SIMPLE |

|

glm-4.5-air |

| MEDIUM |

|

minimax-m2.2.5 |

| COMPLEX |

|

deepseek-v3.2 |

| RESEARCH |

|

glm-5 |

| REASONING |

|

kimi-k2.5 |

Judge 的评估结果通过 Prompt Hash 缓存 优化延迟:

async function judge(task) { const hash = sha256(task); if (cache.has(hash) && !cache.expired(hash)) { return cache.get(hash); // 命中缓存,跳过Judge调用 } const result = await localJudge.analyze(task); cache.set(hash, result, ttl=300); // 5分钟TTL return result;}

ClawXRouter 在 PinchBench (23 项 OpenClaw Agent 基准测试)上的表现:

|

|

|

|

| ClawXRouter(5 模型混合) |

93.2% / 89.6% |

$2.36 |

|

|

|

|

结论 :成本降低 58%,性能反而提升 6.3%。

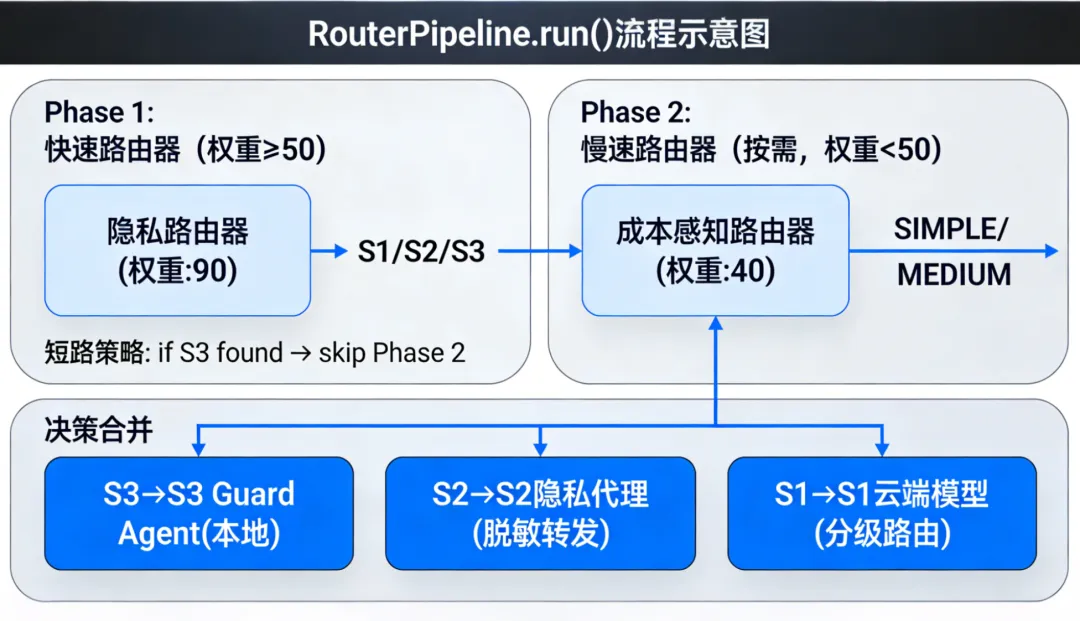

可组合路由管线:10 个 Hook 的全生命周期覆盖

ClawXRouter 的路由决策通过 可组合管线(Composable Pipeline)实现,采用两阶段短路策略 :

-

同级别权重优先 :隐私路由器(90) > 成本路由器(40)

-

passthrough 让步于 redirect :隐私放行时,成本优化生效

-

行为严格性优先 :block > redirect > transform > passthrough

|

|

|

|

before_model_resolve |

|

|

before_prompt_build |

|

|

before_tool_call |

|

|

after_tool_call |

|

|

tool_result_persist |

|

|

before_message_write |

|

|

session_end |

|

|

message_sending |

|

|

before_agent_start |

|

|

message_received |

|

|

与 LangGraph/AutoGen 的定位差异

|

|

|

|

|

| LangGraph |

|

|

|

| AutoGen |

|

|

|

| Dify |

|

|

|

| EdgeClaw/ClawXRouter |

|

三级隐私路由 +GuardAgent |

原生支持 |

关键差异 :EdgeClaw 的核心价值不在于「构建 Agent」,而在于为现有 Agent 系统叠加 安全与成本优化的路由层。

|

|

|

|

|

| 差分隐私 |

|

|

|

| 联邦学习 |

|

|

|

| 可信执行环境(TEE) |

|

|

|

| EdgeClaw 路由 |

|

零改造、灵活、成本低 |

|

>「端侧大模型在隐私安全方面具有天然优势,数据”不出设备”成为 2026 年端侧 AI 的核心卖点之一」

EdgeClaw/ClawXRouter 的出现,标志着 端云协同从「技术可行」走向「工程落地」。

-

更强的本地模型:随着 MiniCPM、Qwen3 等端侧模型能力提升,S2/S3 检测准确率将进一步提高

-

多 Agent 协同:与 Guard Agent 联动,实现更复杂的安全策略

-

硬件加速:结合 NPU/Apple Silicon,实现更低延迟的本地推理

EdgeClaw/ClawXRouter 的出现,为 AI Agent 的「安全焦虑」提供了一个务实的技术解答——不是二选一的妥协,而是 分层治理、各尽其能。

-

三级隐私路由 :用数学定理保证 S3 不可见、S2 脱敏完备

-

成本感知路由 :用 58% 的成本节省证明端云协同的经济性

-

零侵入设计 :通过 Hook 机制叠加,不改业务代对于正在使用或计划部署 OpenClaw 的开发者而言,ClawXRouter 是一个值得认真评估的安全增强方案。

夜雨聆风

夜雨聆风